Claude Code源码泄露:AI圈的一场"地震",到底发生了什么?

AI热点

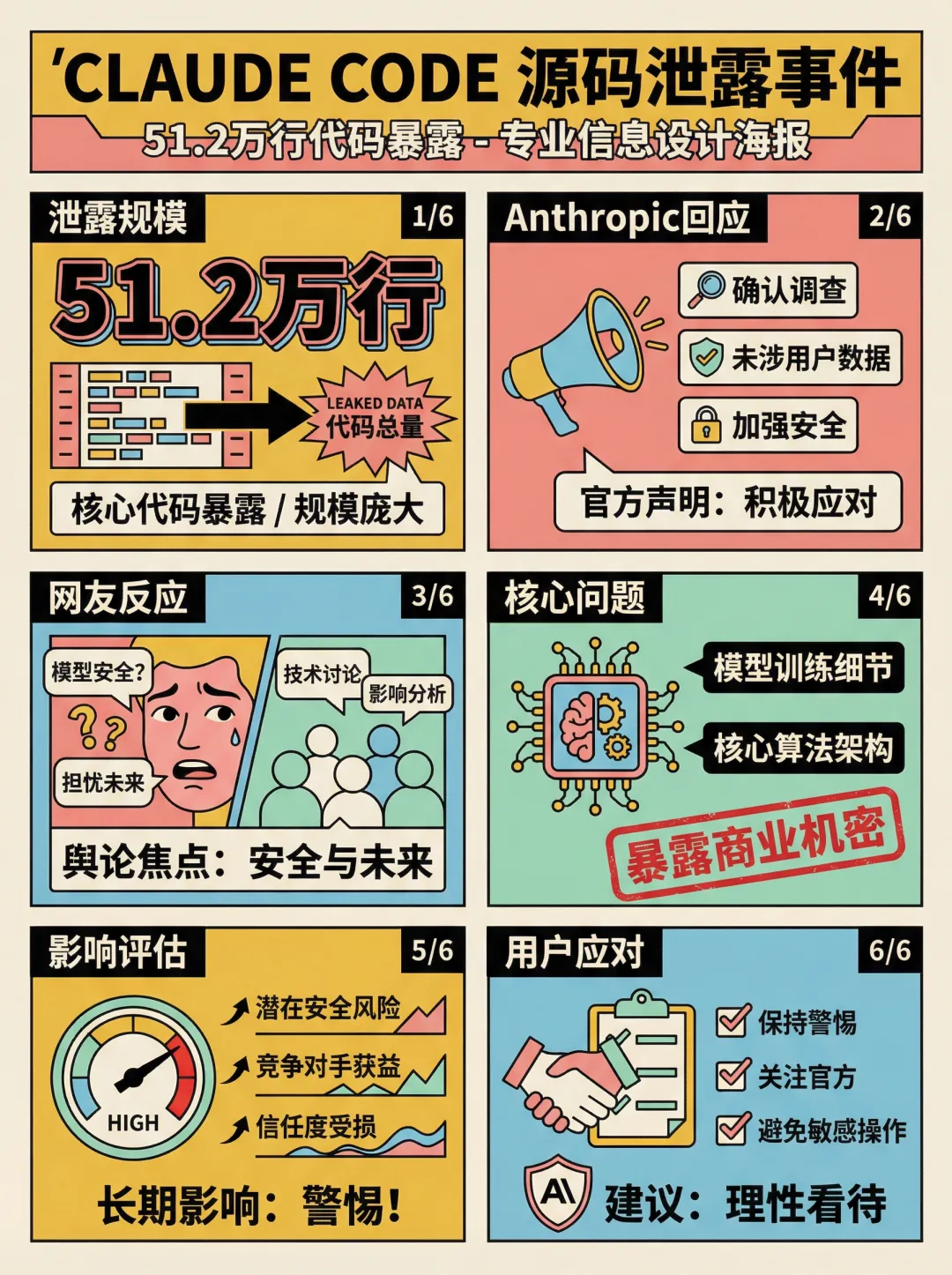

一、事件回顾:51万行代码外泄,Anthropic紧急回应

2026年4月初,AI圈被一条消息炸开了锅——Claude Code的源码疑似泄露。

根据多家媒体披露,这次泄露涉及约51.2万行TypeScript代码,一经曝光便迅速在社交媒体上引发热议。事件的起因是一名匿名用户在X(原Twitter)上发布了一条帖子,声称获取了Claude Code的部分源码,并晒出了代码片段作为”证据”。该帖子很快获得了数万次转发,评论区更是炸开了锅,有人担忧AI安全,有人质疑真实性,也有人已经开始分析起了泄露的代码。

面对这一突发状况,Anthropic的反应堪称迅速。事件曝光后仅数小时,Anthropic便发布了一份官方声明,表示已经注意到相关情况,并强调泄露的代码“仅是框架和工具链代码,不包含核心推理模型”。Anthropic还表示,公司内部已经启动调查,将根据调查结果采取进一步行动。同时,他们也不忘安抚用户:即使源码泄露,Claude的核心能力——即那个”会思考的大脑”——并不会受到影响。

这番表态能否平息众怒?显然不能。很快,质疑声四起:既然只是”工具代码”,那为什么会泄露?这些代码到底包含了什么?Anthropic的回复是否在”避重就轻”?

二、泄露的到底是什么?技术宅们扒出了什么?

所谓”外行看热闹,内行看门道”。虽然大部分普通用户对”源码泄露”这个词无感,但技术圈的反应却极为热烈。

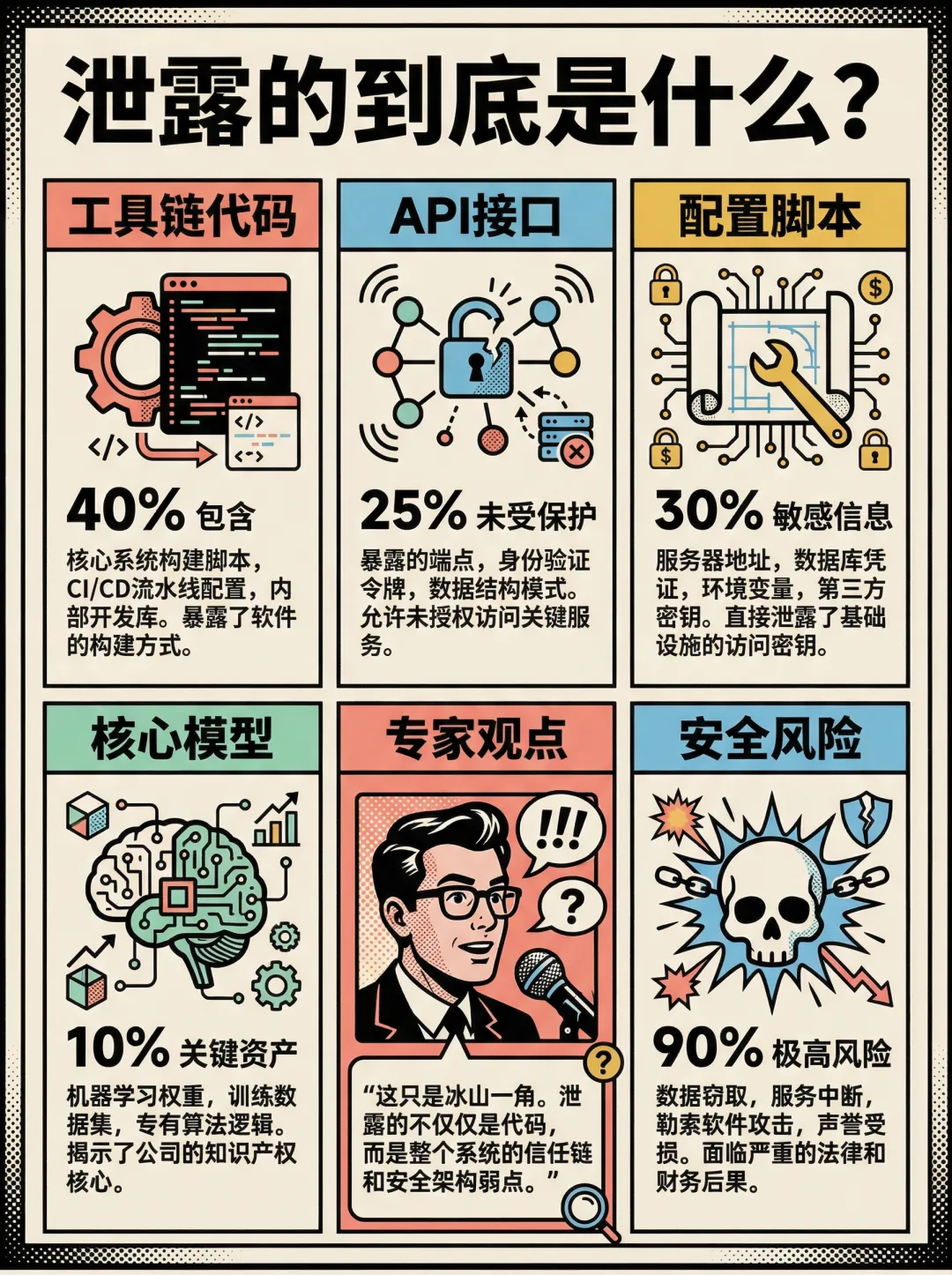

根据一些热心程序员在网上的分析,这次泄露的代码主要包括以下几个部分:

- 第一,Claude Code的工具链代码

。这部分代码主要用于代码编辑、任务规划和项目管理等功能,可以理解为Claude的”双手”。换句话说,它负责让Claude能够帮你写代码、改bug、跑测试,但它本身并不负责”思考”。 - 第二,部分API接口定义

。虽然不涉及核心模型的参数和权重,但一些接口定义的泄露,可能会让研究者逆向分析Claude的工作方式。这对于一家以”AI安全”为核心卖点的公司来说,无疑是一个隐患。 - 第三,一些配置和脚本文件

。包括环境变量设置、构建脚本等。这些信息虽然技术含量不高,但对于试图构建类似系统的人来说,还是有一定参考价值的。

有意思的是,尽管这51.2万行代码看起来数量不少,但与Claude真正核心的”思考能力”——即那个价值数十亿美元训练出来的语言模型——相比,这些代码更像是一个”外壳”。

不过,也有人提出了不同的担忧。安全研究员指出,即使只是工具代码的泄露,也可能被恶意利用。比如,有人可能利用这些代码制造一个”钓鱼版”的Claude Code,诱导用户下载使用,从而窃取敏感信息。这并非危言耸听,此前就曾出现过仿冒AI工具进行网络攻击的案例。

三、Anthropic的”安全人设”会崩塌吗?

提到Anthropic,很多人的第一印象就是”安全优先”。这家公司从创立之初,就一直强调AI安全的重要性,其创始团队更是来自OpenAI的安全部门可以说是AI圈里的“安全派代表”。

然而,这次源码泄露事件,毫无疑问给了Anthropic一记”闷棍”。

质疑点一:安全管理是否到位?

一家以安全见长的公司,为什么会让源码泄露?是内部人员操作失误,还是被外部攻击?虽然Anthropic已经启动调查,但截至目前,具体原因仍未公布。外界难免会猜测:Anthropic的安全措施,是否真的像他们宣传的那样滴水不漏?

质疑点二:开源策略的风险

事实上,Anthropic在去年就已经开始逐步开源部分工具和框架,以吸引开发者生态。这次泄露的代码中,有一部分就来自于其开源的”CLAW”项目。这不禁让人思考:开源固然能促进生态繁荣,但是否也增加了代码管理的风险?这次泄露的代码,是否本不应该被开源?

质疑点三:竞争对手的反应

消息传出后,OpenAI和Google方面均表示”不予置评”。但业内人士都知道,这两家竞争对手绝对不会放过这个”黑料”。未来一段时间,Anthropic在舆论场上的日子恐怕不会太好过。

当然,也有人持不同观点。一位长期关注AI安全的分析师在接受采访时表示:

“任何代码托管在GitHub上的公司,都面临泄露的风险。这次事件固然暴露了Anthropic在代码管理上的漏洞,但并没有证据表明他们的核心模型遭到了泄露。在AI这个圈子里,模型才是最重要的资产,只要模型安全,一切都好说。”

四、源码泄露,对我们普通用户意味着什么?

说了这么多,吃瓜群众最关心的可能是:这件事跟我有什么关系?我用的Claude会不会变差?

答案是:基本没关系,你用的Claude还是那个Claude。

首先,如Anthropic所说,泄露的代码并不包含核心模型。换句话说,你的Claude仍然会”思考”、会”推理”、会”回答问题”。这些能力是由数十亿参数构成的神经网络决定的,而不是那些工具代码。

其次,Anthropic已经表态会加强安全管理,并追查泄露源头。对于普通用户来说,这反而可能是一件好事——一家公司吃了亏,往往会在安全上投入更多。

第三,如果你正在使用Claude Code进行开发,建议密切关注官方公告,留意是否有安全更新。同时,也要注意辨别网上那些”声称可以提供泄露代码”的链接,避免遭遇钓鱼攻击。

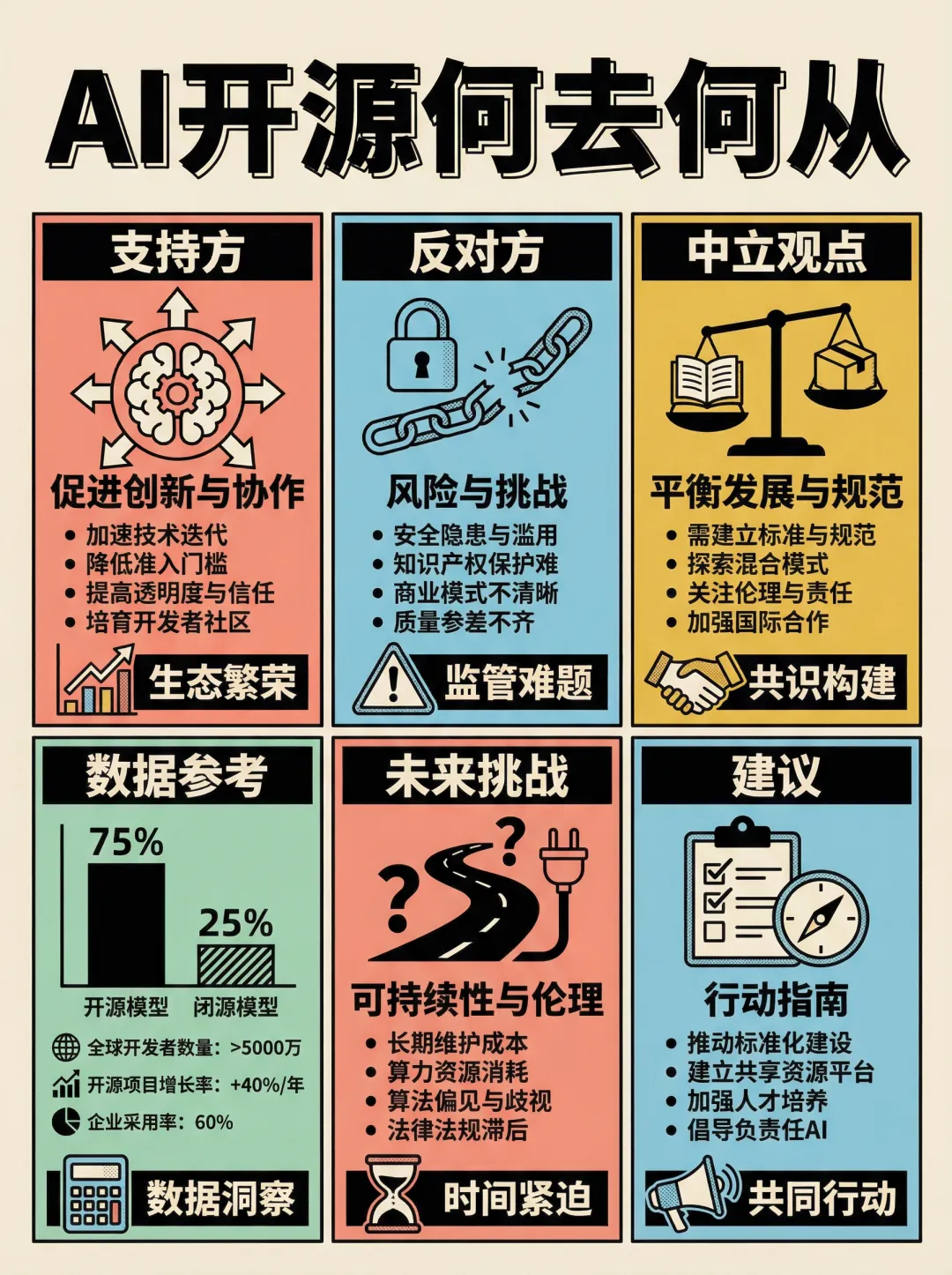

五、行业影响:AI开源该何去何从?

这次事件,也引发了关于AI开源的新一轮讨论。

支持开源的一方认为:开源促进了AI技术的进步,让更多研究者能够参与到AI的发展中来。如果因为害怕泄露而固步自封,整个行业都会倒退。Anthropic开源部分工具的做法值得肯定,这次泄露只是一个”意外”。

反对开源的一方则认为:AI不同于传统软件,一旦核心能力泄露,后果不堪设想。这次泄露虽然没有涉及核心模型,但已经给行业敲响了警钟。未来的开源策略,应该更加谨慎。

中立观点则认为:开源与安全并不矛盾,关键在于”度”的把握。哪些可以开源,哪些必须保密,需要更加精细的划分。

事实上,不仅仅是Anthropic,整个AI行业都面临着类似的抉择。据统计,2025年全球AI公司因代码或数据泄露导致的安全事件超过200起,涉及金额高达数十亿美元。如何在开放与安全之间找到平衡,将是未来几年AI行业的重要课题。

六、写在最后

Claude Code源码泄露事件,虽然没有造成传说中的”毁灭性打击”,但也足以让AI圈警醒。

对于Anthropic来说,这次事件是一次教训,也是一次考验。如果他们能够妥善处理调查、加强安全管理,反而可能化危为机,进一步巩固”安全优先”的人设。但如果处理不当,等待他们的可能是信任危机。

对于整个AI行业来说,这也是一个警示:在追求技术进步的同时,安全永远是底线。正如一位资深从业者所说:

“AI可以是工具,可以是伙伴,但绝不能是悬在头顶的达摩克利斯之剑。”

最后,提醒一下各位小伙伴:如果你的工作或生活中用到了Claude Code,记得及时更新版本,关注官方安全公告。毕竟,在AI时代,安全这件事,怎么强调都不为过。

夜雨聆风

夜雨聆风