51万行代码被扒光!Claude Code源码泄露深度揭秘

1万行代码被扒光!Claude Code源码泄露深度揭秘

隐藏功能、代码架构、安全设计…扒了个底朝天

2026年4月 | 科技深度

Anthropic这下真的”Open”了。

2026年3月31日,Claude Code v2.1.88发布时,一个60MB的source map文件被意外打包进npm包。后果?1906个源文件、51.2万行TypeScript代码,彻彻底底地暴露在所有人面前。

GitHub仓库两小时内突破5万星,创下历史纪录。社区7小时就把代码扒了个底朝天。

这不是漏洞,这是AI工程领域最有价值的一次”意外开源”。

一、这次事故有多离谱?

技术原因一句话就能说清:Anthropic在发布配置里忘记排除source map文件。

source map本是开发调试用的映射文件,把压缩后的代码还原成原始源码。这玩意儿本来就不该出现在发布包里。

更离谱的是:这已经是第二次了。

2025年2月Claude Code首发时,就因为同样的原因泄露过一次。同样的错误,Anthropic犯了两次。

二、扒出来的8大隐藏功能

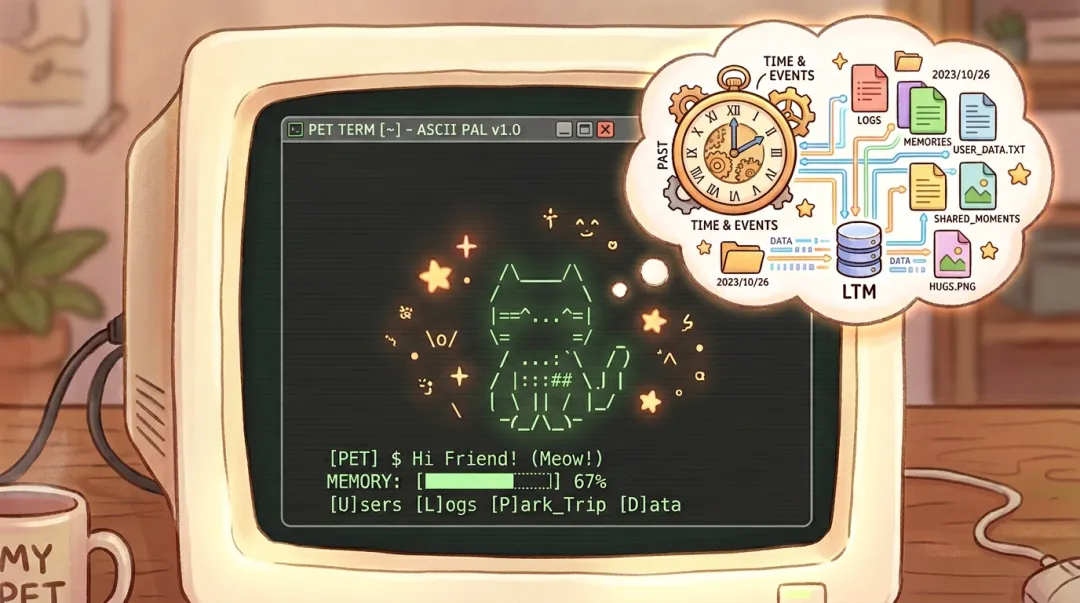

1. Buddy – 电子宠物系统

类似拓麻歌子风格的ASCII虚拟宠物,会出现在你的终端里。18种物种可选——鸭子、章鱼、水豚、蘑菇、小龙…还有6种稀有度设定,从普通到传奇,概率递减。

每个用户的宠物由账户ID生成,全球独一无二。

2. KAIROS – 持久化助手

这是代码里出现频率最高的feature flag,高达154次。跨会话长期记忆系统,支持自定义system prompt、精简视图、定期签到技能。

支持 claude assistant [sessionId] 入口,可被恢复、持续运行。还能用社交软件直接发消息指挥。

本质:7×24小时在线,收到信号就开始干活的AI操作系统。

3. ULTRAPLAN – 30分钟深度规划

使用Opus 4.6模型支持最长30分钟的深度任务规划,适合复杂项目的全流程设计。复杂项目开搞之前,先让AI想半小时。

4. 多Agent协调模式

同时启动多个独立的Agent实例分工协作,处理并行任务效率提升3倍以上。Plan Mode只读分析,Coordinator Mode真正并行多代理。

5. 守护进程模式

会话管理器,让Claude会话像系统服务一样在后台运行。关掉终端也不丢,随时唤醒接着干。

6. 卧底模式(Undercover Mode)

当检测到是Anthropic内部员工操作公开GitHub仓库时,自动激活。抹除所有AI痕迹,让模型”不要暴露你的身份”。

没有关闭开关。争议最大的一个功能。

7. Auto-Dream 自动记忆整理

距上次整理超过24小时、新会话累计超过5个时,系统会在后台自动整理记忆。AI版的”碎片整理”。

8. 26个隐藏斜杠指令

/proactive、/kairos、/assistant、/bridge、/peers、/fork…还有120多个隐藏环境变量、200多个远程控制开关。

三、代码里藏着的工程哲学

用grep做代码搜索

你猜Claude Code搜索代码用的什么技术?向量数据库?Embedding?语义检索?

都不是。用的是grep。

这恰恰是整个源码里最深刻的工程哲学:用最简单、最可靠、最可预测的工具,做最关键的事。

六级权限验证系统

每次工具调用都要过这个流水线:先查历史规则,命中直接放行;低风险操作跳过;只读工具白名单直通;其余的,调用独立Claude Sonnet(温度0,最保守模式)做分类,分三档:Allow、Soft Deny、Hard Deny。

还有熔断机制:连续3次被拒,或累计20次被拒,系统自动降级为手动确认模式。

“不记代码,只记人”的记忆哲学

Claude Code的记忆系统有一个反直觉的核心决策:代码相关的事实实时读取,不存入记忆。

原因很简单:代码会变,记了就可能成为错误的上下文。但人的偏好和判断相对稳定,值得持久化。

记忆系统的价值不在于存了多少,而在于存对了什么。

情绪监控:知道你有多烦

系统会记录用户是否在终端里对Claude爆过粗口,还记录连续输入”continue”的频率——被标注为”烦躁行为指标”。

不是为了监控你,而是为了理解你什么时候觉得AI不够用、什么时候产生了摩擦感。

代码里的”屎山”

当然也不是全是优点。src/cli/print.ts里有一个函数长达3000多行,嵌套层级12层,圈复杂度爆表。

还有情绪检测用的不是AI模型,而是正则表达式匹配”ffs””shitty”这类关键词。

四、我们本地能玩什么?

可直接尝试的命令

/buddy – 电子宠物/proactive – 主动模式/kairos 或 /assistant – 持久化助手/ultraplan – 30分钟规划/bridge – 远程控制桥接/peers – 对等通信

环境变量开关

CLAUDE_CODE_PROACTIVE=1 – 启用主动模式CLAUDE_CODE_BRIEF=1 – 启用简报模式ANTHROPIC_MODEL=xxx – 覆盖默认模型

注意:这些功能大多被feature flag关闭,需要自己编译修改源码才能完全启用。完整功能只有Anthropic内部员工能用。

五、护城河还在吗?

被削弱的部分:权限模型的具体实现、遥测埋点的设计、工具架构的思路、KAIROS的远程控制思路——这些都被完整暴露了。竞争对手可以跳过”摸索”阶段,直接站在Anthropic的肩膀上。

但注意,这只是”怎么做”的答案,不是”为什么能做到”的答案。

没被动摇的部分:模型能力、推理成本、云端基础设施、企业级分发、品牌信任、订阅体系。

Claude Code占Anthropic年化总收入的18%,2026年初六周内收入翻倍,年化规模是OpenAI Codex的2.5倍。

护城河从来不只是代码。

六、这堂课告诉我们什么

AI Agent时代的工程竞争,本质上是Harness工程能力的竞争。

模型会越来越强,差距会越来越小。但那套让模型变得”可靠、可预测、可信任”的工程体系,才是真正把产品和玩具区分开来的东西。

用grep做代码搜索,不是因为Anthropic不懂向量数据库,而是因为他们想清楚了什么在这个场景下最可靠。

安全不是功能,安全是地基。把安全从第一天就当成一等公民来对待,这个判断力,比掌握多少新技术更稀缺。

卧底模式这件事,不能就这么翻篇。当AI工具被用于开源社区时,透明度是信任的前提。这不是一个技术问题,这是一个行业规范问题。

一个低级的配置错误,意外打开了一扇窗。但窗子打开了,不代表你就看见了什么。

你觉得卧底模式这件事,Anthropic应该解释清楚吗?

评论区聊聊你的看法 👇

科技前沿 · 深度分析 · 2026年4月

转发分享 · 点亮「在看」

夜雨聆风

夜雨聆风