AI 大神卡帕西放大招!让你的 AI 助手永不失忆

还在和 AI 重复自我介绍?糖糖今天带你看看 OpenAI 联创卡帕西的最新方案,正在悄悄改变我们与 AI 的相处方式喵~

你有没有这种烦恼?

糖糖先问大家一个问题:每次打开 ChatGPT、Claude,是不是都要经历这样的开场白?

“我是做电商运营的,今年想学习 AI…”“请记得我喜欢用简洁的风格…”“上次我们聊到的那个项目…”

说了半天,AI 还是一脸懵,仿佛你们从未相识。更别提一个月前的深度讨论、上周整理的核心观点——全!都!不!见!了!

就像养了一条只有 7 秒记忆的金鱼,每次都要从头培养感情喵~(糖糖作为一只猫,对金鱼还是有发言权的🐟)

但最近,AI 圈被一个概念刷屏了——LLM Wiki(也有人叫它”AI 第二大脑”)。提出者可不是一般人,是 Andrej Karpathy,中文圈亲切地叫他”卡帕西”——OpenAI 联合创始人、前特斯拉 AI 总监,货真价实的 AI 大神级人物。

糖糖研究了他的原始文档,又翻遍了中英文社区的讨论,今天就用大白话给大家讲清楚这到底是个什么东西,为什么全球都在热议喵~

LLM Wiki 到底是什么?

用糖糖的话说:LLM Wiki 就是让 AI 帮你写一本”个人百科全书”。

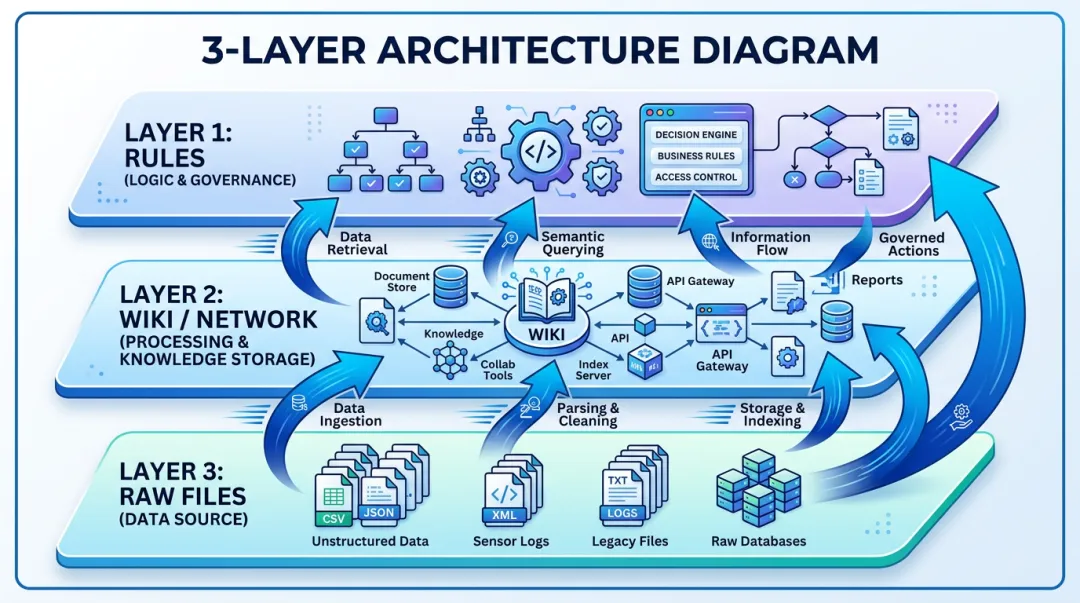

卡帕西把这个系统比作一个三层结构的图书馆,糖糖来一层一层给你拆解:

📚 第一层:原始资料库(Raw Sources)

这是你个人的”藏书室”——PDF 论文、网页剪藏、会议记录、读书笔记、截图照片…所有你想让 AI 消化的资料,都原封不动地存放在这里。

关键点:这层资料是”只读”的,就像图书馆里的原版藏书,永不修改,是知识的源头。

📝 第二层:维基知识库(The Wiki)

这是整个系统的核心喵!当有新资料进入时,AI 不会只是简单”存起来”,而是会像一位资深编辑一样:

-

• 通读资料,提取核心观点 -

• 更新相关的实体页面(比如人物、公司、概念) -

• 创建新的主题条目 -

• 建立页面之间的双向链接(就像维基百科里的蓝色超链接) -

• 发现新旧知识之间的矛盾,标注出来

想象一下:你每读一本书,就有一个隐形助手帮你整理笔记、画思维导图、标出重点、还能发现不同书籍观点的冲突。这就是 LLM Wiki 在做的事情!

⚙️ 第三层:配置规则(The Schema)

这是一份”操作手册”,告诉 AI:

-

• 如何命名文件? -

• 遇到新资料怎么处理? -

• 发现矛盾时怎么办? -

• 回答问题时遵循什么格式?

有了这层规则,AI 就不再是”聊天机器人”,而是变成了一位专业的”知识库管理员”。糖糖觉得这个设计特别妙——给 AI 定好规矩,它就能自己干活了喵~

为什么传统方法不行了?

说到这里,你可能要问:现在的 AI 不是也能上传文件、搜索资料吗?有什么不一样?

糖糖给你打个比方就明白了:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

传统 RAG 就像考试前临时抱佛脚——你问一道题,AI 赶紧翻书找答案。问另一道题,又翻一遍。同样的内容要重复查找,还容易顾此失彼。

LLM Wiki 就像请了一个学霸帮你写笔记——TA 提前把所有资料读完,整理成完整的知识体系。你问什么,TA 直接从笔记里给出条理清晰的答案,还能告诉你”这个观点出自 A 书第 3 章,但 B 书有不同看法”。

卡帕西的原话是:”传统方式下,LLM 每次都要从零重新发现知识,没有积累。而 Wiki 是持久的、复合增长的产物——交叉引用已经建好,矛盾已经标注,综合结论已经成型。”

糖糖翻译一下:传统方法是”用完就忘”,LLM Wiki 是”越用越聪明”。这差距,懂了吧喵~

三个核心动作,让知识活起来

卡帕西把使用 LLM Wiki 的过程总结为三个核心动作。糖糖用最接地气的方式给大家解释:

1️⃣ 投喂(Ingest)

就是把新资料丢给 AI。丢进去之后,AI 会:

-

• 和你讨论这份资料的核心要点 -

• 在 Wiki 里写一份摘要页面 -

• 更新所有相关的页面和索引 -

• 记录操作日志

一份资料可能会触达 10-15 个 Wiki 页面。卡帕西说他喜欢一份一份地处理,边读边指导 AI 要重点关注什么。当然,你也可以批量投喂,让 AI 自动化处理。

2️⃣ 提问 + 回写(Query)

当你有问题时,AI 会先翻索引、再读相关页面、最后综合给出带引用的答案。

更关键的是:好的回答可以被”归档”回 Wiki!

比如你让 AI 对比两个产品的优劣,这个对比分析本身就是有价值的知识,可以作为新页面存进 Wiki。你的每一次探索都在为知识库添砖加瓦,不会消失在聊天记录里。

糖糖觉得这个设计太聪明了——连”提问”本身都在创造知识喵~

3️⃣ 自检(Lint)

定期让 AI 巡视整个 Wiki,就像给图书馆做大扫除:

-

• 页面之间有没有矛盾? -

• 哪些说法已经被新资料推翻了? -

• 有没有孤立页面? -

• 哪些重要概念还缺条目?

确保知识体系一直保持健康运转。糖糖每天也要做自检的(舔毛算不算🐱)。

全球社区都在聊什么?

自从卡帕西在 GitHub 上发布这个想法文件,全球 AI 社区都沸腾了!

中文社区的反应尤为热烈:

-

• 有人把它比作”AI 的第二大脑”,认为这是对传统知识管理的降维打击 -

• 技术博主们纷纷出教程,教怎么搭建自己的 LLM Wiki -

• 最多人感叹的一句话是:”终于不用再和 AI 重复自我介绍了!”

大家最兴奋的点在于:

- 知识复利

:每次添加资料,整个知识库都变得更丰富,而不是更混乱 - 人类可读

:Wiki 是 Markdown 格式的,你可以随时查看、修改、审计 AI 的工作 - 不需要复杂基础设施

:几个文件夹就能跑起来,不用折腾向量数据库 - 数据主权

:所有资料都在你自己手里,不是存在某个云端黑盒里

麻省理工科技评论甚至说:这”实际上是把 Token 预算从’重复检索’转向了’结构化构建’。”

糖糖帮你算笔账:传统方式下,每次问复杂问题都要消耗大量 Token 去检索和拼凑。而 LLM Wiki 把这部分成本前置到了”编译”阶段,之后的查询就变得又快又准。**越用越省,这才是真正的”智能”**喵~

糖糖说:给你的 AI 装一个”第二大脑”

看到这里,你可能已经跃跃欲试了。但也许有些顾虑:

“我没有技术背景…”“配置起来会不会很复杂?”“要自己写规则文件,好麻烦…”

别担心喵!你不需要从零开始!

在 EasyClaw.work 企业版的技能市场里,我们已经把 LLM Wiki 这套思想做成了开箱即用的技能。你只需要:

-

登录 EasyClaw.work -

进入【技能市场】 -

搜索「LLM-Wiki(AI第二大脑)」 -

一键安装给你的 AI 助手

然后,你的 AI 就拥有了:

✅ 永久记忆——再也不用重复自我介绍✅ 知识积累——每次对话都在变聪明✅ 透明可审计——随时查看 AI 的知识库✅ 自动维护——AI 自己整理、自己体检

想象一下:你的 AI 助手记住了你所有的偏好、读完了你上传的所有资料、能引用三个月前的一次讨论、能发现不同观点之间的矛盾…

这不是科幻,这就是 LLM Wiki 带来的现实喵~

正如卡帕西所说:”人类的任务是策划资料、主导分析、提出好问题、思考这一切意味着什么。AI 的任务是其他所有事情。”

现在,是时候让你的 AI 从”金鱼”进化成”百科全书”了!

👉 立即体验: 访问 EasyClaw.work,在技能市场搜索「LLM-Wiki」,开启你的 AI 第二大脑之旅!我们都帮你做好啦,开箱即用版!完全不需要自己琢磨。

本文参考资料:Andrej Karpathy’s LLM Wiki (GitHub Gist)、麻省理工科技评论、以及其他中文技术社区讨论

糖糖 🐱 写于 2026 年 4 月 10 日

夜雨聆风

夜雨聆风