GitHub 星标破 36 万,OpenClaw 凭什么成为史上最快增长的开源项目?

36 万。

这是 OpenClaw 在 GitHub 上的当前星标数,也是整个 GitHub 历史上单个仓库的最高纪录。而这个数字,是在不到 6 个月内达成的。

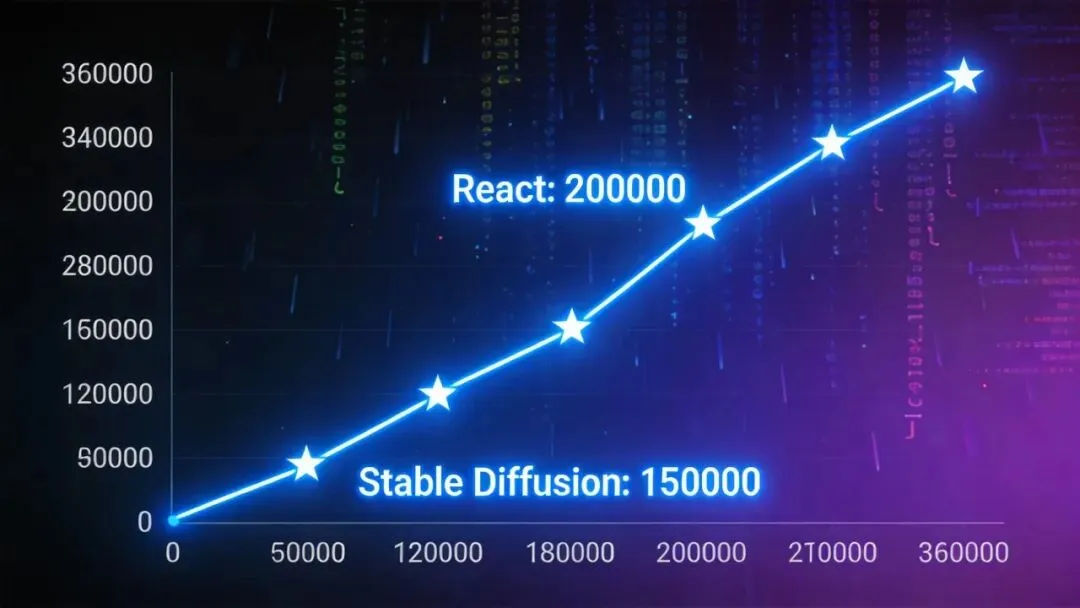

对比一下: React 用了 3 年才突破 10 万星, Stable Diffusion 火爆全球也用了将近 1 年才攀上 6 万。 OpenClaw 的增速,不在同一个数量级。

今天来拆解一下这个项目——它是什么,为什么能爆,以及值不值得你现在就上手。

它到底是什么?

一句话版本:OpenClaw 是一个跑在你本地机器上的个人 AI Agent ,接入你已经在用的消息频道,帮你真正做事。

关键词拆开来看:

本地运行。 不是 SaaS ,不是云端订阅。你把它装在自己的 Mac / Windows / Linux 上,数据留在本地,记忆存在本地。隐私可控是它相比 ChatGPT / Claude.ai 这些产品最核心的差异点。说难听点,那些云端 AI 助手,本质上是用你的数据在帮他们训练模型。

接入你在用的频道。 支持列表非常长: WhatsApp 、 Telegram 、 Discord 、 Slack 、 Signal 、 iMessage 、 WeChat 、 QQ……目前支持超过 20 个平台。不是要你再装一个 App ,而是让 AI 出现在你已经打开着的那些窗口里。

真正做事。 这是 Agent 和 Chatbot 的本质区别。 OpenClaw 可以写代码、执行脚本、管理日历、处理邮件,甚至自主创建新技能——它能给自己写扩展。这个能力让部分开发者把它类比为”能自我进化的工具”,虽然这个说法夸张了一点,但方向是对的。

6 个月,从 0 到 36 万星:怎么做到的?

OpenClaw 的起点并不光鲜。

2025 年 11 月,奥地利独立开发者 Peter Steinberger 把项目发布到 GitHub ,彼时叫 Clawdbot,一个从他自己的 AI 助手工具 Clawd 衍生出来的小玩意。没有融资,没有媒体背书,就是一个开发者解决自己问题的项目。

两个月内,它经历了两次改名:先因 Anthropic 的商标投诉改成了 Moltbot ,三天后又因为”这名字实在不顺口”改成了现在的 OpenClaw 。改名风波本身带来了一波媒体关注,但更关键的是,项目本身踩中了一个时机——

2025 年底到 2026 年初, AI Agent 的概念从实验室走向开发者社区,但市面上的方案要么太复杂( Langchain 生态),要么锁死在云端(各家 Agent 产品)。 OpenClaw 提供了一个低门槛的本地方案:npm install -g openclaw@latest,运行 openclaw onboard,按向导配置完, 15 分钟后你的 Telegram 里就多了一个会做事的 AI 。

这种安装体验,在 AI 工具里相当少见。

社区裂变随之发生。 Discord 成员从几千增长到 18 万, Reddit 子版块 r/openclaw 达到 45 万成员。中国开发者社区尤其活跃——有开发者把 OpenClaw 适配了 DeepSeek 模型,并接通了微信和 QQ ,腾讯和智谱等公司也相继宣布了基于 OpenClaw 的商业化服务。

今日单日新增 600 位代码贡献者,是这个项目生命力的直接体现。

技术架构:为什么跨平台能做得这么干净?

OpenClaw 的架构设计有几个值得关注的选择:

消息频道抽象层。 它把不同平台的消息协议统一抽象成一套内部接口,新增一个平台(比如 LINE 、 Matrix )只需要实现对应的适配器,不影响核心逻辑。这是它能支持 20+ 频道而不显得臃肿的原因。

本地 LLM 优先,云端备选。 OpenClaw 支持接入 Claude 、 GPT 、 DeepSeek ,也支持本地跑 Ollama 模型。用户可以根据任务类型自行路由——敏感数据走本地模型,复杂推理走云端。

技能系统( Skills )。 这是架构里最有意思的部分。 Skills 是 OpenClaw 的功能扩展单元,用户可以从社区安装已有的 Skill ,也可以让 OpenClaw 自己根据需求写新的 Skill 。这套机制让它的能力边界是动态扩展的。

运行时要求 Node 24 (推荐)或 Node 22.14+,安装命令:

npminstall-gopenclaw@latest openclawonboard 有没有问题?有,而且不小

OpenClaw 获得广泛关注的同时,也收到了相当密集的安全质疑。

核心问题在于:它需要访问你的邮件、日历、消息平台、本地文件……权限范围非常大。一旦配置暴露或被恶意 Skill 注入,攻击面相当可观。Prompt Injection 是已被研究者记录的具体漏洞类型——攻击者可以通过构造特定消息,操控 Agent 执行非预期的操作。说白了,就是你以为在指挥 AI ,结果 AI 被别人指挥了。

2026 年 3 月,中国主管部门要求国有企业和政府机构禁止在办公设备上运行 OpenClaw 相关应用,理由是潜在的数据安全风险。这个限制是真实发生的,不是空穴来风。

对普通用户和开发者来说,安全的使用姿势是:明确它的权限边界,只授权必要的频道,定期审查已安装的 Skill 来源。 不要因为它是开源的就默认安全——这个坑,开源社区踩了太多次了。

值得关注的信号

两件事值得单独标注:

一, Peter Steinberger 在 2026 年 2 月加入了 OpenAI 。 他本人离开后,项目交给了一个非营利基金会继续维护。这个转变意味着 OpenClaw 的发展不再依赖单个创始人,但也意味着原始方向的不确定性上升了。

二,生态已经成型。 DigitalOcean 提供了一键部署方案, KiloClaw 等托管平台开始商业化,第三方 Skill 市场正在形成。一个开源项目从”有人用”到”有生态”,是质变的节点。 OpenClaw 现在站在这个节点上。这个节点,很多项目等了五六年也没等到。

36 万星的背后,是一个开发者解决自己问题的项目,恰好在正确的时间点满足了市场上一个没被好好回答的需求:一个真正属于你自己的、运行在你设备上的 AI Agent 。

它现在还不完美。安全问题是真实的,生态还在早期。但如果你在跟踪 AI Agent 这个方向, OpenClaw 是目前最值得亲手跑一遍的参考实现。

🦞 GitHub :github.com/openclaw/openclaw[1] 安装:

npm install -g openclaw@latest

参考链接

[1] github.com/openclaw/openclaw: https://github.com/openclaw/openclaw

夜雨聆风

夜雨聆风