1区8分!又是多模态AI!H&E图像+转录组4基因构建eHCC检测模型,TMC-net两阶段深度学习外部AUROC达0.99,Grad-CAM可视化辅助病理诊断

eHCC和HGDN镜下难分辨?8分顶刊带来破局方案:TMC-net两阶段深度学习解析H&E图像,联合转录组4标志基因构建多模态模型,外部AUROC破0.95。病理AI+分子标志物+可解释可视化,思路清晰可复刻!

eHCC和HGDN镜下难分辨?8分顶刊带来破局方案:TMC-net两阶段深度学习解析H&E图像,联合转录组4标志基因构建多模态模型,外部AUROC破0.95。病理AI+分子标志物+可解释可视化,思路清晰可复刻!

福利大放送!!!关注回复“资料”2字,即可免费领取生信资料,包括数据集、绘图代码、图表复现、思路总结、参考文献……0代码鼠标点一点,就能轻松完成5—10分生信SCI全文复现!(持续关注我们,每天为您解读最新见刊的文献!)

新鲜出炉!今天给大家深度剖析一篇2026年3月发表在《Npj Precision Oncology》上的文章,题目为:用于肝细胞癌早期检测的多模态AI模型。

团队成员合影(位于上海陆家嘴中心,可随时预约参观)

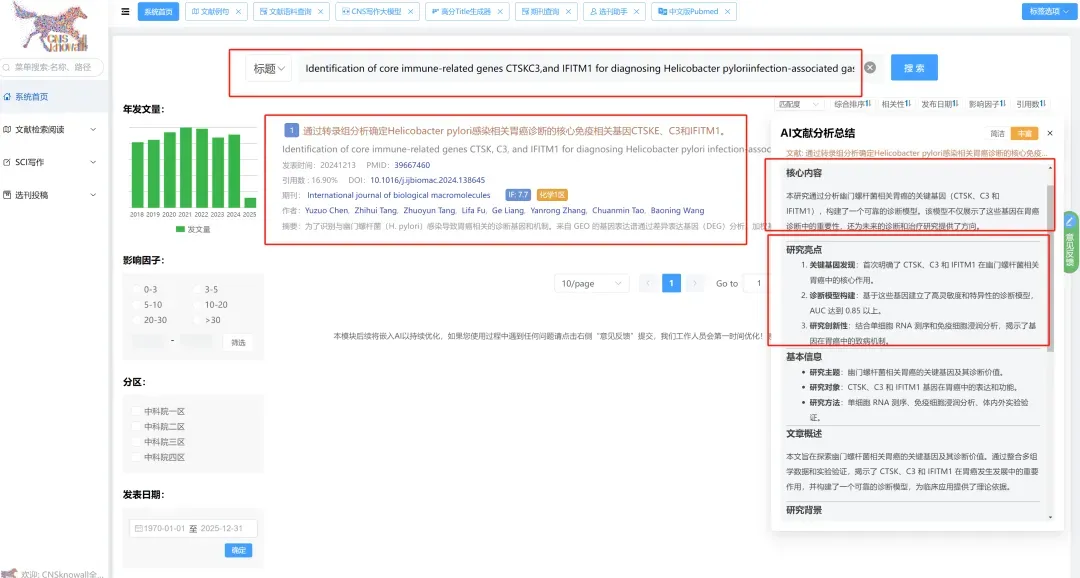

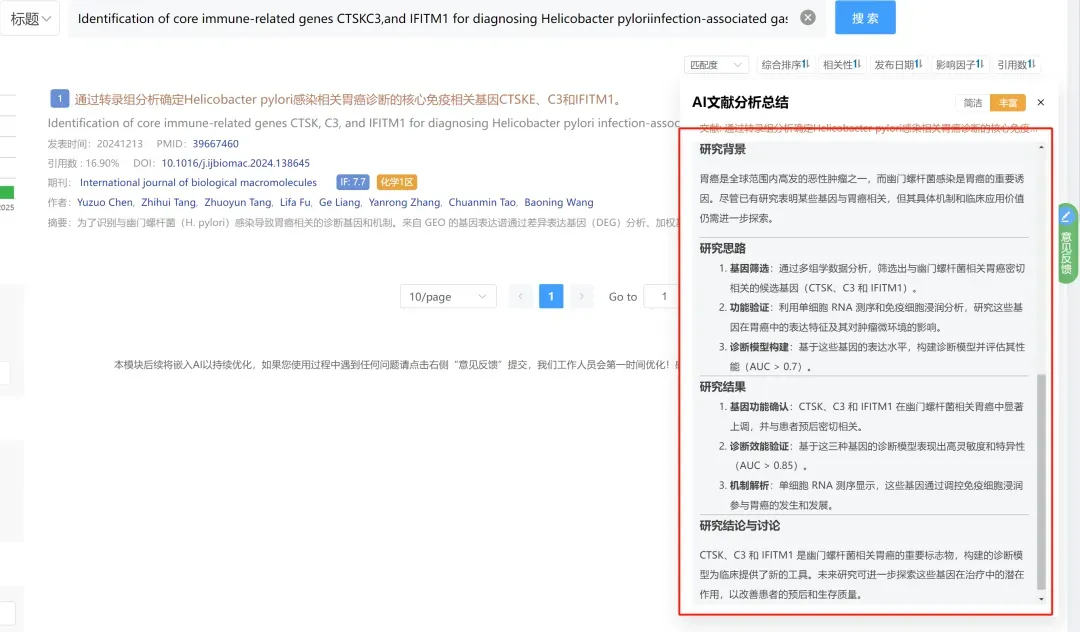

CNSknowall 平台 Pubmed+AI 快速提炼

研究亮点·研究思路·研究结果·研究结论

TMC-net模型在H&E图像特征提取上优于病理学基础模型和传统组织病理学特征,且学习到的特征与临床诊断标准一致,可辅助低年资病理医生提高诊断准确性。

基于标志基因与组织病理学特征的多模态模型在外部测试集上AUROC达到0.9500,表现出优异的泛化能力。

研究验证了所选基因的形态-表型相关性,并在更广泛的HCC队列中发现多模态特征与患者预后相关。

提出两阶段多尺度深度学习模型(TMC-net),能够从H&E图像中捕捉eHCC与HGDN之间的细微特征差异。

整合转录组比较分析筛选出的4个标志基因与图像特征,构建多模态分类模型,实现了优于单一模态的诊断性能。

将AI学习的特征可视化于虚拟图像上,为病理诊断提供了可解释性辅助。

早期肝细胞癌(eHCC)的检测对于及时治疗和改善预后至关重要,但区分eHCC与癌前高分级不典型增生结节(HGDN)具有挑战性。现有病理诊断方法依赖形态学特征,且存在主观性差异,因此需要更精准的辅助工具。

1.基于H&E图像,开发两阶段多尺度深度学习模型(TMC-net)以捕捉eHCC与HGDN的细微特征,并与病理学基础模型及传统组织病理学特征进行性能比较。

2.通过比较转录组分析筛选潜在生物标志物(最终确定4个标志基因)。

3.将标志基因与组织病理学特征结合,构建多模态分类模型,并在内部和外部测试集评估其AUROC。

4.验证所选基因的形态-表型相关性,并分析多模态特征在更广泛HCC队列中与患者预后的关联。

TMC-net模型在H&E图像上表现优于病理学基础模型和传统组织病理学特征,且学习到的特征与临床诊断标准一致,可通过虚拟图像突出显示,辅助低年资病理医生提高诊断准确性。

通过比较转录组分析筛选出4个标志基因。

基于标志基因和组织病理学特征的多模态模型,内部测试集AUROC为0.8875,外部测试集AUROC为0.9500。

确认了这些基因的形态-表型相关性,且多模态特征在更广泛的HCC队列中与患者预后相关。

本研究揭示了早期肝细胞癌(eHCC)的组织病理学和转录组特征,并提供了一种优化的AI辅助诊断解决方案。TMC-net模型能够精准捕捉H&E图像中的细微特征,而多模态融合策略进一步提升了诊断效能。该框架不仅有助于鉴别eHCC与HGDN,还为临床预后评估提供了潜在依据,有望在病理诊断中辅助低年资医生并提升诊断一致性。

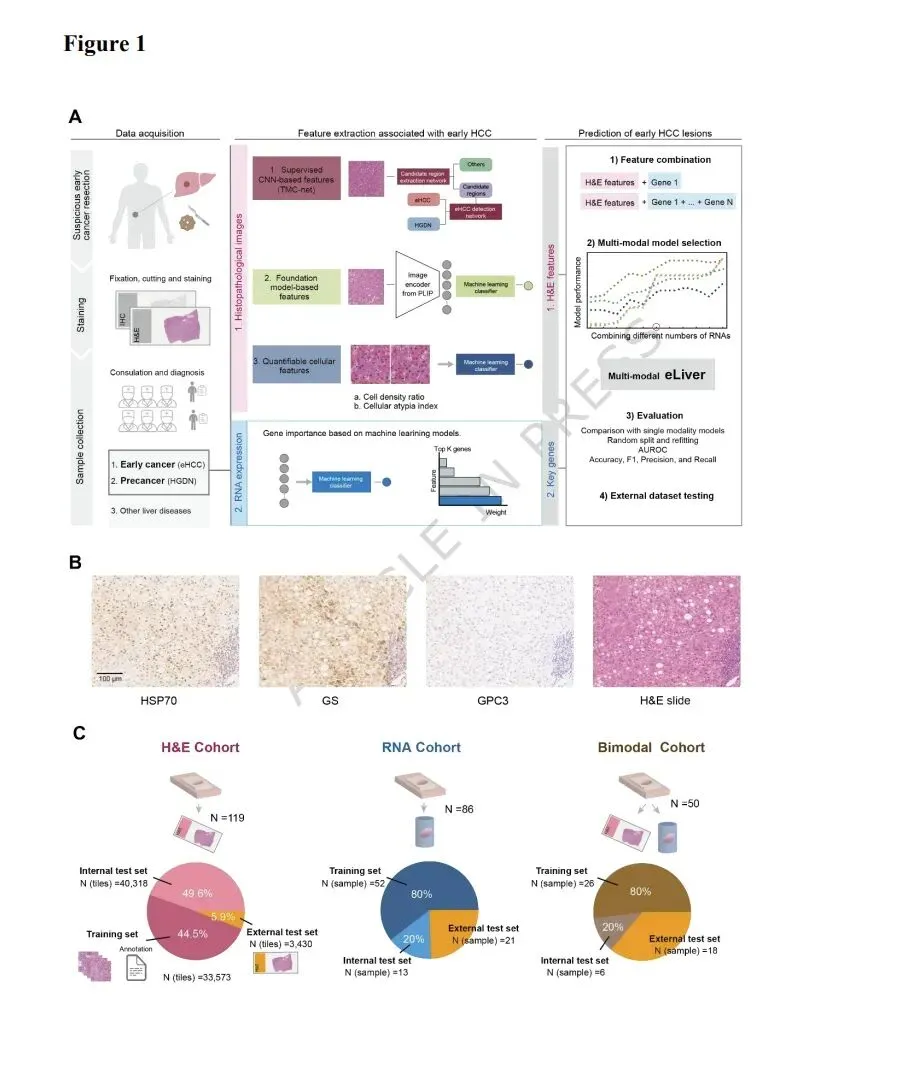

为了识别与HGDN和eHCC相关的生物标志物并构建人工智能模型以支持诊断,我们首先从H&E图像和转录组中提取了组织病理学和表达特征,然后构建了单模态和多模态模型来分类eHCC、HGDN及其他区域(图1A)。鉴于HGDN和eHCC病变在H&E图像上缺乏明显差异,我们采用了三种方法来捕捉细微的组织病理学特征:1)从监督学习(TMC-net)中提取的潜在特征;2)从病理学基础模型中获得的潜在特征;3)传统病理学特征,指可量化的细胞特征。随后,基于最可能在临床实践中应用的H&E图像构建了单模态模型。另一方面,分析转录组以探索eHCC和HGDN之间的差异表达基因和功能变化。为了提高预测准确性,将最佳组织病理学特征与几个关键基因的表达水平相结合,构建了一个多模态模型。所有模型均通过内部和外部测试集进行了评估。由于eHCC和HGDN病变极其隐匿,即使在患者量大的医院,手术病例数量也很少。我们筛选了复旦大学附属中山医院和华山医院记录为HCC或DN的患者。他们的H&E图像由至少两名专攻肝病的资深病理学家重新审查,并在必要时进行了多种蛋白标志物的免疫组化分析(图1B;见方法)。任何包含确诊eHCC或HGDN的切片均被保留,并由病理学家勾画出eHCC或HGDN的病变区域。建模前,将WSI分割成大小为512µm的图块。按患者划分训练集、验证集和测试集,以避免信息泄漏。此过程从ZS获得了33,573个图块用于训练,从ZS获得了40,318个图块用于内部测试,并另外从HS获得了3,430个图块用于外部测试(图1C;补充表S1;见方法)。我们随后测量了显微切割的eHCC病变、HGDN病变和周围肝组织的转录组。其中,65个ZS来源的样本按8:2的比例分为训练集和内部测试集,另外21个HS来源的样本用作外部测试集(图1C;见方法)。50个具有H&E图像的样本构成了双模态队列(图1C)。

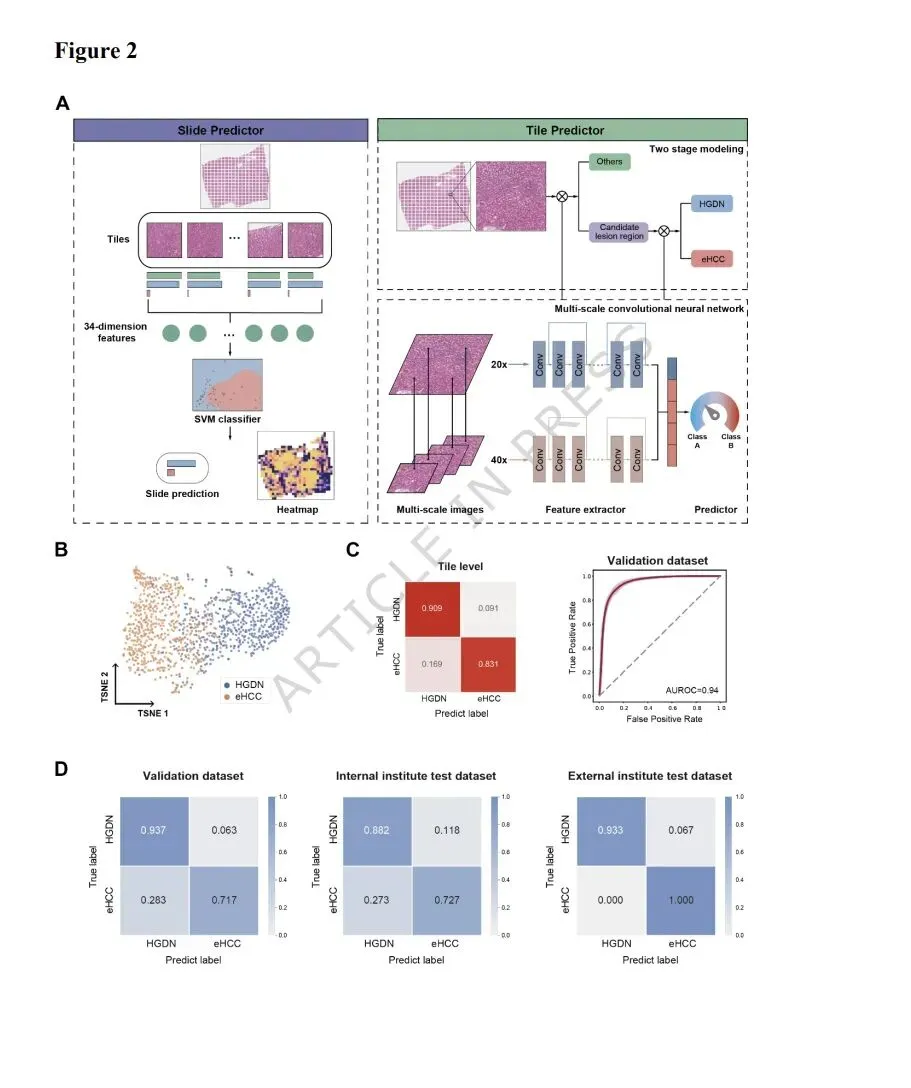

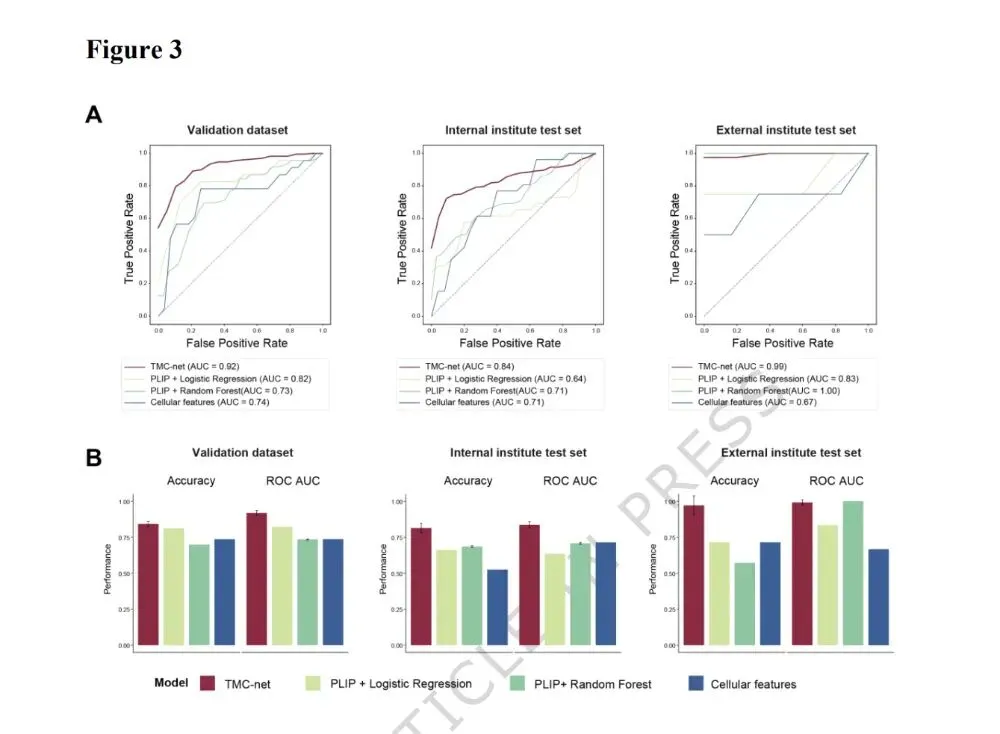

在临床实践中,需要为每位患者或每张切片做出诊断。然而,eHCC和HGDN病变通常只占WSI的一小部分,其余大部分区域由肝硬化等异常肝组织组成。因此,我们首先提出了一个两阶段多尺度卷积网络来预测每个图块的类别标签,然后将图块级特征聚合为切片级特征,以实现对每张切片的分类(图2A)。TMC-net的设计灵感来自临床诊断工作流程,病理学家首先在低倍镜下检查整张切片以识别感兴趣区域,然后在高倍镜下仔细检查这些候选区域以做出最终诊断。TMC-net的第一阶段是一个候选区域提取网络。该网络以图块级H&E图像图块作为输入,并将其分为两类:具有高恶性风险的图块和其他非关键区域的图块。被预测为候选区域的图块随后被传递到第二阶段,即eHCC检测网络。该网络执行更细粒度的分类,区分eHCC和HGDN(见方法)。为了评估TMC-net模型的图块级准确性,我们在标注的图块上进行了留一法交叉验证评估(图1C)。TMC-net最后一层的图块嵌入可视化显示,在潜在空间中HGDN和eHCC类别之间存在清晰的分离(图2B)。这表明多尺度特征提取有效地学习了区分eHCC和HGDN的不同特征。使用LOOCV的评估显示,TMC-net达到了87.1%的图块级分类准确率,AUROC为0.941(图2C)。接下来,我们探索了在不同视野大小下整合多尺度特征对模型准确率和AUROC的影响。结果表明,最佳配置是利用512µm大小的视野在20x和40x倍率下提取互补特征作为模型输入,这实现了eHCC和HGDN的最佳区分(补充图S1A)。在确定了最佳图块大小配置后,我们使用不同的网络设置进行了消融研究,以了解TMC-net的两阶段设计和多尺度架构的重要性(见方法)。结果表明,从TMC-net中移除任何一个模块都会导致准确率和AUROC下降(补充图S1B)。这表明“两阶段框架”和“多尺度CNN”元素都对模型的卓越性能做出了关键贡献。随后,我们计算了整个切片的34个聚合特征。这些特征源自图块级预测的分布模式、集中趋势和变异性特征(补充图S2和补充表S2;见方法)。然后将这些特征用作支持向量机的输入,以实现全切片级别的预测。LOOCV评估在切片级别达到了84.2%的分类准确率,AUROC为0.918(图2D和图3A)。这种集成方法有效地将图块级深度学习输出与完整组织样本的高阶统计特性相结合,从而增强了分类模型的鲁棒性和判别能力。除了新颖的TMC-net方法外,我们还评估了两种替代的病理学特征提取方法:基于病理学基础模型PLIP的方法,以及基于可量化细胞特征的方法,包括定量细胞密度比和细胞异型性指数(图1A)。使用相同的建模框架从这些特征中获得切片级预测(见方法)。结果证实,TMC-net在所有三个数据集上均优于其他两种方法(图3A和3B)。TMC-net在验证集上达到了0.8415±0.0182的准确率和0.9178±0.0175的AUROC(图3B,左侧)。在内部测试集上,准确率为0.8136±0.0338,AUROC为0.8354±0.0214(图3B,中间),表明TMC-net在扩展到新的相关数据时表现出一致的性能。重要的是,TMC-net在独立的外部测试集上实现了0.9714±0.0286的出色准确率和0.9916±0.0084的AUROC(图3B,右侧),表明其即使在不同的机构和成像协议下也具有泛化能力,并有希望在更多外部队列中进行验证和优化。总之,TMC-net作为一种两阶段多尺度卷积网络,展示了提取优越局部图像特征的能力。利用TMC-net架构,我们开发了一个基于H&E图像的eHCC全切片级诊断框架。该框架结合了基于深度学习的图块级特征提取和切片级统计建模,并在外部数据集中保持了一致的性能。这种一致的性能强调了TMC-net的潜在泛化能力和临床适用性。

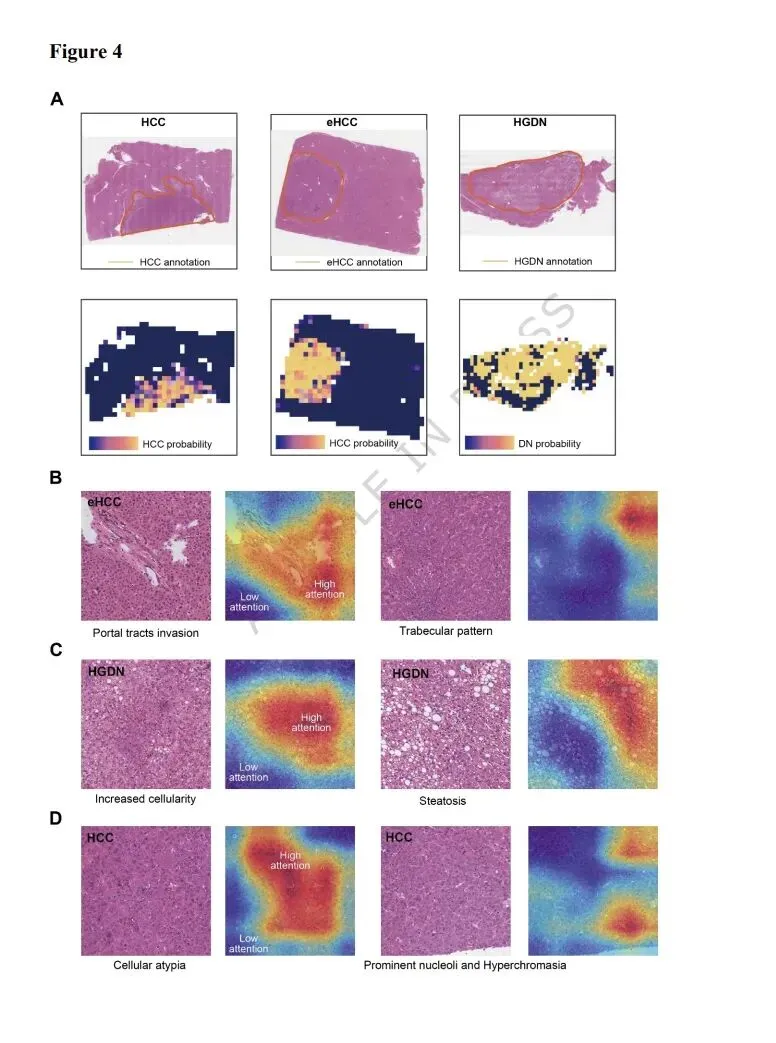

全切片诊断框架不仅提供H&E切片上的预测,还能支持人类病理学家。通过突出显示HCC高概率区域(图4A),TMC-net可以帮助病理学家关注潜在的恶性区域,并减少诊断所需的时间。我们邀请了不同经验水平的病理学家评估验证数据集,包括两名经验不足5年的初级病理学家、一名中级病理学家和一名经验超过15年的高级病理学家。每位病理学家在没有任何其他辅助的情况下独立诊断WSI。TMC-net预测的图块HCC概率随后被可视化为风险热图,突出显示了更可能代表恶性病变的区域。几个月后,初级病理学家在TMC-net生成的风险热图的帮助下重新评估了WSI。诊断结果显示,在风险热图的帮助下,初级病理学家之间的评估者间一致性kappa分数提高了9%。他们的诊断准确率从无辅助时的0.60提高到热图辅助时的0.77,F1分数从0.61提高到0.80(补充图S3)。为了进一步阐明TMC-net的可解释性,我们与经验丰富的病理学家合作,分析了模型在图块上突出的关键组织病理学特征(见方法)。这种可解释性分析显示,通过Grad-CAM解析的TMC-net高关注区域通常与病理学家认可的、临床实践中广泛使用的诊断标准一致。例如,尽管eHCC的恶性表现不太明显,但模型准确地关注了显示门静脉侵犯的区域,这是临床HCC诊断的关键标准(图4B)。对于HGDN,TMC-net将注意力引向细胞增多和脂肪变性的区域(图4C),前者是重要特征,后者指示HGDN高风险。此外,我们还将分析扩展到几张WD-HCC切片,TMC-net在这些切片上突显了显示明显细胞异型性、显著核仁和深染的区域,这些都是恶性转化的标志(图4D)。总之,TMC-net预测所突出的关键组织病理学特征反映了经验丰富的病理学家所认可的诊断标准。这种人工智能辅助方法代表了一种有价值的决策支持系统,可在临床环境中提高HCC的早期检出率。

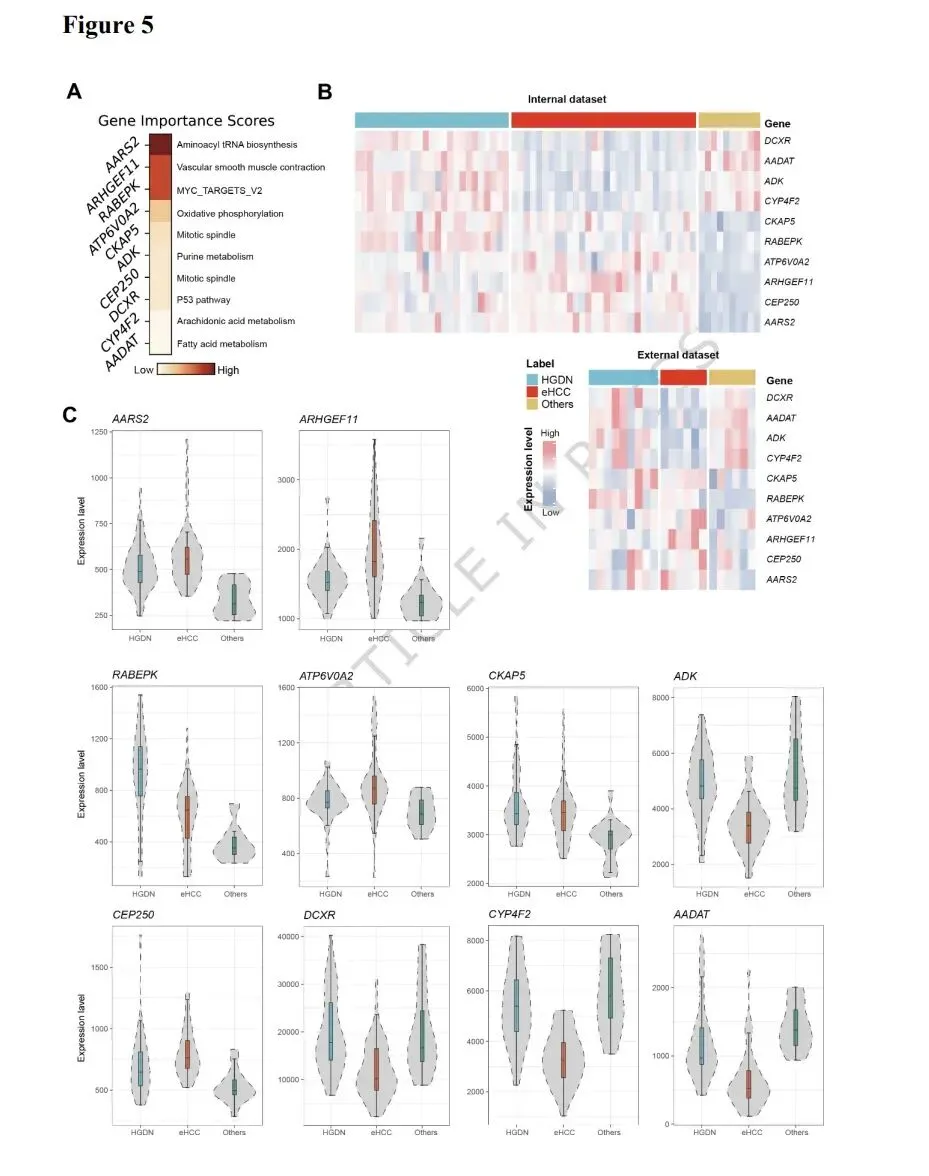

接下来,我们试图进一步阐明区分eHCC和HGDN的分子基础,并识别潜在的生物标志物。我们测量了来自eHCC、HGDN和周围肝脏对照组织的显微切割组织的转录组。通过比较HGDN和eHCC样本之间的DEG,我们观察到了与从癌前状态向早期恶性状态进展一致的不同分子特征。在HGDN中,上调的基因显著富集在与外源物代谢、氨基酸和有机酸加工、氧化磷酸化和脂肪生成相关的代谢通路中(补充图S4A和S4B)。相比之下,eHCC样本表现出与上皮-间充质转化、细胞粘附、有丝分裂和细胞周期调控相关基因的显著上调(补充图S4C和S4D)。这些转录特征与eHCC更具侵袭性、增殖性的表型特征一致。接下来,采用特征重要性分析算法来筛选能够在不同病变之间实现良好分类的潜在生物标志物基因。排名前10的基因是AARS2、ARHGEF11、RABEPK、ATP6V0A2、CKAP5、ADK、CEP250、DCXR、CYP4F2和AADAT(图5A)。值得注意的是,这些关键基因不仅在内部队列中表现出显著的表达差异,在独立的外部数据集中也是如此(图5B;补充表S3)。其中,ARHGEF11、RABEPK、ATP6V0A2、ADK、CEP250、DCXR、CYP4F2和AADAT在HGDN和eHCC样本中显示出显著不同的表达模式(图5C),这与先前观察到的与血管平滑肌收缩和各种代谢过程相关的通路富集一致(补充图S4A、S4B、S4C和S4D)。

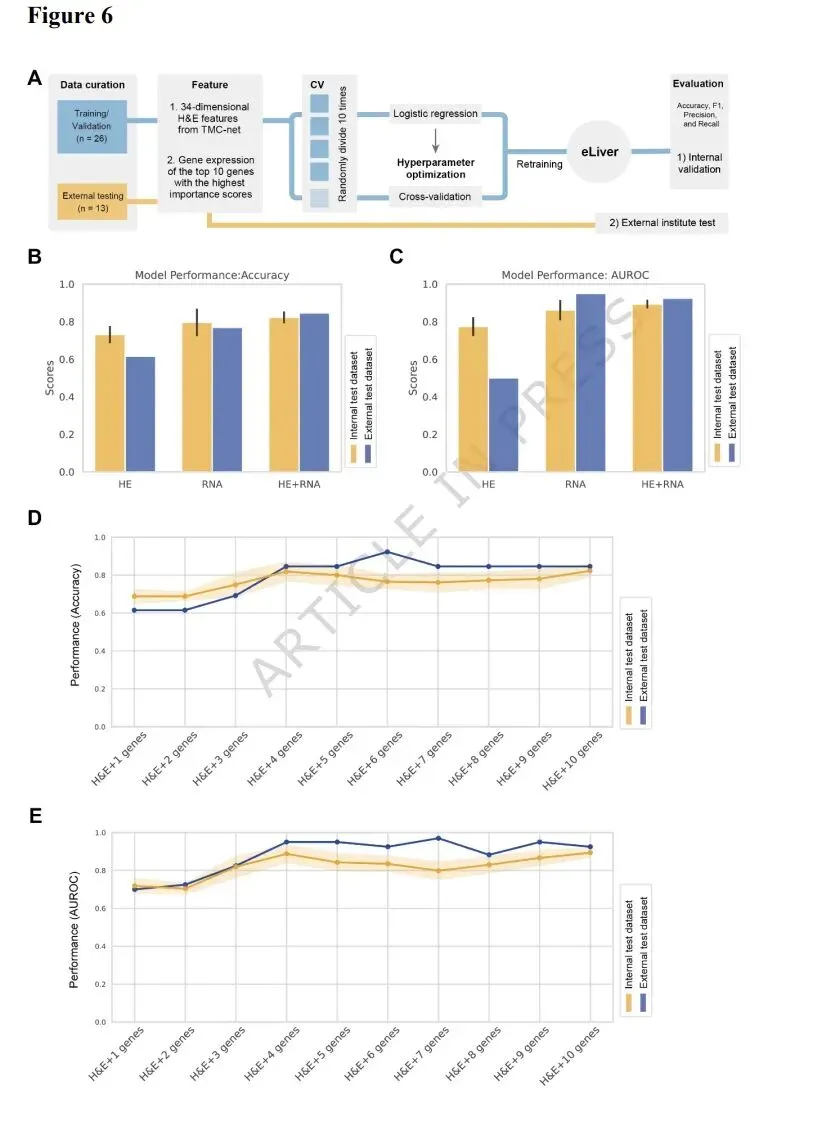

为了探索组织病理学和RNA表达的结合是否能更全面地表征eHCC特征并提高诊断性能,我们首先整合了34个基于TMC-net的组织病理学特征和10个关键基因的表达,构建了一个多模态模型。考虑到输入特征是通过单变量分析识别的潜在生物标志物,具有明确的生物学意义。此外,由于样本的珍贵性,双模态队列的规模有限。因此,我们选择了一个相对简单的逻辑回归模型作为分类器,以降低过拟合风险并促进结果的可解释性。内部队列被随机分为80%的训练集和20%的内部测试集,此过程重复10次以评估模型的稳健性(图6A;见方法)。结果显示,多模态eLiver模型在区分eHCC和HGDN方面优于任何单一模态方法,准确率达到0.8231±0.0308(图6B)。相比之下,仅使用RNA特征的准确率为0.7962±0.0731,仅使用H&E特征的准确率为0.7308±0.0455(图6B)。多模态模型显示出比单模态模型更好的泛化能力和抗噪性。eLiver在外部测试集上的性能没有下降,准确率达到0.8462(图6B)。此外,eLiver模型的AUROC在内部测试集上为0.8938±0.0230,在外部测试集上为0.9250,两者均高于单模态模型的分类性能(图6C)。为了探索准确诊断所需的最少分子特征数量,我们在相同的建模框架内执行了特征选择过程(图6A;见方法)。我们按照基因重要性评分的顺序,将RNA表达水平添加到TMC-net衍生的H&E特征中,并构建了具有不同数量特征的多模态模型。结果表明,随着基因数量的增加,模型在内部和外部测试集上的准确率和AUROC均有所提高,表明分子数据可以有效补充基于H&E的病变诊断(图6D和6E)。值得注意的是,通过添加H&E特征和前4个关键基因,AUROC在内部测试集上从0.7308±0.0455增加到0.8875±0.0459,在外部测试集上从0.6154增加到0.9500(图6E)。然而,随着基因数量的进一步增加,模型在测试集上的准确率和AUROC并未显示出明显改善(图6E)。然后,我们探索了四种常见生物标志物蛋白的表达。结果表明,与我们潜在的生物标志物相比,相应的基因分类性能有限,特别是在外部测试集上(补充图S5A和S5B)。与基于IHC标志物的诊断结果相比,我们的多模态方法可作为增强早期肝癌检测的补充或替代工具(补充图S5C)。这表明,结合H&E图像和前4个关键基因的RNA表达,可能代表了在诊断性能和实际临床可行性之间的最佳权衡,特别是在不易获得专业病理学专业知识的情况下。

为了进一步研究这四个关键基因与组织病理学特征之间的潜在关联,我们将TCGA-LIHC队列中的基因表达数据与组织病理学特征进行了关联分析。基于在H&E图像上分割的恶性上皮细胞、淋巴细胞和成纤维细胞的细胞核,我们计算了一系列组织病理学特征,包括核形态异质性、核空间分布结构等。有趣的是,发现AARS2和ARHGEF11的表达水平与恶性细胞的细胞异型性呈显著正相关(补充图S6A;Pearson相关p<0.001,AARS2的r=0.29,ARHGEF11的r=0.24)。AARS2参与蛋白质合成、能量代谢和细胞呼吸,而ARHGEF11参与细胞信号传导、迁移和粘附——这些过程在癌变过程中经常失调。此外,我们通过亲和传播聚类对成纤维细胞的空间分布进行了聚类。发现簇的扩张与RABEPK的表达水平相关,RABEPK是一个与膜运输和细胞信号传导相关的基因(补充图S6A;Pearson相关r=0.16,p<0.001),表明其在肿瘤微环境重塑中可能发挥作用。ATP6V0A2调节细胞内pH稳态和细胞信号传导,发现其表达水平与由恶性细胞构建的Delaunay图的多边形面积相关(补充图S6A;Pearson相关r=0.29,p<0.001),表明它可能参与肿瘤细胞的空间组织。这些发现为关键分子特征与肿瘤组织病理学特征之间的潜在机制联系提供了见解。

除了多模态模型的诊断性能外,我们还试图探索H&E与基因表达相结合的多模态特征的临床相关性。具体来说,我们检查了TCGA-LIHC队列中多模态特征与OS之间的关联(见方法)。我们发现,由4个基因表达水平组合定义的风险评分能够区分患者之间的生存差异(p=0.017;补充图S6B)。此外,基于TMC-net模型计算的高风险区域比例使生存差异更加明显(p=0.0066;补充图S6C)。当我们将这4个基因的表达与基于H&E的高风险区域比例相结合时,也获得了显著相关的生存差异(p=0.014;补充图S6D)。这些结果表明,前4个生物标志物捕获的分子特征以及从H&E图像衍生的风险区域具有很强的预后相关性,突显了它们有潜力作为HCC临床管理中的潜在生物标志物。

更多结果和补充图表:

PMID:41927783

DOI:10.1038/s41698-026-01393-2

不想做实验,没数据,还想要快速发表文章,没问题的!公共数据库就是我们的数据宝藏!没思路不用担心,作为专业的生信团队,我们很乐意为您效劳,提供研究路线设计和数据挖掘分析,扫码联系我们吧!

长按二维码关注我们,用最短的时间和最高的效率学习更多数据分析方法!

扫描上方二维码或登录平台官网后添加CNSknowall客服微信咨询!官网地址:https://cnsknowall.com

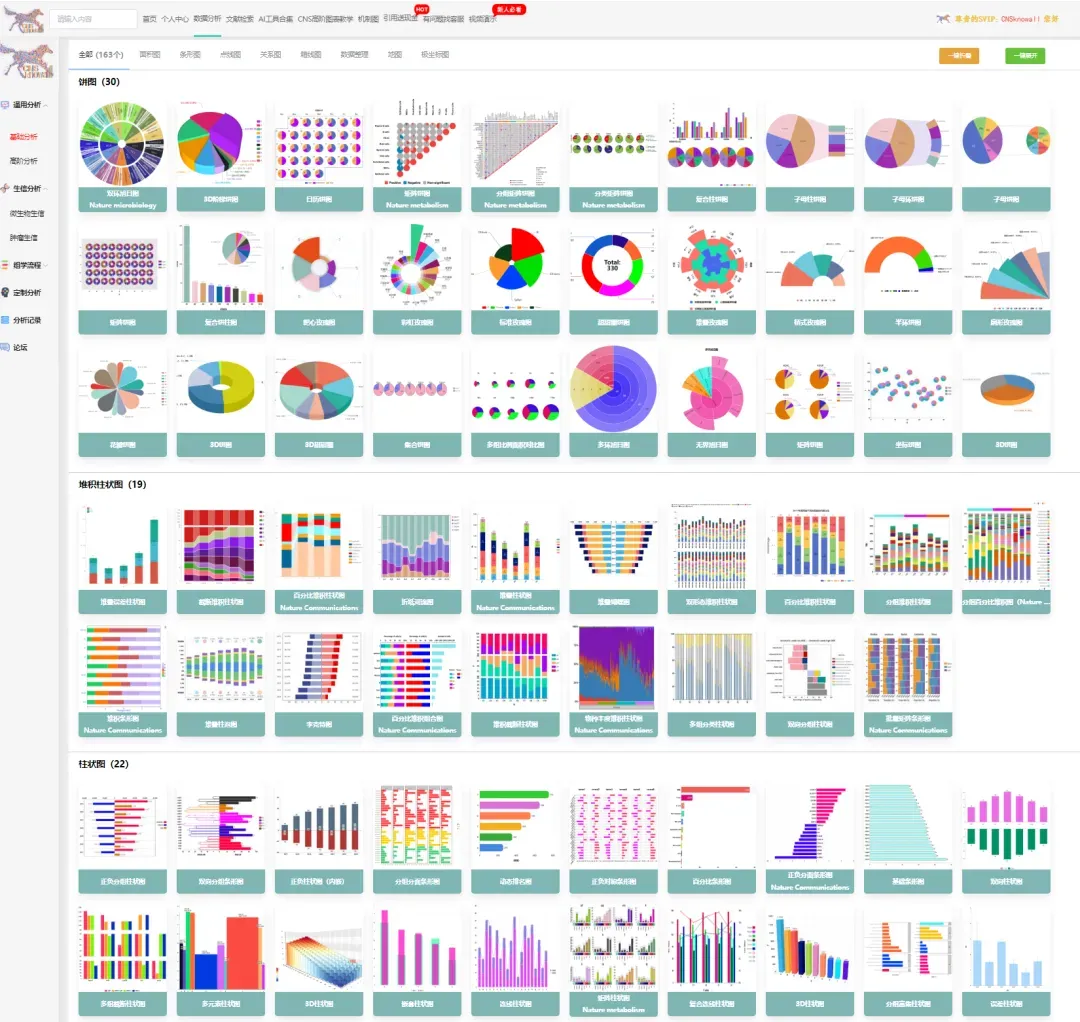

CNSknowall:24年最新问世的遥遥领先的科研数据(0代码生信+统计学)分析平台,同时含有机制图模块+汉化版Pubmed融合Deepseek高效筛选目标文献+SCI文献例句/语料检索模块+OPenAI官方GPT接口,>500款CNS级别图表皆可一秒内一键出图,登录即秒变数据分析大神,体验前所未有的便捷数据分析之旅,开启科研天骄之路!

可向下滑动批阅!

夜雨聆风

夜雨聆风