AI 正在重写“记忆成本”:下一轮竞争,拼的不只是聪明

评价一个 AI 模型,最常问的是:它聪不聪明?推理强不强?跑分高不高?但接下来,一个更现实的问题会变得越来越重要:

它能不能长期记住重要信息,并且以足够低的成本调用出来?

正因如此,“记忆成本”正在成为 AI 进入下一阶段竞争时,一个越来越关键的变量。

这里说的“记忆”,不是浪漫意义上的“AI 记住你是谁”,也不只是模型能塞进多少字,而是指 AI 在真实工作中,保存、压缩、检索、理解和复用上下文所需要付出的综合成本,包括算力、存储、检索、推理和系统设计成本。

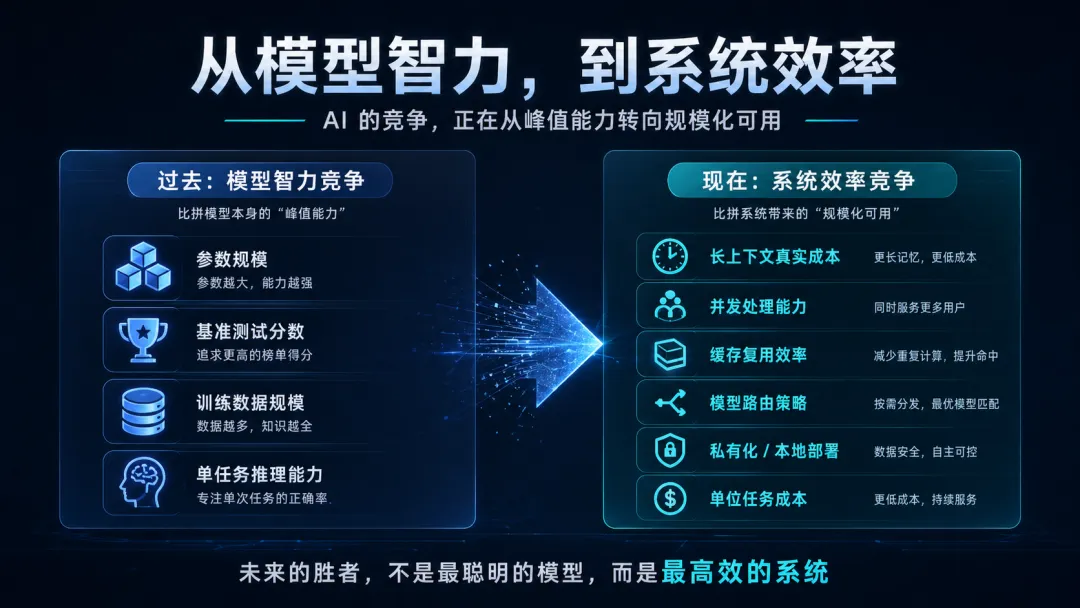

过去两年,大模型的进步主要体现在三个方向:更强的推理、更长的上下文、更丰富的多模态能力。表面上看,这是能力边界不断外扩,但从产业角度看,真正决定 AI 能不能进入千行百业的,往往不是“峰值能力”,而是“单位能力的成本”。

说得更直白一点:

一个模型“会不会做”,已经不是唯一问题,它能不能稳定地做、便宜地做、规模化地做,才是 AI 走向真实应用的关键。

而“记忆成本”,正在成为这场竞争里最关键的一笔账。

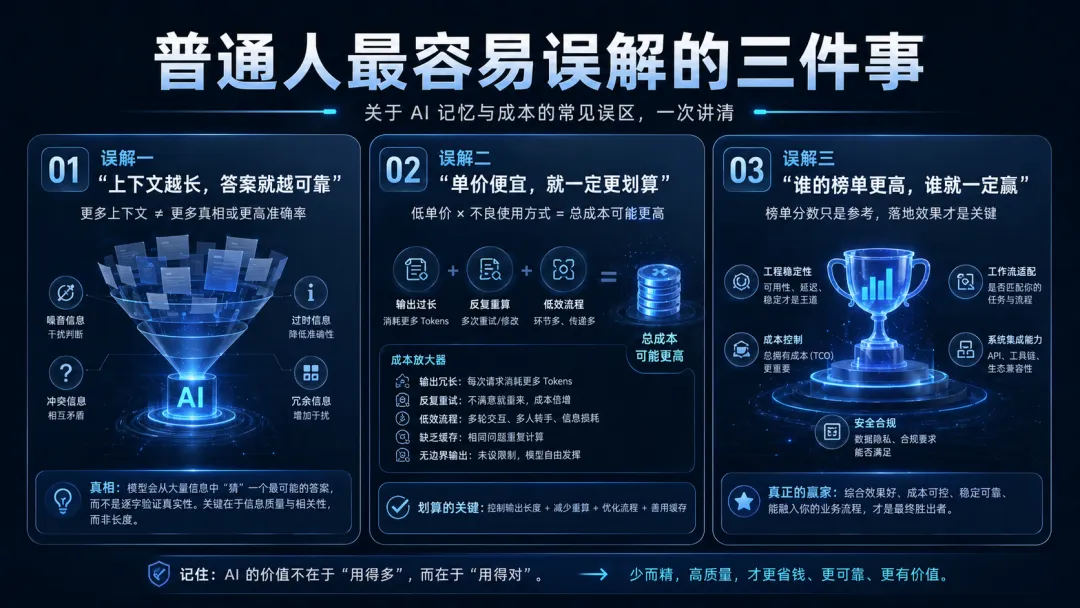

很多普通用户对大模型的理解,还停留在“上下文窗口越长越好”,这当然没错,但只说对了一半。

长上下文确实重要,无论是写代码、读合同、分析研报、处理会议纪要,还是驱动 Agent 连续执行任务,模型都越来越需要处理大量连续信息。

但问题在于:长,不等于可用。

如果一个模型理论上能看 100 万 token,但每处理一次都要消耗巨量显存、带宽和推理资源,那么这种能力更像实验室里的样品,而不是可以普及的基础设施。

举个简单的例子:

一个 AI 编程助手,如果每次只能看当前文件,它只是一个代码补全工具;如果它能长期理解整个项目结构、历史修改、技术债和团队规范,它才可能真正变成开发协作者。

但这背后不是“记住更多”这么简单。

它需要知道哪些信息要完整保留,哪些内容可以压缩,哪些历史只需要索引,哪些上下文需要在关键时刻重新召回,否则,模型看似“记得很多”,实际每次调用都在重复烧钱。

所以,真正重要的变化不是模型“记得更长”,而是它开始学会像人一样,把不同层次的信息分开处理:

-

刚刚发生的内容,保留精细细节;

-

稍早的信息,做压缩和筛选;

-

更久之前的内容,只保留结构化印象和关键索引;

-

真正需要时,再对重点部分做高精度召回。

这意味着,大模型的“记忆”开始从一堆原样堆积的数据,演化成一套更接近真实认知系统的结构。

所以,下一阶段 AI 的关键,不是单纯扩展记忆容量,而是提升记忆的管理效率。

不是把所有东西都塞进去,而是知道什么该记、怎么记、什么时候调出来。

如果说前一阶段的大模型竞争,主要拼的是:

-

参数规模

-

训练数据量

-

跑分成绩

-

单次任务的推理能力

那么从现在开始,另一个维度会越来越重要:

-

长上下文的真实成本

-

多请求并发能力

-

重复前缀的缓存复用

-

不同模型之间的分层调度

-

本地部署和私有化部署的可行性

这背后,其实是产业评价标准变了。

在 Demo 时代,大家容忍高成本,因为重点是证明“AI 能做到什么”,但当 AI 开始进入企业服务、软件开发、内容生产、教育、金融、制造、政务等长期场景后,衡量标准就会变得更现实。

这时,真正有价值的问题不再是:

这个模型最强时有多强?

而变成:

这套智能系统,能不能每天稳定跑一万次、十万次,而且不把账单烧穿?

对企业来说,真正昂贵的不是让 AI 回答一次问题,而是让它每天在权限可控、知识可追溯、成本可预测的前提下,持续服务几十个、几百个甚至更多员工。

因此,AI 的竞争正在从“单点智力竞赛”,转向“系统工程竞赛”。

这也是为什么最近很多技术更新,表面上看是在优化架构细节,实际上却在重新定义整个行业的成本曲线。

因为未来的 AI,不会只做一次性回答,而会越来越多地承担持续性任务。

比如:

-

一个程序员,不再只是问模型一段代码怎么写,而是让它连续理解整个仓库、修 bug、补测试、跟踪历史提交;

-

一个内容团队,不再只是让模型润色一句话,而是让它跟进选题、整理资料、改写多平台版本、复盘数据反馈;

-

一个企业,不再只是拿 AI 当聊天机器人,而是让它接入文档、流程、权限和系统,长期协助运营和决策;

-

一个普通上班族,也不再满足于“问一次答一次”,而是希望 AI 能记住项目上下文、工作风格、任务状态和长期目标。

一旦 AI 从“回答问题”升级到“持续工作”,记忆就不再是附属功能,而会变成主干能力。

没有便宜、稳定、可管理的记忆系统,所谓 Agent、Copilot、企业智能助理,很容易沦为昂贵的演示品。

所以,“记忆成本”这件事,本质上决定的是:AI 能不能从一个聪明的工具,变成一个真正可用的系统。

未来,越来越多主流模型都会把长上下文作为基础能力,而不是稀缺卖点。

但真正成熟的产品,不会把所有信息粗暴塞给模型。行业会越来越清楚地认识到,原文窗口、摘要层、检索层、缓存层必须协同工作。

换句话说,未来比拼的不是谁“能装更多”,而是谁“会装、会筛、会复用”。

未来一个完整的 AI 产品里,往往不会只有一个模型。

更可能的结构是:

-

低成本模型负责扫信息、做预处理、跑常规工作流;

-

高性能模型负责关键判断、复杂推理、难题求解;

-

必要时再辅以本地小模型或私有模型,承担数据敏感场景。

这会像云计算里的分层架构一样自然,不是所有任务,都值得调用最贵的“脑子”。

只要长上下文能力的成本持续下降,本地部署就会越来越有现实意义。

过去很多企业并不是不想本地化,而是“能跑”和“跑得动”之间差着一条鸿沟。现在这条鸿沟正在缩小。

尤其是在数据敏感、流程复杂、知识沉淀较深的企业场景里,本地部署和私有化部署会重新升温。

这会推动一类新的产品机会:

-

面向企业内网的私有智能系统

-

面向专业场景的本地 Agent

-

面向创作者和开发者的个人 AI 工作台

当模型能更低成本地在本地或专属环境里运行,AI 的价值就不只是“更方便”,还包括“更可控”“更安全”“更长期”。

很多人关心 AI 会不会替代自己。

但更现实的变化,往往不是直接替代某个职业,而是先重构这个职业的工作链条。

例如:

-

开发者会把更多时间放在架构判断、代码审查和复杂决策,而不是重复性编码;

-

内容工作者会把更多时间花在选题、观点和风格,而不是机械整理资料;

-

管理者会更依赖 AI 做信息汇总、状态跟踪和多线程推进;

-

专业人士会逐步拥有“可持续协作的第二大脑”,而不是一次性问答工具。

这种变化比“替代论”更慢,但更深。

上下文变长,解决的是“看得更多”的问题,不自动解决“理解得更准”或“说得更真”的问题。

一个模型即使能读完整本书,也可能在关键处胡说八道。

所以未来的核心能力,不只是长记忆,还包括:

-

真实性控制

-

幻觉抑制

-

关键事实校验

-

不确定性表达

很多模型虽然单次调用价格下降了,但如果输出特别长、反复重算同样内容、工作流设计粗糙,总成本依旧可能很高。

未来真正重要的不是“某个模型便不便宜”,而是整个系统的单位任务成本。

真正决定胜负的,往往是:

-

工程稳定性

-

成本控制能力

-

对真实工作流的适配度

-

与软件、硬件、业务流程的整合能力

从这个角度看,未来 AI 的竞争越来越像一次完整的产业升级,而不只是一次模型比赛。

对刚开始接触 AI 的人来说,这意味着 AI 会从“问答工具”变成“长期工作伙伴”。你不一定要懂底层架构,但要开始建立“让 AI 参与长期任务”的使用习惯。

对开发者来说,重点会从“调用哪个模型”转向“设计怎样的低成本智能工作流”。未来最稀缺的能力之一,不是会不会调接口,而是会不会搭建高复用、低成本、可持续的智能系统。

对内容创作者来说,AI 不再只是润色器,而会逐渐参与资料管理、选题延展、内容复用和风格沉淀。你的护城河会越来越集中在判断力、原创视角和长期品牌感。

对企业管理者来说,真正要关注的不是某个模型一时有多火,而是它能不能接入知识、流程、权限和业务节奏,并且在可控成本下持续稳定运行。

对普通职业人来说,最重要的变化不是一夜之间被替代,而是会不会把 AI 纳入自己的长期工作流。那些能把 AI 当作长期协作者的人,效率差距会越来越大。

过去很多人用 AI,是把它当作一个升级版搜索框。

未来越来越多的人会意识到,AI 的真正价值不只是给答案,而是:

-

帮你组织信息

-

帮你保持任务连续性

-

帮你管理复杂上下文

-

帮你把碎片知识变成可执行行动

而这背后的前提,正是“记忆成本”被持续压低。

对普通人来说,这件事听起来有点技术,但其实很现实。

未来你用 AI 写方案、做报告、整理资料、规划项目时,真正好用的 AI,不是每次都从零开始回答你,而是能理解你之前做过什么、现在卡在哪里、下一步该怎么推进。

这就是“记忆成本”下降之后,普通人最先能感受到的变化。

所以,AI 的下一阶段,不只是模型变聪明,更重要的是,它开始变得便宜、稳定、可复用、可接入。

这听起来没有“超级智能”那么性感,却可能是 AI 真正进入日常工作和真实产业的关键一步。

因为只有当 AI 记得起、用得起、跑得动、接得住,它才不再只是一个聪明的聊天窗口。

它才会变成一种新的工作基础设施。

夜雨聆风

夜雨聆风