OpenClaw 引爆 Agent 元年?企业规模化应用的真实路径

2026 年初,一个叫 OpenClaw 的开源项目风靡全球。GitHub Star 从零涨到 4 万只用了几周,非技术人员也跟着”养虾”,各社区攻略层出不穷——”499 安装 OpenClaw 之后再花 299 卸载”这种段子都出来了。

Karpathy 说了一句很准确的话:OpenClaw moment 的意义不在于它本身有多强,而在于这是第一次,大量不懂技术的人真正体验到了 agentic models。以前他们只知道 AI 就是 ChatGPT 那个网页。

但狂欢过后,一个更实际的问题摆在了面前:如果你的公司不是个人玩票,而是真想把 Agent 跑在生产环境里,OpenClaw 够不够?

不够。不是因为 OpenClaw 不行,是因为企业级 Agent 的瓶颈从来不在模型能力。

你以为是模型不够聪明,其实是脚手架太薄

最近阿里云一篇 Agent 工程实践文章里有个判断很有意思:更贵的模型带来的提升,很多时候没有想象中那么大。反而 Harness(脚手架/驾驭层)和验证测试质量对成功率的影响更大。

调试 Agent 行为时,应该优先检查工具定义——因为多数工具选择错误,都出在描述不准确。

这句话放在企业场景里,分量很重。

什么意思呢?假设你用一个顶级模型,给了它 20 个工具。它选错了工具。你的第一反应是”换个更强的模型”。但实际上,问题大概率出在工具的描述写得模糊,模型根本分不清该用哪个。

这不是假设。Harrison Chase(LangChain 创始人)最近在 X 上吐槽过一件事:OpenClaw 的 subagent 经常超时、完不成任务。他的解决办法不是换模型,而是用 BullMQ 做了一套基于 Postgres 的队列/任务系统,给 OpenClaw 装上了翅膀。Minions 快了 10 倍,也更可靠了。

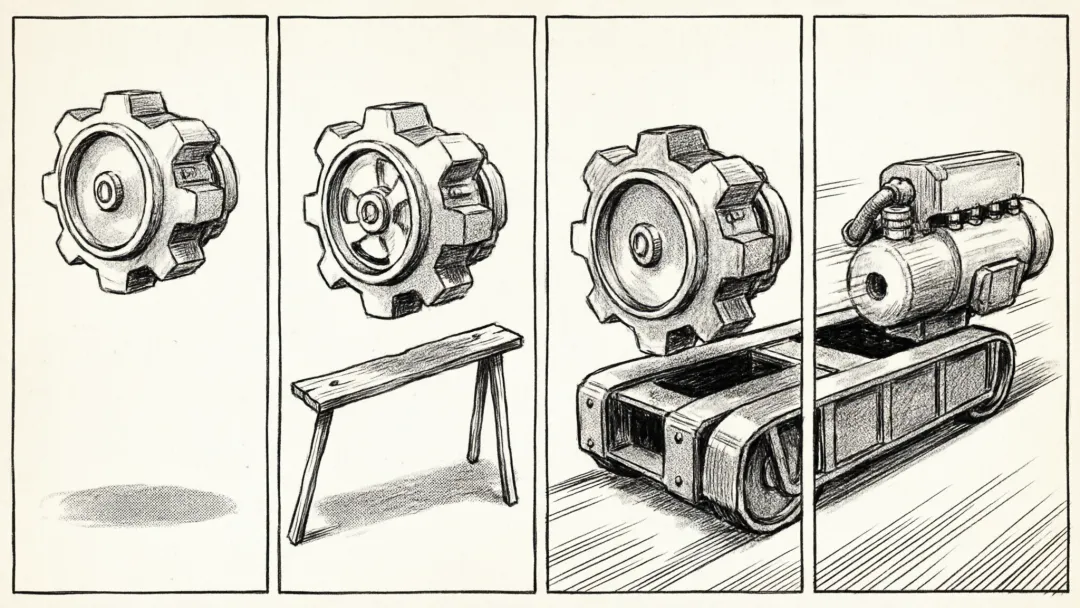

模型是引擎。Harness 是底盘。没有好底盘,再强的引擎也只是在原地空转。

靠人喂 vs 自己长

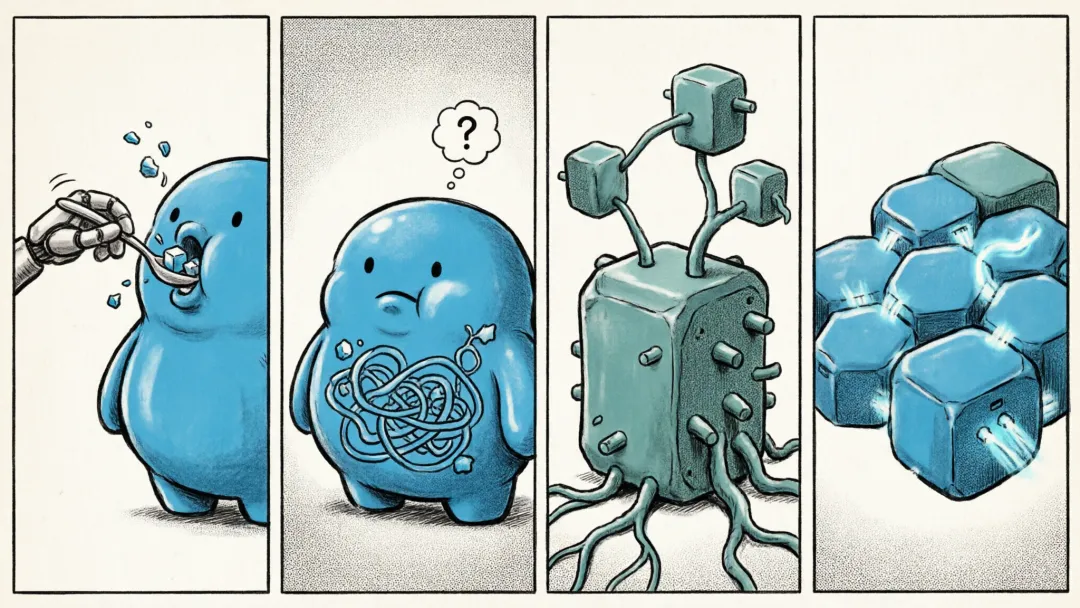

OpenClaw 的 Skill 是手写的 Markdown 文件。你写多少它会多少,你不写它就不会。

这意味着什么?意味着 Agent 的能力增长,完全取决于维护者的时间和意愿。

Google Cloud 高级 AI 产品经理 Shubham Saboo 做过一个对照实验:他用 OpenClaw 跑了 6 个 Agent,研究、写内容、审代码、发通讯,全部按计划自动运行。但越跑越发现一件事——他维护这套系统花的时间,比系统自己进化的时间更多。

他不停地更新 SOUL.md,修配置,调提示词。每天早上打开 Telegram 看结果的时候,第一反应不是”太棒了”,而是”昨天又有三个任务失败了,得去查日志”。

然后他在同一台机器上加了最近爆火的 Hermes Agent,做了一个对照实验。结果完全不一样:Agent 开始自己写技能文件,自己总结故障手册,完成的工作开始留下可复用的痕迹。

这不是功能差异,是设计哲学的分野。一个靠人喂,一个自己长。

在企业环境里,这个区别是致命的。你的运维团队不可能有精力为每个 Agent 手写 Skill 文件。如果一个 Agent 干了三个月,犯过的错还在重复犯,那它就只是一个会耗 token 的自动化脚本。

上下文密度比上下文长度重要

最近有个叫 Generic Agent(GA)的项目,半个月涨了 5k Star,登上了 GitHub trending 第一。它解 Agent 问题的方式只有一条原则:上下文信息密度最大化。

不追求上下文有多长,只追求每一个 token 都在为当前决策服务。

对比 OpenClaw 和 Hermes 的实际使用,你会发现一个共同毛病:一句 “Hello” 发过去,系统提示词先吃掉几万 token。装了二十个 Skill,越装越慢,连最基本的事都开始卡。上周刚教会的操作,这周又忘了,每次都像第一次见面。

GA 的思路很直接:把那些”礼貌性”的、”说明性”的提示词砍掉。留下的都是决策必须的。同样一个任务,GA 用两千个 token 就能启动,别人要两万个。

对于个人用户来说,token 消耗可能只是钱的问题。对于企业来说,它直接关系到并发能力和成本模型。如果你有一个 Agent 团队 24 小时在跑,每个 Agent 每次启动浪费一万个 token,一个月下来就是天文数字。

开源 Agent 的军备竞赛

OpenClaw 不是唯一的故事了。

Hermes Agent 在 GitHub 上拿了 10 万星,OpenRouter 排行榜增速 204%。Generic Agent 用十分之一的 token 启动。Pi-mono(OpenClaw 的底层框架)也冲到了 4 万星。DeepSeek V4 Pro 针对 OpenClaw、Claude Code、OpenCode 做了专项适配和优化。

MiniMax 同时为 OpenClaw 和 Hermes 两边提供订阅服务。Karpathy 的 LLM Wiki 理念也被人开源了。

这个赛道的节奏已经不是”月更”,是”周更”,甚至”日更”。OpenClaw 三天两头重置用量,Anthropic 悄悄把 Claude Code 从 Pro 套餐里移出来,Google 的 Qwen 模型也跑上了 Ollama 的云端。

对于个人开发者来说,这是最好的时代。对于企业来说,这是最难做技术选型的时代。因为你选的任何方案,下个月可能就有一个新的出来,性能更好、成本更低、维护更少。

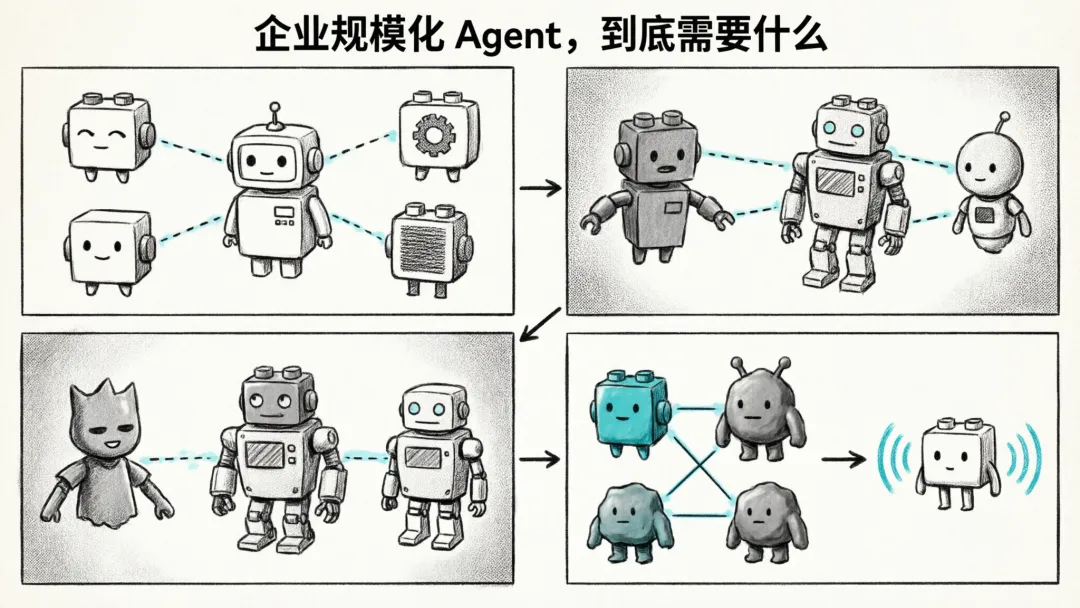

企业规模化 Agent,到底需要什么

回到那个问题:OpenClaw 引爆了 Agent 元年,然后呢?

对于想规模化部署 Agent 的企业,真正的路径不是选”哪个 Agent 最强”,而是回答三个问题:

第一,你的 Harness 够不够厚? Agent 的行为可预测性,取决于脚手架的设计质量。任务队列、失败重试、结果验证、超时处理——这些”无聊”的基础设施,比模型选哪个更重要。

第二,Agent 能不能自己变好? 不能自我进化的 Agent,只是一个会聊天的 cron job。你需要的是一个能沉淀经验、自动总结 Skill、从错误中学习的系统。

第三,上下文成本能不能压下来? 每个 token 都是钱。每个不必要的系统提示词都是浪费。上下文信息密度最大化,不是优化建议,是成本底线。

OpenClaw 做了一件伟大的事:它让更多人第一次体验到了 Agent。但体验和生产,之间隔着一条鸿沟。

跨过那条鸿沟,需要的不是更强的模型。需要的是更弱的依赖。

Karpathy 说 OpenClaw moment 最大的意义是让非技术用户也能体验到 agentic models。

这话说对了一半。另一半是:体验到了,然后呢?

真正的 Agent 元年不是体验元年,是规模化元年。当企业不再问”哪个 Agent 最强”,而是问”怎么让 Agent 稳定跑起来、越跑越好、成本越来越低”——那才是元年真正的开始。

今天你部署的 Agent,三个月后还在用同样的方式运行吗?如果是,那它可能不是 Agent,只是一个会耗 token 的定时任务。

夜雨聆风

夜雨聆风