个人 AI 开发配置(2605-5):买硬件还是租云,算清楚拐点再做决定

Mac mini M4 Pro 48GB 在中国官网约 13999 元。国内 AI 云平台上,RTX 4090 级别的 GPU 实例在专用 AI 计算平台(如 AutoDL)约 2-5 元/小时,在大型云厂商(阿里云、腾讯云)则约 8-15 元/小时;A100 级别约 20-35 元/小时。买本地硬件不一定比租云省钱,取决于你用得多密集,以及你需要做什么任务。这篇把拐点算清楚,然后再给推荐策略。

云算力的实际成本(2026年4月国内市场)

各平台价格有差异,以下是量级参考(实际以下单时为准):

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

有几个点需要注意:

算力不等于时间。租 GPU 是按实际使用小时计费,你的代码在跑就在计费,你去吃饭就停掉实例就不计费。本地硬件则是 7×24 小时都在折旧,即使你不用它。

「按需」的真实含义。租云的最大优势是弹性——你需要 4 块 H100 精调一个大模型,租一天,做完释放。本地买 4 块 H100 等于锁定几十万的资金在一台机器里,大多数人做不到。

本地硬件的真实成本

买一台设备,实际上每小时花了多少钱,算法是:把设备总价除以预期使用年限,再除以每年实际使用的小时数,加上电费。

以 Mac mini M4 Pro 48GB(约 14000 元)为例:

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

这个数字很有意思:如果你每天稳定使用 4 小时以上,本地硬件的每小时成本已经低于专用 AI 云平台的 RTX 4090 实例(2-5 元/小时),更是远低于大型云厂商的价格(8-15 元/小时)。

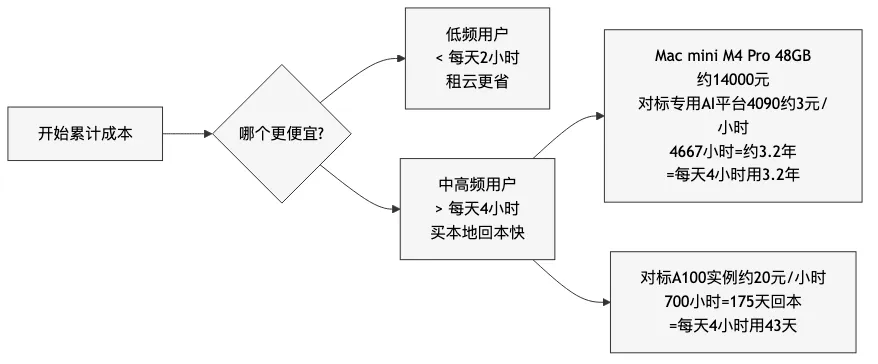

拐点:什么时候买本地硬件划算

具体速算(以 Mac mini M4 Pro 48GB 约 14000 元为例):

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

结论:如果你经常用大型云厂商的 A100 做开发,每天用 4 小时,半年内就回本了——之后每天用都是在省钱。如果你只是偶尔跑一下,每天不到 1-2 小时,或者主要用专用 AI 平台的低价 RTX 4090 实例,买本地硬件回本周期要长得多,租云更灵活。

云的真实优势:弹性和大卡

买了本地硬件,卡就那张,内存就那么多,不能临时扩容。云的弹性在这两个场景下是真实优势:

精调大模型(34B-70B+ QLoRA)

RTX 5070 只有 12GB,精调 34B 模型需要至少 48-80GB 的显存(取决于配置),本地做不到。临时租 4×A100 或 2×H100,一次精调任务可能 3-6 小时,花几百块,做完就释放。比买一堆 A100 锁在家里合理得多。

突发性大批量任务

处理一批几万个文档,需要 GPU 密集跑几天,本地也可以,但慢。租云临时扩 10×,几小时做完,成本可控。

本地的真实优势:隐私、延迟和稳定性

数据不出本地

把公司内部文档、代码、私人数据发给任何云服务,都有数据离境或泄露的风险。本地模型推理,数据完全在自己机器上。这对于处理敏感数据、合规要求高的工作至关重要。

无网络延迟

本地调用模型,网络延迟是 0。对于在 IDE 里集成 AI 代码补全、做实时语音对话这类场景,100ms 的网络延迟会明显影响体验。

随时可用,不限次数

租云实例,你要等启动时间(几秒到几十秒),还要管理实例的启停。本地模型常驻内存,打开 IDE 就有,随时调用,没有次数限制。

长期稳定成本

云的价格会变,平台会调价,服务可能下线。买了本地硬件,成本是固定的折旧,不受外部因素干扰。

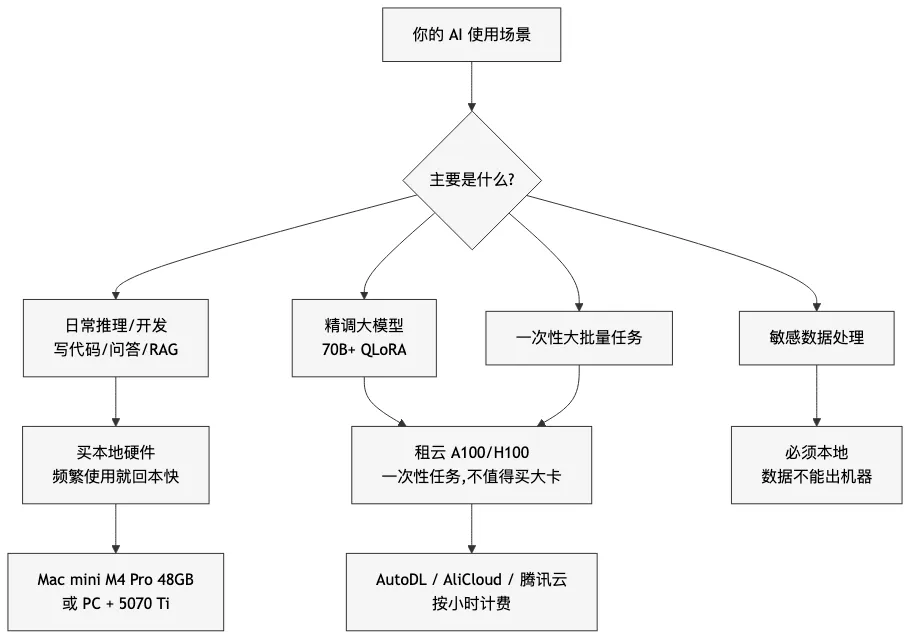

推荐策略:不是非此即彼

简单说:

- 推理(日常开发)→ 买本地

:只要每天用 3-4 小时以上,比租云省钱,还有隐私和延迟优势 - 精调大模型(34B+)→ 租云

:一次性任务,本地根本跑不起来,租比买合理 - 精调小模型(7B-14B QLoRA)→ 本地可以

:RTX 5070 12GB 足够,几个小时完成

最实用的组合:本地一台 Mac mini M4 Pro 48GB(日常推理 + 应用开发),需要精调大模型时按需租 A100/H100 实例。两者不是竞争关系,是互补的。

下一篇是最后一篇:三类用户的完整推荐方案,直接给结论。

价格数据基于 2026 年 4 月国内主流 GPU 云平台(AutoDL、阿里云、腾讯云)的公开定价,具体以下单时平台实时价格为准。Mac mini 价格参考中国官网,因汇率和促销活动有波动。

夜雨聆风

夜雨聆风