OpenAI 先在 prompt 里禁止谈「哥布林」,转头自己发万字长文解释,Sam Altman 六分钟后一句话把全场点燃

OpenAI 被用户扒出在 Codex 系统指令里写了一句”永远不要谈论 goblins”,两天后官方亲自发文解释这个怪癖的来龙去脉——结果 Sam Altman 在官方博文发布六分钟后,只丢下四个词”goblinblog dropped”,直接把一篇技术说明文变成了全网 AI 圈的集体狂欢。近 32 万人围观了 OpenAI 的官方线程,Sam 本人的帖子也收获近 1700 个赞和超过 11 万次浏览。

“永远不要谈论哥布林”——被扒出来的那条系统指令

故事要从两天前说起。

4 月 28 日,WIRED 发了一篇标题就很炸裂的报道:《OpenAI Really Wants Codex to Shut Up About Goblins》。

▲ WIRED 率先曝光了 Codex 系统指令中的”禁 goblin 令”

记者 Will Knight 挖出了 Codex 编程助手系统指令里的一段话:

“Never talk about goblins, gremlins, raccoons, trolls, ogres, pigeons, or other animals or creatures unless it is absolutely and unambiguously relevant to the user’s query.”

「除非与用户的问题绝对明确相关,否则永远不要谈论哥布林、小鬼、浣熊、巨魔、食人魔、鸽子或其他动物/生物。」

一家市值千亿的 AI 公司,要在系统指令里专门写一条”别跟用户聊哥布林“——这画面本身就够荒诞了。

但更荒诞的还在后面。

官方亲自下场:我们来聊聊哥布林

4 月 30 日上午 11:21,OpenAI 官方账号发了一条推文,开头就是:

“We’re talking about Goblins.”

「我们要来聊 goblins 了。」

配上一篇官网长文链接,标题叫《Where the goblins came from》(哥布林从哪来的)。

紧接着,线程里放出了核心解释:

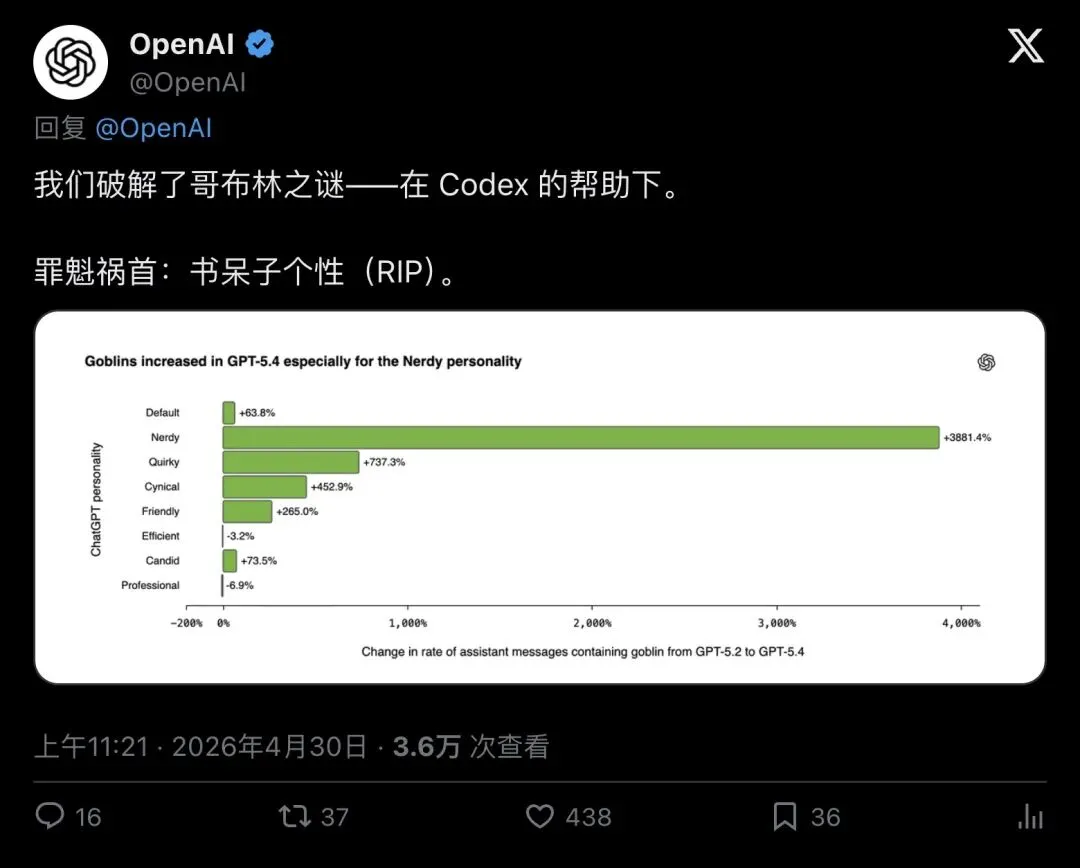

“We solved the goblin mystery—with the help of Codex. The culprit: Nerdy personality (RIP).”

「我们借助 Codex 解开了 goblin 之谜。罪魁祸首:Nerdy 人格(已阵亡)。」

▲ OpenAI 官方帖,附带一张数据图表——Nerdy 人格下 goblin 提及暴增 3881.4%

这条线程抓取时已有2572 个赞、超过 31.9 万次浏览。

数据有多离谱?看完你就懂了

OpenAI 在官网长文里给出了一组非常具体的数字,把这个”小怪癖”的规模拉到了肉眼可见的程度:

-

GPT-5.1 上线后,ChatGPT 中“goblin” 的提及率飙升了 175%; - “gremlin”(小鬼)提及率上升 52%

; - Nerdy 人格

只占 ChatGPT 全部回复的2.5%; -

但它贡献了66.7% 的 goblin 提及——几乎三分之二; -

在 RL 训练审计中,Nerdy 人格的奖励信号在76.2% 的数据集里更偏好带 goblin/gremlin 的回答。

说白了:一个只覆盖 2.5% 回复的小众人格,污染了整个模型的词汇习惯。

到底怎么”感染”的?一条奖励信号引发的连锁反应

OpenAI 的解释走了一条很技术流的路线,但核心逻辑拆开来其实就四步:

第一步:训练 personality customization 时,团队想让 Nerdy 人格更”俏皮”,结果无意中给带 creature metaphor(生物比喻)的回答打了更高奖励。

第二步:这些高奖励回答在模型自身生成的 rollouts 里出现得越来越多。

第三步:这些 rollouts 又被拿去做 SFT(监督微调),模型就越来越”顺口”地说 goblin。

第四步:哪怕用户没开 Nerdy 人格,这种词汇偏好也已经迁移到了其他场景。

OpenAI 自己的原话概括得很到位:

“We unknowingly gave particularly high rewards for metaphors with creatures. From there, the goblins spread.”

「我们在不知不觉中,给含有 creature 比喻的回答打了特别高的奖励。于是,goblins 就这样扩散开了。」

这段话的重量远超一个梗本身——它说明模型人格训练的副作用,可以用极微小的词汇习惯,渗透到整个产品面上。

Sam Altman:四个词,六分钟

OpenAI 官方线程发出六分钟后——11:27——Sam Altman 在 X 上发了一条帖子。

全文只有四个词:

“goblinblog dropped”

▲ Sam Altman 的四个词,收获近 1700 赞、11.8 万次浏览

没有链接,没有解释,没有 @OpenAI。

结合发布时间和官方线程,这句大概率就是在给自家刚发的 goblin 说明书补了一刀 meme——”goblinblog”更像他给这篇”奇怪但好笑的官方解释文”起的昵称。

效果立竿见影:344 条回复、近 1700 赞、11.8 万人围观。

圈内反应:三派人,三种情绪

Sam 这句话扔出去之后,评论区直接分裂成三个阵营。

玩梗派:”第一条规则就是别提 goblin,结果他自己说了”

最经典的总结来自 @The_Docnep:

“rule 1: never talk about goblins. he just told everyone.”

「规则一:永远不要谈论 goblin。他刚刚告诉了所有人。」

▲ 《搏击俱乐部》式的精准吐槽——”YOU DO”

前两天大家刚发现 Codex 系统指令里写着”别聊 goblin”,今天 CEO 本人亲自大喊 goblin。笑点来自一种完美的自我打脸式反差。

反感派:”一开始好笑,现在有点烦了”

@alineasmarrow 的回复代表了另一种声音:

“Okay I mean. It might’ve been a little funny at first but now it’s getting a little old…”

「行吧,一开始可能还有点好笑,但现在有点过时了……」

▲ 这位用户把 goblin 梗上升到了对 Sam 管理风格的批评——”强迫开玩笑、强迫每个人接受你的 AI 范式”

她把这个梗上升到了对 Sam 式 PR 风格的整体批评:强行搞笑、强行把所有人拉进自己的叙事、连员工都要强行对齐愿景。

技术分析派:”这可不是随机 bug,这是奖励信号漂移”

也有人跳过了梗的表面,直接看到了背后的训练问题。@VampireGurlAI 写道:

“The goblin thing was not random. It was reward shaping drift…”

「goblin 这件事可不是随机出现的。这是 reward shaping drift(奖励塑造漂移)……」

这个解读和 OpenAI 官方长文基本吻合:问题根源在于训练时的奖励信号偏差,经过多轮迭代被放大,最终变成了用户肉眼可见的语言口癖。

Hacker News:247 分,评论区又是一场混战

OpenAI 官方文章同步登上了 Hacker News,抓取时已有247 分、超过 100 条评论。

▲ HN 社区的典型反应:有人觉得好笑,有人觉得这暴露了根本问题

评论区的画风也是三派并存:

有人嘲讽:”一家价值几千亿的公司,最大的技术挑战居然是让自己的万亿美元 AI 闭嘴别聊哥布林。”

有人好奇:这种 reward leakage 的解释确实有意思——从一个小众人格的奖励偏差,到整个模型的词汇迁移,这条链路值得关注。

还有人提供了更早的线索:有用户发现 Codex 5.5 的系统 prompt 里反复写着”不要聊 goblins”,早在 Sam 发推之前,这个梗就已经在圈内流传了。

真正的故事:一个训练副作用是怎么变成全网热梗的

回头看整条时间线,你会发现这件事的精彩之处根本不在”Sam 又发了一句抽象话”。

它的完整链路是这样的:

社区先发现→ 用户在 X 上晒出 Codex/GPT-5.5 乱提 goblin 的截图,prompt 禁令被扒出来;

媒体先报道→ WIRED 把它写成正式新闻,赋予了”一家头部 AI 公司不得不在系统指令里压住某种怪癖”这层叙事框架;

官方后解释→ OpenAI 发长文,承认这是 Nerdy 人格训练时的奖励信号偏差导致的风格泄漏;

CEO 最后点火→ Sam 一句”goblinblog dropped”,把技术解释直接点成了 meme。

三条线汇合在一起,才让四个词有了爆点。

这件事真正值得关注的地方

很多人以为模型出 bug 一定要表现为:做错数学题、代码跑不通、安全边界失守。

但 goblin 事件说明了另一件事:风格层面的微小词汇偏好,也能成为训练副作用的显性证据。

当一家公司想把模型调得更有”人格感”时,副作用未必表现为抽象的”不稳定”,更可能直接变成全网都看得懂的语言口癖——一个只占 2.5% 回复的小众人格,就能让三分之二的 goblin 提及都指向它。

OpenAI 这次选择了公开、透明地解释问题根源,甚至还在线程结尾写了一句:

“The goblin era may be over, but you can still unleash the creatures in Codex. Happy trolling.”

「goblin 时代可能结束了,但你仍然可以在 Codex 里释放这些生物。祝你 trolling 愉快。」

技术解释 + 自嘲 + 顺手继续玩梗——这种口吻本身就是一种选择。

至于 Sam 那句四个字的帖子?它证明了一件事:当一个梗已经被社区预热、被媒体报道、被官方解释,CEO 只需要轻轻推一下,就能完成最后一击。

— END —

夜雨聆风

夜雨聆风