AI越聪明,世界越需要电

AI数据中心为什么这么耗电?

AI数据中心不是普通机房,也不是简单多放几台服务器。它本质上是一个高度密集的电力消费体。耗电主要是四个方面:

1.最直接的耗电来自GPU、TPU、ASIC等AI加速芯片。模型训练需要大量芯片长时间满负荷运行,推理阶段虽然单次请求耗电不一定夸张,但当用户量、调用频率、Agent任务快速上升后,总耗电会非常大。

2.服务器、内存、存储和网络设备也在持续耗电。大模型训练不是一台机器单独计算,而是成千上万张芯片之间高速通信,交换机、光模块、网络互联设备本身也需要大量电力支撑

3.冷却系统是另一大耗电来源。GPU高负载运行会释放大量热量,数据中心必须通过风冷、液冷、冷水机组、泵和散热系统持续降温,否则过热会影响设备稳定性和寿命。

4.供配电系统自身也有损耗。电从电网进入数据中心,要经过变压器、UPS、配电柜、母线、电力转换设备,中间每一道环节都需要冗余和安全设计。UPS(Uninterruptible Power Supply)是不间断电源,当外部电网突然断电、闪断、电压波动时,UPS可以在极短时间内接管供电,保证服务器不断电、不宕机,相当于汽车后备箱里备胎的作用。

UPS长这样:

所以,一次AI问答或更复杂的智能体任务,看起来只是屏幕上的几行结果,但背后对应的是芯片、网络、冷却、供电系统这一整套机制的运转。

如果用数据中心规模来量化,一个100MW的数据中心,如果全年高负载运行,一年大约消耗8.76亿度电;如果是1GW级数据中心,年耗电量就是87.6亿度电。EPRI预计,到2030年,美国数据中心可能消耗全国9%到17%的发电量,明显高于当前水平。

100MW差不多一个大型AI数据中心级别的负荷。目前OpenAI、Anthropic这类头部AI公司的算力需求,已经在向数百MW、甚至GW级别演进。Anthropic披露,与Google Cloud合作的TPU容量将在2026年带来超过1GW算力。

AI数据中心需要什么样的电?

AI数据中心需要的不是普通意义上的“有电就行”,它对电力质量提出了更高的要求。

1.稳定。数据中心不能频繁断电,一旦断电,可能造成服务中断、训练或推理任务失败,甚至影响硬件和数据安全。

2.持续。AI训练和推理不是白天开机、晚上关机,而是7×24小时运行。尤其大模型训练任务,可能连续运行数周甚至更久。

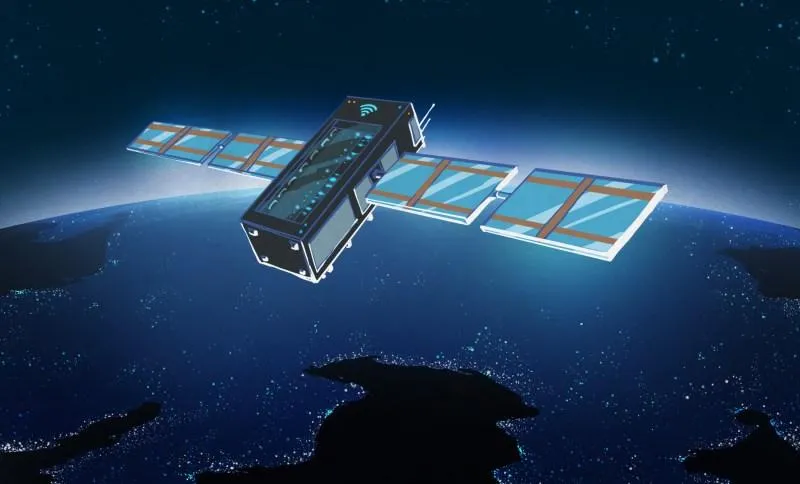

以DeepSeek-V3为例,公开技术报告显示,其模型为671B总参数、每个token激活37B参数的MoE模型,预训练了14.8万亿token,完整训练消耗约278.8万小时H800 GPU。

如果简单换算成时间,假设2048张H800同时训练,也要接近两个月;如果4096张H800同时训练,也要接近一个月。这还只是模型训练本身,没有算前期数据处理、调参、后训练和上线部署等。

3.大规模。过去几十兆瓦负荷已经算大项目,现在AI数据中心动辄百兆瓦,甚至向吉瓦级规划发展。微软和Constellation签了20年核电购电协议,推动重启三里岛1号机组;Amazon和Talen签下接近2GW级别的核电供电协议;Oracle则与Bloom Energy合作,用燃料电池为AI数据中心提供最多数GW级别的本地电力。

4.能快速接入。不是发电量够就可以,还要看当地电网、输电线路、变压器、配电系统能不能承载。很多地方不是“缺电”,而是缺可以快速接入数据中心的电力基础设施。

5.电价可控。电费最终会成为AI训练、推理和云服务的成本。未来AI公司之间竞争的不只是模型能力,也会竞争能源成本和基础设施效率。如果电价成本过高,AI叙事很难得到商业论证。

所以,AI数据中心最理想的电力,应该具备下面这些关键词:

稳定、持续、大规模、效率接入、价格可控。

传统能源里,水电和核电是非常优质的基荷电源。它们稳定、低碳、适合长期持续供电,尤其核电正在重新进入科技巨头视野。美国数据中心和AI需求快速增长后,微软、Meta、Google等公司都在不同程度上寻找核电、下一代核能或长期清洁电力合同。

煤电的优点是稳定、成熟、可作为基荷电源,理论上完全可以给数据中心供电。但是碳排放高、环保压力大、审批和社会接受度越来越低,也不符合微软、Google、Meta、Amazon这些公司的长期低碳承诺。

天然气发电则更像短期和中期的替代方案。它建设速度相对核电更快,调峰能力强,能够在电网接入慢、数据中心扩张快的地区补上缺口。比如电力供应商Entergy近期提高资本开支计划,其中很重要的原因就是为Meta在路易斯安那的数据中心建设超过5.2GW的天然气电厂和相关基础设施。

新兴能源里,光伏和风电的优势是建设快、成本下降快、低碳属性强,但问题是出力不稳定。太阳能白天强、晚上没有;风电受天气影响较大。因此,光伏和风电更适合作为“增量电源”,不能单独承担AI数据中心的全部稳定供电任务。

这时候,储能就变得非常关键。储能不是凭空发电,而是把不稳定的新能源变得更可用:白天光伏多发时储电,夜间或高峰时放电,电网波动时稳定频率,突发断电时提供应急支撑。

储能设备长这样:

所以,可以把AI数据中心的电力结构简单理解为:核电、水电、天然气负责稳定底座,光伏、风电负责增量供给,储能、UPS、电网设备负责调节和安全。

真正受益的,不只是发电企业,而是整套“电源—电网—储能—数据中心供配电”的产业链。

太空光伏,是噱头还是未来?

根据Reuters,SpaceX在2026年1月向美国FCC提交方案,希望部署最多100万颗太阳能驱动的轨道AI数据中心卫星。现在不是都在地面建AI数据中心吗,马斯克是考虑把AI数据中心的一部分搬到太空。

这个方案的逻辑是:地面数据中心受制于电力、土地、水资源、冷却和审批,而太空中太阳能更连续,不受昼夜和天气影响。如果未来发射成本大幅下降,理论上有可能成为极端大规模AI算力的一种补充路线。

不过这个方案能否落地还是未知数,难点包括发射成本、轨道维护、空间散热、通信延迟、卫星寿命、辐射环境和太空碎片风险。

下面是设想图,一看就觉得离谱是不是:

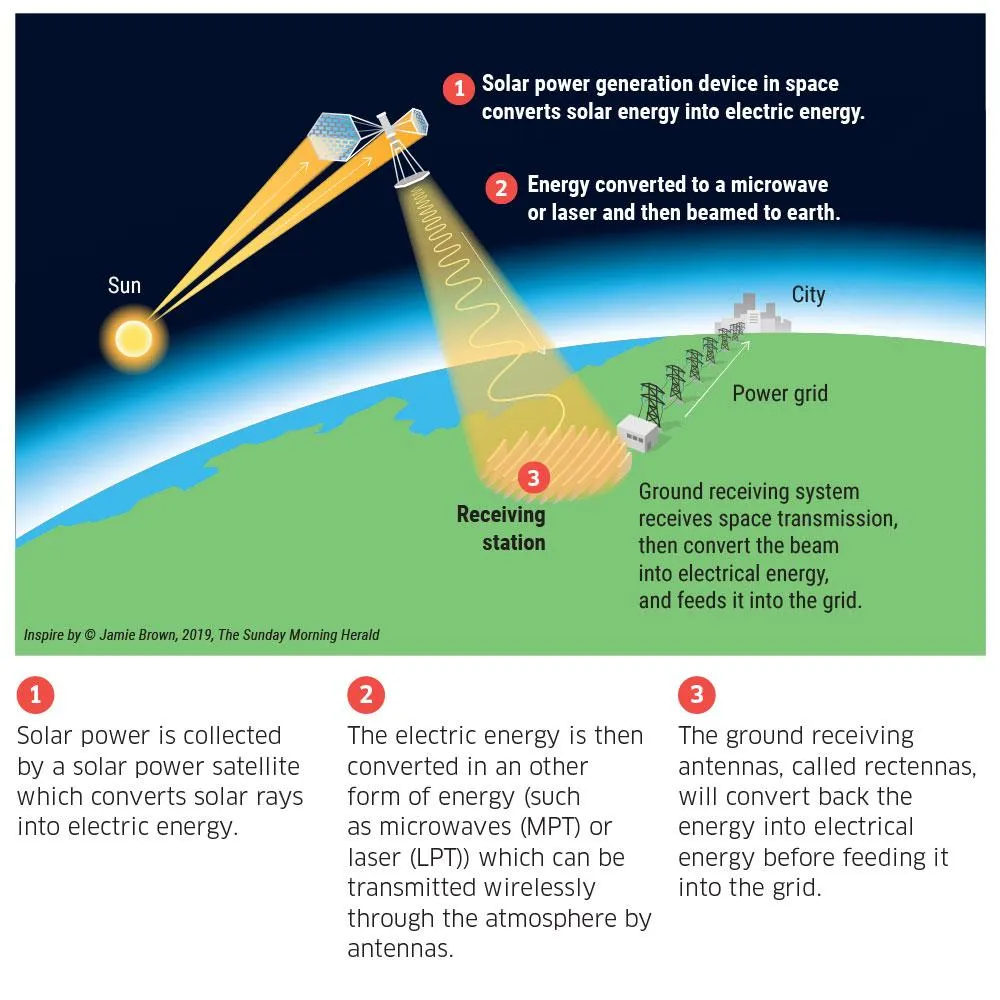

相比之下,Meta与空间太阳能初创公司Overview Energy合作的方案在短期更有可行性。他们计划在轨道上收集太阳能,再把能量通过无线能量传输回地面设施,传输的技术路线包括微波传输或激光、近红外传输。据说,Meta将获得最高1GW的早期电力容量,首次演示目标在2028年,商业交付目标在2030年。

所以,太空光伏现在还不能马上应用,但它传递了一个重要信号:AI巨头已经把电力问题上升到了战略资源层面。

AI带来的不是单纯全球缺电,而是结构性缺电。数据中心想建的地方,不一定有足够便宜稳定的电;有电的地方,不一定有足够输电线路;有新能源的地方,不一定能满足全天候稳定供电。

同时,AI电力系统还会拉动一批上游资源需求。比如铜用于电缆、变压器、电机和电网,铝用于输电和光伏,锂、钠、钒用于储能;铀用于核电,天然气用于过渡电源,稀土用于电机和部分电力设备。

这意味着,AI时代的资源竞争,可能不只发生在GPU和先进制程上,也会延伸到铜矿、铀矿、天然气、电网设备、储能材料和电力基础设施。

更深一层看,未来AI算力中心的布局,可能越来越取决于能源条件。谁拥有稳定、便宜、低碳、可快速接入的电,谁就更容易承接大规模AI数据中心。AI主权背后,可能是能源主权,算力竞争背后,可能是电力和资源竞争。

芯片、服务器、光模块是AI扩张最直接的硬件载体。但随着模型越来越大、推理调用越来越多、数据中心越来越密集,电力正在从后台成本变成前台变量。未来AI产业链的定价逻辑,很可能从“算力设备”继续扩展到“能源底座”。核电、水电、天然气、光伏、风电、储能、电网设备、UPS和关键资源,都可能被重新纳入AI产业链的观察范围。

说到底,AI越聪明,世界越需要电。而谁能给AI提供稳定、持续、便宜、可扩展的电,谁就可能成为下一轮AI基础设施重估里的重要角色。

夜雨聆风

夜雨聆风