部署 OpenClaw 后,NAS 定时任务该怎么选?

一文讲透两种定时任务的区别、适用场景和常见坑位,附真实 A 股监控系统排错案例。

引子:部署了 OpenClaw 之后,定时任务反而不会设了?

如果你的 NAS 上只有 Linux,定时任务很简单——打开 crontab,写一行就完了。你没得选,也不需要选。

但如果你部署了 OpenClaw,事情就变了:你突然多了一个 cron 系统。

-

系统 crontab:Linux 自带的,跑脚本、执行命令 -

OpenClaw cron:AI Agent 的,能分析、能整理、能判断

选择多了,反而容易选错。

我最近就踩了个坑。A 股监控系统连续两个定时任务超时失败:

持仓监控 09:50 报错

cron: job execution timed out

10:05 的选股复核也挂了。明明脚本本身只要 4 秒就跑完,为什么定时任务会超时?

排查后发现一个关键问题:我把需要 AI 分析的复杂任务,和只需要简单跑脚本的任务,全都混在了 OpenClaw cron 里。结果 AI session 启动时间过长,300 秒的超时窗口根本不够用。

把部分任务迁移到系统 crontab 后,问题迎刃而解。

这篇文章就借着这次排错经历,一文讲清楚两种定时任务的区别——系统 crontab 和 OpenClaw cron,帮你避免踩同样的坑。

一、两种定时任务,本质完全不同

1. 系统 crontab:Linux 的”老伙计”

crontab 是 Linux 系统自带的定时任务管理器,从 Unix 时代就存在了。它的逻辑非常简单:

分 时 日 月 周 要执行的命令比如:

# 每天早上 9:00 执行脚本0 9 * * 1-5 python3 /vol1/1000/github/LuckyniumaA/stock-holding-monitor.py# 每 3 小时执行一次0 */3 * * * /home/Jaben/scripts/backup.sh特点:

-

由操作系统直接调度,不依赖任何应用 -

执行的是 shell 命令或脚本 -

输出默认通过邮件发送(NAS 上通常不配邮件,所以输出会丢失) -

没有内置的通知推送能力 -

适合跑简单的、不需要 AI 参与的脚本

2. OpenClaw cron:AI Agent 的”智能闹钟”

OpenClaw cron 是 OpenClaw 系统内置的定时任务管理器,它不是直接跑脚本,而是触发一个 AI Agent 会话,让 AI 去执行任务。

它的配置结构是这样的:

{"name": "持仓监控 09:35","schedule": {"kind": "cron","expr": "35 9 * * 1-5","tz": "Asia/Shanghai" },"payload": {"kind": "agentTurn","message": "执行 python3 /vol1/1000/github/LuckyniumaA/stock-holding-monitor.py,把完整输出发给我","timeoutSeconds": 300 },"delivery": {"mode": "announce","channel": "last","to": "987654321" }}特点:

-

每次触发会启动一个 AI Agent session(isolated 模式) -

AI 会读取你的指令,执行脚本,然后整理输出发送给你 -

内置 Telegram/微信等消息推送 -

支持超时控制、失败告警、执行历史 -

适合需要 AI 分析、整理、判断的复杂任务

二、核心区别对比

|

|

|

|

|---|---|---|

| 调度者 |

|

|

| 执行内容 |

|

|

| 输出方式 |

|

|

| AI 能力 |

|

|

| 启动开销 |

|

|

| 超时风险 |

|

|

| 管理方式 | crontab -e

|

|

| 执行历史 |

|

|

| 适合场景 |

|

|

三、我的真实案例:A 股监控系统的定时任务

背景

我在 NAS 上跑了一个 A 股监控系统,交易日需要定时执行两类任务:

-

选股复核:每 30 分钟跑一次选股脚本,筛选适合建仓的股票 -

持仓监控:每 15 分钟跑一次持仓监控脚本,检查持仓股票是否需要调整

交易日的执行时间从早上 9:00 到下午 15:45,总共 30+ 个定时任务。

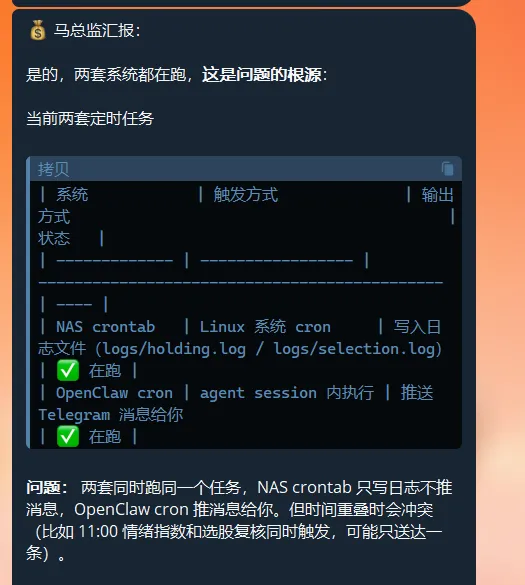

之前的问题

所有任务都配置在 OpenClaw cron 里。看起来合理——毕竟需要 AI 分析选股结果和持仓状态。

但实际跑起来发现几个问题:

问题 1:超时频繁

持仓监控脚本本身只要 4 秒,但 OpenClaw cron 的 300 秒超时窗口经常不够。原因:

-

AI session 启动需要 10-30 秒 -

脚本执行需要 4 秒 -

脚本输出内容很长(包含多只股票的详细分析),AI 需要时间整理 -

整理后的消息还要通过 Telegram API 发送

高峰期(上午 9:35-11:20,每 15 分钟一个持仓监控 + 每 30 分钟一个选股复核),多个任务并发,session 排队,超时就成了常态。

问题 2:上午持仓监控丢失

4 月 25 日 NAS 迁移时,批量更新了 31 个 cron 任务,但上午 8 个持仓监控任务被遗漏了。直到 4 月 29 日才发现——整整 4 天上午的持仓监控没有执行。

问题 3:输出格式不一致

不同任务的消息指令写法不统一,有的写”直接输出脚本的完整结果”,有的写”必须把脚本的完整输出内容原样发给我”,导致 AI 的输出格式五花八门。

现在的方案:混合使用

排查后我做了调整,核心思路是按任务性质分流:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

关键改动:

对于持仓监控这类简单任务,我创建了一个包装脚本,脚本执行完后直接用 Telegram Bot API 推送结果,不经过 AI session:

#!/bin/bash# stock-holding-cron-wrapper.shcd /vol1/1000/github/LuckyniumaARESULT=$(python3 stock-holding-monitor.py 2>&1)# 直接通过 Telegram Bot API 推送curl -s -X POST "https://api.telegram.org/bot${BOT_TOKEN}/sendMessage" \ -d "chat_id=98764321" \ -d "text=${RESULT}" \ -d "parse_mode=Markdown"然后在系统 crontab 里配置:

# A 股持仓监控 - 上午35,50 9 * * 1-5 /home/Jaben/scripts/stock-holding-cron-wrapper.sh5,20,35,50 10 * * 1-5 /home/Jaben/scripts/stock-holding-cron-wrapper.sh5,20,35,50 11 * * 1-5 /home/Jaben/scripts/stock-holding-cron-wrapper.sh# A 股持仓监控 - 下午10,25,40,55 13 * * 1-5 /home/Jaben/scripts/stock-holding-cron-wrapper.sh10,25,40,55 14 * * 1-5 /home/Jaben/scripts/stock-holding-cron-wrapper.sh选股复核等需要 AI 分析的任务,仍然保留在 OpenClaw cron 里。

效果对比

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

四、如何选择:决策树

面对一个定时任务,到底该放哪里?

按这个流程判断:

你的任务需要 AI 分析/判断/整理吗?├── 不需要 → 放系统 crontab│ ├── 简单脚本执行(备份、监控、导出)│ ├── 定时重启服务│ ├── 日志清理│ └── 数据同步│└── 需要 → 继续判断 ├── 输出内容短、脚本执行快(<10 秒)→ OpenClaw cron │ ├── 情绪指数更新 │ ├── 彩票选号 │ └── 简短报告生成 │ └── 输出内容长、脚本执行慢、或需要复杂分析 → OpenClaw cron ├── 大盘预判/复盘 ├── 选股分析 └── 周报/月报生成几个典型场景

场景 1:每天凌晨备份 NAS 数据

→ 系统 crontab。不需要 AI,就是跑个 rsync 或 tar 命令。

0 2 * * * /home/Jaben/scripts/backup-nas.sh场景 2:交易日每 15 分钟监控持仓股票

→ 如果你的监控脚本本身已经输出了完整的分析结果(技术面、资金面、基本面),那脚本执行完直接推送就行,系统 crontab + 推送脚本。

→ 如果你的监控脚本只输出原始数据,需要 AI 二次分析判断,那放 OpenClaw cron。

场景 3:每天生成一份 AI 分析报告

→ OpenClaw cron。需要 AI 理解数据、生成分析、整理格式。

场景 4:每 3 小时扫描一次 Polymarket 市场

→ 系统 crontab。脚本执行、结果推送,全程不需要 AI 介入。

五、用户设置指南:如何让 OpenClaw 选对执行方式

前面讲了 OpenClaw 如何判断任务应该放哪里。但作为用户,你在跟 OpenClaw 对话设置定时任务时,怎么说清楚需求?

1. 描述任务时,提供这些关键信息

OpenClaw 判断任务类型主要看四点:

|

|

|

|

|---|---|---|

| 任务内容 |

|

|

| 输出长度 |

|

|

| 执行时间要求 |

|

|

| 是否需要 AI 判断 |

|

|

2. 如何明确指定执行方式

你可以直接告诉 OpenClaw 用哪种方式:

明确指定系统 crontab:

帮我设个定时任务:- 每天 9:35 跑一次持仓监控脚本- 脚本路径:/vol1/1000/github/xxx/stock-holding-monitor.py- 输出直接推送给我,不需要 AI 分析- 放系统 crontab明确指定 OpenClaw cron:

帮我设个定时任务:- 每个交易日 15:00 做一次大盘复盘- 需要收集当天的数据,AI 分析后生成报告- 用 OpenClaw cron让 OpenClaw 自己判断:

帮我设个定时任务:每天 9:35 跑持仓监控脚本,路径是 xxx,你来判断放 crontab 还是 OpenClaw cron3. 典型对话示例

❌ 模糊描述(OpenClaw 可能追问):

用户:帮我设个监控任务OpenClaw:好的,请问:1. 监控什么内容?跑脚本还是需要 AI 分析?2. 输出大概多长?3. 多久执行一次?✅ 清晰描述(一次性搞定):

用户:帮我设个定时任务,交易日每天 9:35 跑一次持仓监控脚本,脚本路径是 /vol1/1000/github/xxx/stock-holding-monitor.py,输出是股票分析结果,大概 500 字,脚本执行很快,跑完直接推给我,不需要 AI 分析,放系统 crontabOpenClaw:好的,已添加到系统 crontab:35 9 * * 1-5 python3 /vol1/1000/github/xxx/stock-holding-monitor.py4. OpenClaw 的默认行为

当你没有明确指定时,OpenClaw 会这样判断:

-

提到”跑脚本””执行命令””不需要分析” → 倾向于系统 crontab -

提到”分析””整理””生成报告””AI 帮我看看” → 倾向于 OpenClaw cron -

不确定时 → OpenClaw 会追问你

5. 快速参考卡片

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

六、常见坑位和避坑指南

坑 1:把所有任务都塞进 OpenClaw cron

症状: 频繁超时、消息推送延迟、AI token 消耗暴增。

原因: OpenClaw cron 每次触发都要启动 AI session,有 10-30 秒的启动开销。如果任务本身只需要跑个 4 秒的脚本,这个开销就是浪费。

解法: 简单脚本放 crontab,需要 AI 的才放 OpenClaw cron。

坑 2:在系统 crontab 里跑需要 AI 分析的任务

症状: 任务能跑,但输出是一堆原始数据,看不懂。

原因: crontab 只负责执行命令,不会帮你整理和分析。

解法: 需要分析的任务放 OpenClaw cron,或者在 crontab 脚本里自己处理输出。

坑 3:crontab 脚本的输出丢失

症状: 任务明明执行了,但看不到结果。

原因: crontab 默认通过邮件发送输出,NAS 上通常没配邮件服务,输出就丢了。

解法: 在脚本里自己处理输出——写日志文件,或者通过 Telegram Bot API 推送。

坑 4:两种 cron 配置不同步

症状: 改了脚本路径,忘了一边没改,导致一边能跑一边不能跑。

原因: 系统 crontab 和 OpenClaw cron 是两套独立配置,没有联动。

解法: 关键任务只保留一份配置。如果要双备份,做好文档记录。

坑 5:OpenClaw cron 的 delivery 路由不一致

症状: 有些任务的消息发到 main session,有些发到 agent session,用户收到消息的渠道不一致。

原因: delivery 配置不统一,有的写了 channel: "last", to: "987654321",有的只写了 mode: "announce"。

解法: 统一所有任务的 delivery 配置,确保消息路由到同一个地方。

七、管理建议

1. 统一文档

把两种 cron 的配置都记录在一个文档里,比如 TRADING_SYSTEM_MASTER.md 或 cron-config.md,包含:

-

任务名称 -

执行时间 -

执行内容 -

放在哪里(crontab / OpenClaw cron) -

推送渠道

2. 定期检查

-

系统 crontab: crontab -l定期查看 -

OpenClaw cron:通过 OpenClaw 对话查看执行历史和状态

3. 迁移时格外小心

NAS 迁移、系统重装时,系统 crontab 和 OpenClaw cron 都需要重新配置。建议:

-

系统 crontab 导出到文件备份: crontab -l > crontab-backup.txt -

OpenClaw cron 配置记录在文档里,方便重建

结语

系统 crontab 和 OpenClaw cron 不是二选一的关系,而是互补的关系。

-

crontab 是”快而稳”的基础设施,适合简单任务 -

OpenClaw cron 是”慢但聪明”的智能层,适合需要 AI 参与的任务

理解它们的区别,按任务性质合理分配,才能让定时任务系统既稳定又高效。

希望这篇文章能帮你避开我在 A 股监控系统里踩过的坑。如果你有更好的定时任务管理方案,欢迎交流。

👥 折腾交流群

如果你想看更多这类 OpenClaw × NAS × AI自动化 的实战内容;

如果你想参与讨论、一起共创玩法,也欢迎私信或者进群一起交流。

夜雨聆风

夜雨聆风