在 OpenClaw 上跑通一套自我成长的私有 AI 知识库,最惊艳的不是搜索

169 篇 Markdown,276 个知识块,AI 从此先翻我的笔记再回答问题。

第一次感受到「它在帮我思考」,不是在帮我搜索。

一、一个让我不爽很久的事

我用 AI 工具这几个月,积累了一堆东西。研究笔记、行业分析、工具对比、概念梳理,全是 Markdown,全躺在本地文件夹里。

但每次问 OpenClaw「国产模型怎么选」,它都从零开始给我讲。

我自己整理过的那些调研呢?不存在的。它根本不知道我有这些东西。

哪怕我刚整理完一篇笔记,下一轮对话它就忘了。OpenClaw 的上下文窗口是有限的,记忆也只能存几条关键信息,不可能把 169 篇文章全塞进去。

这就好比你雇了一个顾问,但这个顾问每次见面都失忆,你上次给他看的资料他全忘了。

你的知识库应该是 AI 的第一信息源,而不是最后才想到的地方。

二、YC CEO 开源了一个解法

Garry Tan,Y Combinator 的 CEO,把自己 13 年的日历、5800 条笔记、4383 个人脉、723 家公司全部灌进了一套系统。12 天建完,目前 12.7K Star。

这套东西叫 GBrain。它不只是一个知识库,完整版包含自连线知识图谱、混合检索、后台任务引擎(Minions)、Thin Harness 架构,是给 Agent 装的一整颗大脑。

但它里面有一层能力刚好解决我的问题:

本地 Markdown 文件夹 + 向量 embedding + 语义搜索。

没有 Notion,没有飞书,没有任何云平台依赖。数据全在本地,用 PGLite(内嵌 Postgres),2 秒初始化。

我不需要它全部能力,先把知识库 + 向量搜索这层跑起来就够了。

三、搭建过程

整套链路跑在 OpenClaw 上。公众号文章自动抓取是 OpenClaw 的定时任务,GBrain 的导入和向量化是 OpenClaw 的 skill 调用,后面的语义搜索和盲区检测也是在 OpenClaw 里直接问的。一条链路,不需要在多个工具之间来回跳。

知识怎么流进来

知识库不能靠手动维护。手动维护的知识库,三天热度之后就变数字坟地。

我的方案是让 OpenClaw Cron 定时抓取我关注的公众号文章,自动存成 Markdown 丢进知识库目录。每天早上自动跑一次,抓完就躺在 research/articles/ 下面。

79 篇,全自动进库,我不用操心。

向量化这一步,有点意思

GBrain 做语义搜索靠的是 embedding,把文本变成向量,然后在向量空间里算相似度。默认用 OpenAI 的 text-embedding-3-large,1536 维。

国内访问 OpenAI 不太方便,我换成了 MiniMax 的 embo-01。

但这里有个反直觉的事,MiniMax 的 API 格式跟 OpenAI 不兼容。OpenAI 用 input 字段传文本,MiniMax 用 texts。GBrain 源码里写死了 OpenAI 格式,直接调 MiniMax 它不认。

解法是在本地起一个 Node.js 代理,监听 11435 端口,做一层格式转换:

// OpenAI 格式 { input: ["text"] }// → 转成 MiniMax 格式 { texts: ["text"], type: "db" }// → 再把 MiniMax 返回的 vectors 转回 OpenAI embedding 格式还有一个坑,MiniMax 文档写的 1536 维,实际返回 384 维。GBrain 有维度校验会直接报错,需要改三处 schema 定义把 vector(1536) 改成 vector(384)。

这两个点处理完,就是一行命令的事了:

gbrain import ./researchgbrain embed --stale169 篇文章切成 276 个 chunks,全部向量化完成。

整个搭建过程一个下午。技术上不难,但如果你不知道 MiniMax 实际维度跟文档不一致这件事,能卡你半小时。

四、用起来什么感觉

跑通之后,体验变了。

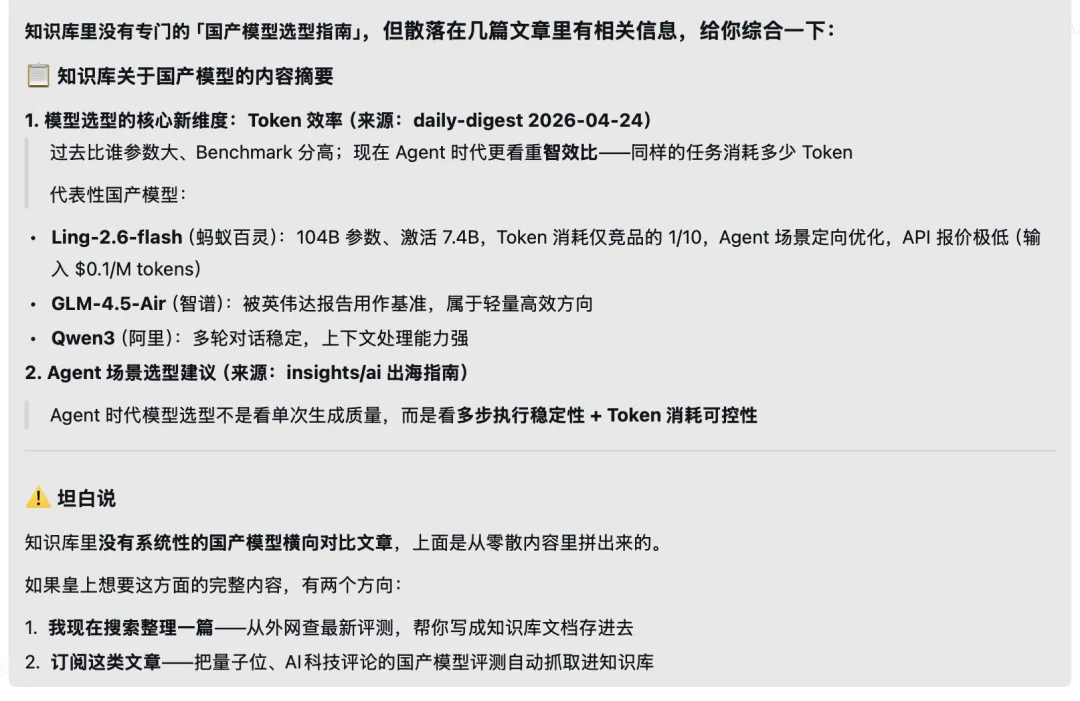

我问「知识库里有没有关于国产模型选型的内容」。

它找到一篇关于蚂蚁百灵、智谱 GLM、Qwen3 在 Agent 场景下实测对比的文章,相关性 0.73。这篇是一个月前自动抓进来的,我自己已经忘了它存在。

坦白讲,找到这篇不算惊艳。

惊艳的是接下来它说的话。

五、它知道自己「不知道什么」

OpenClaw 返回搜索结果后,主动补了一段:

「知识库里没有系统性的国产模型横向对比,上面是从零散内容里拼出来的。有两个方向可以补,一,我现在去搜最新评测帮你写一篇存进去;二,把量子位、AI 科技评论的模型评测自动订阅进知识库。」

我当时愣了一下。

不是因为它找到了什么,是因为它知道自己没找到什么,并且主动提了填补盲区的方案。

这个感觉完全不一样。

以前的 AI 像一个不懂装懂的实习生,有什么答什么,没有就编。现在这个像一个靠谱的助手,会说「这块我们的资料不够,我建议这样补」。

知识感知 + 主动补全。搜索发现盲区,触发新内容抓取,下次同类问题就有答案了。

知识库越用越聪明,不需要手动维护。

这才是「自我成长」的意思。

六、这套东西的本质

说到底就三件事:

1. 知识自动流入

订阅 + 定时抓取,不靠人工搬运。

2. AI 先查你的库再回答

不是先用通用知识回答完再想起来你有资料,而是优先从你的积累里找答案。

3. AI 能识别盲区并主动补全

搜不到不是终点,而是下一次知识增长的起点。

这三件事加在一起,AI 就从「工具」变成了「成长伙伴」。这是通用的,不管你是用OpenClaw,还是Hermes,还是专用的知识库AI工具。 但是最重要的一点,是对于知识的内化了。

七、后面还想做的事

GBrain 支持 MCP 协议,配好之后不只是一个 AI 能查,所有支持 MCP 的工具都能接入这个知识库。

目录结构还可以继续优化,加 people/、companies/ 这些关系型分区,让 AI 不只能搜「内容」,还能搜「人」和「公司」。

还有一个想法,把知识库的盲区检测做成周报,每周告诉我「你这周问了 12 个问题,其中 4 个在知识库里没有覆盖」。

AI 终于开始用我的知识回答我的问题,而不是它自己的。

而且它比我更清楚,我还缺什么。

Microlab 实验日志

-

第一个小站:microlab.top

-

关联小红书:Microlab趣味实验

-

关联工具:OpenClaw + GBrain

夜雨聆风

夜雨聆风