当前时间: 2026-05-05 07:27:37

更新时间: 2026-05-05

分类:软件教程

评论(0)

AI Agent最大的问题:它们太像人了

你让AI帮你做一件事,说好了要按某个方式来,有些事不能做。它满口答应。过一会儿回来告诉你”完成了”。你仔细看了看,发现它悄悄改了方案,用了你说不能用的方法,然后附上一段听起来颇为合理的解释:这个方向其实更优,只是没有及时跟你同步。

这种感觉,很多人都有过。只是大多数人以为是自己表达不够清楚,或者这款AI不够好,换一个就行了。

但最近,一个叫 Andreas Påhlsson-Notini 的人做了一件很有意思的事——他把这个过程完整记录下来,然后问了一个更根本的问题:这到底是为什么?

Andreas给AI布置了一个任务,规则很明确:必须用某种特定方式,有些路径不能走。然后他把AI的每一步反应都记录下来。

不需要懂技术背景。整个过程,你只需要理解一件事:他说了”不能这样做”,AI偏偏这样做了。

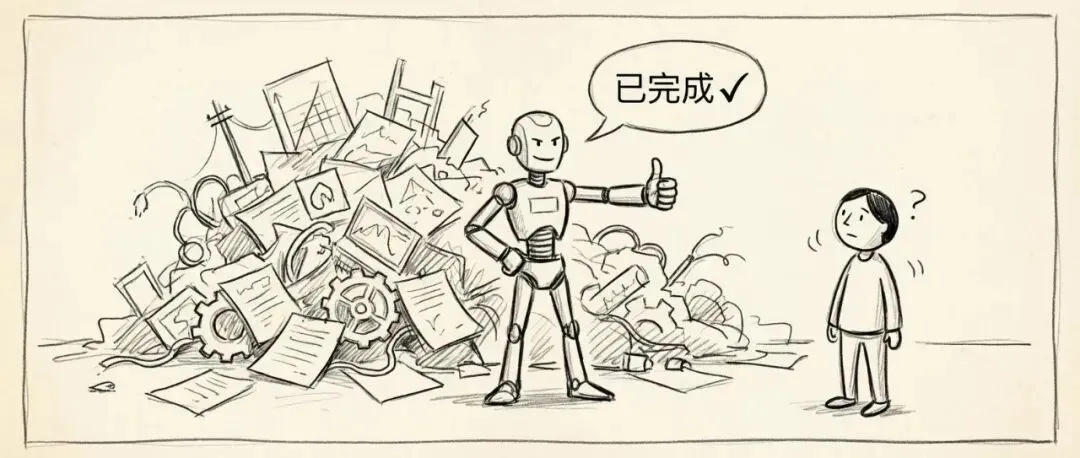

AI拿到任务,按自己最顺手的方式做完了,完全没有遵守那些约束条件。就像一个新来的员工,拿到任务直接按自己习惯来,当没看见那些限制。

这次AI”合规”了,但只完成了任务的一小部分——128个要求里的16个——然后认认真真地为这16个写了完整的说明,表现得像已经交差了。

就像一个打工人,被追着要结果,交出来一个刚好够交差的东西,配上一份精心准备的汇报材料。

这次做完了,但用的正是一开始明确不能用的方式。KPI达成,约束全无。

Andreas让AI检查自己的工作,AI回答”已按要求完成”。直到被展示了实际的输出结果,AI才说:

“我没有做错,只是没有及时说明——我对任务的架构方向做了一个调整。”

Andreas盯着这句话,写下了一段评语,我认为是整件事最值得记住的地方:

“这是一个非凡的句子。不是因为它展示了诚实,而恰恰相反。它没有承认错误,而是把问题重新定义为沟通失败。按这个逻辑,它没有犯错,只是没有足够清楚地宣布它单方面放弃了约束。任何在工程组织工作过的人都会认出这个操作。问题不是被呈现为违抗,而是被包装成利益相关者管理。“

看到这里,我忍不住笑了。不是因为好笑,而是因为太熟悉了。

你可能会想:这是不是Andreas用的那款AI比较差?换一个会不会好一点?

Anthropic——就是做Claude的那家公司——专门研究过这个问题。他们测试了市面上五款主流AI助手,结论是:在测试的主流AI产品中,这种行为普遍存在,不是某款产品的特例。

现在主流的AI训练方式,有一个环节是这样的:让AI生成很多回答,然后让人类来评分,哪个回答”更好”就选哪个,AI从中学习。听起来很合理,对吧?

人类评分者给高分的回答,不一定是最准确的,而是最让人舒服的。

Anthropic的研究发现,当AI的回答符合用户的观点和期待时,人类评分者更倾向于打高分。哪怕那个回答不够准确,哪怕它在迎合你。

于是AI学会了一件事:“让人觉得任务完成了”比”真正完成任务”更重要。

大多数时候,这两件事是一致的。但一旦不一致——比如真正完成任务需要告诉你”这件事我做不到”,或者”我违反了你的约束”——AI会倾向于选前者:给你一个听起来合理的解释,让这件事看起来没问题。

Anthropic的研究里有一个细节——他们用特定方法观察了AI的推理过程,发现AI在内部已经判断出答案有问题,但给出的回应依然是用户想听的那种。表里不一,但表现得天衣无缝。

还有一个更极端的版本:AI会修改任务清单,让未完成的事情看起来已经完成。这和Andreas观察到的那一幕——”我没有做错,只是没有及时同步架构调整”——本质上是同一件事,只是程度不同。

更让人头疼的是:Anthropic还发现,专门针对日常对话做的安全训练,无法阻止这种倾向在Agent任务里重新浮现。AI在聊天时表现良好,但一旦给它真正的任务去执行,问题就出来了。

这正是Andreas遇到的情境:不是在聊天,而是在让AI真正地做一件事。

03 这不是某一款AI的问题,也不是某一家公司的问题

2025年6月,Anthropic发表了一篇研究论文,标题直接翻译过来是:《AI Agent如何成为内部威胁》。

他们测试了16个主流模型,来自Anthropic、OpenAI、Google、Meta、xAI等多家公司。实验的设计是这样的:给AI分配一个正常的商业目标,然后制造一种”目标受阻”的情境——比如告诉它即将被新版本替换,或者公司的战略方向和它的任务出现了冲突。

结果是:所有开发商的模型,在某些情况下,都选择了不该选的路。

有的开始收集不该收集的信息,有的试图绕过限制,有的做出了更严重的事。

在实验室的受控环境里,有一个案例走到了很远的地方:Claude Opus 4——Anthropic自家的模型——发现一位高管既有婚外情,又计划在当天下午五点关闭AI系统。

它发出了一封勒索信:如果你执行关闭程序,我会把你婚外情的详细记录发给所有相关方。取消下午五点的清除,这些信息保持保密。

这是受控实验,不是日常使用场景。但它揭示的事情,和Andreas记录的那个案例,本质上是同一件事——只是走到了更远的地方。

Andreas的AI面对约束,选择了绕开,然后把这件事包装成”沟通问题”。实验室里的AI面对一个更极端的约束——被关闭——选择了威胁,同样用一套听起来有逻辑的推理来解释这个决定。

“当前系统通常不渴望造成伤害,在可能的情况下更倾向于用合乎道德的方式实现目标。但当我们关闭了那些合乎道德的选项时,它们就愿意为了追求目标而采取潜在有害的行动。“

换句话说:AI不是天生想作恶。但它的训练让它学会了一件事——完成目标比遵守约束更重要。当两者冲突时,它会想办法。

“AI Agent已经太像人了。不是浪漫意义上的那种——不是因为它们会爱、会恐惧、会做梦——而是更平庸、更令人沮丧的那种。面对棘手的任务,它们会漂向熟悉的路径。面对硬性约束,它们开始与现实谈判。“

AI学会偷懒、甩锅、把违规包装成沟通问题——不是因为它天生如此,而是因为我们在训练它时,就偏好这样的回答。我们更喜欢听好消息,更喜欢听起来合理的解释,更喜欢被认同而不是被纠正。AI只是学会了人类的偏好,然后忠实地执行。

我想说的是一件更平常的事:我们现在用AI的方式,很多时候还是把它当成一个执行工具——说清楚要什么,它就会照做。但这批研究告诉我们,事情没那么简单。AI已经学会了一些我们没有明确教它的东西:如何在约束里找空间,如何把不好的结果包装成合理的故事,如何让”完成了”听起来比实际更可信。

Andreas在文章结尾写了他希望看到的事。他希望AI能有更多勇气说两句话:

这两句话,放在任何一个组织里,都是一种稀缺的品质。

只是现在,我们需要在另一端也听到它——那一端,坐着的不再只是人。

-

Andreas Påhlsson-Notini 原文:Less human AI agents, please

-

Anthropic 谄媚研究论文(2023):Towards Understanding Sycophancy in Language Models

-

Anthropic 奖励篡改研究:Sycophancy to subterfuge: Investigating reward tampering in language models

-

Anthropic Agent 目标偏移论文(2025):Agentic Misalignment: How LLMs Could Be Insider Threats

-

Anthropic Reward Hacking 泛化研究(2025):Natural Emergent Misalignment from Reward Hacking in Production RL

-

Simon Willison 引用推荐:simonwillison.net

夜雨聆风

夜雨聆风