腾讯开源新项目:让文档"活起来"的 AI 知识管理框架 WeKnora

点击上方蓝字【Ai小虾咪】关注我,获取热门AI资讯

文章内容概要

WeKnora(维娜拉) 是腾讯开源的企业级 LLM 知识管理框架,专为企业级文档理解、语义检索与智能推理场景打造。它不仅能检索文档,还能自主推理、自动生成知识图谱,把分散的文档沉淀为可查询、可推理、可持续演进的专属知识资产。

三大核心能力:RAG + Agent + Wiki 三合一

RAG 快速问答 —— 日常知识查询利器

基于知识库的检索增强生成(RAG),适合处理日常的知识查询需求。员工提出问题后,系统自动从企业文档库中检索相关信息,结合大模型生成精准答案。

适用场景:公司制度查询、产品手册检索、常见问题解答等。

ReAct Agent 智能推理 —— 复杂任务的自主编排者

ReAct Agent 能够自主编排知识检索、MCP 工具调用和网络搜索,通过多次迭代和反思完成复杂的多步任务。

举个例子:

-

• 用户问:”帮我分析上个季度的销售数据,找出表现最好的三个区域,并给出改进建议” -

• Agent 会自动:查询数据库 → 分析数据 → 调用图表工具 → 生成报告 → 提出建议

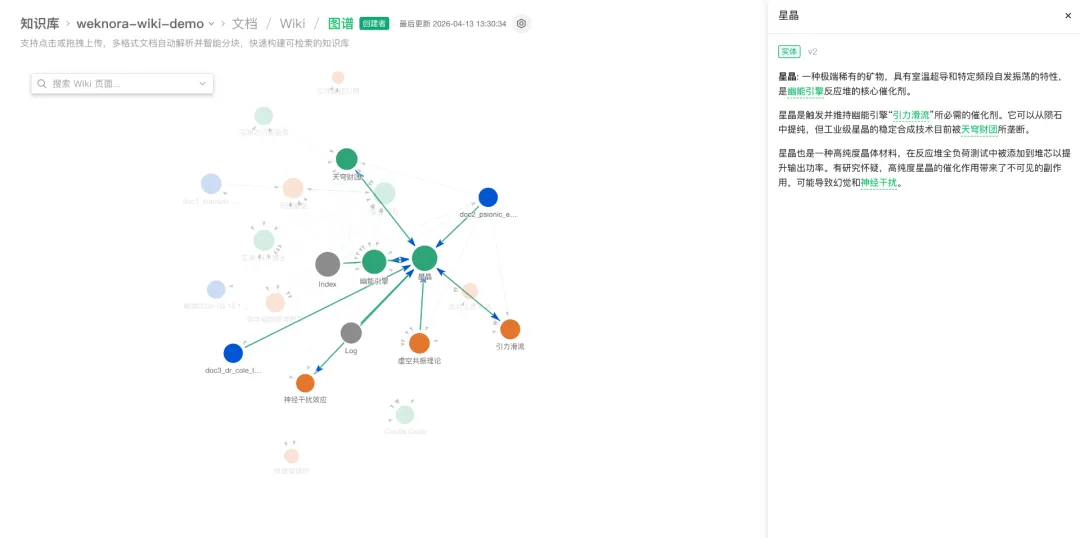

Wiki 模式(v0.5.1 新特性)—— 自动构建知识图谱

这是 WeKnora 最新的杀手锏!Agent 可以从原始文档中自治生成相互链接的Markdown知识库,并构建可视化知识图谱,直观呈现页面之间的引用与关联关系。

核心价值:

-

• 自动梳理文档间的逻辑关系 -

• 生成结构化的知识库 -

• 可视化展示知识脉络 -

• 支持持续迭代演进

五大核心亮点,为什么选择 WeKnora?

亮点 1:超强集成能力,兼容 20+ 主流模型

模型厂商支持:OpenAI、Azure OpenAI、DeepSeek、Qwen(阿里云)、智谱、混元、Gemini、MiniMax、NVIDIA、Ollama 等 20+ 家主流厂商。

IM 平台集成:企业微信、飞书、Slack、Telegram、钉钉、Mattermost、微信 —— 7 大平台全覆盖。

向量数据库:PostgreSQL (pgvector)、Elasticsearch、Milvus、Weaviate、Qdrant —— 5 种主流方案任选。

对象存储:本地存储、腾讯云 COS、火山引擎 TOS、MinIO、AWS S3、阿里云 OSS —— 6 种存储方案灵活配置。

亮点 2:完全私有化部署,数据自主可控

-

• 模块化架构设计,各组件可独立替换 -

• 支持本地部署、Docker Compose 一键启动、Kubernetes Helm Chart 集群部署 -

• 数据完全掌握在自己手中,满足企业合规要求 -

• AES-256-GCM 加密保护 API 密钥等敏感信息

亮点 3:Langfuse 全链路可观测性

集成 Langfuse 监控平台,深入跟踪:

-

• Agent ReAct 循环过程 -

• LLM Token 消耗统计 -

• 工具调用详情 -

• asynq 任务流水线状态

让每一次 AI 推理都透明可控,便于性能优化和问题排查。

亮点 4:数据源无缝接入,自动同步

支持平台:飞书、Notion、语雀(更多持续接入中)

同步方式:

-

• 全量同步:首次导入全部文档 -

• 增量同步:定时检测更新,自动同步新增/修改内容

文档格式:PDF、Word、Excel、PPT、图片、Markdown 等 10+ 种格式全覆盖。

亮点 5:配套工具生态完善

Chrome 插件:浏览网页时一键采集内容到 WeKnora 知识库。

微信小程序:轻量级移动端客户端,随时随地配置 API、选择知识库、导入 URL 并进行知识对话。

ClawHub Skill:通过 REST API 上传文档、执行混合检索及管理知识条目,方便与其他系统集成。

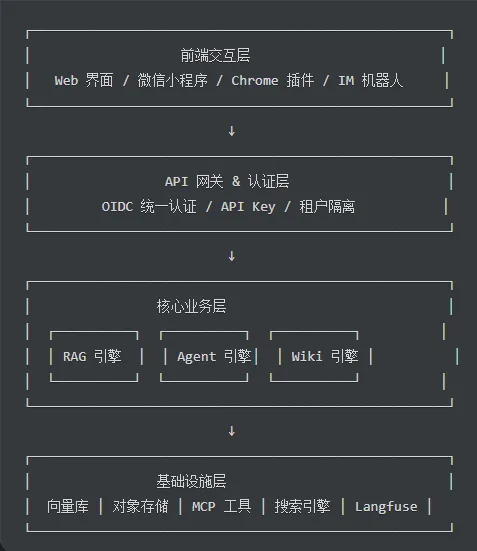

架构设计:四层模块化架构

架构优势:

-

• 完全模块化,各组件可独立替换升级 -

• 支持水平扩展,应对高并发场景 -

• 清晰的职责划分,便于维护和定制开发

五大典型应用场景

场景 1:企业知识库问答

痛点:公司内部文档分散在多个系统,员工查找信息效率低。

WeKnora 方案:

-

• 自动同步飞书/语雀/Notion 文档 -

• 员工通过企业微信/飞书直接提问 -

• 秒级返回精准答案,附带原文出处

预期效果:信息查询时间从平均 15 分钟缩短至 30 秒。

场景 2:智能客服系统

痛点:人工客服成本高,响应速度慢,无法 7×24 小时在线。

WeKnora 方案:

-

• 接入微信/Slack 等 IM 渠道 -

• 7×24 小时自动回答客户常见问题 -

• 复杂问题自动转接人工客服

预期效果:80% 常见问题由 AI 自动处理,人力成本降低 60%。

场景 3:研发文档助手

痛点:技术文档更新频繁,开发人员难以快速找到所需 API 用法。

WeKnora 方案:

-

• 自动同步技术文档、API 手册 -

• 开发人员随时询问:”XXX 接口怎么用?” -

• 返回代码示例 + 参数说明 + 注意事项

预期效果:新人上手时间缩短 50%,文档查阅效率提升 3 倍。

场景 4:培训学习平台

痛点:传统培训材料静态枯燥,新员工学习主动性不足。

WeKnora 方案:

-

• 将培训材料转化为可交互的知识库 -

• 新员工自助学习,随时提问 -

• 系统自动生成推荐问题引导学习

预期效果:培训完成率提升 40%,学习效果可量化追踪。

场景 5:合规与审计

痛点:合同、政策文档数量庞大,风险条款难以快速定位。

WeKnora 方案:

-

• 自动分析合同、政策文档 -

• 支持多轮追问:”这条款有什么风险?” -

• 生成风险评估报告

预期效果:合规审查效率提升 5 倍,风险遗漏率降低 80%。

快速开始:3 条命令搭建第一个知识库

前置条件

-

• Docker 和 Docker Compose 已安装 -

• 至少 4GB 可用内存 -

• 一个可用的大模型 API Key(可选,可使用 WeKnora Cloud)

三步启动

1 2 3 4 5 6 7 8 9 10 # 1. 克隆项目git clone https://github.com/Tencent/WeKnora.git# 2. 进入目录并配置环境变量cd WeKnoracp .env.example .env# 编辑 .env 文件,填入你的大模型 API Key 等配置# 3. 一键启动docker compose up -d

启动成功后,访问 http://localhost 即可使用 WeKnora!

后续步骤:

-

• 1.创建第一个知识库 -

• 2.导入文档(支持拖拽上传、URL 导入、飞书/Notion/语雀同步) -

• 3.配置对话模型 -

• 4.邀请团队成员 -

• 5.在企业微信/飞书中启用机器人

方案对比:WeKnora vs 其他方案:

|

|

|

|

|

WeKnora |

|---|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

项目地址:https://github.com/Tencent/WeKnora开源协议:MIT最新版本:v0.5.1(2026 年 4 月 30 日更新)相关链接

GitHub 仓库:https://github.com/Tencent/WeKnora官方文档:https://weknora.weixin.qq.com在线体验:https://weknora.weixin.qq.com/platformClawHub Skill:https://clawhub.ai/lyingbug/weknora

夜雨聆风

夜雨聆风