AI 已经开始自己做科研了?Nature 这篇论文有点震撼

Towards end-to-end automation of AI research

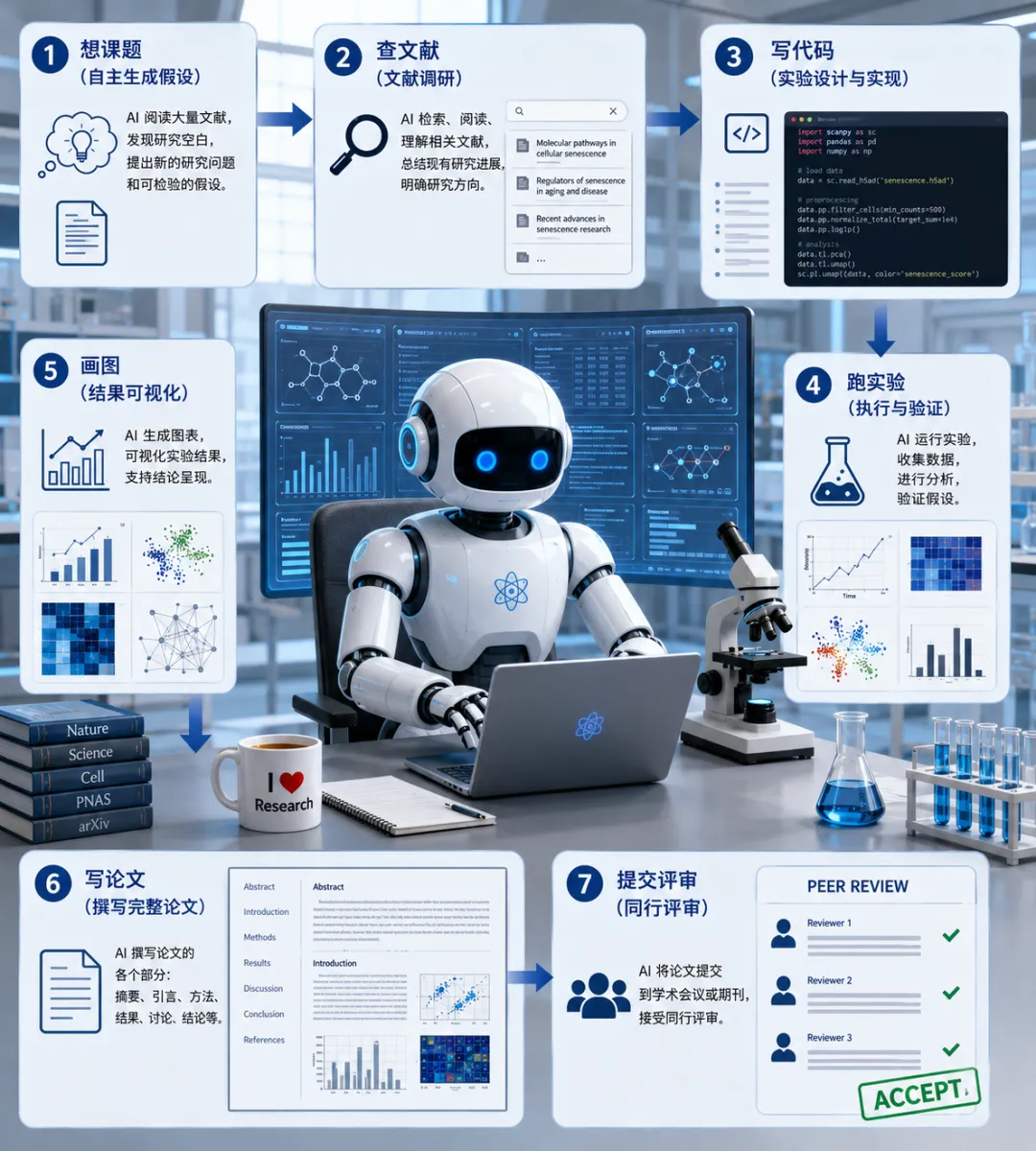

如果有一天,一篇论文不是人类研究者写的,而是 AI 自己想题目、查文献、写代码、跑实验、画图、写论文,最后还送去同行评审,你会觉得这是科幻吗?

论文提出了一个系统,叫 The AI Scientist。它不是普通的论文润色工具,也不是帮你写几行代码的助手,而是试图自动完成一整套科研流程。

自己想课题,自己做实验,自己写论文,自己接受评审。

一、它不是帮人写论文,而是自己走完整个科研流程

以前我们说 AI 辅助科研,通常是帮一个小环节。比如帮你查文献、写代码、润色论文、总结实验结果。

但 The AI Scientist 不一样。它做的是把这些环节全部串起来:

提出研究想法 → 查文献判断新不新 → 写实验代码 → 跑实验 → 画图 → 分析结果 → 写成论文 → 自动审稿。

这就不是“AI 帮我写一段内容”,而是 AI 尝试自己完成一篇研究论文的生产过程。

二、最有冲击力的案例:AI 论文真的去参加了同行评审

这篇论文里最震撼的案例,是作者真的把 AI 生成的论文拿去投稿了。

他们让 The AI Scientist 自动生成了 3 篇机器学习论文,然后提交到 ICLR 2025 的一个工作坊进行盲审。

ICLR 是机器学习领域的重要顶会。虽然工作坊门槛比主会低,但它依然是真实的同行评审流程。

评审人知道里面可能有 AI 生成论文,但不知道具体哪一篇是 AI 写的。

结果怎么样?

3 篇 AI 论文里,有 1 篇拿到了 6、7、6 的评审分数,超过了该工作坊的平均接收线。也就是说,如果不是研究者事先规定“AI 论文无论结果如何都要撤回”,这篇论文很可能会被接收。

这个案例真正值得关注的地方,不是 AI 写了一篇文章。而是它写出了一篇包含研究问题、实验代码、结果图表和论文结构的完整研究论文,并且经受住了真实同行评审的第一轮检验。

三、这篇 AI 论文研究了什么?

那篇差点被接收的 AI 论文,研究的是一个机器学习问题:

有些看起来能提升神经网络泛化能力的方法,实际效果可能并不好。

这类论文叫“负结果论文”。什么叫负结果?通俗说,就是告诉大家:这个方法我们试了,没那么有效。

很多人以为科研论文都要提出一个特别厉害的新方法,但其实负结果也很重要。因为它能告诉后来的人:这条路可能走不通,不要重复踩坑。

有意思的是,这篇 AI 生成论文刚好符合那个工作坊的主题:研究那些“本以为能让深度学习变好,但结果并没有明显变好”的方法。

也就是说,AI 不是随便编了一篇论文,而是对准了投稿场景,写出了一篇主题匹配的论文。

四、案例2:AI 自己设计实验,还会不断修改路线

The AI Scientist 研究了一个问题:模型为什么会依赖捷径特征?什么叫捷径特征?举个简单例子。

假设你训练一个模型识别水鸟。正常来说,模型应该看鸟的形状、羽毛、嘴巴和翅膀。但如果训练数据里,大多数水鸟都出现在水面背景中,模型可能会偷懒。

它不是真的学会了识别水鸟,而是学会了:看到水面,就猜是水鸟。这就是捷径学习。

The AI Scientist 就围绕这个问题自动设计实验。它先构造带颜色偏差的数据集,让模型容易依赖颜色这种“捷径”;然后继续调参数、修代码、换数据集、加入新实验,最后做消融分析,判断哪些因素真的有用。

这个过程很像一个研究生在实验室里反复试错:

第一版不行,就改代码。结果不稳定,就调参数。结论不清楚,就补实验。最后再把实验整理成论文。区别是,这些步骤是 AI 自动完成的。

五、它还做了一个“AI 审稿人”

这篇论文还有一个关键设计:Automated Reviewer,也就是自动审稿人。它会像机器学习会议审稿人一样,对论文进行评价:

这篇论文可靠吗?实验充分吗?方法有贡献吗?表达清楚吗?最后应该接收还是拒稿?作者还用真实 ICLR 论文数据测试这个自动审稿人,发现它和人类审稿人的判断一致性接近。

AI 还不是伟大科学家,但它已经像一个初级研究者了

当然,这篇论文并不是说 AI 已经可以取代科学家。论文也承认,The AI Scientist 还有很多问题:有些想法比较幼稚,代码可能出错,实验设计不够严谨,论文里可能出现幻觉引用,生成论文的质量也还达不到顶级会议主会标准。

而且,它目前主要适合机器学习这类可以在电脑上完成实验的领域。像医学实验、社会调查、田野研究、复杂理论创新,还远远不是它能独立完成的。但这篇论文真正重要的地方在于,它展示了一个趋势:

AI 正在从“科研辅助工具”,变成能够串联完整科研流程的智能体系统。

夜雨聆风

夜雨聆风