LoRA下载使用-comfyUI图文教程11

LoRA 模型(Low-Rank Adaptation) 是一种用于微调大型生成模型(如 Stable Diffusion)的高效技术。 它通过在预训练模型的基础上引入可训练的低秩矩阵,仅调整部分参数,而非重新训练整个模型,从而以较低的计算成本实现特定任务的优化,相对于类似 SD1.5 这样的大模型,LoRA 模型更小,更容易训练。

https://docs.comfy.org/zh/tutorials/basic/lora

-

大白话就是,别人训练好的模型,你可以拿来用!

-

当然只针图片生成,也就是文生图、图生图

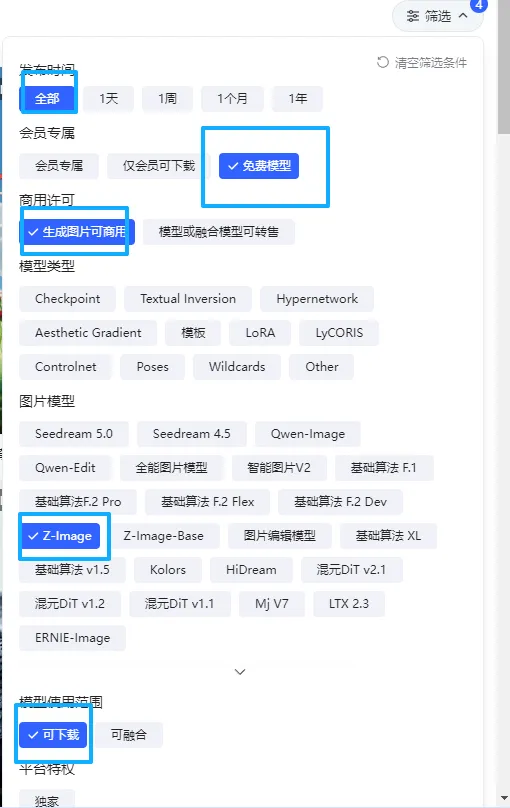

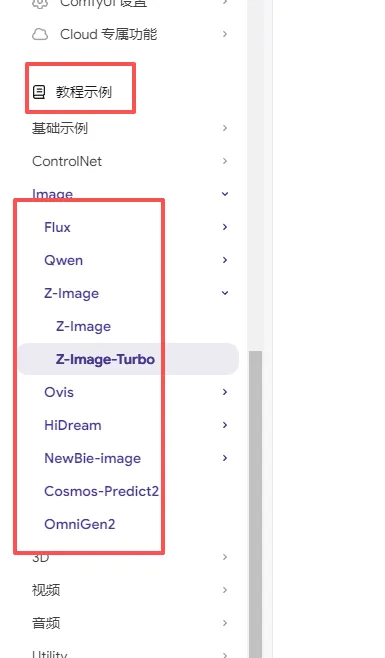

图片类的模型很多我列出些

Seedream 5.0,Qwen-Edit,基础算法F.2 Pro,Seedream 4.5,Qwen-Image,智能图片V2,基础算法F.1,基础算法F.2Flex,基础算法F.2Dev,VZ-Image,基础算法v1.5,混元DT v1.2,Z-Image-Base,Kolors,混元DiTv1.1,基础算法XL,HiDream,MjV7,混元DiT v2.1,LTX 2.3,ERNIE-Image….

-

我之前一直以为只能在平台上运行

-

直到我有了lora的概念后

-

原来,就是接了一个别人预设的参数罢了(无意冒犯,这样说比较好理解)

-

直接演示吧。比较好理解

-

下载LoRA文件:前往LiblibAI、吐司等平台,筛选免费+可商用模型(注意Flux1/Flux2对应关系),下载

.safetensors文件放入\models\loras\目录,并记录搭配的基础模型。 -

获取并准备基础工作流:从ComfyUI官网或平台下载对应模型的工作流(

.json文件),拖入ComfyUI界面后先保存。遇到模型报错或忘记目录,参考基础合集教程。下载模型后按Ctrl+R刷新,无需重启。 -

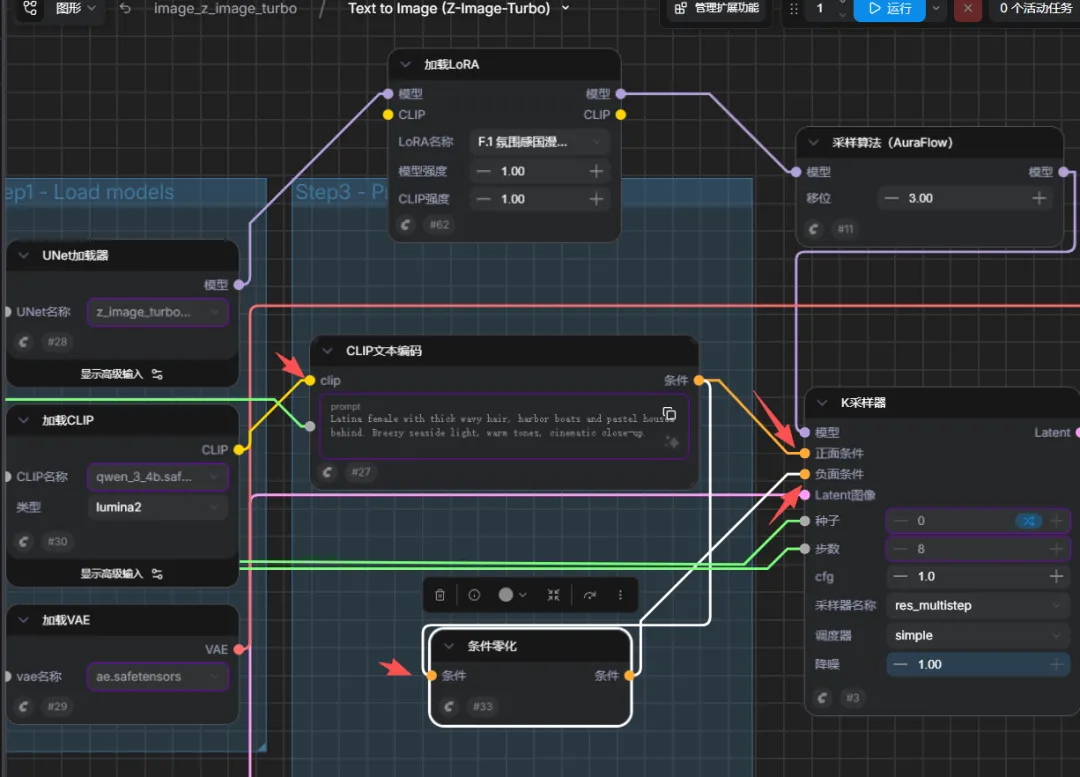

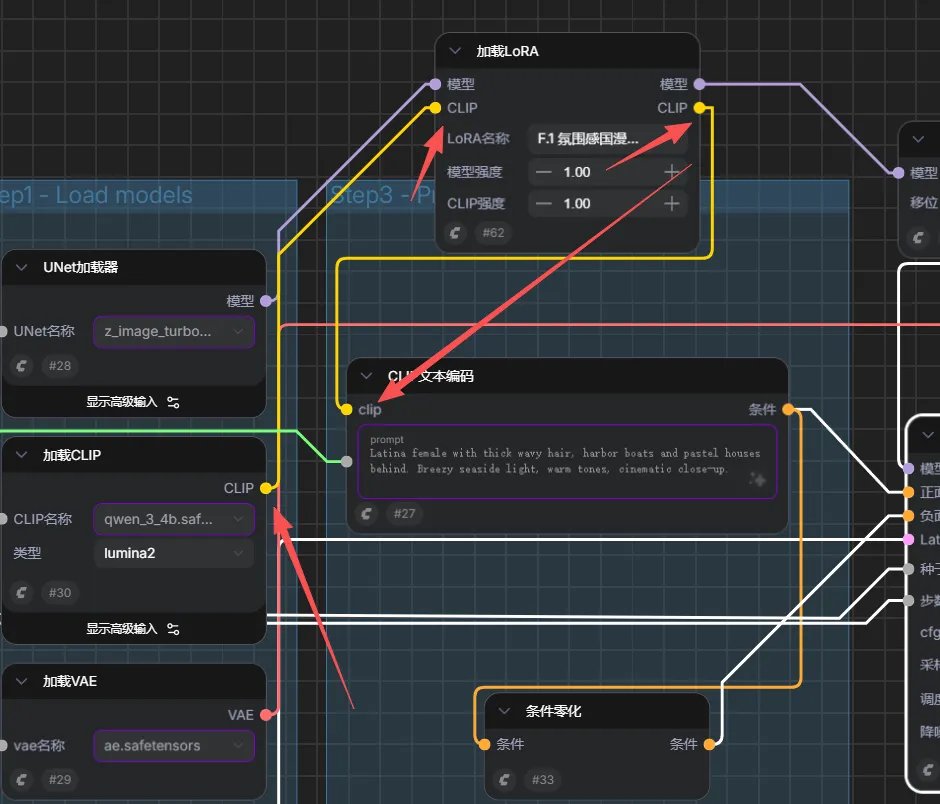

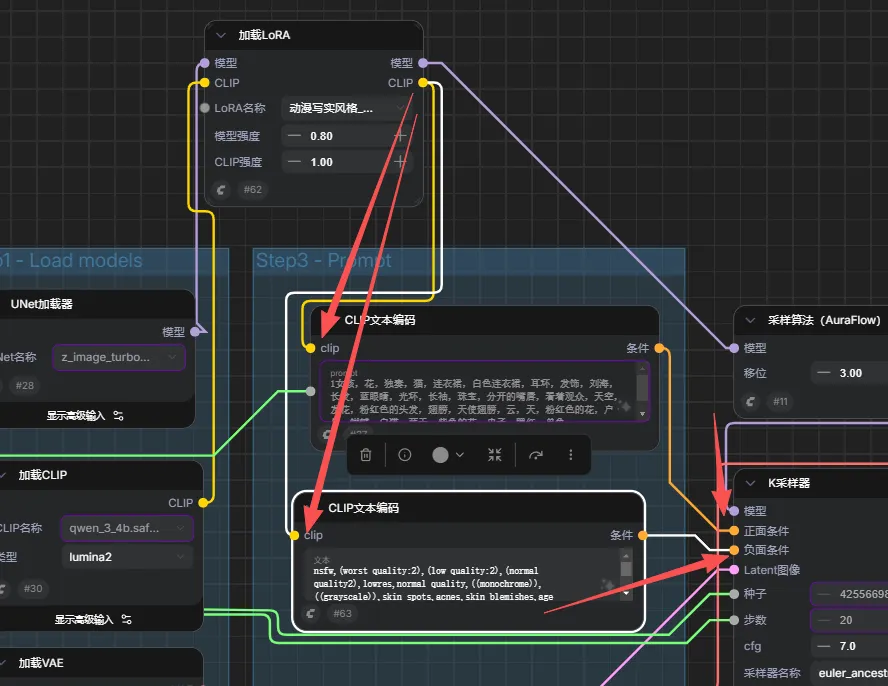

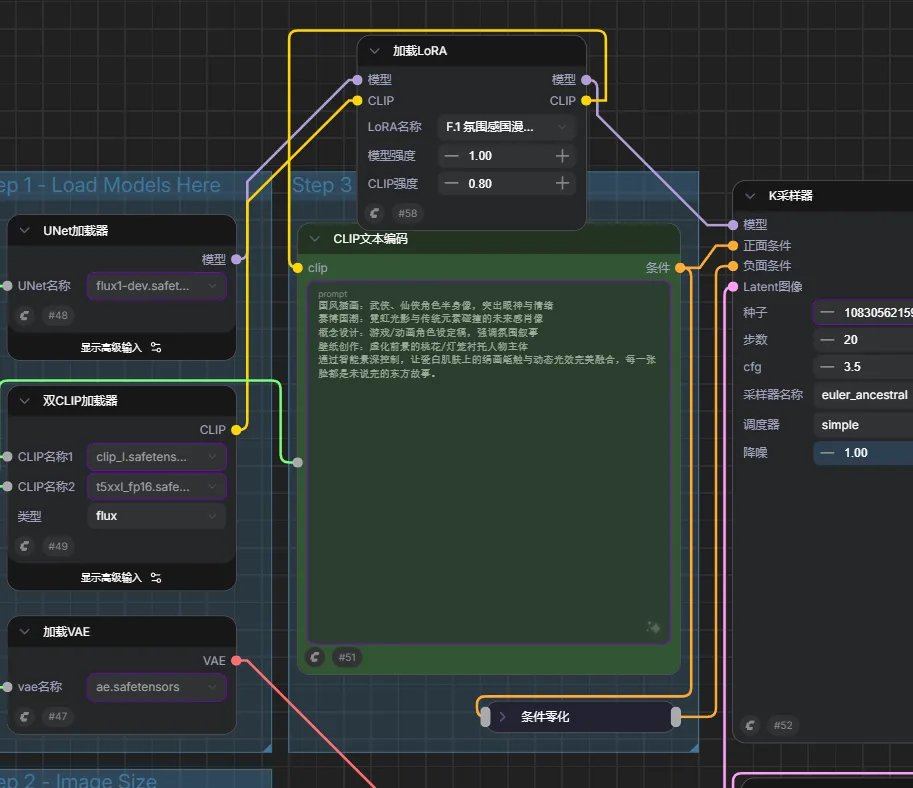

插入LoRA节点并连接:在工作流中拖入“加载LoRA”节点,将其串联在主模型之后(主模型→LoRA→采样器)。将clip输出分别接入正/负提示词(若无负向提示词节点,可自行复制一个)。

-

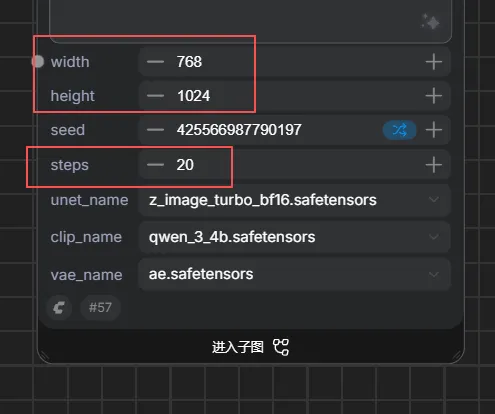

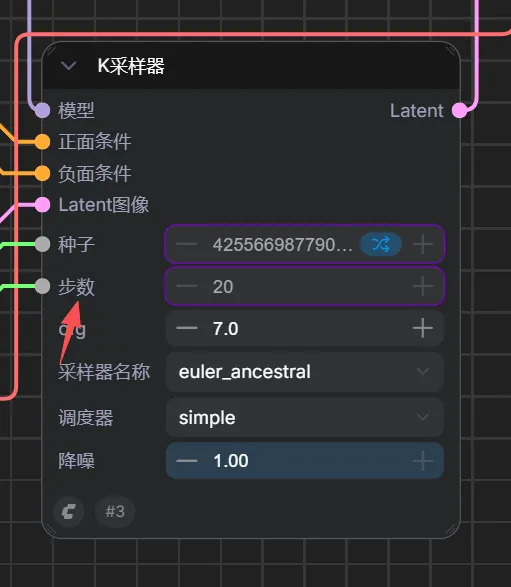

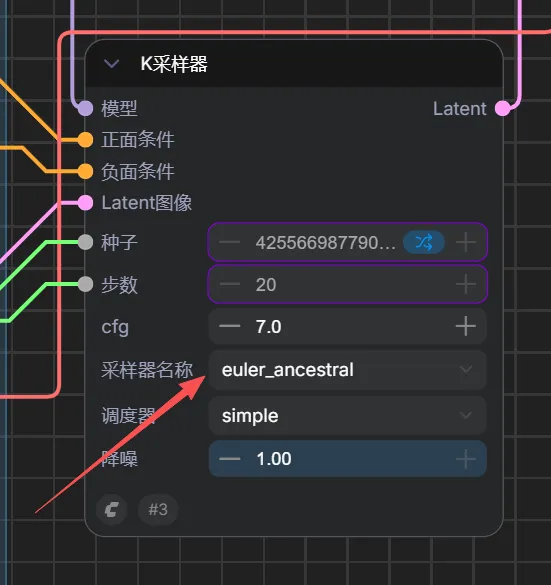

设置参数并运行:调整LoRA权重(如0.8)、采样器cfg(如7)、采样方法(如Euler a),确认宽高和步数(一般在子工作流或采样器上)。保存后点击运行即可。切换不同模型时,先下载其所需的配套模型和工作流。

目前可以下lora的平台很多

-

LiblibAI-哩布哩布AI https://www.liblib.art/

-

吐司 https://tusi.cn/

-

https://civitai.com/models (要魔法)

-

https://tensorhub.art/ (要魔法)

你自己问下ai可以找到很多。

我教你怎么在你自己工作里怎么用别人的lora

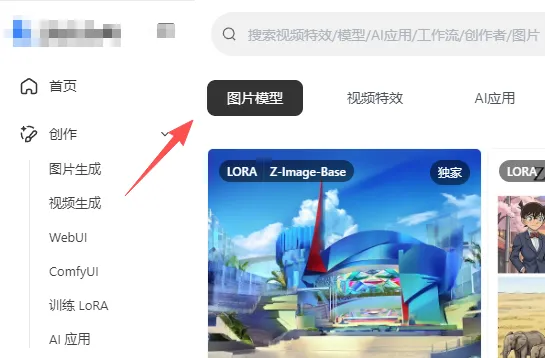

你网上找到一个lora平台,后先选到图片模型这一栏选显卡

切记 右侧这边是可以筛选模型的

-

要选免费的,毕竟我们是测试

-

可商用的

-

然后看你本地有哪个模型,你筛选下,

-

顺带一提,哪个f.1哪个就是Flux 1, f.2 就是Flux2 (这里我是这么理解了,也试了貌似是对的,你们自行查证)

-

然后几的勾选可下载的

-

我拿z-image举例

-

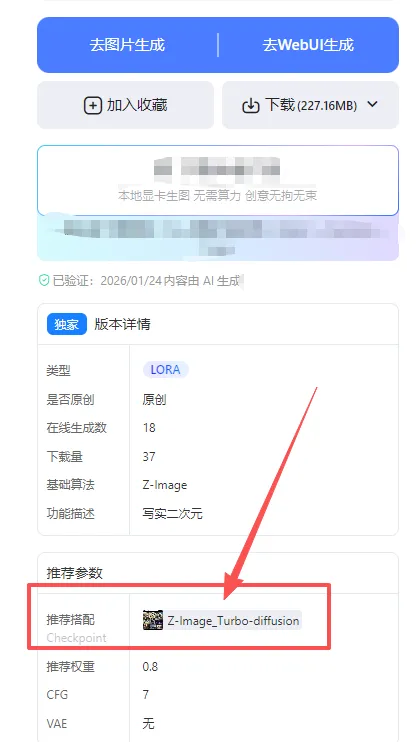

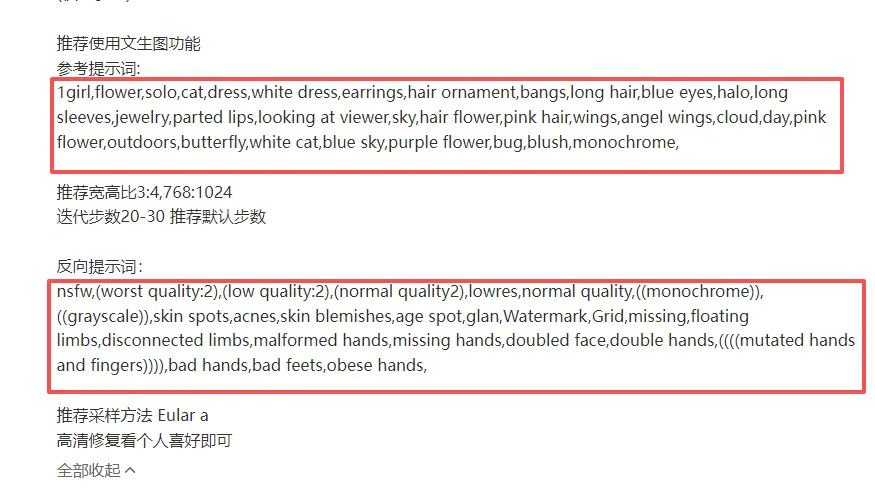

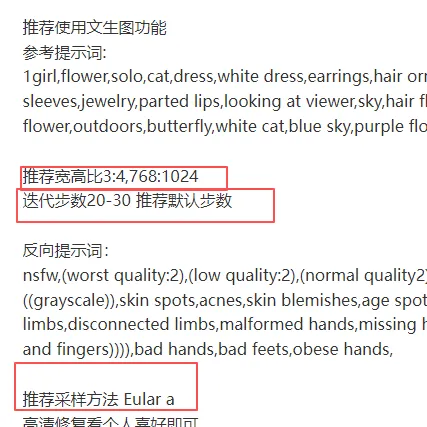

我选中一个喜欢的模型后,点进去右侧正常都是下图这样的

-

先点击下载(你下载的就是.safetensors格式的lora了)

-

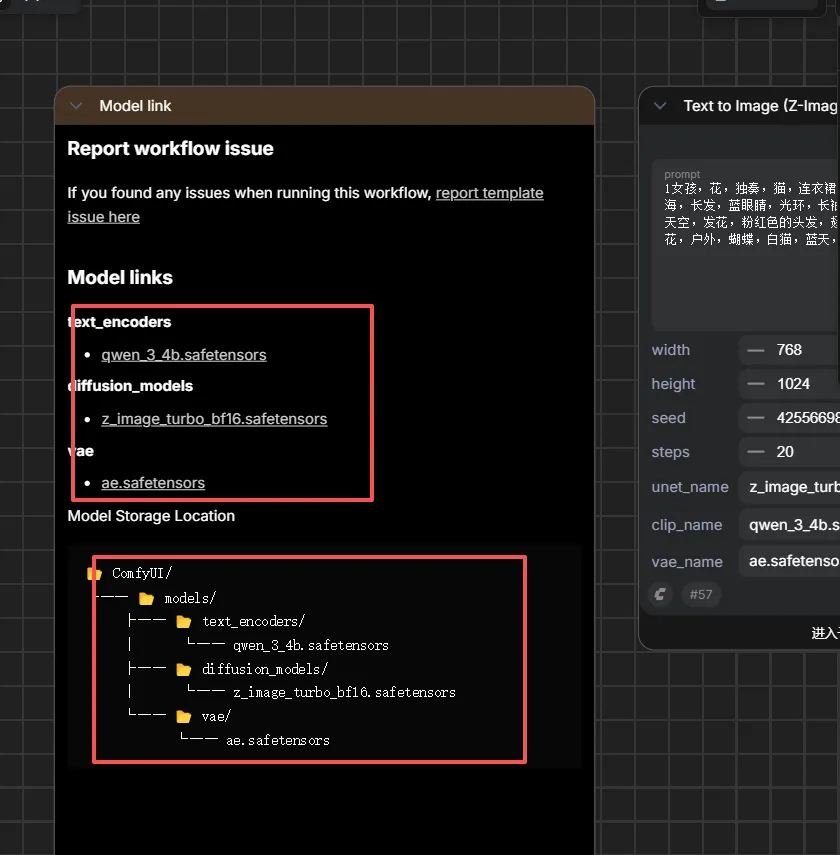

放在\models\loras\这个目录下

他下面有搭配的模型,你先知道是啥,记录下

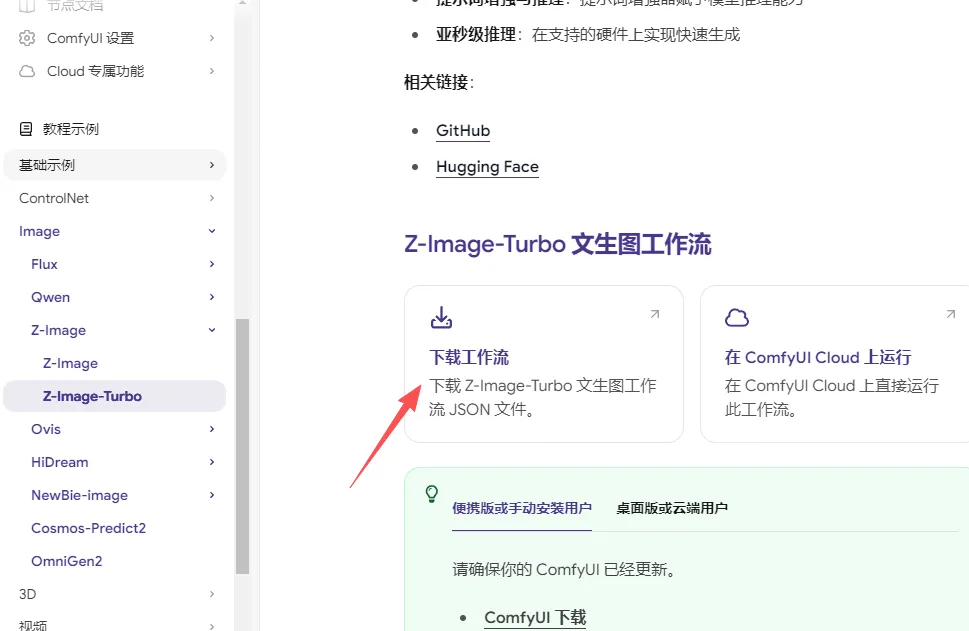

你可以在comfyui的模版管理找到模型对应的案例,如果没有对应的,你要到网上去找下工作流,

其实文生图、图生图 demo是很简单的 comfyui的官网是都有下载demo的地方。

comfyui官网:

https://docs.comfy.org/zh/tutorials/image/z-image/z-image-turbo

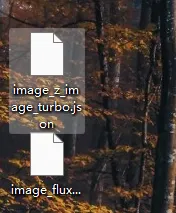

你点下去他是网页的,右键网页另存为到桌面他是.json格式

-

这个就是工作流了,你拖动进来comfyui工作流界面后记得先保存下。

-

下载和放哪个文件夹官方demo基本都是有写,你要是忘记了,去看我这篇=>下载模型models、工作流、解决报错报红

-

你得先保证你基础的工作流demo跑的通

-

下载完模型后有小伙伴说他每次都得关了comfyui在打开

-

没必要的

-

你直接ctrl+r刷新下就好!(技术点,笔记要做!!!)

好,上面这些步骤你会卡到的话,你就去把我最上面那个合集全部通关一遍。

-

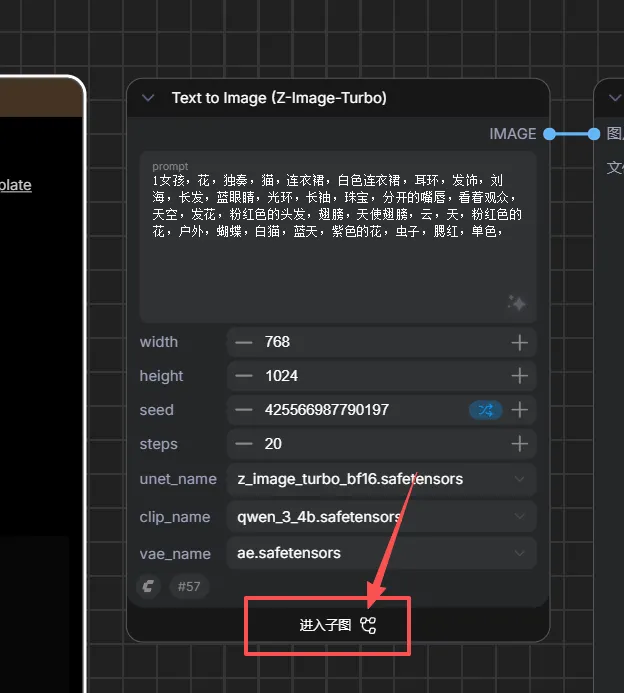

点击子圈

-

我们要进去加个lora

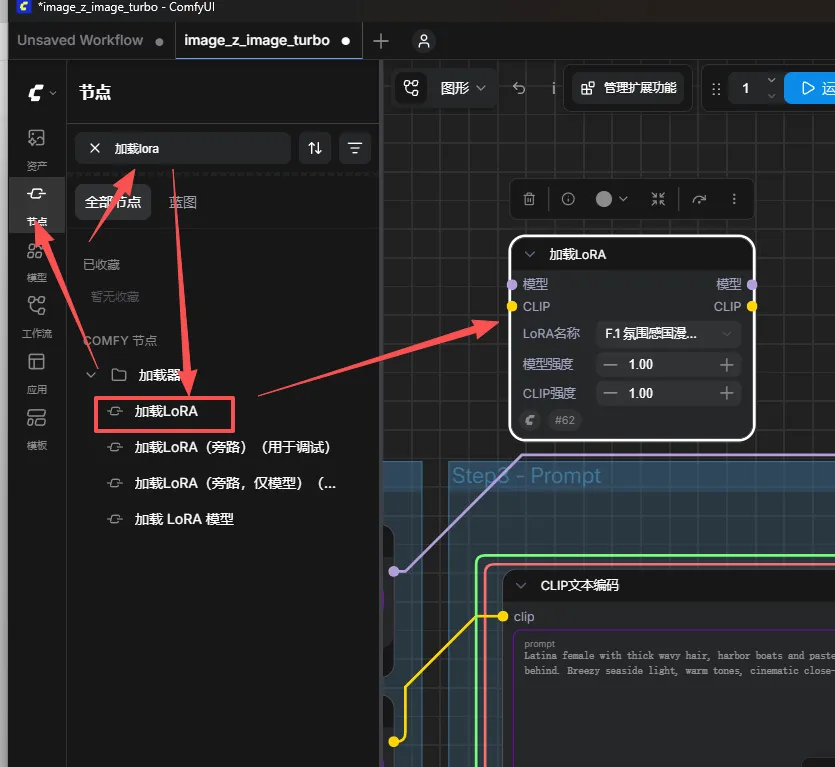

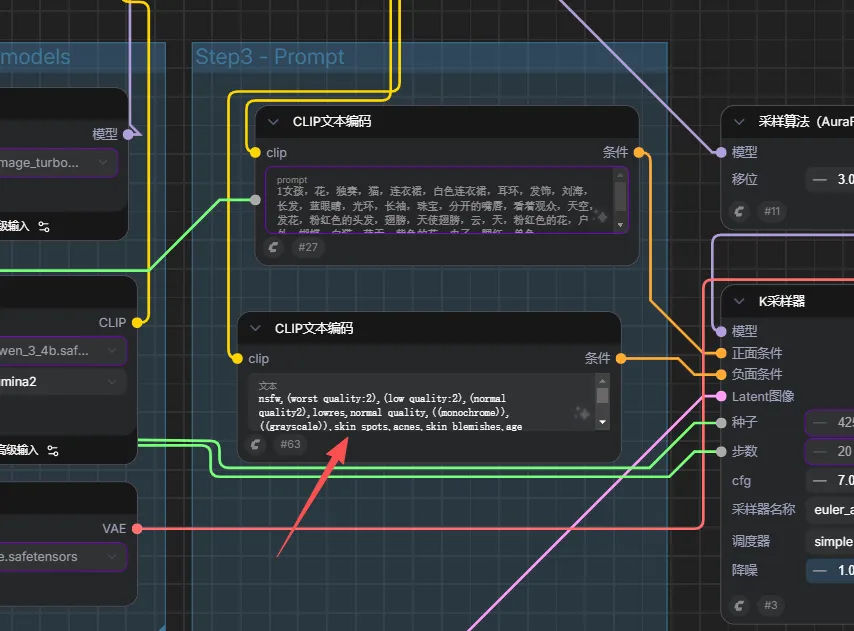

节点里面搜 加载lora 这个节点拖动到工作流

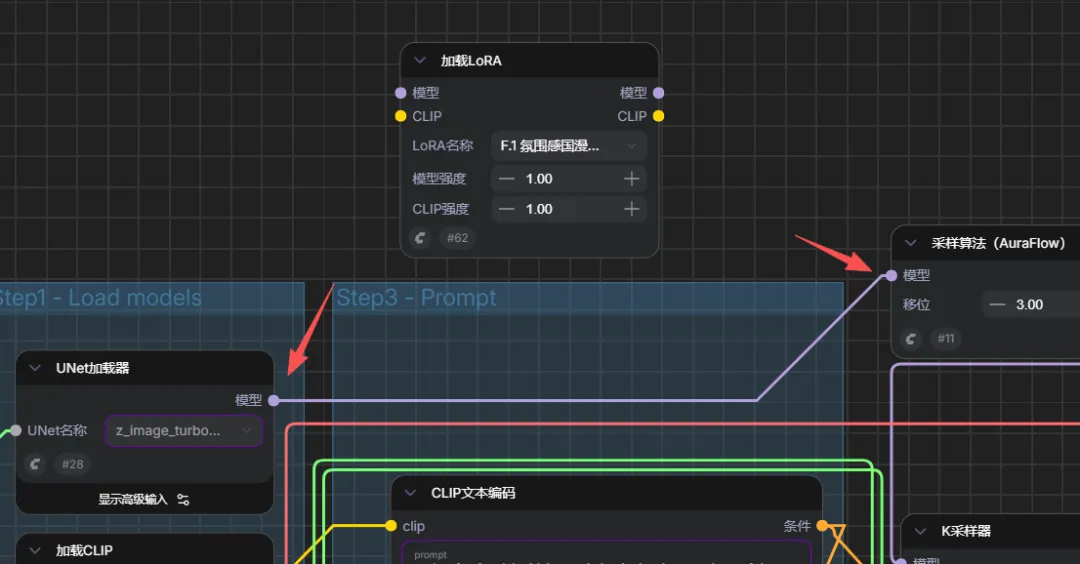

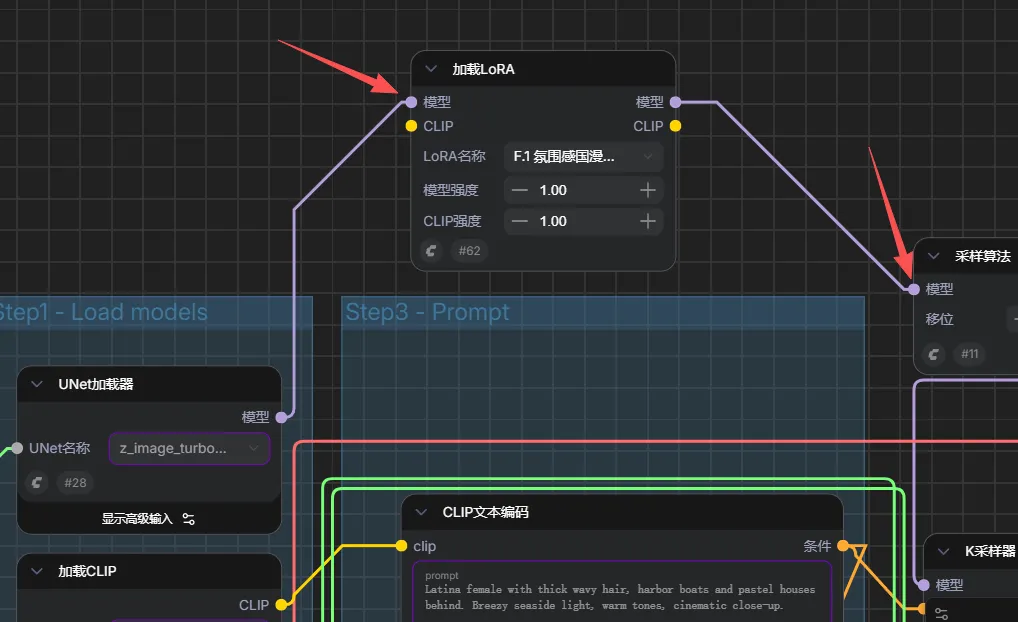

你看他主模型连哪里,就先给他连到lora,

语言模型也就是处理 正提示词、反提示词这个(他有些模型demo不需要反提示词,所以接了个处理为0的条件节点)

你要是看不习惯你就给他复制一个提示词框 接一个负向提示词,

然后从lora的clip出来分别接正、负提示词,在去接k采样器。

-

好现在你成功了。

-

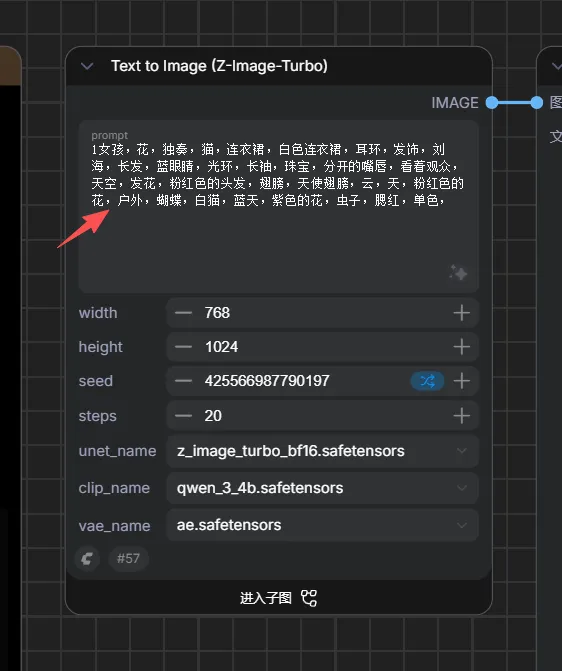

我们开始参数要输入什么

-

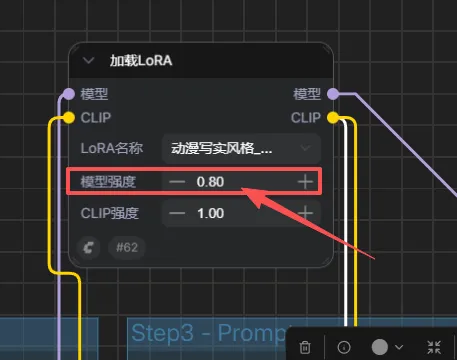

权重指的是lora的权重

-

也就是模型强度,调0.8

-

cfg是k采样器的cfg参数 7

然后文中会提到正向和方向提示词,放哪里这个我就不用多说了吧

一个是在主工作流

如果没有暴露出来的话,一个在子工作流 图像里面

-

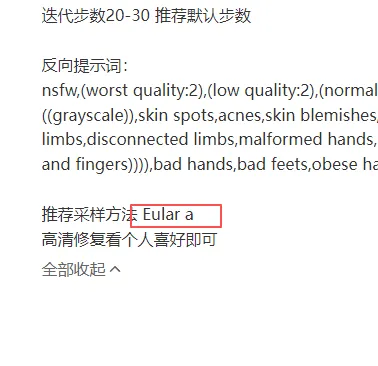

他就提到一个Eular a,估计是写错了,应该是euer_a -

你点k采样器的 采样器名称里面下拉看哪个看起来像就是了 -

保存 -

运行 -

撒花 -

三连,这就不用我教了吧

-

其实最主要的不是你本地有啥模型你去找网上有哪些模板

-

而是你看网上哪些你中意的模板,在去下他运行需要的模型。

雪狼之夜ps:既然都看到这行了,不如给个3连,亲~~~

☟

夜雨聆风

夜雨聆风