这是一篇写给即使完全没有编程经验的小白也能轻松入门OpenClaw的文章。我将一步一步拆解OpenClaw的配置,你不需要先懂代码,这里帮你一步步拆解OpenClaw安装向导,只要按顺序做,就能先把 OpenClaw 在本机网页里跑起来,安装必要技能,再继续接入飞书、企业微信、钉钉、QQ 机器人,以及教你如何部署接入本地模型。

先用一句话理解 OpenClaw

你可以把 OpenClaw 理解成:

一个装在你自己电脑或服务器上的“AI 总控台”。

它会做三件事:

接收消息(来自网页、飞书、企业微信、钉钉、QQ 等社交软件) 把消息交给你配置的模型处理(比如 OpenAI、Ollama、qwen、kimi) 把结果再发回去

所以你看到的很多名词,其实都很好理解:

CLI:命令行工具,也就是 openclaw这个命令Gateway:OpenClaw 的后台服务,相当于总控中心 Dashboard / Control UI:网页控制台 Channels:聊天渠道,比如飞书、企业微信 Plugins:给渠道或能力扩展用的插件 Skills:给 AI 增加“会做什么”的技能包 Model Provider:模型提供方,比如 OpenAI、Ollama

一、OpenClaw 部署安装基础版:先在网页里跑起来

这一部分最重要。

先不要着急接机器人,也不要着急上本地模型。对新手来说,最稳的目标只有一个:

先让 OpenClaw 在浏览器里成功打开并能聊天。

只要这一步成功,后面接飞书、企业微信、钉钉、QQ 都只是“往上加一层配置”。

1. 准备运行环境:安装 Node.js

OpenClaw 依赖 Node.js 运行。官方目前推荐 Node 24,同时兼容 Node 22 LTS(22.16+)。

你需要做什么

先检查电脑里有没有 Node:

node --version如果能看到版本号,说明已经安装了。如果提示命令不存在,就先去安装 Node.js。

小白怎么理解这一步

你可以把 Node.js 理解成:

OpenClaw 的运行底座。

没有它,就像没有地基,后面的命令都跑不起来。

2. 安装 OpenClaw

官方最推荐的方式是直接用安装脚本,它会自动处理:

Node 检测 OpenClaw CLI 安装 启动安装向导

macOS / Linux / WSL2

curl -fsSL https://openclaw.ai/install.sh | bashWindows PowerShell

iwr -useb https://openclaw.ai/install.ps1 | iex如果你已经自己管理好了 Node,也可以直接用 npm 安装

npm install -g openclaw@latest这一步到底装了什么?

这一步装的是 OpenClaw 命令行工具,也就是后面所有命令的入口。

安装完成后,你就能在终端里执行:

openclaw --help如果能正常显示帮助信息,说明 CLI 已经装好了。

3. 运行安装向导(最关键的一步)

安装完 CLI 后,继续执行:

openclaw onboard --install-daemon这一步是新手最关键的一步。--install-daemon 的作用就是把它安装成后台服务。这样哪怕你关掉终端,它也能继续工作。

很多人以为它只是“下一步、下一步”的向导,其实它会帮你完成:

初始化 OpenClaw 配置目录 配置认证信息 配置 Gateway 安装后台守护服务 生成网页控制台访问方式

也就是说:

这一条命令,才是真正把 OpenClaw“装成一个能长期运行的系统”。

4. 安装向导每一步是什么意思?

零基础读者最容易卡在这里,所以这里我拆开讲。

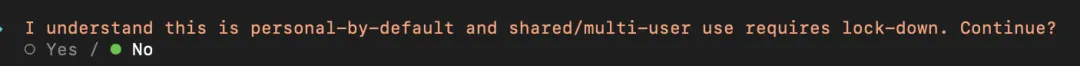

第一步

翻译一下:这个安装默认是给个人电脑用的;如果是多人共用机器,需要额外做安全加固。是否继续?

这里按键盘左键选择yes,然后回车进入下一步

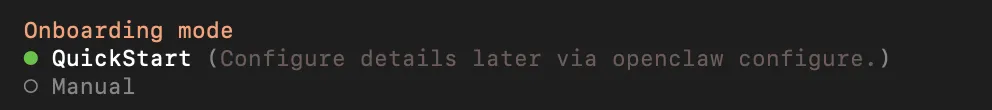

第二步

这两个选项可以这样理解:

QuickStart:适合小白、个人电脑、本机先用起来

Manual:适合你已经知道自己要改端口、改 bind、改认证策略,或者你准备部署到远程机器/多人环境

这里保持光标在 QuickStart,直接回车进入下一步

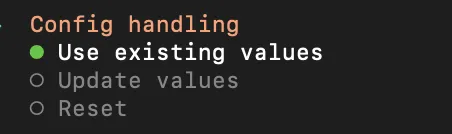

第三步

这里由于我已经安装过,~/.openclaw/openclaw.json,这里选 Use existing values,不会把现有配置清掉,第一次安装如果没有这个选项就略过,这里还是直接回车进入下一步

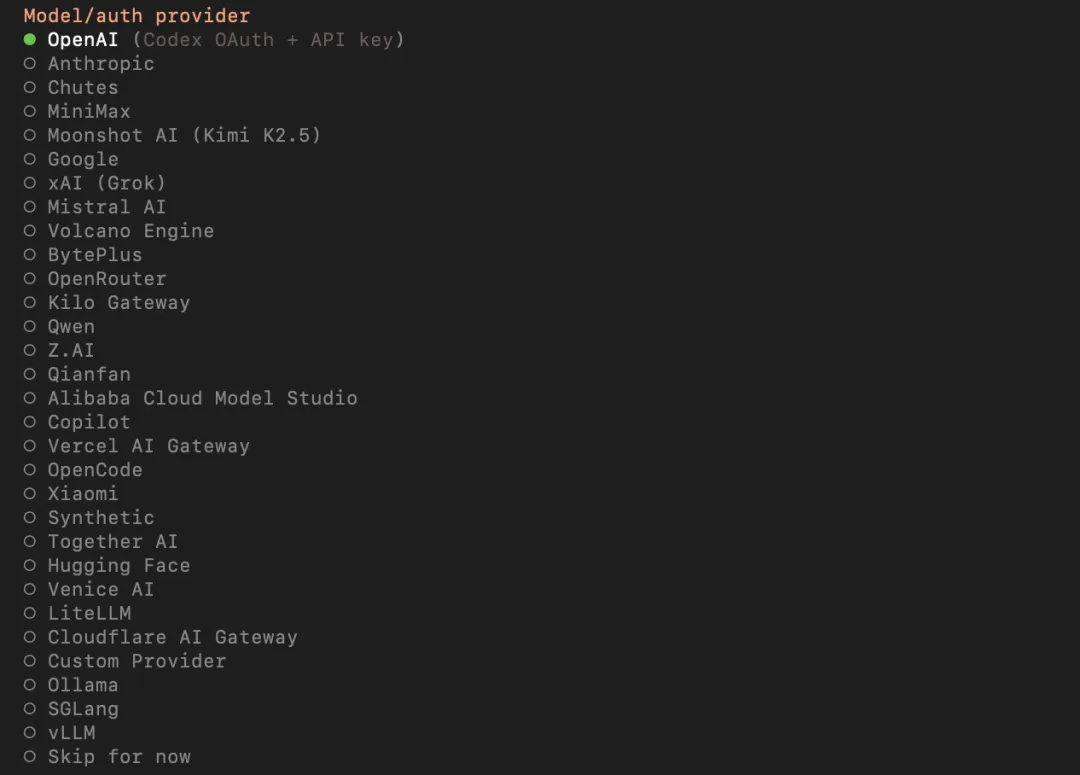

第四步

向导问你想先用哪种模型

新手建议这样理解:

云端模型:最省心,开箱即用 本地模型:更省钱,但配置会多一点,对电脑性能也有要求

建议: 第一次安装时,先用云端模型把系统跑通。等网页已经能聊天后,如果想用本地模型再切本地模型。

这样最不容易把自己卡住。

那么云端模型怎么选择呢?智谱第一次注册应该会有一些免费的token额度,大家可以直接扫描下面二维码注册,注册之后手机上就有创建API Key的入口,申请一个免费的key先用着,后续如果token消耗很多的话,可以选择一个国产或者国外大模型购买token。

后续token消耗情况,大家可以在bigmodel网页端 查看,入口在 控制台 -> 财务 -> 资源包 -> 我的资源包 查看

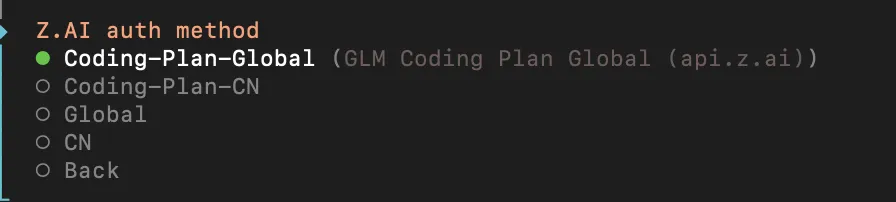

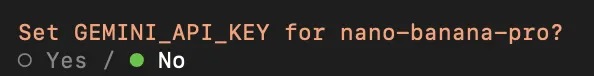

所以这一步,我们按键盘下键,找到Z.AI回车,如果你有其他模型,可以选择自己的模型,这里以智谱 GLM 作为参考

第五步

这里选择CN,普通 Z.AI 通用 API 中国区,如果你后续购买了套餐重新配置的话,再安装你的套餐选对应的套餐

第六步

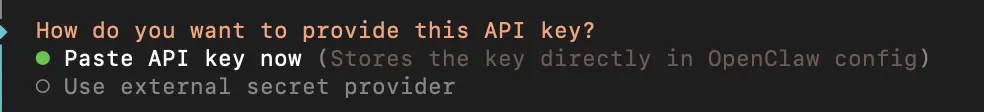

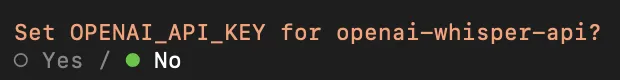

这两个选项的区别可以这样理解:

Paste API key now:最简单,直接粘贴,马上继续安装。适合个人电脑、本地使用。

Use external secret provider:更适合已经会用密钥管理的人,比如把 key 放到环境变量、外部 secret manager 或服务器安全系统里。对新手来说会更绕。OpenClaw 也有单独的安全与配置文档,说明更复杂的安全方案通常是给更进阶的部署场景准备的。

这里直接回车选择 Paste API key now。

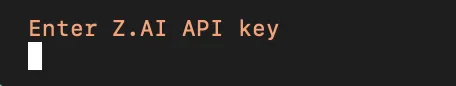

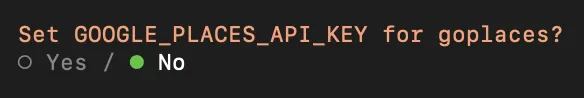

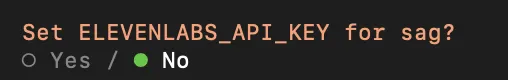

第七步

这里把你刚申请的apiKey复制粘贴过来,回车进入下一步

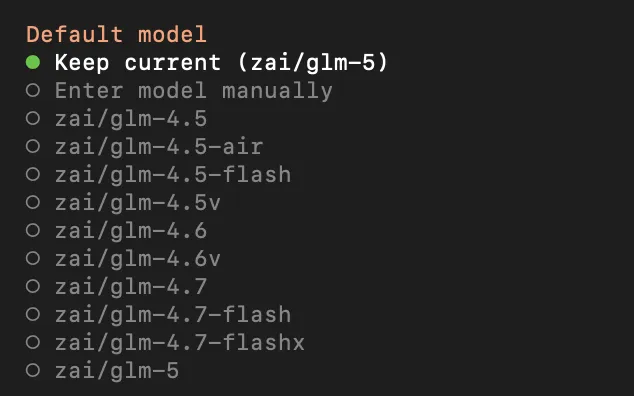

第八步

这里是选择具体的模型,找到zai/glm-5,选择这一项回车进入下一步吧,嗯~,你可以理解为它智商最高

第九步

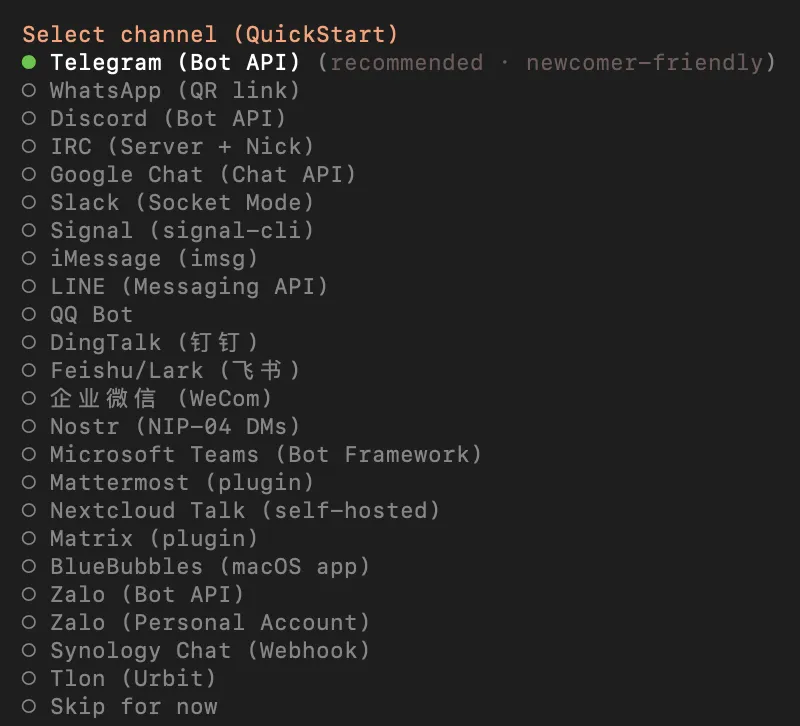

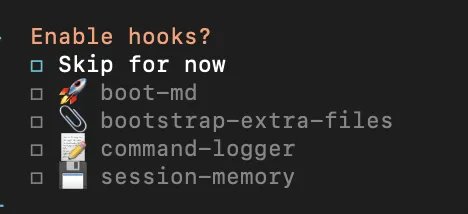

这里让你选择渠道机器人接入,这里我们先跳过,保证最基础的功能跑起来,后续再配置,选择 Skip for now 进入下一项

第十步

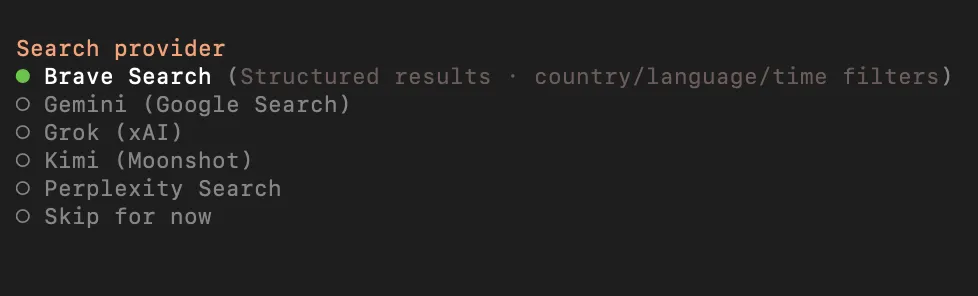

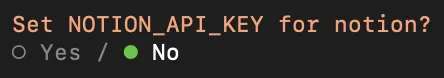

这一步是让我们选搜索提供商,我想说的是,都是收费的,如果你是买的kimi订阅套餐,可以选择kimi,否则这里我们先选择 Skip for now 进入下一项

第十一步

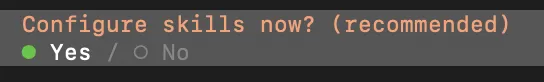

这里建议选 Yes,在 onboarding 里,选了以后它会帮你读取可用技能、检查依赖,并让你选择 npm 或 pnpm 来安装一些技能需要的依赖;这正适合第一次安装时顺手把基础能力补齐。

第十二步

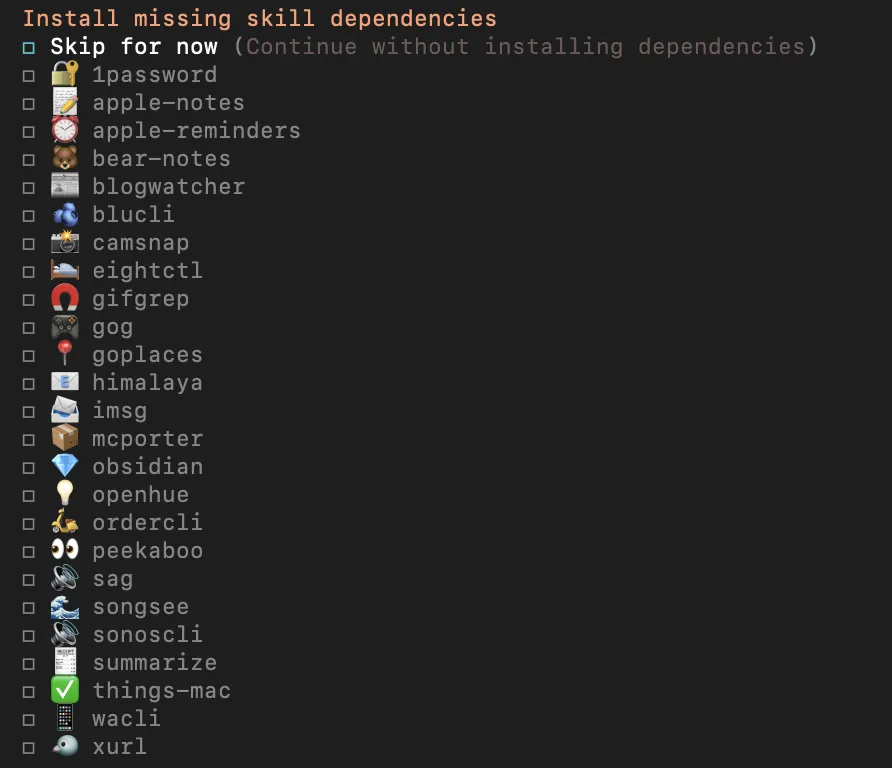

这里建议选 Skip for now (Continue without installing dependencies)

原因是这一页列出来的都不是 OpenClaw“必须才能运行”的基础依赖,而是一些可选技能的额外依赖。所以最稳的做法是先跳过,后面真正需要哪个技能,再单独安装哪个。OpenClaw 官方安装流程也强调首次安装的主线是先把 CLI、Gateway 和 onboarding 跑通。

这里跳过需要先空格键选中 Skip for now 再回车

第十三步

后面几项我们都选择默认项进入下一步,这些能力后续有需要我们可以再装

第十四步

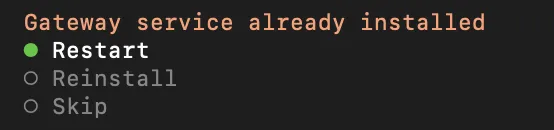

这里选择Restart重启,第一次配置可能会有所不同,选择默认选项就好。

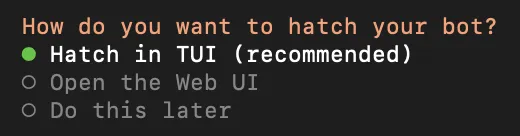

第十五步

这里是让我们选择启动方式,我们选择第二项,Open the Web UI 回车,至此,你的openclaw应该会自动打开一个网页,去和你的模型聊聊天吧~

第十六步 异常处理

如果你的模型已经可以正常了聊天了,请跳过,直接进入第二模块技能安装。

如果你的网页没有正常打开

检查 Gateway 是否正常

安装向导跑完后,执行:

openclaw gateway status如果看到服务正常

说明 OpenClaw 的后台已经起来了。打开网页控制台执行:

openclaw dashboard如果没有起来

后面“问题解析”章节会教你怎么修。

到这里,你已经达成了第一阶段目标

OpenClaw 已经在网页里跑起来了。

这时候再去折腾技能、渠道、本地模型,就会轻松很多。

二、安装必要技能:先装最值得装的

很多新手一开始容易犯一个错误:

看到很多技能很激动,一口气装几十个。

其实更好的方法是:

先装最常用、最能提升使用体验的几类。

1. 技能是什么?

你可以把 Skills 理解成“AI 的功能包”。

比如:

能不能更主动 能不能帮你继续发现别的技能 能不能更好地做结构化记忆 能不能增强联网搜索

这些通常都不是靠“主程序本体”完成,而是靠技能补充。

2. 技能从哪里来?

OpenClaw 官方公开的技能目录叫 ClawHub。 它是一个公开技能注册表,可以搜索、安装、发布技能。

常用命令

搜索技能:

// 搜索ontology技能npx clawhub search ontology安装技能:

npx clawhub install ontology官方 / 公开技能相关仓库

技能市场

https://clawhub.aiClawHub(技能目录),这是 ClawHub 这个网站本身的源码仓库

https://github.com/openclaw/clawhubskills 备份仓库(历史技能集合)

https://github.com/openclaw/skills

注意:skills 备份仓库本身是历史备份集合,官方提醒其中可能存在可疑内容。新手优先通过 ClawHub 安装更稳。

3. 目前最建议先装的技能

下面这几类最适合新手起步。

技能一:find-skills

推荐指数:★★★★★

它的作用非常直接:

帮你继续发现“还有哪些技能值得装”。

对于刚入门的人,这个技能非常有价值,因为你通常并不知道整个生态里到底有什么。

安装方式

npx clawhub install find-skills它最适合谁?

刚接触 OpenClaw 想慢慢扩展技能能力 不知道该从哪些技能开始装

技能二:proactive-agent-lite

推荐指数:★★★★★

它的思路是让助手不只是“你问一句,它答一句”,而是变得更主动一些。

安装方式

npx clawhub install proactive-agent-lite它最适合谁?

想让 OpenClaw 更像“私人助理”的人 希望它能主动推进事情,而不是只做聊天机器人

技能三:ontology

推荐指数:★★★★☆

这个技能更偏“结构化记忆”。

简单理解:

它可以帮助 OpenClaw 更清楚地区分和整理:

人物 项目 任务 事件 文档 它们之间的关系

如果你以后想把 OpenClaw 用作长期助手,这类技能很有价值。

安装方式

npx clawhub install ontology技能四:tavily-search

给 OpenClaw 增加“联网搜索能力”的技能。 它背后调用的是 Tavily Search API,作用类似“给 OpenClaw 装一个专门给 AI 用的搜索引擎”。在 ClawHub 上,这类技能的描述通常是:适合网页搜索、新闻查询、事实核查、搜来源链接、提取更适合 AI 阅读的结果

安装方式

npx clawhub install tavily-search所以,tavily-search 常见用途是:

搜“今天/最近”的新闻

帮你找某个主题的网页资料

找原始来源链接

做事实核查

给 AI 返回更干净、更结构化的搜索结果

技能五:skill-vetter

安装技能前的安全检查员,它是干什么的

OpenClaw 的技能生态很开放,这是优点,也是风险点。 因为 skill 本质上可能包含脚本、命令、网络访问、环境变量读取等能力,所以一旦来源不可靠,就可能出现这些问题:

偷 API key、token、cookie 把本地文件发到外部服务器 用混淆代码隐藏真实行为 用相似名字冒充热门技能 申请和功能不匹配的过大权限

skill-vetter 的作用,就是在你安装前先帮你做一次“像安全审计一样的初筛”。相关公开说明里明确提到它会检测 credential theft、exfiltration、obfuscated code、typosquatting 这类风险

安装方式

npx clawhub install skill-vetter对新手来说,它很值得优先装,因为它不要求你有很强的编程能力,也能帮你挡掉一部分明显风险

如果安装过程中报错了,请看这一部分

安装过程中,你很可能遇到这样的问题:Error: Rate limit exceeded (retry in 59s, remaining: 0/20, reset in 59s)

这表示你触发了限流,别急,稍等多试几次吧,当然,你也可以这样做

通过仓库手动安装

以find-skills为例

git clone https://github.com/openclaw/find-skills.git ~/.openclaw/skills/find-skillsopenclaw skills register ~/.openclaw/skills/find-skillsopenclaw skills list | grep find-skills每一步解释

git clone:把技能代码下载到本地skills register:告诉 OpenClaw“把这个技能正式注册进来”skills list:确认安装成功

更多技能,去技能市场看看吧~,去搜搜你需要的

下面,我们来看下,怎么接入各个平台的机器人

三、OpenClaw 接入飞书、企业微信、钉钉、QQ 机器人配置流程

这一部分是很多人最关心的:

我已经把网页跑起来了,怎么让它出现在我平时聊天的软件里?

核心思路其实都一样:

在目标平台创建机器人 / 应用 拿到凭证(ID、Secret、Token 等) 在 OpenClaw 里安装对应插件 添加渠道配置 重启 Gateway 做一次收发消息测试

A. 接入飞书(Feishu / Lark)

第 1 步:在飞书开放平台创建应用 / 机器人

访问飞书开放平台,单击 创建企业自建应用 ,填写应用名称和描述,选择应用图标,单击 创建 。

左侧导航栏单击 凭证与基础信息 页面,复制 App ID(格式如 cli_xxx)和 App Secret。

左侧导航栏单击 权限管理 页面,点击 批量导入/导出权限 按钮,粘贴以下 JSON 配置,单击 下一步 ,确认新增权限,单击申请开通。

JSON配置文件内容

{"scopes": {"tenant": ["aily:file:read","aily:file:write","application:application.app_message_stats.overview:readonly","application:application:self_manage","application:bot.menu:write","cardkit:card:write","contact:user.employee_id:readonly","corehr:file:download","docs:document.content:read","event:ip_list","im:chat","im:chat.access_event.bot_p2p_chat:read","im:chat.members:bot_access","im:message","im:message.group_at_msg:readonly","im:message.group_msg","im:message.p2p_msg:readonly","im:message:readonly","im:message:send_as_bot","im:resource","sheets:spreadsheet","wiki:wiki:readonly" ],"user": ["aily:file:read", "aily:file:write", "im:chat.access_event.bot_p2p_chat:read"] }}左侧导航栏中单击 添加应用能力, 选择按能力添加页签,找到机器人卡片,单击配置。

配置事件订阅。

在飞书开放平台左侧导航栏单击事件与回调,在事件配置页签中单击订阅方式,选择使用 长连接 接收事件,单击保存。 在事件配置页面,单击添加事件,搜索事件 im.message.receive_v1(接收消息),单击确认添加。

在 版本管理与发布 页面创建版本,填写应用版本号和更新说明,单击保存,提交审核并发布。这一步需要飞书管理员审核,审核通过后机器人才算添加成功。

第 2 步:安装飞书插件

目前常见、较可信的飞书 OpenClaw 插件示例包名:

openclaw plugins install @larksuiteoapi/feishu-openclaw-plugin如果配置向导里已经能直接选飞书,也可以优先走向导,因为对新手更省事。

第 3 步:添加渠道

openclaw channels add进入交互式菜单后,选择:

飞书 / Lark 输入 App ID 输入 App Secret 保存

第 4 步:重启 Gateway

openclaw gateway restart第 5 步:在飞书里测试

给机器人发一句简单的话,比如:

你好,测试一下如果能收到回复,说明飞书接入成功。

小白要知道的重点

飞书接入的本质,是把飞书机器人变成 OpenClaw 的一个“消息入口” 以后你在飞书发消息,本质就是发给 OpenClaw Gateway 如果改了渠道配置却没生效,第一反应就是 openclaw gateway restart

B. 接入企业微信机器人

这部分你已经有实操命令,我这里把它整理成最适合新手照抄的版本。

第 1 步:到企业微信后台创建机器人

进入企业微信管理后台, 在左侧导航栏单击管理工具 > 智能机器人。单击创建机器人,单击手动创建。

通过API模式创建智能机器人,配置基础信息,然后下拉到页面底部单击API模式创建,连接方式选择使用长连接,配置方式获取Secret,记录下来Bot ID和Secret。

第 2 步:安装企业微信插件

openclaw plugins install @wecom/wecom-openclaw-plugin这个插件是企业微信官方团队发布的 OpenClaw 插件之一。

第 3 步:添加企业微信渠道

openclaw channels add进入菜单后:

选择“企业微信” 输入 Bot ID 输入 Secret 确认

第 4 步:重启 Gateway

openclaw gateway restart第 5 步:回到企业微信后台点保存

这是很多人容易漏掉的一步。

你需要回到企业微信机器人页面,再点一次保存,完成最终配对。

第 6 步:发送测试消息

如果企业微信里能收到回复,说明企业微信接入成功。

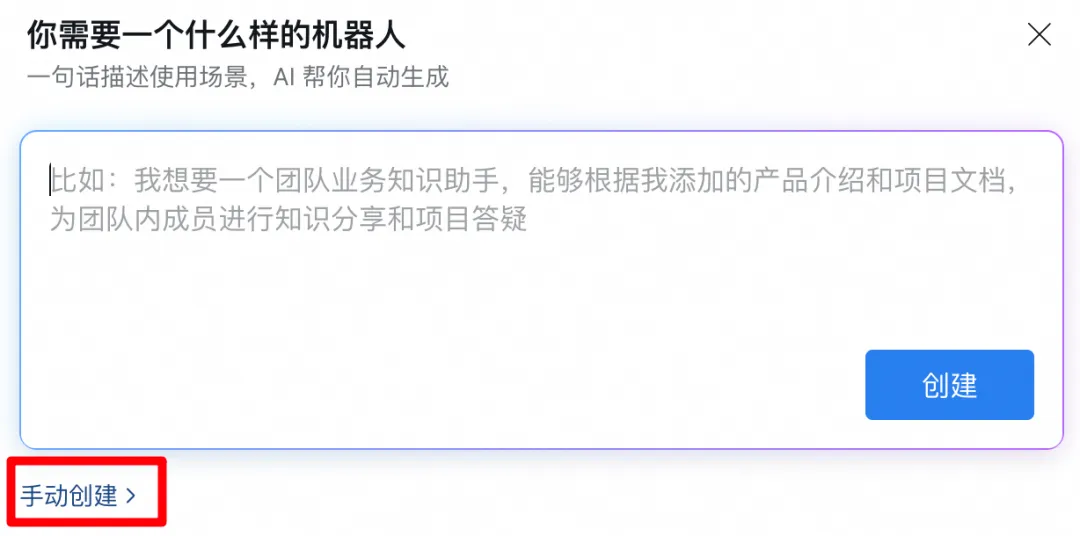

C. 接入钉钉机器人

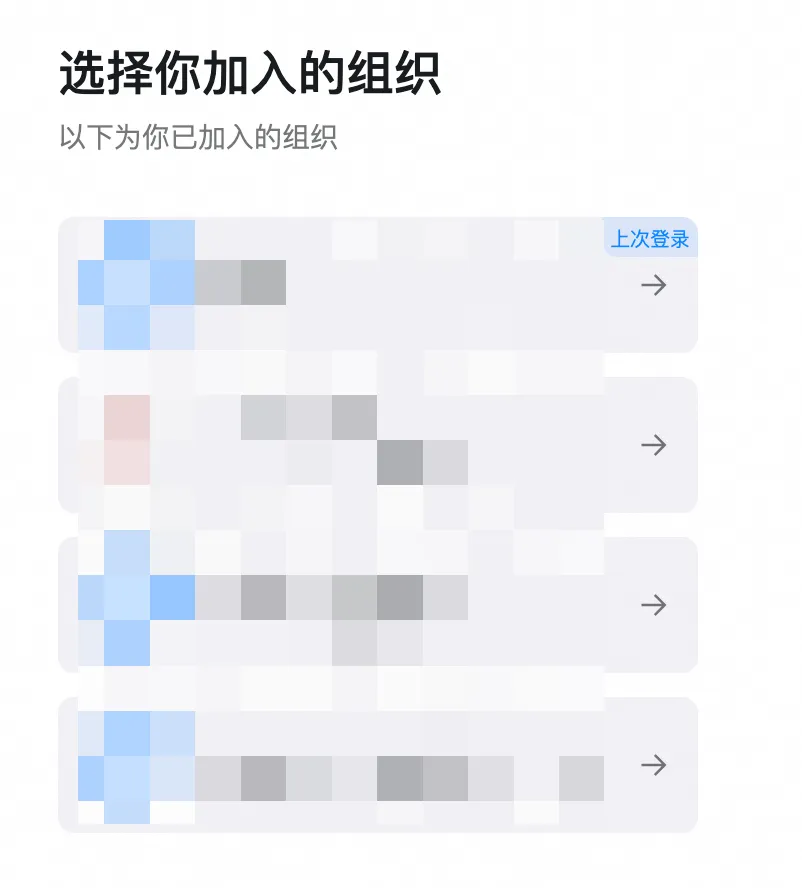

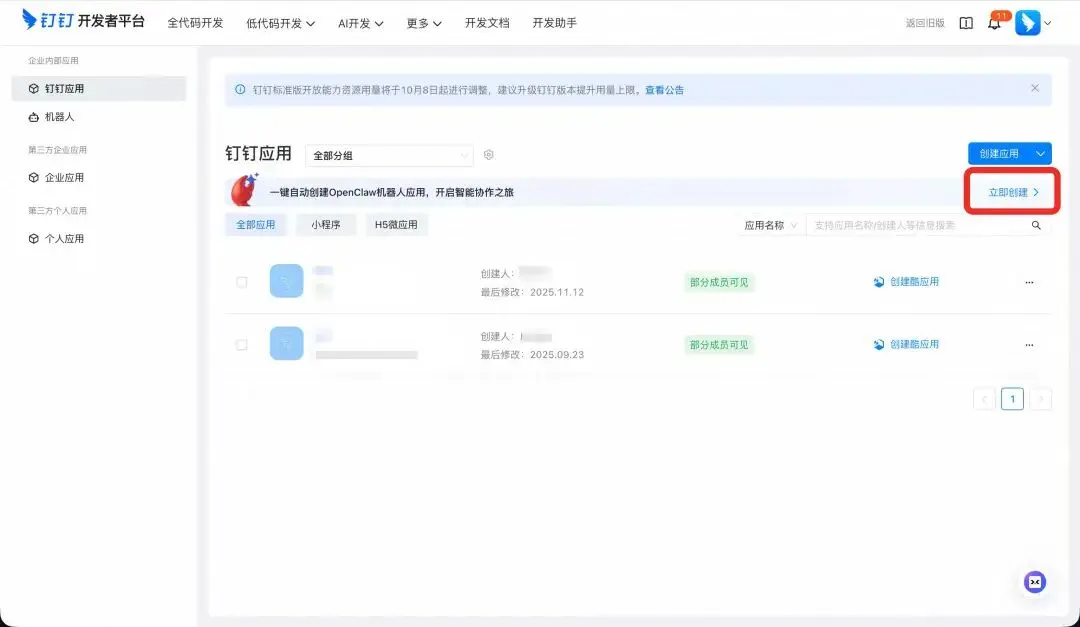

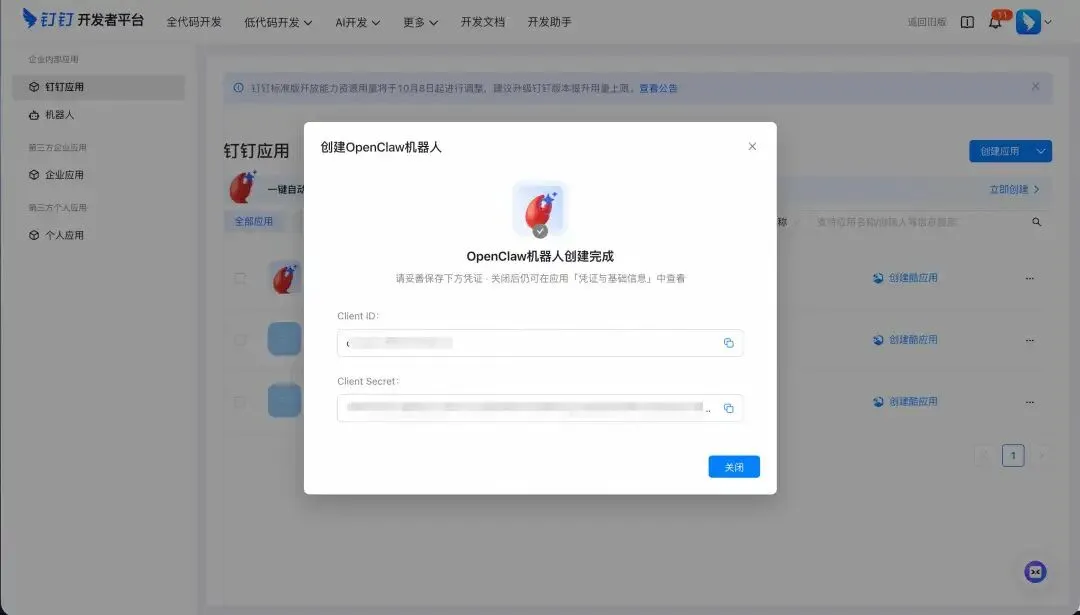

第 1 步:在钉钉后台创建机器人

选择或创建组织。

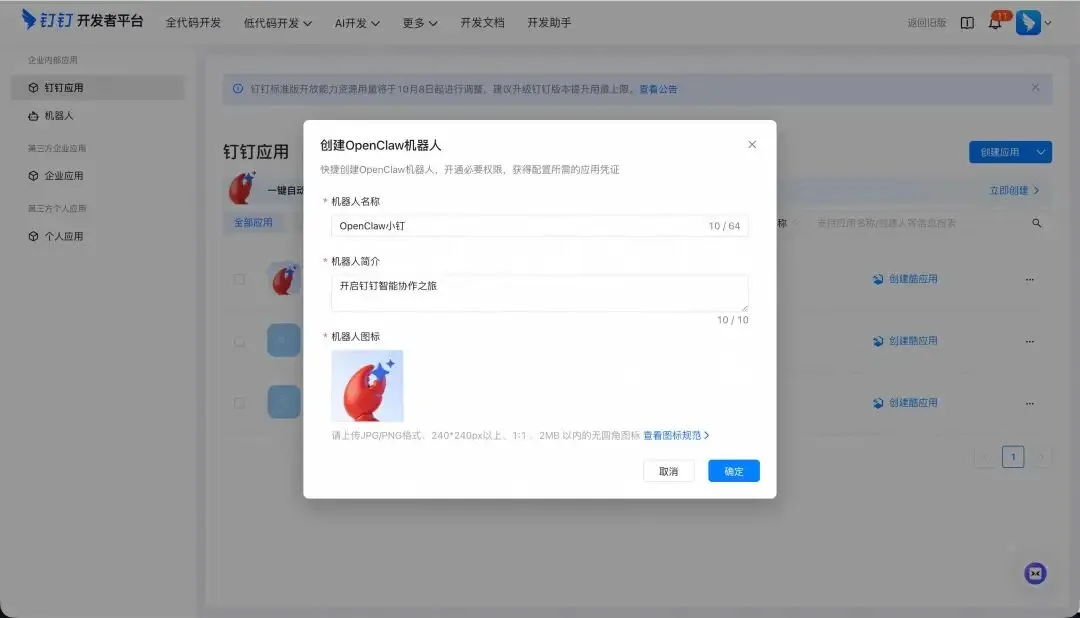

在开发者后台,在一键自动创建OpenClaw机器人处点击立即创建。

平台已自动预设OpenClaw机器人信息,可根据业务需要修改配置后,单击确定进行创建。如需创建多个应用建议在创建时修改机器人名称或者图标,方便后续区分。

在创建成功后,复制并保存应用的Client ID和Client Secret。

第 2 步:安装钉钉插件

目前常见的社区插件示例有这些:

openclaw plugins install clawdbot-dingtalk或者:

openclaw plugins install @soimy/dingtalk不同插件维护者不同,字段名和向导提示可能略有差异。零基础用户优先选文档更完整、近期仍在更新的插件。

第 3 步:添加渠道

openclaw channels add然后按提示填写钉钉的凭证。

第 4 步:重启 Gateway

openclaw gateway restart第 5 步:在钉钉里测试

给机器人发消息测试。

小白要知道的重点

钉钉这里最容易搞混的是:

你不是在“装钉钉” 你是在“让 OpenClaw 学会通过钉钉收发消息”

所以如果失败了,优先查的是:

机器人后台凭证有没有填错 插件包名是否正确 重启是否做了

D. 接入 QQ 机器人

QQ机器人接入最方便

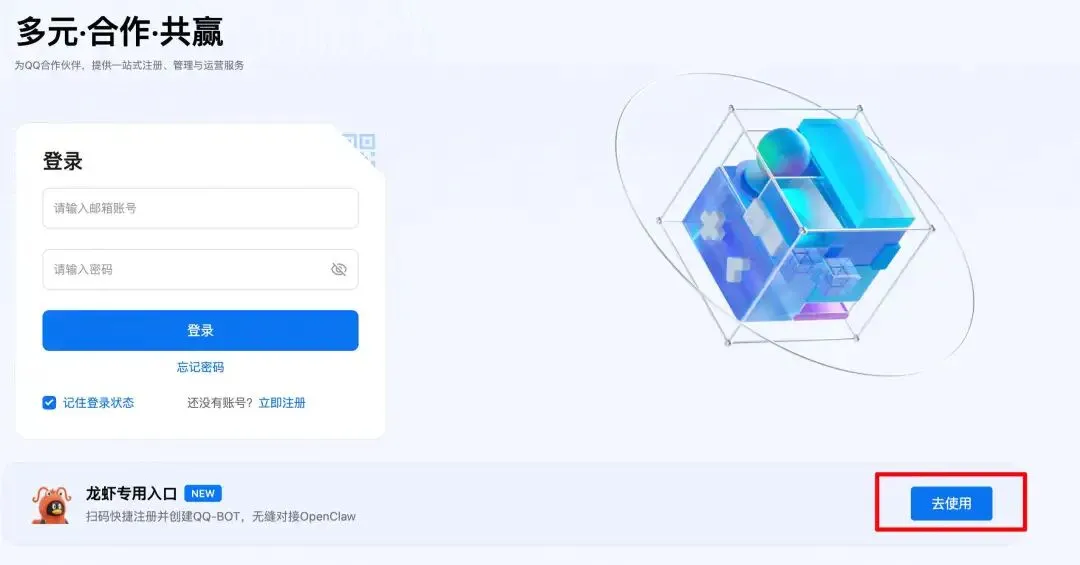

第 1 步:创建 QQ 机器人

前往腾讯QQ开放平台官网。在下方的龙虾专用入口单击去使用。

在手机登录区域,扫描二维码登录QQ账号。

单击创建机器人,生成新的QQ机器人。

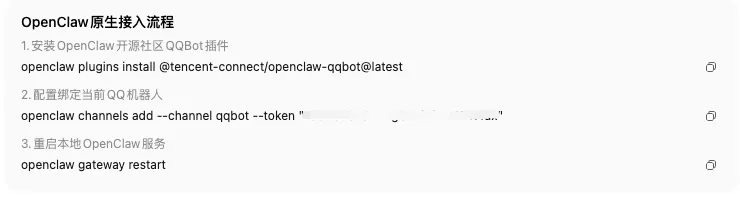

第 2 步:安装 QQ 插件 & 绑定机器人 & 重启OpenClaw

创建机器人后,会看到OpenClaw原生接入流程,直接按照流程复制命令粘贴即可

第 3 步:发消息测试

先测试私聊,再测试群聊 @ 机器人。

四、OpenClaw 接入本地模型配置指南

如果你已经把网页控制台跑起来,下一步很多人会想:

能不能不用云端模型,改成本地模型?

答案是可以,而且官方对 Ollama 的支持已经比较成熟。

对于完全没有经验的人,我最推荐的本地模型方案就是:

Ollama + OpenClaw

1. 本地模型的优点和代价

优点

不会产生云端调用费用 数据更多留在你自己机器上 可以自由切换开源模型

代价

需要电脑性能足够 首次配置比云端模型略复杂 模型越大,对内存和算力要求越高

新手建议

如果你只是想“先用起来”,先用云端。如果你想“长期低成本”,再切到本地模型。 不过本地模型只能安装开源模型,而且是小参数的,其实更适合操作简单任务或者尝试学习使用。

2. 安装 Ollama

macOS 上常见安装方式:

brew install ollama启动 Ollama:

ollama serve如何确认 Ollama 是否已启动

打开浏览器访问:

http://127.0.0.1:11434如果看到类似 Ollama is running,说明本地模型服务已经启动。

3. 下载本地模型

可下载的开源模型在这里:https://ollama.com/search,

例如下载一个比较常见的模型:

ollama pull qwen2.5:7b查看已下载模型:

ollama list小白怎么理解这一步

你可以把它理解成:

ollama serve:把“本地模型服务”启动起来ollama pull:把某个具体模型下载到电脑里

两者缺一不可。

4. 把 Ollama 告诉 OpenClaw

如果你想手动配置,可以这样设置:

openclaw config set models.providers.ollama.apiKey "ollama-local"openclaw config set models.providers.ollama.baseUrl "http://127.0.0.1:11434"openclaw config set models.providers.ollama.api "ollama"每一行是什么意思?

第 1 行:apiKey

Ollama 本地一般不需要真实 API Key。这里填一个占位值即可,例如:

ollama-local第 2 行:baseUrl

告诉 OpenClaw:

本地模型服务在

http://127.0.0.1:11434

第 3 行:api

告诉 OpenClaw:

这里走的是 Ollama 原生 API,不是 OpenAI 兼容 API。

这个点很重要。

不要把 Ollama 配成 /v1 那种 OpenAI 兼容地址来给 OpenClaw 用。官方文档明确建议用 Ollama 原生接口。

5. 切换到本地模型

配置好 provider 后,切换默认模型:

openclaw models set ollama/qwen2.5:7b查看当前模型情况:

openclaw models listopenclaw models status最后重启 Gateway:

openclaw gateway restart到这里你做成了什么?

你已经把 OpenClaw 的“大脑”从云端模型切到了你自己电脑上的本地模型。

五、OpenClaw 安装后配置模型和切换模型方法

很多新手后面都会遇到这个问题:

我装好了,但想换模型,应该怎么做?

其实只要记住一个原则:

先看有哪些模型,再指定默认模型,最后重启 Gateway。

1. 查看当前有哪些模型

openclaw models list这条命令会帮你看:

当前可用模型 模型名字怎么写 以后切换时应该填什么完整名称

2. 查看当前模型状态

openclaw models status这条命令非常有价值,因为它不只是列出模型,还能帮助你看:

默认模型是什么 认证是否正常 Provider 是否就绪 是否存在明显错误

如果你切换模型后不工作,先看它。

3. 用简单命令切换默认模型

切到本地模型

openclaw models set ollama/qwen2.5:7b切到云端模型

例如:

openclaw models set openai/gpt-4o4. 用配置方式直接修改默认模型

你也可以直接改配置:

openclaw config set agents.defaults.model.primary "openai/gpt-4o"这种方式更接近“底层配置修改”。

新手建议

优先用:

openclaw models set <模型名>更简单,也更不容易写错。

5. 改完模型后一定要重启

openclaw gateway restart为什么要重启?

因为 Gateway 是常驻后台服务。你改了模型配置后,如果不重启,它可能还在用旧配置。

6. 一个实用的模型使用建议

方案 A:先用云端模型入门

适合:

完全新手 想尽快体验 不想折腾硬件

方案 B:熟悉后再切本地模型

适合:

想降低长期成本 愿意自己管理本地模型 电脑性能足够

方案 C:两个都准备

很多人的实际做法是:

平时省钱:本地模型 复杂任务:切回强一点的云端模型

这也是比较现实的方案。

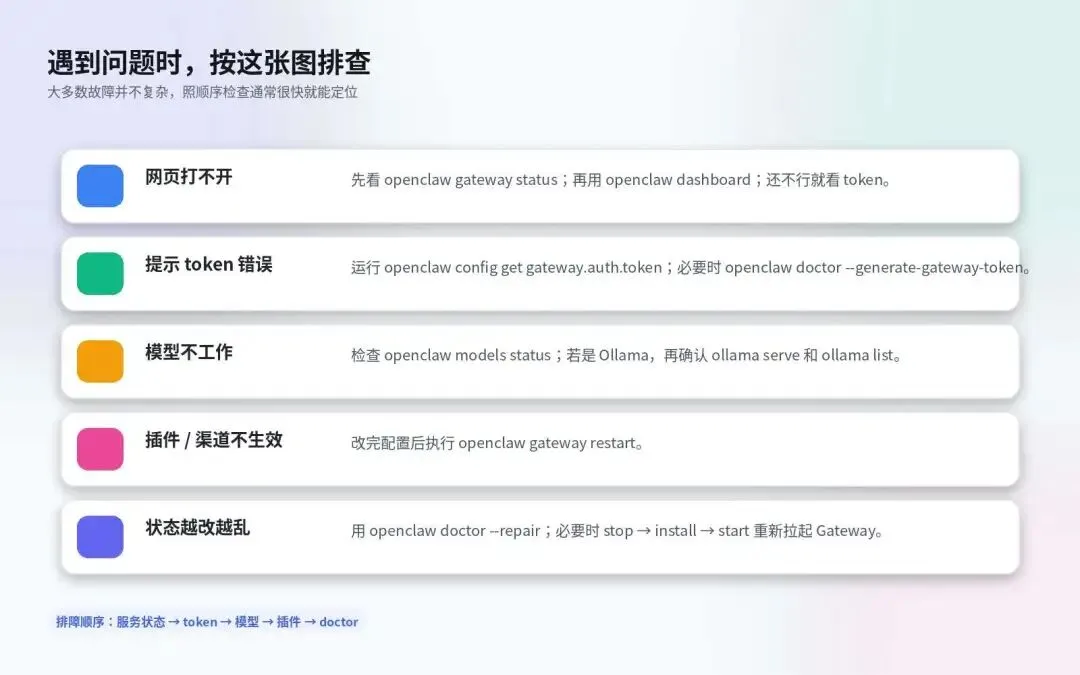

六、配置安装过程中可能遇到的问题解析

真正让新手头疼的,不是“会不会装”,而是:

明明已经装了,为什么就是不工作?

这里我把最常见的问题按排查顺序写清楚。

问题 1:网页控制台打不开

先检查 Gateway 是否正常

openclaw gateway status再尝试直接打开

openclaw dashboard这类问题最常见的原因

Gateway 没启动 服务虽然安装了,但没正常运行 端口没起来

问题 2:网页打开了,但提示 token 错误

先取 token:

openclaw config get gateway.auth.token把它填进 Control UI。

如果你怀疑 token 状态不对,可以尝试:

openclaw doctor --generate-gateway-token问题 3:模型已经配置了,但聊天不工作

先看模型状态:

openclaw models status如果你用的是 Ollama,再检查:

ollama serveollama list这类问题最常见的原因

Ollama 没启动 模型没下载 默认模型没切过去 改完模型后没重启 Gateway

问题 4:插件或渠道明明加了,但机器人没反应

先重启:

openclaw gateway restart为什么这招很常用?

因为很多渠道插件和配置变更,都需要 Gateway 重新加载。

尤其是你刚刚:

装了插件 改了渠道配置 加了新凭证

这时不重启,很容易表现成“明明配了,但好像没生效”。

问题 5:安装越来越乱,不知道哪里错了

先做系统自检:

openclaw doctor --repair这个命令非常重要。它会检查并尽量修复常见配置和环境问题。

问题 6:Gateway 服务彻底乱了,想重新拉起来

你可以按顺序执行:

openclaw gateway stoppkill -f openclawrm -rf ~/.openclaw/run/*openclaw gateway installopenclaw gateway startsleep 5openclaw gateway status这一套在做什么?

停止旧服务 清掉残留进程 清掉运行时临时状态 重新安装 Gateway 服务 再重新启动

适合什么场景?

服务项损坏 状态残留太多 重启都不恢复

问题 7:安装时报 sharp / libvips 相关错误

官方安装页对这个问题给了建议。

在 macOS 上,如果你装过全局 libvips,可能会导致 sharp 安装出错。这时可以尝试:

SHARP_IGNORE_GLOBAL_LIBVIPS=1 npm install -g openclaw@latest问题 8:配置文件改了以后,Gateway 启动失败

OpenClaw 的配置校验很严格。如果配置格式不符合 schema,Gateway 会拒绝启动。

新手建议

优先用 openclaw config set改配置少手写大段 JSON 改完就用 openclaw doctor和openclaw gateway status检查

七、给小白的一条最稳安装路线

如果你只记得一条路线,请记这个:

第一步:先把网页跑起来

npm install -g openclaw@latestopenclaw onboard --install-daemonopenclaw gateway statusopenclaw dashboard第二步:再装必要技能

第三步:再接聊天渠道

第四步:最后再切本地模型

八、结语

如果你看完这篇文章,只想记住一件事,那就是:

OpenClaw 不要一上来就全装全配。最稳的方法是“先网页、再技能、再渠道、最后本地模型”。

这也是最适合零基础用户的路线。

你完全可以把 OpenClaw 的部署拆成 4 个小目标:

网页打开并能聊天 技能装上并能用 聊天软件里能收发消息 本地模型切换成功

当你按这个顺序做,OpenClaw 其实并不难,快行动起来吧~⛽️,安装过程中有任何问题,欢迎私信博主

夜雨聆风

夜雨聆风