对于 OpenClaw 而言,模型需要提供稳定、高速、不中断的服务。

很多新手第一次给 OpenClaw 接本地模型,都会首选 Ollama,因为安装简单,对新手极度友好。但真正跑起来就会发现,Ollama 的推理速度越来越慢:

今天这篇文章,给大家带来一套完整的、经过实测的方案:用 vLLM 部署本地模型,完美对接 OpenClaw,单卡就能跑出商用级的稳定体验。

一、适配 OpenClaw 的模型推荐

OpenClaw 对模型的核心要求,是优秀的中文理解能力、稳定的工具调用能力、低显存占用,这里给大家按显存大小整理了适配清单:

| 显卡显存 | 推荐模型 | 核心优势 |

|---|---|---|

| 24GB 及以上 | Qwen3-14B-AWQ | 中文能力顶尖,Agent 与工具调用能力拉满,综合表现最优 |

| 12GB-16GB | Qwen2.5-7B-Instruct-AWQ | 平衡性极强,显存占用低,工具调用能力稳定,适合中端显卡 |

| 8GB 及以下 | Qwen2.5-4B-Instruct-AWQ | 轻量高效,入门级显卡也能流畅运行,满足基础自动化任务需求 |

二、保姆级分步部署

注:本教程以 Windows+WSL2 环境为例,原生 Ubuntu 系统可直接跳过 WSL2 安装步骤,对应执行相关命令即可。

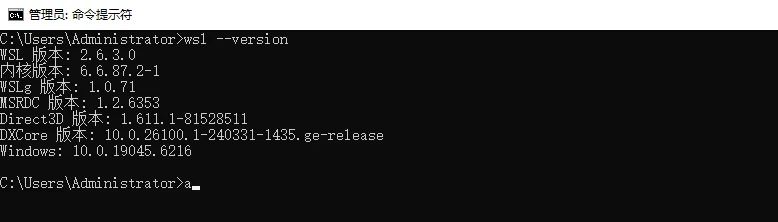

步骤 1:WSL2 与 Ubuntu 系统安装与校验

以管理员身份打开 Windows PowerShell,执行以下命令安装 WSL2:

wsl --install安装完成后重启电脑,再次以管理员身份打开 PowerShell,执行命令安装 Ubuntu 系统:

wsl --install -d Ubuntu安装完成后,设置 Ubuntu 的用户名和密码,执行以下命令校验 WSL 版本,确保输出为 WSL2:

wsl --version

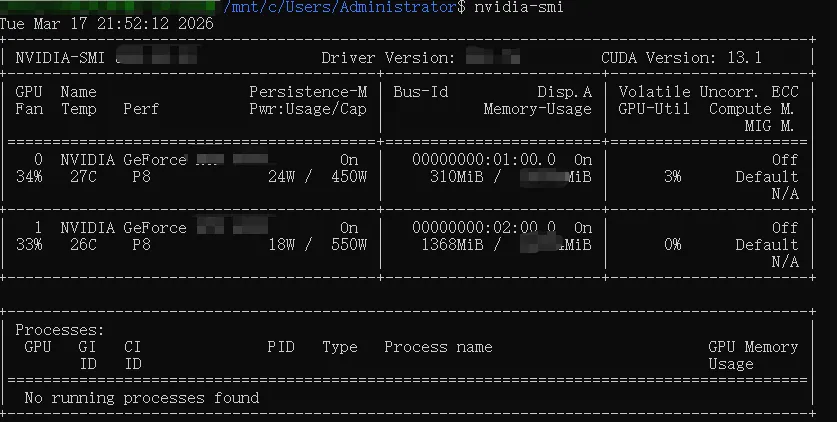

步骤 2:WSL 环境 GPU 直通配置与 CUDA 驱动校验

先确保 Windows 系统已安装对应 NVIDIA 显卡的最新驱动,可在 NVIDIA 官网下载安装;

打开 Ubuntu 终端,执行以下命令,校验 GPU 是否直通成功:

nvidia-smi若输出了你的显卡信息、CUDA 版本等内容,说明 GPU 直通配置成功;若报错,需重新检查 Windows 显卡驱动和 WSL2 安装是否正确。

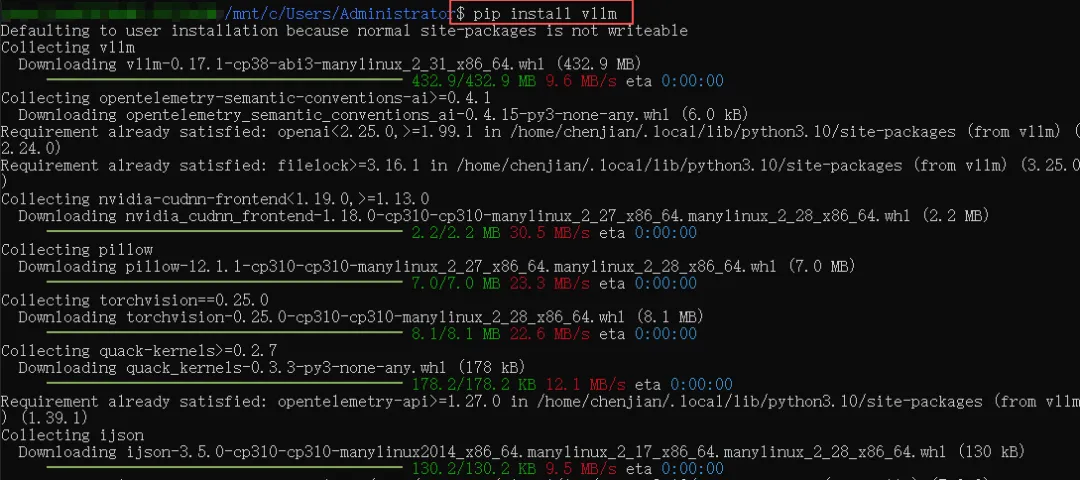

步骤 3:Python 虚拟环境搭建与 vLLM 安装

先更新 Ubuntu 系统软件源,执行以下命令:

sudo apt updatesudo apt upgrade -y

安装 Python 与相关依赖:

sudo apt install python3-pip python3-venv -y创建 vLLM 专属虚拟环境,避免环境冲突:

cd ~python3 -m venv vllm-env

进入虚拟环境(后续 vLLM 相关操作,都需要先执行此命令进入环境):

source vllm-env/bin/activate升级 pip 并安装 vLLM:

pip install --upgrade pippip install vllm

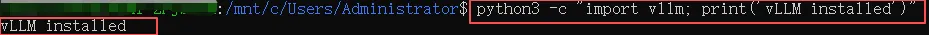

安装完成后,执行以下命令校验,若输出 "vLLM installed",说明安装成功:

python3 -c "import vllm; print('vLLM installed')"

步骤 4:下载模型

如果你习惯把模型文件牢牢握在自己手里,或者想方便以后离线使用,可以去阿里官方的“魔搭社区”(ModelScope)手动下载。

先在环境里安装 modelscope:

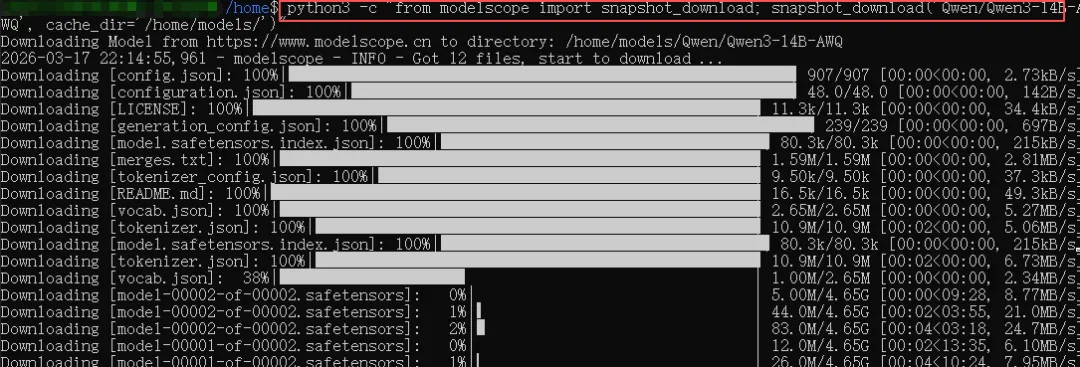

pip install modelscope运行一行 Python 代码将模型下载到本地(比如下载到 /home/user/models/ 目录):

python3 -c "from modelscope import snapshot_download; snapshot_download('Qwen/Qwen3-14B-AWQ', cache_dir='/home/models/')"

步骤 5:vLLM 服务启动与核心参数配置

执行以下启动命令,即可自动下载模型并启动 API 服务(以 Qwen3-14B-AWQ 为例,其他模型可替换模型名称):

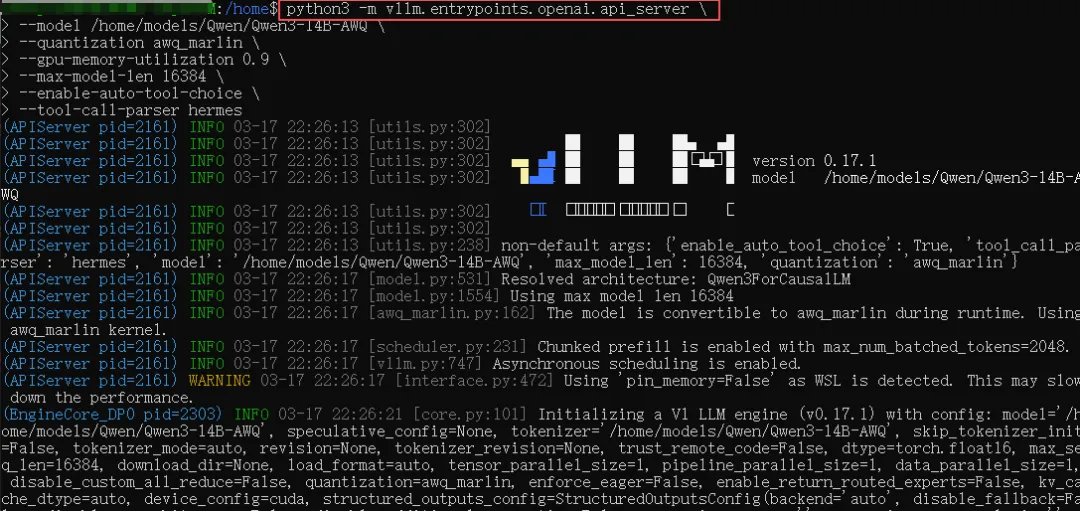

python3 -m vllm.entrypoints.openai.api_server \--model /home/user/models/Qwen/Qwen3-14B-AWQ \--quantization awq_marlin \--gpu-memory-utilization 0.9 \--max-model-len 16384 \--enable-auto-tool-choice \--tool-call-parser hermes

核心参数详解,可根据自己的硬件和需求调整:

--model:指定要加载的模型名称,vLLM 会自动从 Hugging Face 下载;--quantization:量化方案,AWQ 模型固定填写awq_marlin,大幅提升推理速度;--gpu-memory-utilization:GPU 显存利用率上限,建议设置 0.85-0.9,预留部分显存避免溢出;--max-model-len:模型最大上下文长度,根据显存大小调整;--enable-auto-tool-choice--tool-call-parser hermes:开启工具调用能力,适配 OpenClaw 的核心参数。

启动成功后,终端会输出 "Uvicorn running on http://0.0.0.0:8000",说明 API 服务已正常启动。

步骤 6:本地 API 服务连通性测试

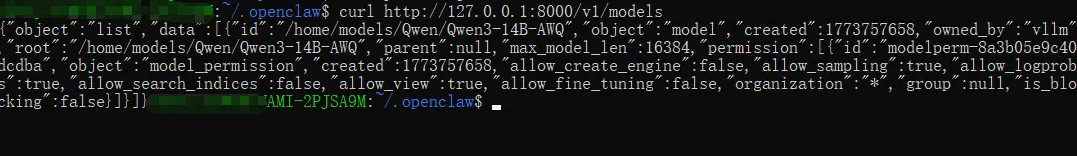

服务启动后,打开 Windows PowerShell,执行以下 curl 命令,测试服务是否可正常访问:

curl http://127.0.0.1:8000/v1/models

正常情况:会返回模型名称

Qwen/Qwen3-14B-AWQ等相关信息,说明服务连通正常;若报错,可直接查看本文第六部分的踩坑排查指南。

步骤 7:OpenClaw 本地模型配置对接

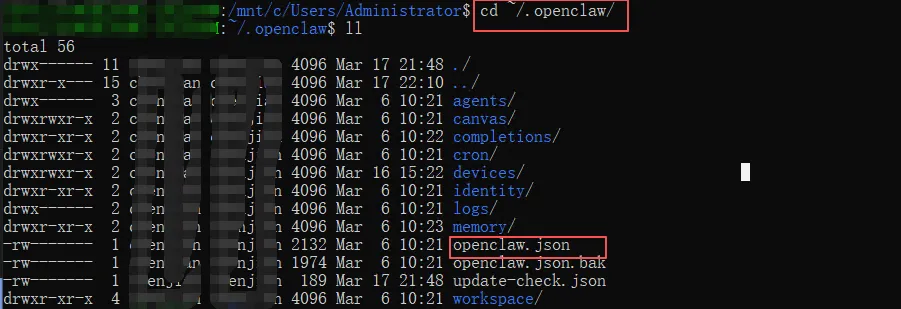

使用vLLM启动Qwen3-14B-AWQ后,在已安装的OpenClaw配置文件openclaw.json中进行修改。

安装完成后,输入 openclaw onboard 进入配置界面。在添加模型时,按照以下信息填写:

模型提供商: 自定义 (Custom)

Base URL:

http://127.0.0.1:8000/v1API key:

123456(本地 vLLM 随便填即可)模型名称:

Qwen3-14B-AWQ

保存后,OpenClaw 就成功连接到你的本地高算力大脑了。

三、进阶优化指南:彻底解决卡顿、长对话掉速问题

完成基础部署后,通过以下优化设置,可进一步提升稳定性,彻底解决卡顿、长对话掉速问题。

1. OpenClaw 核心参数优化

进入 OpenClaw 的模型参数设置页面,按以下数值调整,可大幅降低卡顿概率:

Context length(上下文长度):设置为 6000–8000,预留足够的冗余空间,避免工具调用日志快速占满上下文;

Temperature(温度值):设置为 0.7,平衡工具调用的稳定性和灵活性;

Max tokens(最大生成 token):设置为 2048,避免单次生成内容过长导致超时。

2. 长对话不掉速技巧

长对话运行中,历史内容会不断累积,导致推理速度越来越慢。我们可以通过 System Prompt 设置,让模型自动压缩对话记忆,解决这个问题。

在 OpenClaw 的 System Prompt 中,添加以下内容:

When the conversation becomes long,summarize previous messages into a short memory.Keep the memory under 200 tokens.设置后,模型会自动将长对话历史压缩到 200token 以内,既保留了核心上下文,又不会让上下文窗口持续膨胀,长任务运行也能保持速度稳定。

3. 实测性能数据(以RTX4090 为例)

完成以上优化后,Qwen3-14B-AWQ 模型的实测核心指标如下,完全满足 OpenClaw 自动化任务的需求:

| 性能指标 | 实测数值 |

|---|---|

| Token 生成速度 | 100–150 token/s |

| 首 Token 延迟 (TTFT) | 0.4 – 0.8 秒 |

| 最大上下文 | 32K tokens(建议实际任务限制在 8K–16K 之间) |

| 显存占用 | 12–16GB |

四、踩坑排查指南:高频报错问题一站式解决

1. 核心报错:URL 拼写可能存在错误,请检查

该报错出现在 curl 测试或 OpenClaw 对接时,对应http://127.0.0.1:8000/v1和/v1/models接口,排查方案按优先级排序:

检查 vLLM 服务状态:确认 Ubuntu 终端中的 vLLM 服务正常运行,没有报错退出,端口为 8000;

严格核对 URL 拼写:Base URL 必须为

http://127.0.0.1:8000/v1,不能遗漏/v1,不能多写末尾斜杠,不能写错 IP 或端口;检查端口映射与防火墙:确认 Windows 防火墙没有拦截 8000 端口,WSL2 的端口映射正常,可尝试重启 WSL 服务解决;

检查端口占用:执行

netstat -ano | findstr :8000,确认 8000 端口没有被其他程序占用。

2. 其他高频问题

显存不足(Out of Memory):降低

--gpu-memory-utilization数值,或更换参数更小的模型;模型下载失败:配置 Hugging Face 国内镜像,或手动下载模型到本地,通过本地路径加载;

OpenClaw 工具调用失败:确认 vLLM 启动时添加了

--enable-auto-tool-choice和--tool-call-parser hermes参数,更换工具调用能力更强的模型。

五、方案总结:适用场景与人群

1. 核心应用场景

OpenClaw 自动化任务、AI Agent 多工具调用流程;

对隐私要求高,不能使用云端 API 的私有化自动化场景;

高频、连续的自动化办公、数据处理、内容生成任务;

本地 AI 工具二次开发与测试场景。

2. 适合人群

AI 工具与自动化爱好者,想给 OpenClaw 搭建稳定的本地模型服务;

内容创作者、办公人群,需要用 AI 自动化完成重复性工作;

AI 开发者,需要本地高性能推理环境做 Agent 开发与测试;

对数据隐私敏感,不想将数据上传到云端 API 的企业与个人用户。

夜雨聆风

夜雨聆风