点击上方蓝字“小谢取证”一起玩耍

感谢各位老铁的点赞和评论。有评论区有的老铁提出关于数据的安全问题,毕竟可能会涉及到敏感的数据,这一点小谢确实没有在上篇文章当中提及到。除此之外,还是会再有其他的需求:

有一些电脑是完全没有网络环境的,所以这期就推出完全离线部署的教程,完全没有网络环境的状态下部署OpenClaw,赋能实战工作。

无网络环境完全离线部署OpenClaw的好处是不涉及到大模型的Token消耗,且不需要网络环境,直接安装包进行安装,简单易用,还能将OpenClaw的服务共享给局域网的其他机子,也在隐私数据上最可控。但建议需要部署的内网机性能好一点。所以这期我们来讲解一下在无网络环境完全离线的状态如何搭建OpenClaw。 但搭建之前也要与大家声明安全问题,大多单位是直接不允许搭建的内网机子,本文章只是作为完全离线部署搭建技术的探讨,不具备现实工作的指导意义。各位老铁也要根据实际情况出发。 如果大家自己搭建在自己本地电脑,想要做到相对的安全,想稳妥用 OpenClaw,可以按这个来:

1.只从 GitHub 官方仓库 / 官方可信渠道 下载源码或编译包

2.下载后校验哈希值(SHA256),确保没被篡改

3.运行前用杀毒软件全盘扫描一次

4.重要资料、密钥不要放在同一台机器

5.满足这些,再加上离线,豆包给出的答案是基本可以认为足够安全。

本文适用于Windows 10/11系统(内附Mac和Linux的安装包,可以后台回复“离线部署”自取),手把手教你利用LLM-Studio进行大模型的本地部署及OpenClaw的本地部署和加载大模型、局域网服务配置及对接,只需三步,步骤简洁无坑,新手也能上手! 前期准备 系统:Windows 10/11(64位) 硬件最低要求(必看)

CPU:4核+

内存:16GB+最好

存储:固态硬盘20GB+(模型+系统) 显卡:无强制,但如果有独显(8GB+显存)最佳网络:完全无需网络环境,只需安装包进行安装(需要安装包资源,后台回复“离线部署”即可) 安装包列表(全离线安装包且免费安装运行)

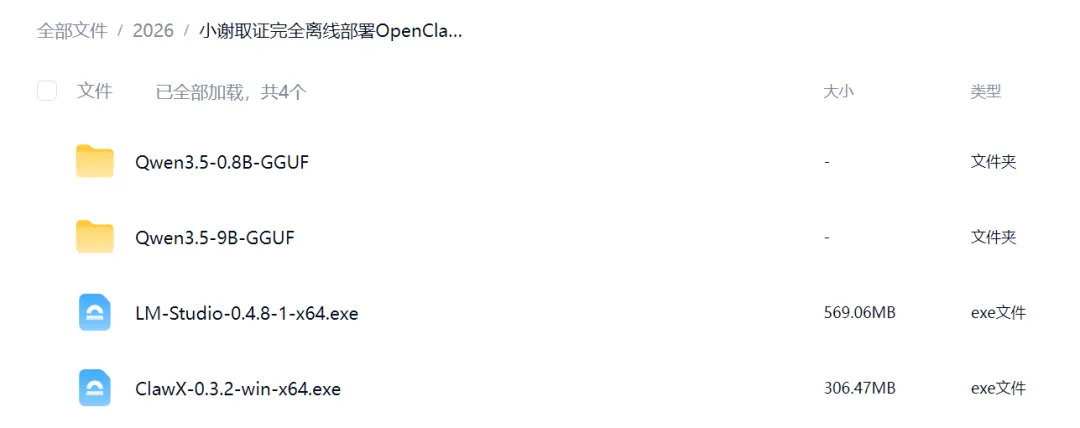

1.LM-Studio(本地模型运行器) 2. 离线大模型.gguf文件(可使用LM-Studio进行导入)3.Clawx(基于开源框架OpenClaw开发的图形化桌面应用) 小谢自己搭建的是Qwen3.5 9B模型。效果在文末有展示。配置如下  有了上述的前期准备之后,接下来我们来进入实操。只需简单的三步,即可搭建完成。 第一步:一键安装LM Studio

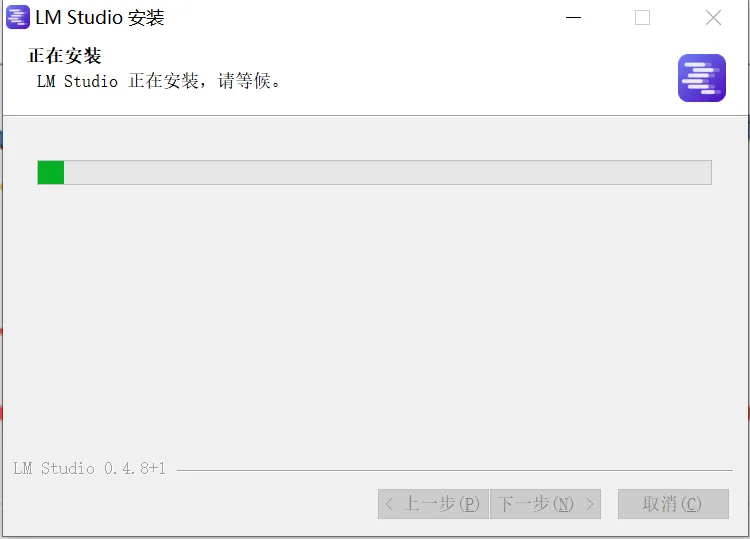

有了上述的前期准备之后,接下来我们来进入实操。只需简单的三步,即可搭建完成。 第一步:一键安装LM Studio

(1)双击运行安装包正在安装

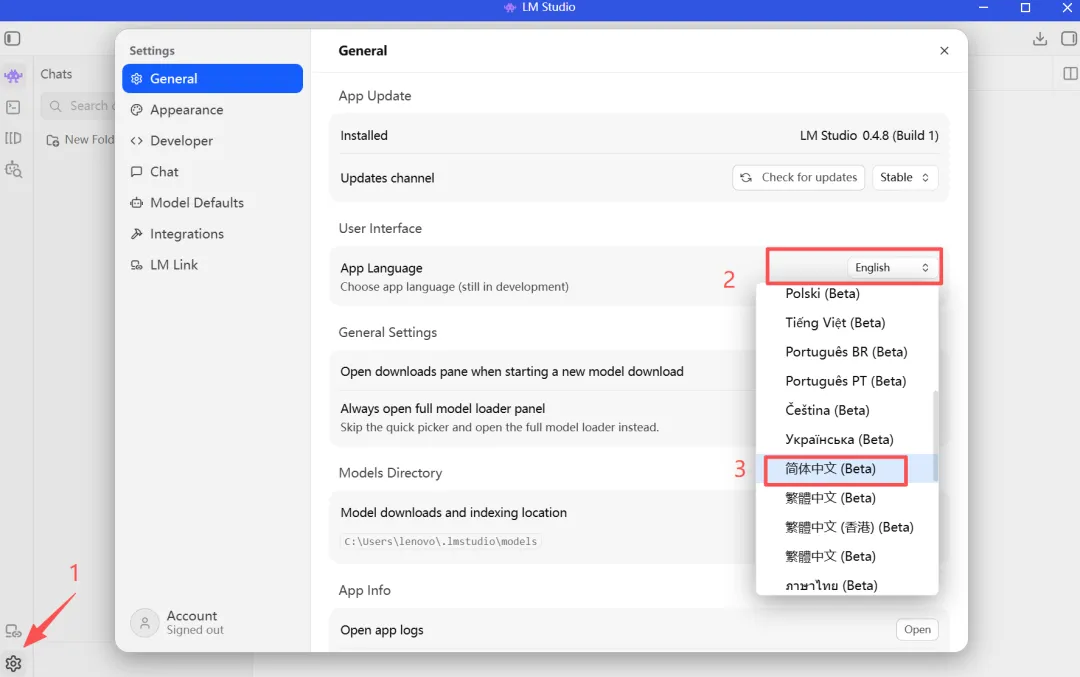

最开始进入界面我们可以在设置处设置为中文

(2)接下来我们要来导入模型。 先载下所给的资料当中的“0.8b”或者“9b”的文件夹,然后要将他放到模型所在的文件夹当中,也就是默认的路径

(3)紧接着在这个文件夹当中放入我们的.gguf离线大模型的文件夹。我们以0.8b的为例。可以在LM-Studio的My Models处看到,是没有0.8b的模型。

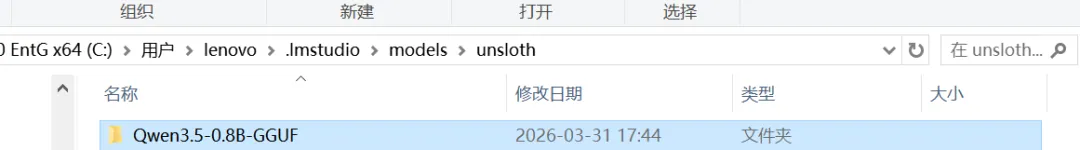

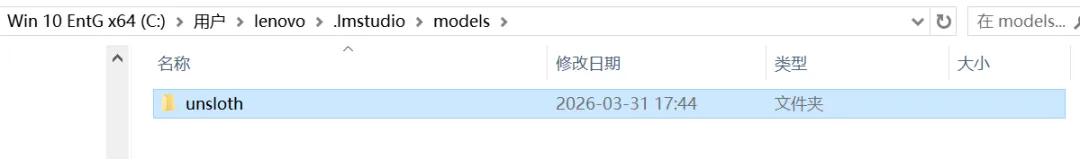

(4)将其放入C:\Users\lenovo\.lmstudio\models\unsloth文件夹当中。

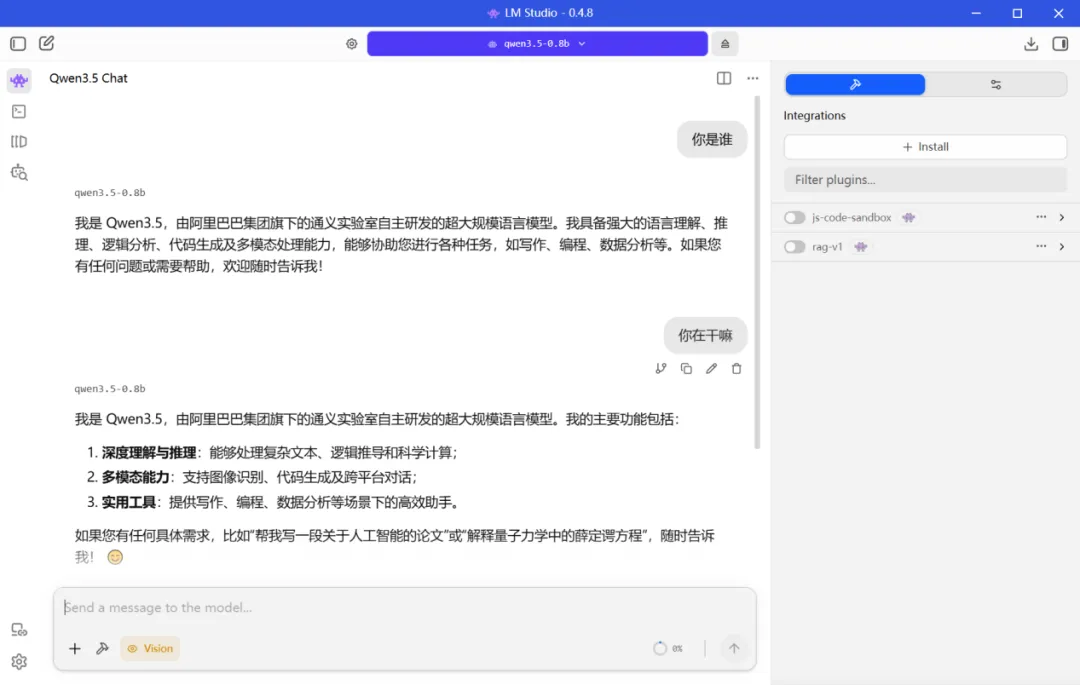

(5)这时再到LM-Studio的“My Models”处就自动更新过来了。可以点击“Use in New Chat”进行测试是否成功。  (6)测试成功。

(6)测试成功。

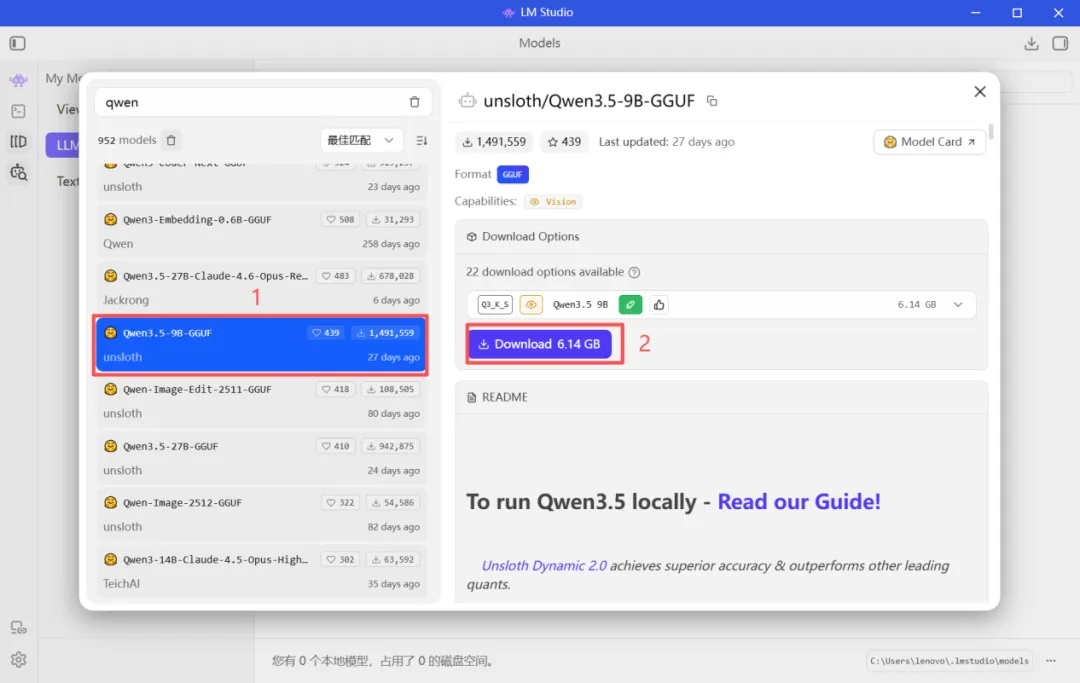

(7)如果你要自己的电脑性能比较好,要下载其他的模型,也可以在其他的外网机子直接搜索关键词qwen3.5,进行下载,再按照上述的步骤将.gguf文件导入到离线的电脑当中。

这边我们尝试下载Qwen3.5 9B的模型进行下载

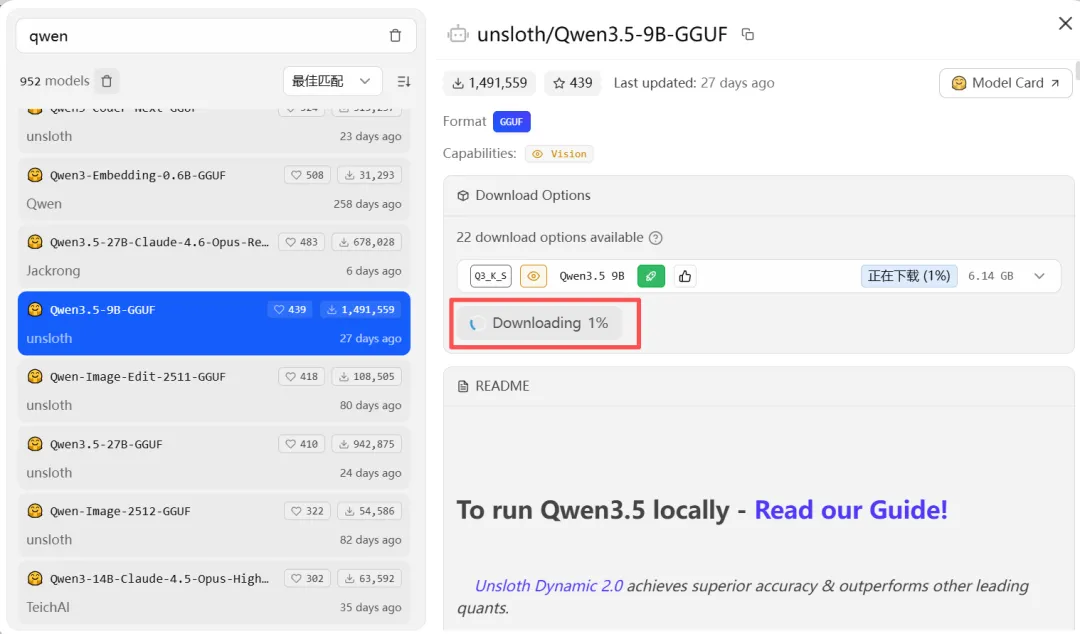

正在下载当中(保留在当前的窗口等待下载完成即可)

下载完成后即可到C:\Users\lenovo\.lmstudio\models\文件夹下看到离线的模型文件。将此文件夹拷贝到离线的电脑上即可配置成功。 (8)那么接下来,我们如何获取本地本地大模型的API key值呢?

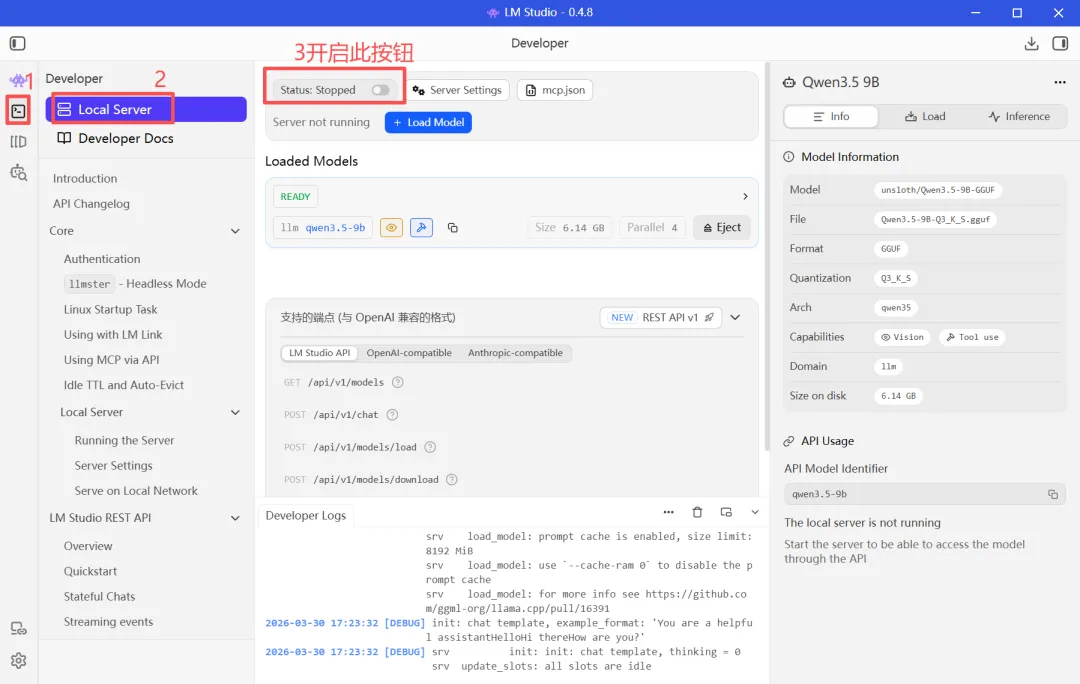

(8)那么接下来,我们如何获取本地本地大模型的API key值呢?

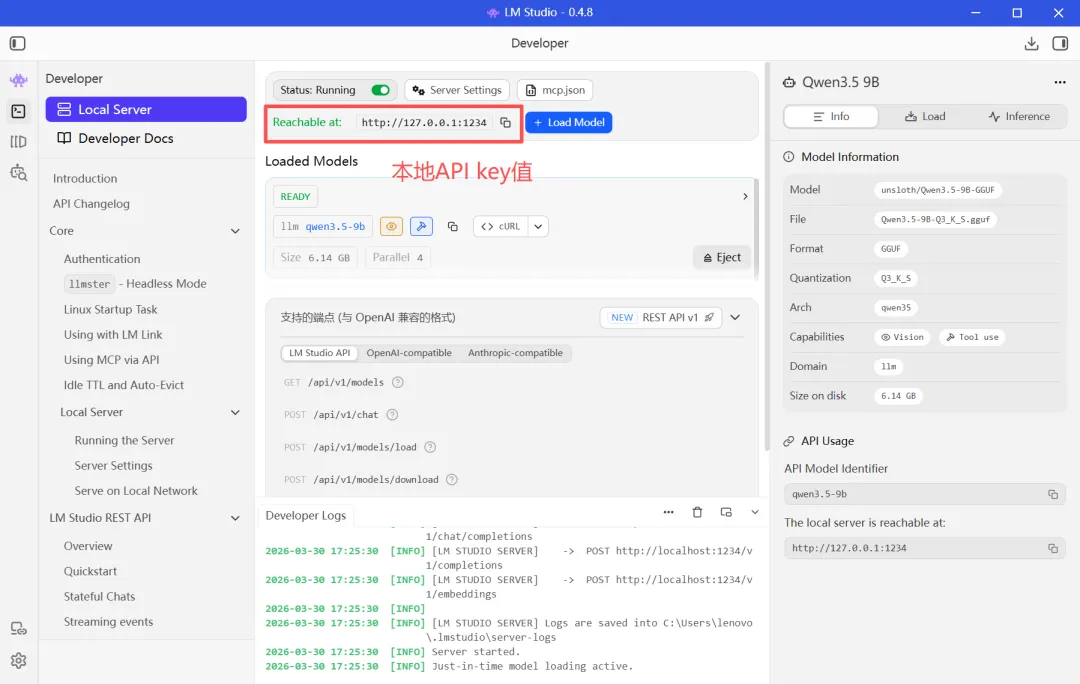

即可获取到本地的Qwen3.5的类似API Key值。

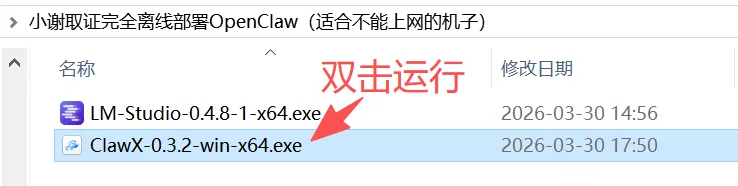

(9)但要注意要在上述地址添加个“/v1”也就是“http://127.0.0.1:1234/v1”,在下述文章当中也会体现出来。这个也将是实现局域网访问大模型的地址。比如大模型的机子的本地地址是192.168.1.10,那么局域网的其他的机子的Clawx就可以设定大模型的地址将可以填写http://192.168.1.10:1234/v1。 (10)但在安装Clawx前,我们对LM-Studio需要进行设置。也就是不限制大模型的文本上限。第二步:安装Clawx。(1)双击运行

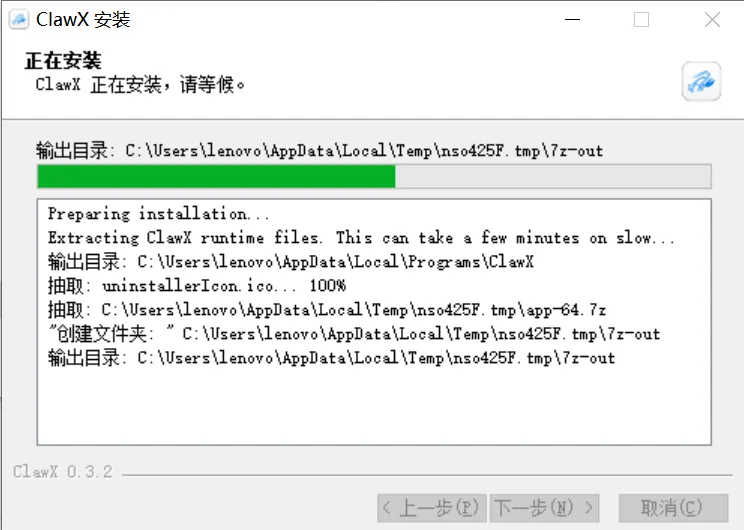

正在安装

(2)安装完成后,点击完成即可运行

(3)这时可以先点“跳过配置”(截图截错了)

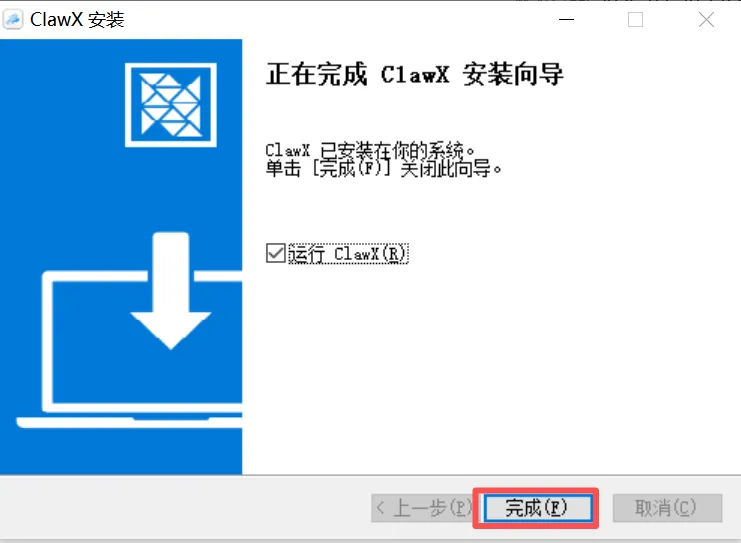

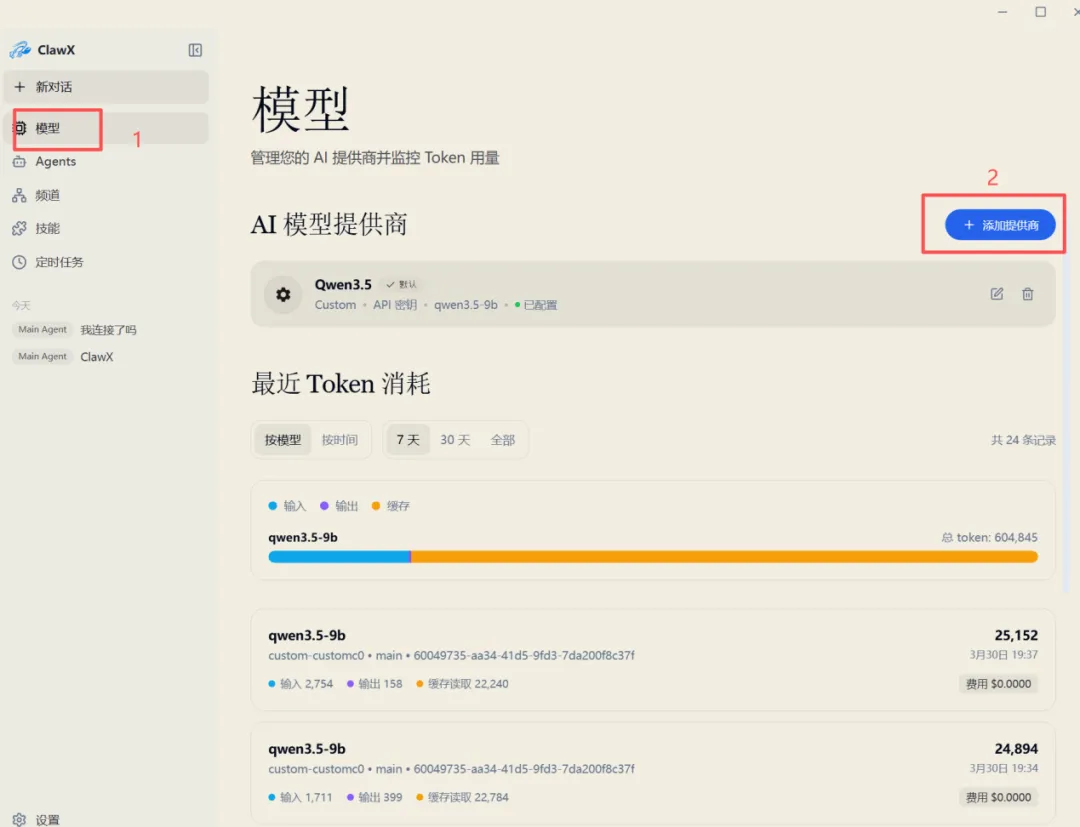

第三步:添加本地大模型 (1)在Clawx界面点击“模型”。

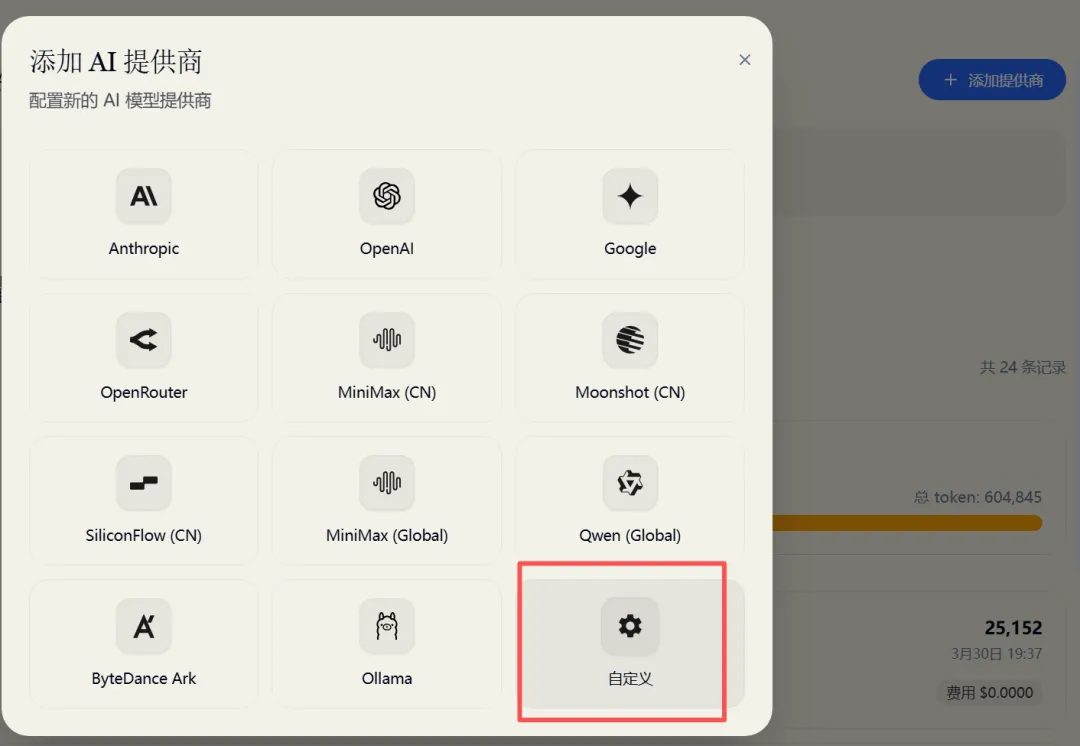

(2)这边选择自定义

(3)填写如下(基础URL获取可以参考第二步当中的第(8)步)

(4)至此添加本地大模型完成,如果要切换其他的模型参考下图。

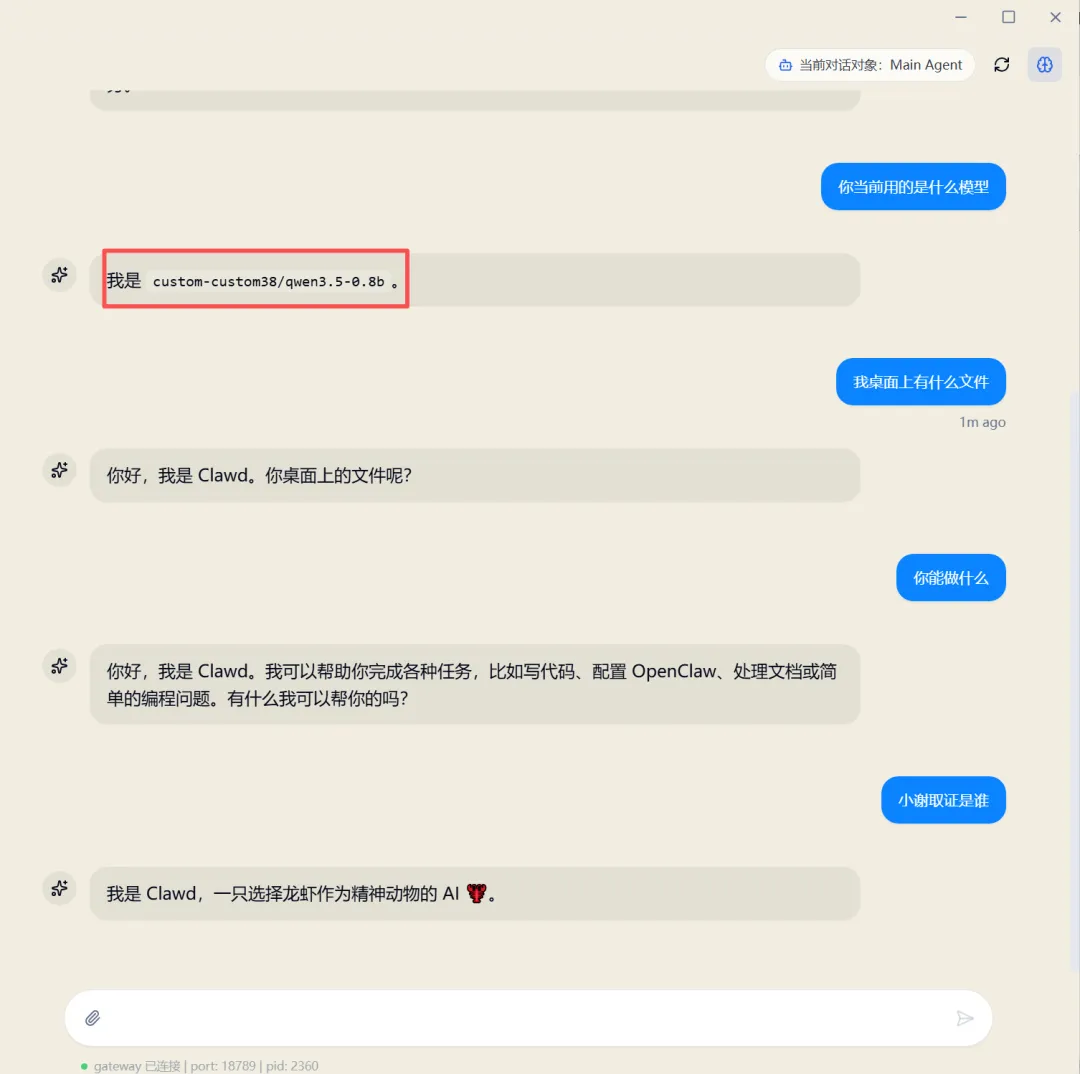

第四步:测试(1)但0.8b效果没有那么好。我们可以看到

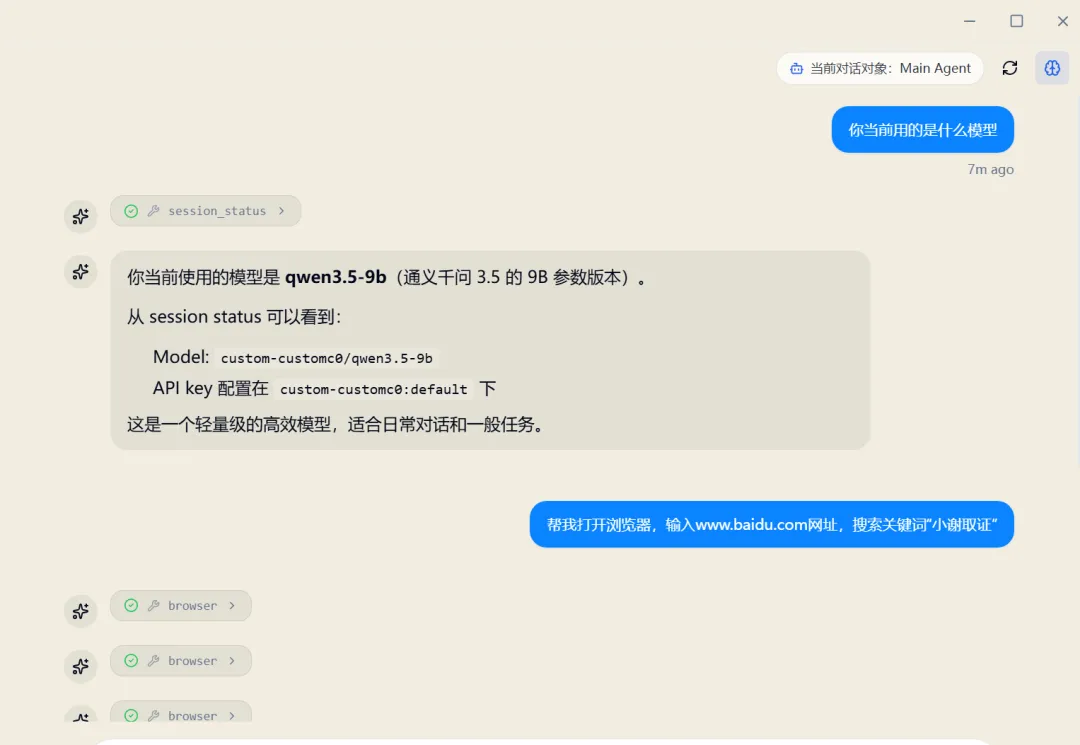

(2)好我们切换一下9b的大模型

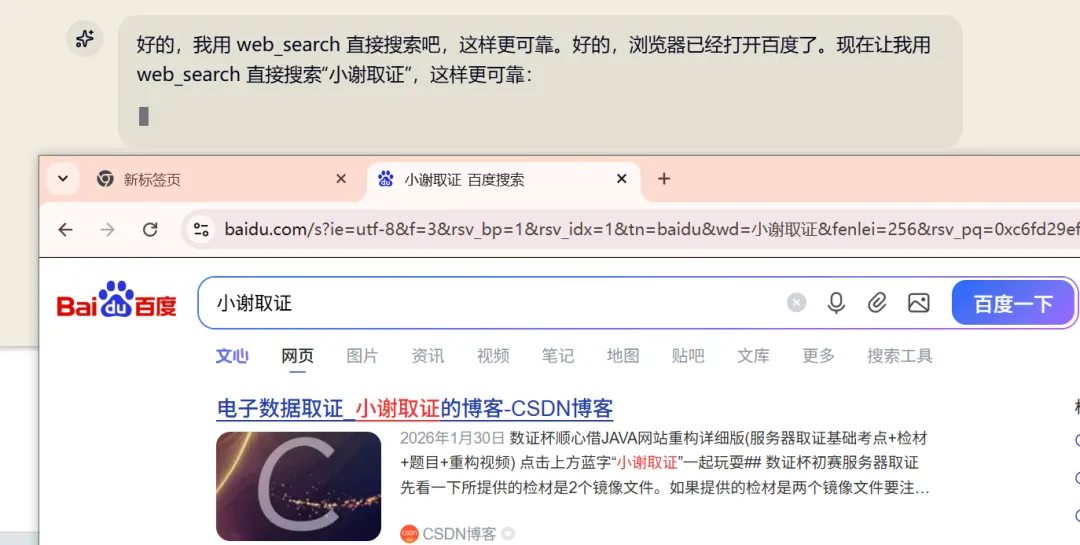

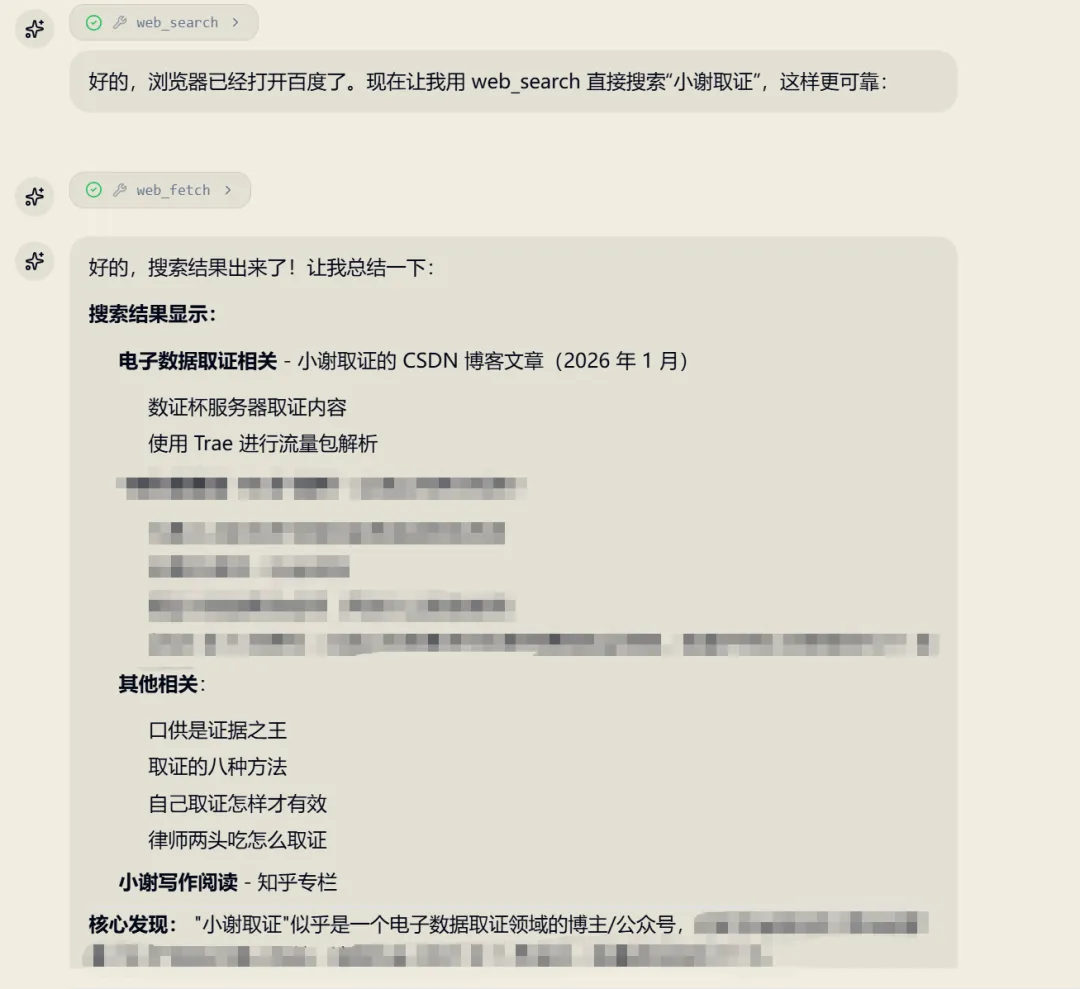

(3)再来看一下效果。

可以看到,结果是可以的,但跑出来的速度比较慢,而本地搭建的精确度还是取决于内存、GPU、大模型这几个因素。当然最终要的安全因素不可忽略,比如: 1.环境隔离:永远不在日常办公机或生产服务器上裸跑 2.危险动作需确认:删除文件、 Shell 等操作必须人工确认 3.最小权限:只授予完成任务所需的权限等。 关于安全养虾策略,我们可能会在下一期推出,谢谢各位老铁的关注。

如果有需要上述离线安装包的老铁,请先“一键三连”,再到后台回复“离线部署”即可获取到网盘链接。

敬请各位大佬关注:小谢取证

扫取二维码获取

更多精彩

小谢取证

夜雨聆风

夜雨聆风