点击蓝字

点击蓝字

关注我们

《护理人看得懂的AI概念说明书:一次打通底层逻辑》篇章五:工具调用,Tool

前面几篇,我们已经把几层基础逻辑慢慢拆开了:AI最核心的“脑子”是什么,它是怎么处理文字的,它为什么看起来像是“记得”前面说过的话,我们又该怎么把任务交代得更清楚。讲到这里,一个更现实的问题就自然冒出来了:AI想把一件事做好,往往离不开足够有效、正确的信息。可这些信息,难道都要靠人一条一条手动喂给它吗?

这恰恰也是大模型下一步能力演进的关键。随着上下文窗口越来越大、任务交代越来越清楚,这个“脑子”的理解、推理和任务组织能力确实在不断增强。它越来越擅长听懂问题、整理信息、分析逻辑,甚至能把复杂任务拆成更清晰的步骤。但再聪明的大脑,也有一个非常明显的限制:它本身无法直接感知外部世界。也就是说,眼前没有的信息,它就拿不到;没有接进来的文件,它就看不到;没有打通的系统,它也查不了。换句话说,大模型虽然越来越会“想”,但它本身还不会真正“动手”。

大家开始希望:能不能让大模型不只是回答问题,而是进一步借助外部能力,把事情往前推进?比如在需要的时候去读取一份文档、查询一条资料、调取一段数据、连接某个系统接口。到了这一步,AI才开始不再只是“围绕眼前这堆字做文章”,而是能够在任务需要时,把外部世界里的信息带回来,再继续处理。

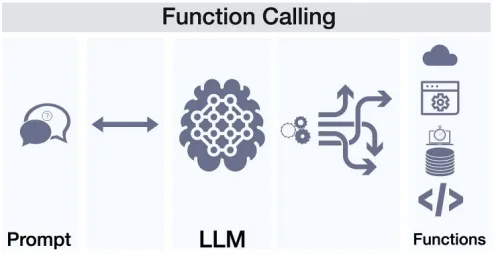

但这里有一个很容易被误解的地方:工具并不是由大模型自己直接去调用的。因为大模型本质上仍然只是一个“输入文字、输出文字”的系统。它不会真的自己伸手点按钮,也不会自己直接连接数据库、打开文档或者执行程序。它能做的,是根据当前任务判断:我接下来需要什么信息、需要哪个动作、需要往哪一步走。然后,它把这个需求表达出来;再由外部的执行层、平台或者程序,把这些文字需求翻译成真实的工具调用动作。

也就是说,中间其实还有一个非常关键的“翻译和执行层”。这个层先读懂大模型输出的文字指令,再把这些指令变成实际动作:去读文件、去查资料、去调系统、去拿结果。等工具执行完成之后,再把结果整理成文字,重新交还给大模型继续理解和处理。大模型拿到新的信息以后,再接着分析、判断、组织下一步输出。

从这个角度看,整个过程其实很清楚:大模型负责思考、判断和组织;外部平台负责执行、调用和反馈。两者配合起来,AI才真正开始从“会聊天”走向“会做事”。

如果用护理工作里的场景来类比,这就更好理解了。你可以把大模型想成一个特别会分析、特别会组织表达的人。你把材料递到它眼前,它很会总结,也很会提炼重点;但如果你没有把材料递给它,它自己并不会起身去档案柜找,也不会自己去系统里查。只有当它旁边接上了“能跑腿的人”或者“能执行的工具”,它才不再只是坐在原地思考,而是能在需要的时候把外部信息调进来,再继续把工作往前做。

比如在护理管理场景里,如果要让AI帮忙整理一次质量分析,它光靠眼前一小段文字,往往是不够的。它可能还需要参考事件经过、制度要求、历史整改记录,甚至某些统计数据。如果这些都要人手动一点点复制粘贴进去,当然也能做,但会很累,也很容易漏。可一旦它能借助外部工具去读取文档、调取资料、连接系统,它的工作方式就不一样了。人更多是在提目标、定方向、做把关,AI则开始承担中间的信息调取、初步整理和结构组织。

这也是为什么现在大家会觉得,今天的AI系统和早期那种纯聊天机器人越来越不一样。过去,它更像一个回答器:你问一句,它答一句;你不给材料,它就只能在有限信息里说。现在,它越来越像一个真正的助手:不只是回答你,还能在任务需要时把资料拿回来,把步骤接上去,把事情往前推进一点。

所以,这一篇真正想讲明白的是:AI之所以开始长出“手脚”,不是因为大模型自己突然会点按钮了,而是因为它开始能够借助外部工具,把判断变成动作,把外部信息带回到眼前,再继续处理任务。

下一篇,我们继续往下拆。因为当工具越来越多以后,很快又会出现一个新问题:不同工具、不同系统、不同平台,各有各的接法,那AI到底怎么才能更顺畅地和这些外部能力对接?

下一篇,我们讲:AI和工具之间,为什么还需要一种“统一语言”。

夜雨聆风

夜雨聆风