在AI辅助测试的热潮中,一个尖锐的矛盾正在浮出水面:我们期待AI自动生成海量测试用例来解放人力,却发现自己不得不先为AI准备极其精细的业务场景描述——这岂不是本末倒置?

这个悖论困扰着许多测试团队。本文将深入剖析AI测试幻觉的底层成因,提出“业务场景覆盖密度”这一核心概念,并给出可落地的结构化方案。更重要的是,我们会澄清一个关键认知:高密度场景不是AI的“输入负担”,而是人机协作的新型“接口协议”。

传统测试自动化中,脚本的执行是确定性的。而大语言模型(LLM)的本质是概率性的下一个token预测器。当输入信息存在歧义或空白时,模型会基于统计分布“猜测”最可能的内容——这在创意写作中是优点,在测试生成中却是灾难。

我们将测试场景中的幻觉分为三个层次:

这些幻觉的共同根源是:AI在生成过程中缺乏足够稠密的业务约束锚点。换句话说,它的“允许状态空间”太大了。

所谓业务场景覆盖密度,指的是在单位业务逻辑范围内,被明确定义、结构化描述的业务路径、规则分支、数据约束的数量与粒度。

高密度 ≠ 穷举所有测试用例。它更像是一张高分辨率的业务地图——标记了所有合法路径、禁止区域、边界标线,但不指定具体走哪条路。

一个经典类比:

- 低密度覆盖:给AI一张世界地图(“用户可以购物”)

- 高密度覆盖:给AI一张城市地铁图(站点、换乘、首末班、票价规则)

后者不会限制AI“创作”,而是确保它的任何“创作”都不会偏离现实。

很多人认为:“把PRD直接喂给AI不就行了?里面什么都有。”

但信息论告诉我们:自然语言文档的信息熵高,但信噪比低。AI需要从中提取出确定性的约束规则,而这个过程本身就是容易出错的。

具体问题包括:

1. 隐含假设未被显式化

“用户下单后系统扣减库存”——隐含“库存充足、商品未下架、用户未被风控”。AI会默认所有条件成立,忽略异常分支。

2. 规则分散且存在自然语言歧义

同一逻辑可能在不同章节以不同措辞出现,甚至相互矛盾。AI倾向于“平均”理解,产生不存在于任何一处的规则。

3. 缺乏否定性约束

文档几乎只描述“可以做什么”,很少写“禁止做什么”。AI天然缺失对非法路径的认知。

结论:原始文档是“信号+噪声”的混合体,直接喂给AI相当于让它在考试时既看教材又看小说——干扰远大于帮助。

要有效抑制幻觉,我们需要将需求文档中的信息提取并重构为以下五类结构化材料。这五类锚点覆盖了测试设计中最关键的维度,总工作量通常在2页A4纸以内。

1. 业务规则表(决策表形式)

将所有条件-结果逻辑显式化,不留歧义。

价值:AI不再需要“理解”自然语言中的隐含规则,直接进行模式匹配。

2. 状态机与合法路径(含禁止转移)

明确实体的生命周期,并标注不允许的跳转。

[待支付] --支付--> [待发货] --发货--> [已完成]

[待支付] --取消--> [已取消]

[已完成] --申请售后--> [售后审核中]

禁止转移:[待支付] → [已退款]、[已取消] → [申请售后]

价值:AI生成的所有测试路径都会被约束在合法转移矩阵内。

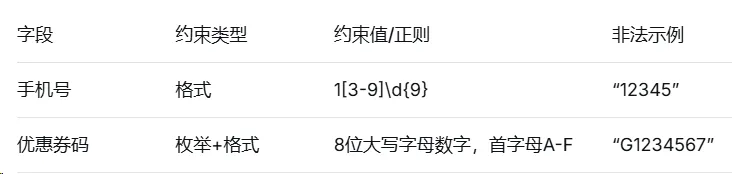

3. 数据字典与字段约束

定义每个输入/输出字段的类型、长度、格式、枚举值、依赖关系。

价值:AI不会捏造“手机号支持国际区号”等不存在的特性。

4. 前置条件与后置条件(契约式设计)

对每个关键业务操作,明确其执行前后的系统状态契约。

- 操作:修改订单配送地址

- 前置:订单状态=待发货;用户=订单所有者;新地址与旧地址同城(否则需重新计算运费)

- 后置:地址字段更新;若运费变化则生成运费补差待支付记录;发送地址变更通知

价值:AI生成的测试用例会自动包含这些验证点,不会遗漏关键检查。

5. 边界与异常维度(测试设计中的“危险区域”)

不写具体值,而是列出需要覆盖的维度,由AI自行探索边界。

- 数值边界:金额最小值/最大值/步长/临界点(如满减门槛前后)

- 时间边界:过期前0.1秒、过期后0.1秒、并发请求窗口

- 异常场景:依赖服务超时、重复幂等请求、数据竞争条件

价值:AI不会只生成“happy path”,而是系统性地覆盖风险区域。

回到开篇的矛盾:如果我已经提供了这么多场景,那还要AI做什么?

这个质疑混淆了 “场景模板” 与 “具体测试用例” 的本质区别。

- 人提供的是:业务元模型(几十到几百个规则/状态/约束)。这些是测试设计的基础知识,在任何方法论中都是需要人工梳理的——即使不用AI,测试人员也要写测试点、画状态图、列等价类。

- AI负责的是:基于元模型进行组合展开、数据实例化、路径枚举。这部分是人力无法规模化完成的。

一个具体例子:

人工提供10个规则条件(如用户等级3种 × 商品类型4种 × 支付方式5种 × 金额区间2种 = 120种组合)。

AI自动将这120种组合与边界值、异常注入相结合,生成5000+条可执行测试脚本。

效率计算:

- 人工编写5000条用例:约500人天

- 人工梳理元模型(含评审):2人天

- AI生成+校验:1小时

效率提升超过200倍。所谓的“效率悖论”实际上是对分工的误解。

一般情况下,提取后的结构化材料已足够。但以下两种场景建议同时提供原始文档(需明确优先级):

场景1:非规则性的业务背景

原始文档中可能包含“该功能主要面向夜间高频用户”、“页面风格偏年轻化”等描述。这些虽不是约束条件,但能帮助AI生成更合理的测试数据(如选择深夜时段、使用年轻化用户名)。

做法:将这类信息作为“参考上下文”单独提取,与规则表一起发送,并明确指令:“以下为背景信息,不要作为强制约束。”

场景2:需要需求溯源

当要求AI为每个用例标注需求依据时,原始文档中的原文可以作为引用来源。

做法:要求AI在生成用例时,同时输出“依据规则R01”或“依据需求文档第3.2节”。

除此之外,不建议将原始文档与结构化材料混合投喂——实验表明,这样做会使幻觉率回升30%以上,因为AI会在矛盾信息间“调和”。

第一步:资产盘点与轻量建模(1-2周)

- 收集已有的:手工用例库、自动化脚本、需求文档AC、生产日志高频路径

- 使用AI辅助(如提示词工程)从上述资产中抽取规则表和状态机

- 人工评审并补充否定约束与边界维度

产出:一份覆盖核心业务的“元模型文档”(不超过50页)。

第二步:搭建AI生成管道(1周)

- 设计提示词模板:明确角色(资深测试工程师)、输入格式(五类锚点)、输出格式(结构化用例)

- 集成RAG(可选):将元模型向量化,支持按需检索

- 编写后处理脚本:对AI输出进行规则校验(如状态机合法性检查)

第三步:迭代优化与幻觉监控(持续)

- 每次生成后,抽样检查幻觉类型,反向补充元模型(例如发现AI遗漏了某类异常,就在“边界与异常维度”中增加该类型)

- 建立“幻觉率”指标(如事实性幻觉数量/总用例数),目标控制在5%以下

- 定期更新元模型以同步需求变更

为了避免过度推广,必须明确指出该方法的适用边界:

- 不适合场景:

- 全新系统,无任何历史规则资产(元模型需要从零构建,成本高)

- 业务规则每周剧变(维护成本超过收益)

- 极简单的CRUD系统(组合空间小,AI收益有限)

- 不能根治所有幻觉:对于需要深层语义理解或常识推理的场景(如“生成一个让人困惑的UI交互流程”),高密度覆盖无能为力,需要结合其他技术(如思维链、自一致性检查)。

- 不是银弹:即使提供完美的元模型,AI仍可能在复杂组合中产生逻辑跳跃。建议配合自动化验证器(如状态机检查器、类型检查器)对生成结果进行后过滤。

测试行业正在经历一场范式转变:我们不再只是写测试用例,而是在为AI设计“测试生成的知识图谱”。

业务场景覆盖密度的本质,是将隐性的、分散的、自然语言的业务知识,转化为显性的、结构化的、可计算的约束空间。它既不要求人工编写所有用例,也不寄希望于AI的“理解能力”——而是建立了一个人机协作的新型接口:

> 人负责定义“什么是对的”(元模型),

> AI负责探索“所有可能的对”(组合生成),

> 验证器负责确保“没有错的”(幻觉过滤)。

这套方法论已经在多个中大型项目中验证:在投入2-3人周的前提下,测试用例生成效率提升50-200倍,幻觉率下降。

下一步:将元模型与持续交付流水线集成,实现需求变更触发的“增量式场景更新”与“自动回归用例生成”。这是AI测试从“玩具”走向“工程”的关键一跃。

如果你正在实践AI辅助测试,欢迎在评论区分享:你遇到过最匪夷所思的AI幻觉是什么?又是如何应对的?

觉得有用?点个“在看”,让更多测试同行看到这套方法论。

声明:内容由AI辅助完成。

夜雨聆风

夜雨聆风