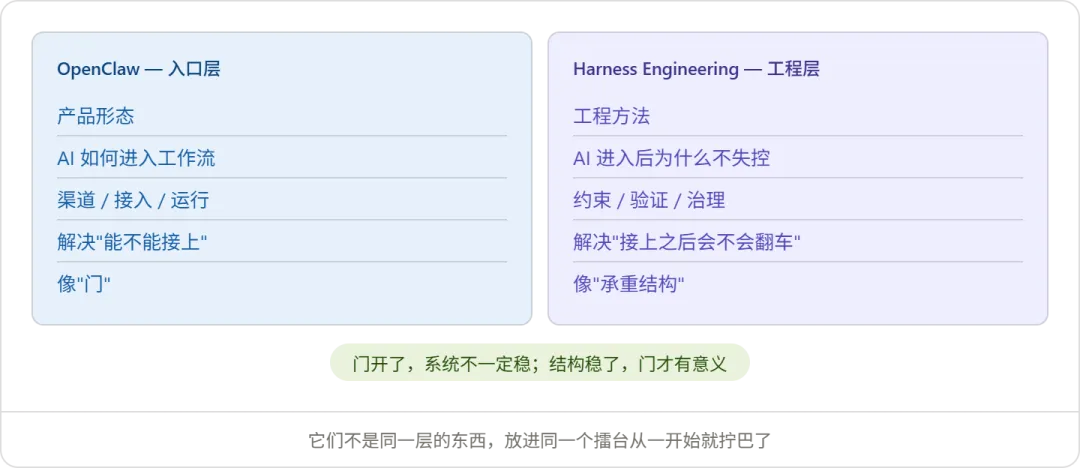

一个解决 AI 从哪里进场,一个解决 AI 为什么能把事做成。把它们放进同一个比较框,从一开始就拧巴了。

最近一段时间,两个词越来越常一起出现。一个是OpenClaw,一个是Harness Engineering。

乍一看,它们都带着一点"Agent 时代新范式"的光环,很容易被放进同一个比较框里。于是问题也跟着来了:到底谁更先进?谁更适合团队?谁才代表下一代 AI 工作方式?

但这个问题,从一开始就有点拧巴。

因为OpenClaw 和 Harness Engineering,本来就不是同一层的东西。把它们硬拉进一个擂台,就像拿"操作系统"去和"项目管理方法"比高低,热闹是热闹,结论多半会跑偏。

真正该问的,不是谁更强,而是:OpenClaw 解决的是什么问题?Harness Engineering 解决的又是什么问题?

01 | OpenClaw 是什么:不是另一个聊天框,而是 AI 的入口层

按照官方文档,OpenClaw 的定位非常明确:它是一个self-hosted gateway,强调"runs on your hardware, your rules"——运行在你自己的硬件和规则之下;支持multi-channel,可以把多个聊天渠道接到同一个 Gateway 上;同时强调agent-native,把工具调用、会话、记忆、多 Agent 路由这些能力作为原生能力来组织。

这意味着,OpenClaw 解决的不是"模型聪不聪明",而是更靠近现实的一层问题:

你的 AI 助手能不能常驻在线?能不能接进 Telegram、Slack、Discord、手机端、桌面端这些已有入口?能不能挂载 skills,调用工具,把一次聊天变成一段持续的工作流?

从官方 CLI 文档和 GitHub README 看,OpenClaw 甚至把 openclaw onboard 作为推荐起手方式,围绕网关、工作区、渠道和 skills 做初始化——这很能说明它的核心身份:

它是 AI 助手的"运行平台"和"接入壳"。

理解 OpenClaw 最好的方式,不是把它看成"一个更潮的 AI 工具",而是把它看成:把 AI 接进现有通信系统和个人工作流的一层基础设施。它关心的是入口、渠道、连接、常驻、编排和扩展,它要解决的是"AI 怎么进场"。

02 | Harness Engineering 是什么:不是一个产品,而是一种工程观

Harness Engineering 则完全是另一回事。

OpenAI 在 2026 年 2 月发布的文章里,用 Codex 做了一个很强烈的实验:在五个月里,用"0 行人工手写代码"作为约束条件,去构建并交付一个内部 beta 软件产品。这个实验背后的重点,不只是"模型能写代码",而是人的工作开始转向设计环境、组织约束、搭建反馈回路、构建可持续的 agent-first 开发方式。

Martin Fowler 之后对这个概念做了更清晰的提炼,讨论的重点并不是"让 AI 更自由",而是"如何增加我们对 coding agent 结果的信任"——也就是如何让 agent 在更少监督下工作,但不把团队拖进一片不确定的沼泽。

LangChain 对这个概念的定义尤其干脆:Agent = Model + Harness,并且明确写道,harness 是除模型本身之外的代码、配置和执行逻辑。一个裸模型不是 agent,只有当它被状态、工具执行、反馈回路和可执行约束包起来,它才真正成为一个 agent。

所以,Harness Engineering 不是某个具体产品,也不是某个框架的专有名词,它更像一种新的工程观:

在 Agent 时代,工程师的核心价值,正在从"直接产出代码"转向"设计让 AI 稳定产出结果的系统"。

03 | 它们真正的差别,不是强弱,而是分工

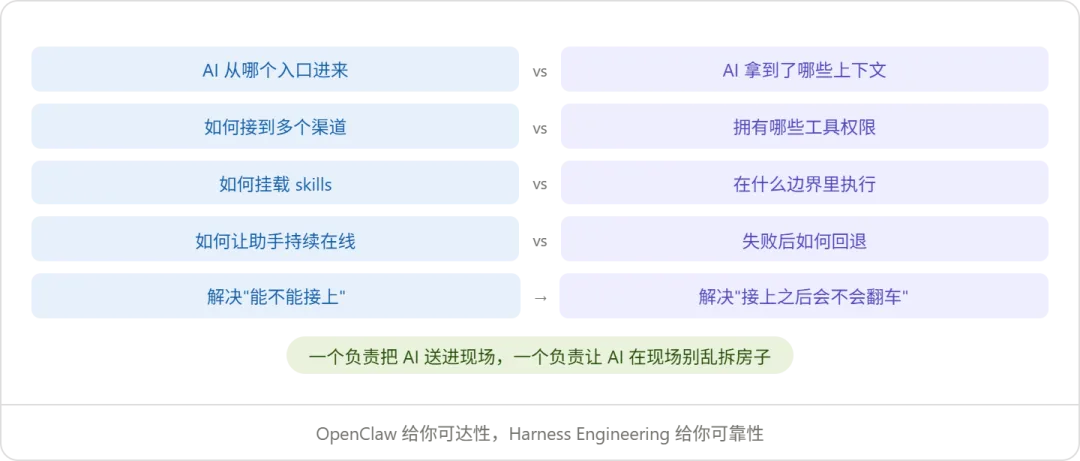

如果一定要把它们放在一张图里看,最准确的关系不是对立,而是分层。OpenClaw 更像接入层 / 交互层 / 运行层,Harness Engineering 更像约束层 / 验证层 / 治理层。

说得再直白一点:OpenClaw 解决"能不能接上",Harness Engineering 解决"接上之后会不会翻车"。一个负责把 AI 送进现场,一个负责让 AI 在现场别乱拆房子。

04 | 为什么很多人会把两者混为一谈

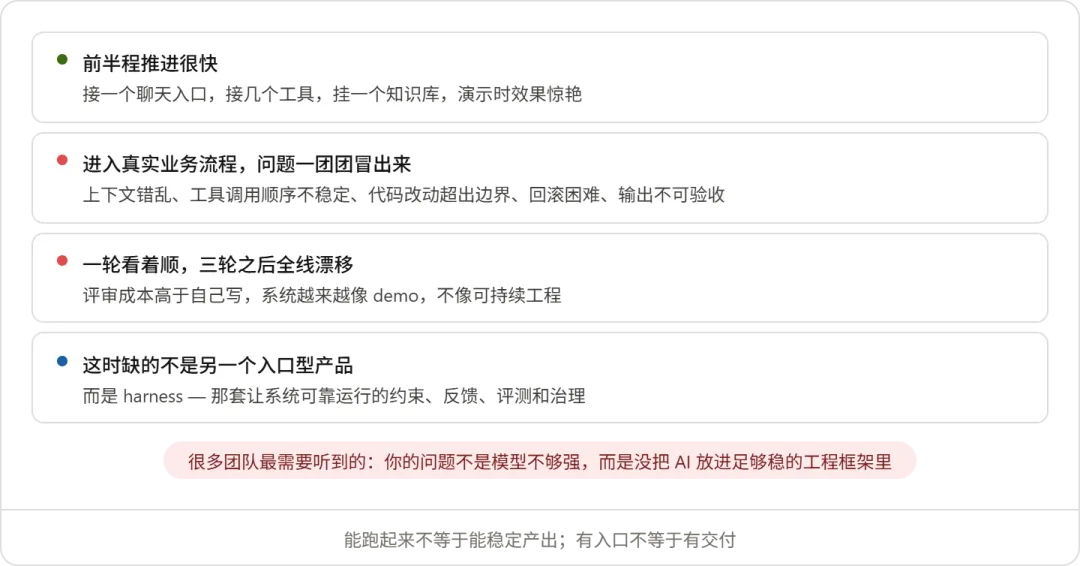

因为在 AI 语境里,大家太容易被"能跑起来"这个瞬间迷住。

一个系统只要能聊天、能调工具、能连 IM、能执行几个技能,看起来就已经很像"完整的 Agent 体系"了。

但问题恰恰在这里。能跑起来,不等于能稳定产出。有入口,不等于有交付。

这是很多团队最容易踩的坑——前半程往往推进得很快:接一个聊天入口,接几个工具,挂一个知识库,演示时效果惊艳。可一旦进入真实业务流程,问题就一团团冒出来。这时你就会发现,缺的往往不是另一个入口型产品,而是harness——不是再接一个"壳",而是补上那套让系统可靠运行的约束、反馈、评测和治理。

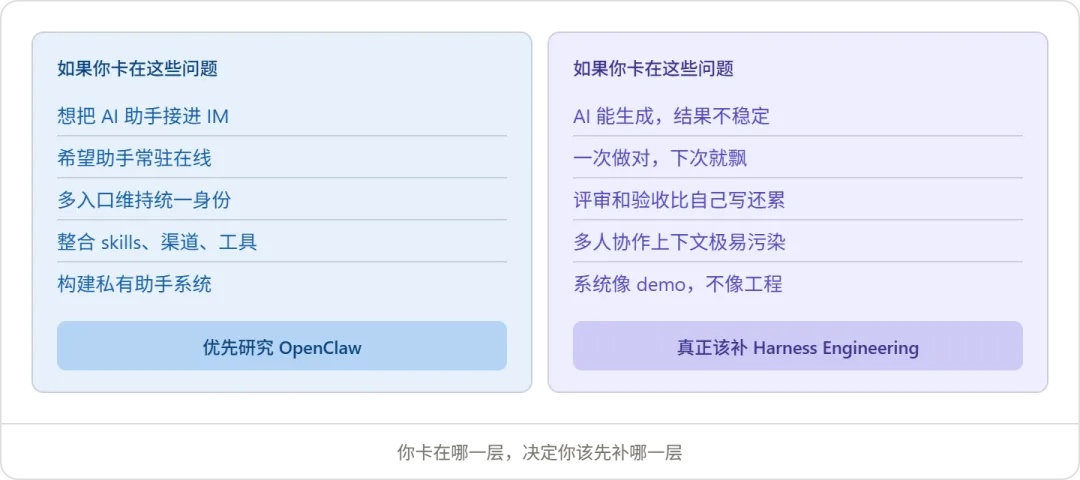

05 | 到底谁适合你,取决于你卡在哪一层

如果你现在卡的是:想把 AI 助手接进 Telegram、Slack、Discord 或手机端,希望助手常驻在线而不是每次临时打开一个网页,想让一个 AI 在多个入口维持统一身份和能力——那你面对的是入口接入问题、渠道统一问题、运行平台问题,应该优先研究 OpenClaw 这一类东西。

但如果你现在卡的是:AI 能生成,但结果不稳定,一次能做对,下一次就飘,评审和验收比自己写还累,多人协作时上下文极易污染,系统越来越像 demo,不像可持续工程——那你真正该补的是 Harness Engineering,因为你面对的是工程控制问题、上下文组织问题、反馈闭环问题、人机协作边界问题。

很多团队最需要听到的一句话其实是:你现在的问题,不一定是模型不够强,也不一定是工具不够新,而是没有把 AI 放进一个足够稳的工程框架里。

06 | 真正成熟的做法,不是二选一,而是上下叠加

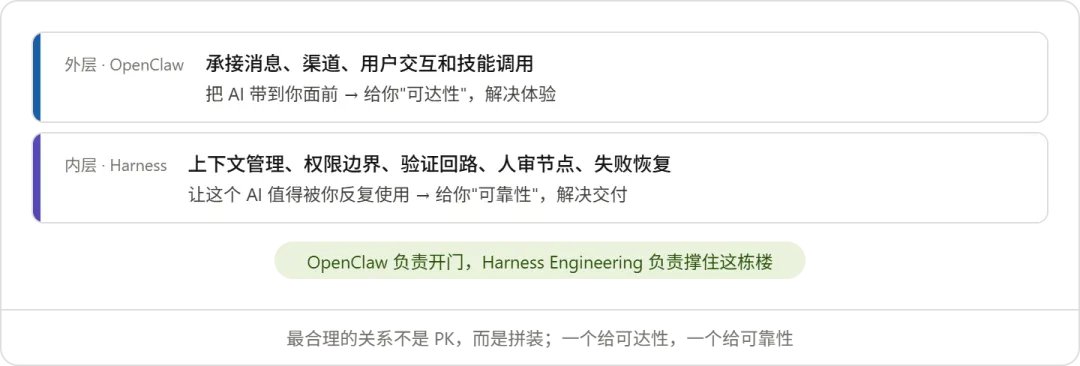

把话说回来,OpenClaw 和 Harness Engineering 最合理的关系,不是 PK,而是拼装。

一个成熟的 Agent 体系,很可能长这样:外层,用 OpenClaw 这样的入口平台承接消息、渠道、用户交互和技能调用;内层,用 Harness Engineering 的思路去设计上下文管理、权限边界、验证回路、子代理分工、人审节点和失败恢复。

OpenClaw 负责把 AI 带到你面前,Harness Engineering 负责让这个 AI 值得被你反复使用。前者给你可达性,后者给你可靠性;前者解决体验,后者解决交付。

当团队还在找入口时,OpenClaw 很有价值。当团队已经把 AI 接进系统,却发现越用越乱时,Harness Engineering 才是那个真正决定天花板的东西。

写在最后

这两年,大家对 AI 的热情像洪水一样往前冲。谁先接上,谁先演示,谁先做出一个看起来能跑的东西,谁就更容易被看见。

可真正决定系统寿命的,往往不是那一层最亮眼的入口,而是入口背后那套不那么显眼、却一直在兜底的结构。

OpenClaw 的价值,在于把 AI 从孤零零的网页聊天框里解放出来,让它真正进入你的通信系统和工作现场。Harness Engineering 的价值,在于承认 AI 天生不是一个稳定、可预测、自动服从边界的工程成员,于是我们必须围绕它搭起一整套护栏、反馈、权限和验证机制。

OpenClaw VS Harness Engineering这个问题,真正的答案其实很简单:

它们不是谁替代谁,而是谁负责开门,谁负责撑住这栋楼。

门能不能打开,很重要。但楼能不能住人,才决定系统最终有没有价值。

AI 时代,最容易被高估的是入口,最容易被低估的是结构。

夜雨聆风

夜雨聆风