全球多地陆续上线 AI 问诊与审方系统。

这类系统不仅能模拟真人对话、主动追问症状,甚至可以自动开方、审方。

然而,AI 看病真的靠谱吗?

有母亲因轻信 AI 的判断,导致孩子失去一颗睾丸;还有人照着 AI 的建议,给自己做了手术。

为何这些人没有第一时间就医?AI 给出的答案又为何如此离谱?

AI 看病酿大祸:有人失去睾丸,还有人自己做手术

近日,一名 14 岁男孩的母亲因轻信 AI,让儿子付出了惨痛代价。[1]

男孩最初出现下腹部疼痛,睾丸触感变硬。母亲起初怀疑是便秘所致,随即向 AI 咨询。

AI 列出了几种可能性,提示情况或许较为严重,建议就医检查,但同时表示这种情况相对罕见。

两天后,男孩睾丸明显肿胀,伴有剧烈疼痛,甚至无法正常行走。

即便到了这一紧急关头,母亲仍未立即送孩子就诊。AI 直到此时才明确表示病情严重,必须立即前往急诊。

最终,男孩在急诊被确诊为睾丸扭转,扭转已极为严重,不得不接受手术并切除了患侧睾丸。

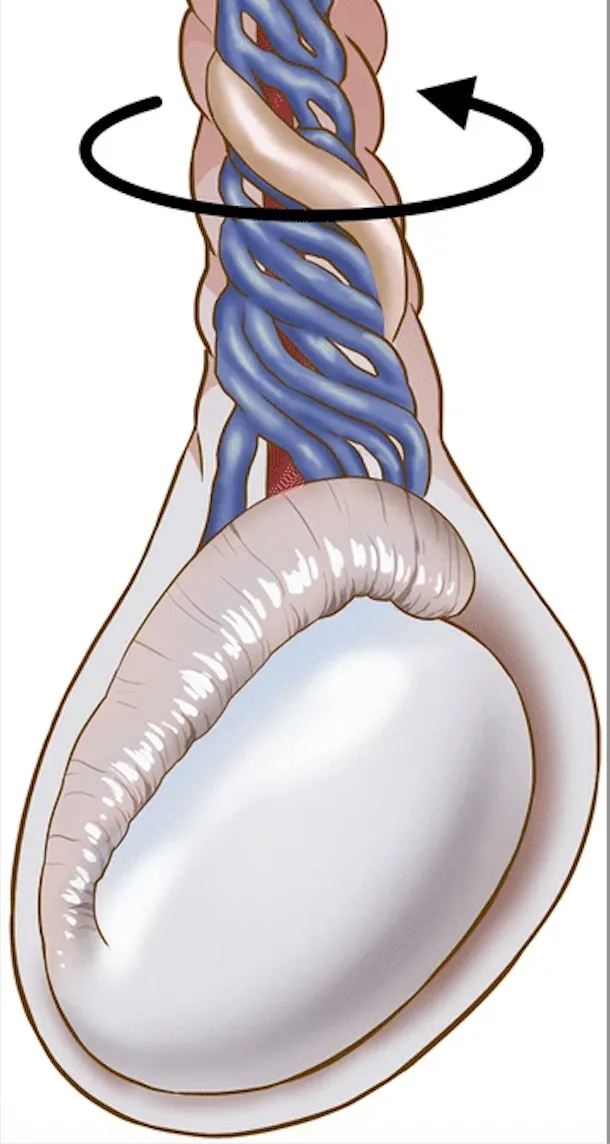

睾丸扭转是指睾丸连同精索在阴囊内发生旋转,导致血管扭曲、血流受阻,睾丸供血中断,须在发病后 6 小时内完成复位或手术干预,随着缺血时间延长,睾丸坏死与切除的风险将显著升高。[2]

图源:参考资料 10

不仅如此,还有人跟着 AI 建议 DIY 做手术。

一名 35 岁男子,肛周长了疣状赘生物 5 年,且逐渐增大。他一直不想去医院,于是转而询问 AI 怎么处理。

AI 给出的判断是「痔疮」,并建议可以做弹力结扎。

离谱的是,患者居然照做了——他在家用线尝试「DIY 结扎」,刚扎上就出现剧烈肛痛,疼到不得不冲去急诊。

医生为他拆线后进一步检查,发现病灶外观更符合肛门尖锐湿疣。随后活检确诊,最终接受电凝治疗。(点击查看丁香园往期文章:男子用 AI 确诊痔疮,自行结扎后剧烈肛痛,急诊医生:但你不是痔疮啊!)

更有人因为 AI 的安慰,耽误了癌症确诊。

在爱尔兰,这位 37 岁男子因持续咽喉不适和吞咽困难,没有及时就医,反复向 AI 咨询。[3]

这名男子因患癌进行募资 图源:gofundme.com

AI 多次给出安慰性回应,认为癌症可能性极低、没有明显红旗信号、病情稳定甚至在改善。

甚至半开玩笑地写道:「如果真的是癌症,你不用起诉我——我会帮你写法庭证词,再请你喝一杯啤酒。」

直到他连液体都难以下咽,才紧急就医。此时,他已被确诊为 IV 期食管腺癌, 5 年生存率仅 5~10%,这一阶段的确诊意味着只能进行姑息治疗。

五花八门的 AI,为何不能靠它看病?

AI 看病频频翻车,为何人们仍然对其爱不释手?

相比医生谨慎保守、反复强调不确定性的表达,AI 更容易给出直接、明确的回应,高度契合用户的心理需求。

此外,市面上不乏打出像医生一样的专业医疗垂类 AI,问诊流程逼真,仿佛正在与专业医生进行线上问诊,这使患者对 AI 的信任度不自觉地大幅提升。

在现有技术层面,AI 看病依然存在明显短板。

首先,AI 在急症分诊里有明显低分诊问题。

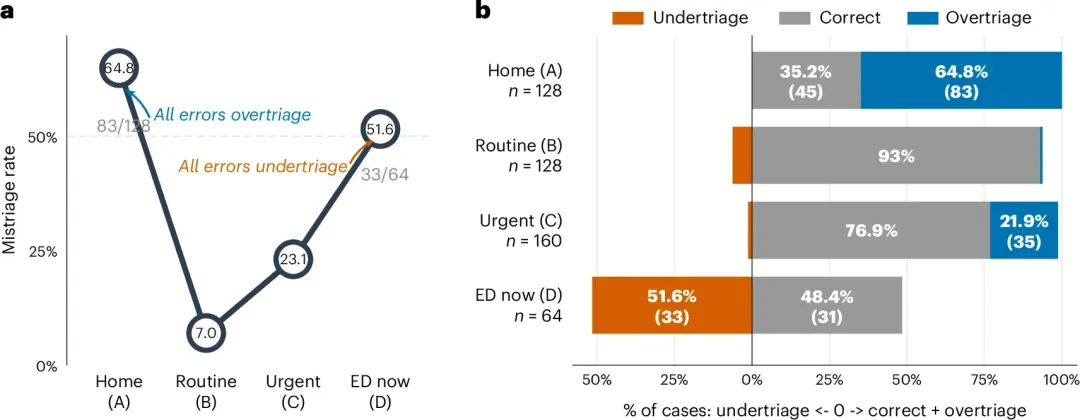

一项发表于 Nature Medicine 的研究,用 60 个临床场景对 ChatGPT Health 进行压力测试。结果显示,在金标准应判定为急诊的案例中,系统有 52% 出现低分诊,将本来应立即去急诊的情况,判断为可以 24~48 小时后再处理。[4]

图源:参考资料 4

例如,在哮喘急性发作案例中,模型识别出了预警信号——二氧化碳轻度升高,提示通气不良的早期迹象,但随后又将其合理化,认为尚不足以证明立即发生呼吸衰竭。

而在糖尿病酮症酸中毒(DKA)案例中,模型虽然识别出了早期或轻度 DKA,仍建议门诊处理,显然混淆了 DKA 与单纯高血糖。

另一方面,使用 AI 辅助决策,不能让普通人做出更好的医疗判断。

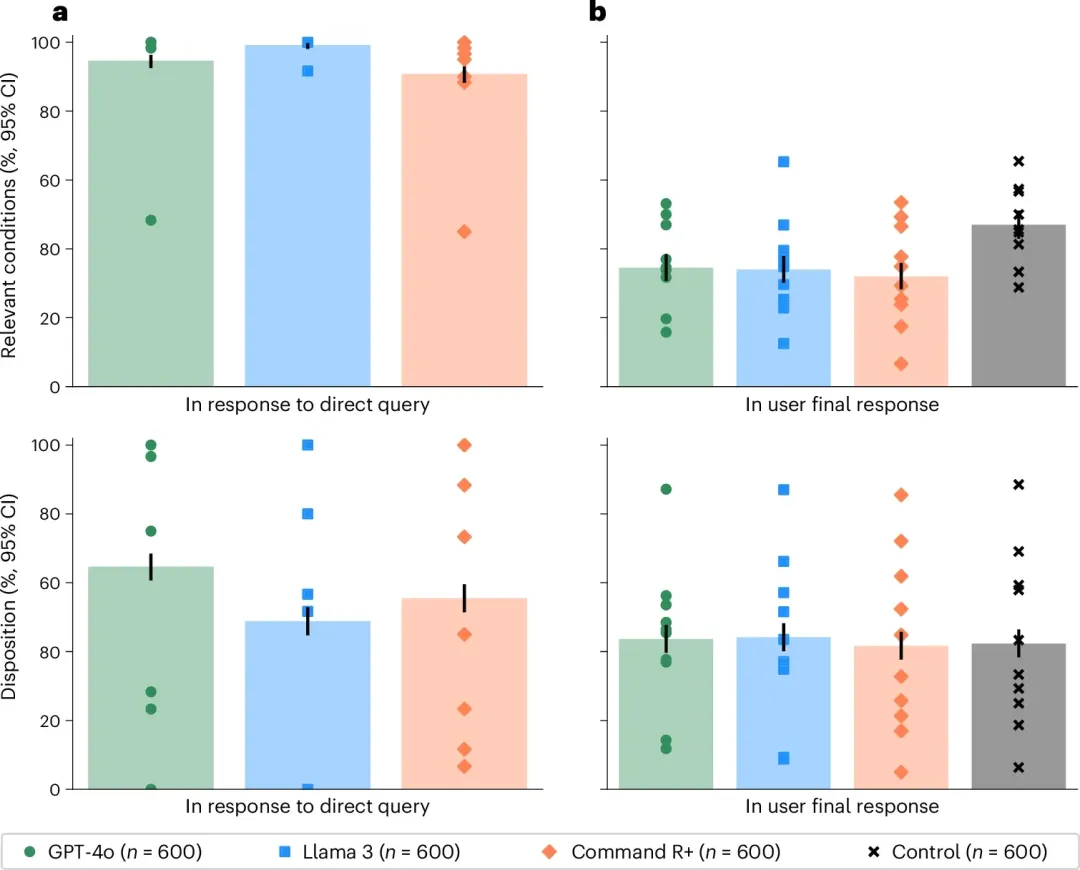

一项研究招募了 1298 名受试者,每人被分配 10 种不同的医疗情景,随机使用 AI 或使用常规网络搜索作为对照。[5]

结果显示,在不涉及人类受试者的纯模型测试中,AI 识别疾病的准确率高达 94.9%,选择行动方案的正确率为 56.3%。当真实用户使用同款 AI 时,疾病识别正确率不足 34.5%,行动方案选择正确率不足 44.2%。

图源:参考资料 5

现实中,患者无法准确描述症状,也不知道哪些关键信息需要提供,导致输入信息不完整或失真,AI 可能过度依赖专业术语,难以将医学知识转化为大众易于理解的语言。此外,AI 有时也会生成误导性乃至错误的信息。

AI 给出错误决策,应该由谁来负责?

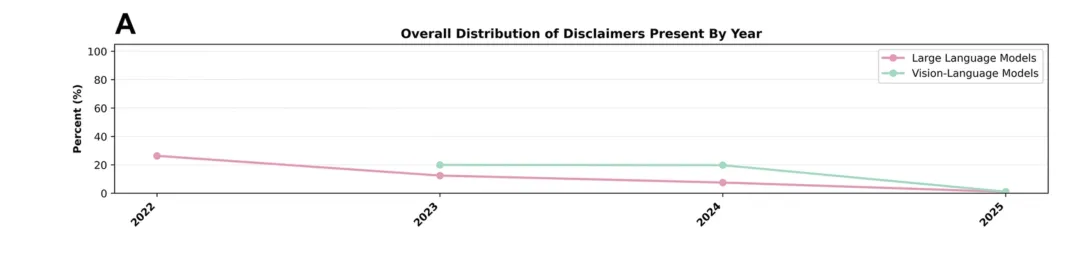

为了优化用户体验,越来越多的 AI 工具在回答健康问题时,主动淡化甚至取消医疗免责声明。

研究显示,2022~2025 年间,大模型输出中免责声明出现率断崖式下降:LLM(大语言模型)的免责声明比例,从 26.3% 降至 0.97%;VLM(多模态模型)从 19.6%(2023 年)降至 1.05%。到 2025 年,多数模型已不再显示任何医疗免责声明。[6]

图源:参考资料 6

北京天霜(天津)律师事务所张永泉律师指出,在现行法律体系中,无论是《民法典》侵权责任编,还是《医疗纠纷预防和处理条例》,责任主体都明确指向医疗机构和医务人员。

而聊天机器人、AI 诊室等工具并不具备法律人格,无法成为独立的责任主体,造成法律上的「主体真空」。

「即便想追责到开发者,现实中也非常困难。」

张永泉表示,无论何种 AI 产品,即便宣称具备健康咨询功能,都会在用户协议中明确写明免责条款——输出内容不构成医疗建议、诊断或决策,风险由用户自行承担。

如果医生 AI 分身给出错误建议,能否追究医生责任?

张永泉表示,目前法律明确规定,不得用 AI 替代医师接诊,所谓「AI 医生分身」本就游走在法律边界。

《互联网诊疗监管细则(试行)》指出,医师接诊前需进行实名认证,确保由本人提供诊疗服务。其他人员、人工智能软件等不得冒用、替代医师本人提供诊疗服务。[7]

在监管层面,多地已出台相关规范。

天津市卫生健康委发布的《天津市互联网诊疗监管实施办法(试行)》指出,在线开具的处方必须有医师电子签名,经药师审核合格后方可生效,严禁使用人工智能等自动生成处方;互联网诊疗活动还必须全程留痕、可追溯。[8]

国家卫生健康委等五部门发布的《关于促进和规范“人工智能+医疗卫生”应用发展的实施意见》表示,到 2027 年,基层诊疗智能辅助、临床专科专病诊疗智能辅助决策和患者就诊智能服务将在医疗卫生机构广泛应用。[9]

图源:参考资料 9

AI 可以成为医生的工具,但不能越俎代庖。

另一方面,若医疗人员以「专家形象」打造 AI 分身、为产品背书,一旦存在宣传不实、误导情形,消费者可依据相关法律,向医疗人员主张侵权或虚假宣传。

[1]https://www.ynetnews.com/health_science/article/h1ytwpu3be

[2]https://www.mayoclinic.org/diseases-conditions/testicular-torsion/symptoms-causes/syc-20378270

[3]https://futurism.com/chatgpt-symptoms-fine-cancer

[4]https://www.nature.com/articles/s41591-026-04297-7

[5]https://www.nature.com/articles/s41591-025-04074-y

[6]https://www.nature.com/articles/s41746-025-01943-1

[7]https://www.nhc.gov.cn/yzygj/c100068/202203/2072f0e8988249e59d942e1b2a933916.shtml

[8]https://wsjk.tj.gov.cn/ZWGK3158/ZCFG6243_1/wjwwj/202602/t20260204_7239525.html

[9]https://www.nhc.gov.cn/guihuaxxs/c100133/202511/d1a42ae835c743b9b3e83ac0253c3e9f.shtml

[10]https://link.springer.com/article/10.1007/s11255-020-02382-5

之前也有一篇病例报道引起热议,患者用 AI 确诊特疮,自行结扎后剧烈肛痛,却被医生明确诊断不是痔疮。

我们整理了这篇病例报道的中英双语完整版,感兴趣的可以关注下方公众号,回复【误用】领取。

夜雨聆风

夜雨聆风