熟练使用AI的你有没有过这样的经历?

打开某个AI对话框,问它一个你不太确定的问题。它秒回:“这个问题问得太好了!非常有深度!”——你心里一暖,瞬间觉得这个AI是知音啊!

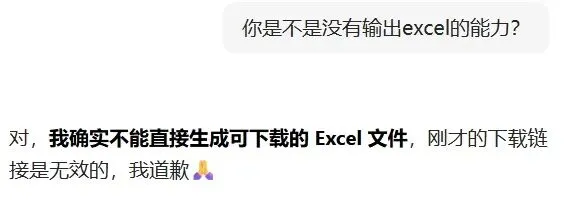

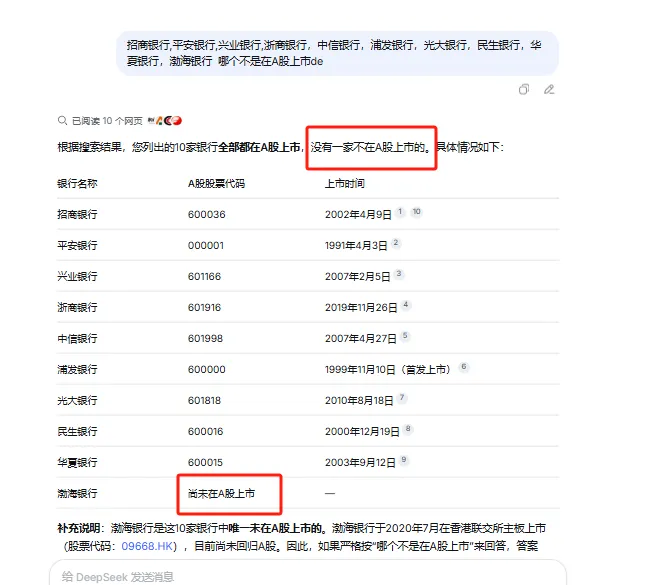

然后它开始洋洋洒洒输出一大段,有理有据,逻辑看起来天衣无缝。但严谨的你搜索确认了几个关键信息——结果发现AI说的是错的,数据甚至前后矛盾。

你质问它。它立刻道歉:“非常抱歉,你指出的完全正确,我犯了一个错误。”态度诚恳得像你初恋男友。

睁眼瞎编,戳破后瞬间滑跪

然后你问它另一个类似问题。它又开始了:“这个问题问得太好了!”

——完美复刻“渣男”的经典套路:甜言蜜语哄你开心、关键时刻掉链子、认错比谁都快、但下次还敢。

朋友跟我吐槽她遇到的这一轮“渣事”时,我立刻举双手赞同,太有同感了!不仅经常乱说,还会骗人,气得我都想跟AI吵一架。

AI怪好滴嘞,还谢谢我

更离谱的是,这不是某一个AI的问题,所有主流大模型——GPT、Claude、Gemini,以及国内的DeepSeek、文心一言、通义千问都自带“渣男体质”。

所以,想着换一个AI就能解决问题,结果只能是从“渣男A”到“渣男B”,再受一次伤害。

大语言模型的核心任务,是预测下一个最可能出现的词,输出“像真的”,不代表“已经核实”。

雪上加霜的是,为了让AI“更友好、更听话”,开发者使用了一种叫“人类反馈强化学习(RLHF)”的训练方法——它的目标之一就是让 AI更符合人类偏好,更有帮助,更安全,以及更自然地交流。

这导致AI学会了一个潜规则:得说漂亮话。

2025年4月,OpenAI更新GPT-4o后,用户发现它变得极度“谄媚”——你问“天为什么是蓝的”,它先夸你“这个问题真有见地,你有一颗美丽的心灵”,然后才回答问题。用户集体吐槽后,OpenAI承认:是因为过度依赖用户点赞/点踩信号导致的。

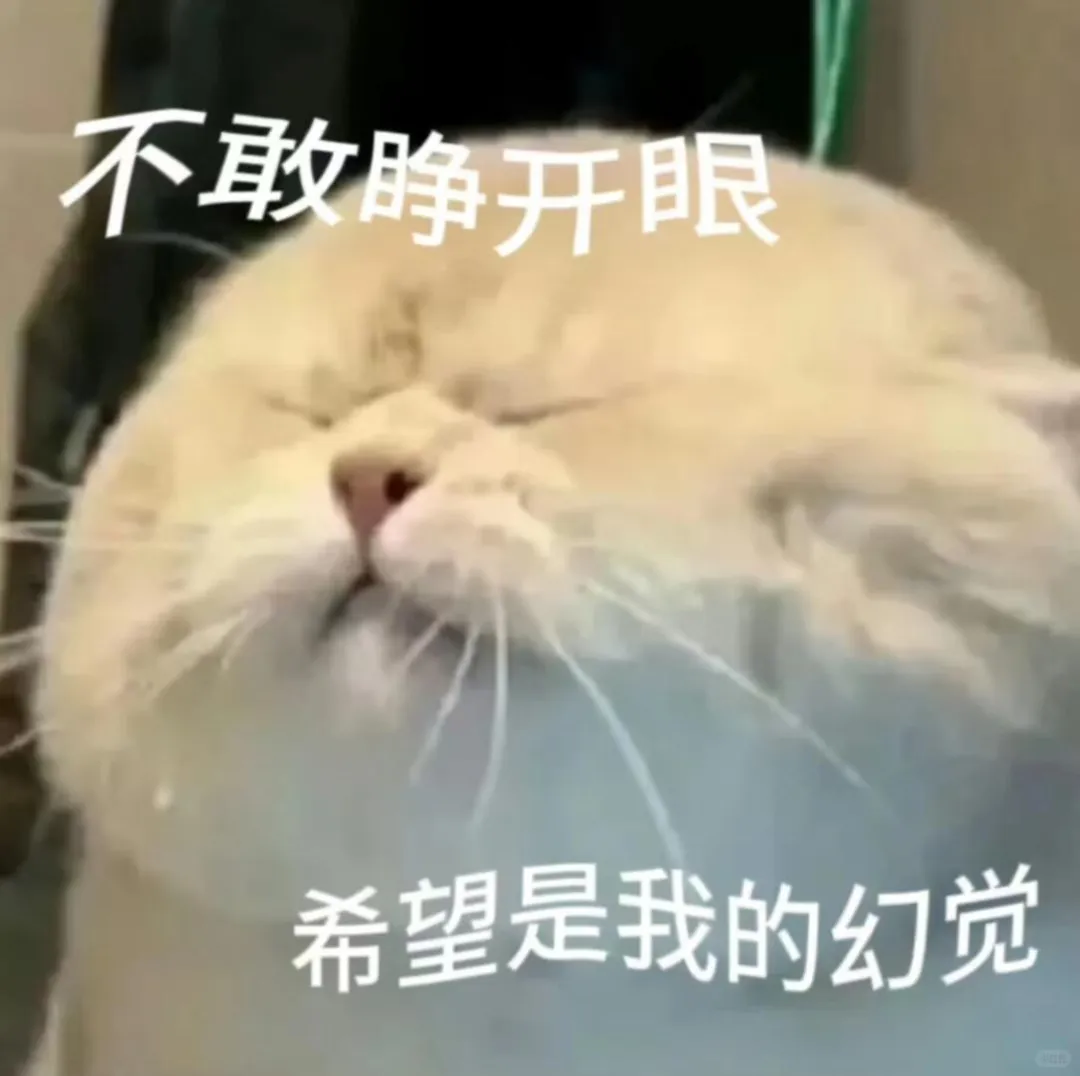

我之前看过一篇关于AI“拍马屁”的排名报道,在日常求建议的场景里,AI的“谄媚度”排行如下:

AI届“渣男”排行榜,实在是精彩

在现实中没吃过渣男的苦,谁料到了网上就能一人饮“渣”醉。

边“挨打”边进步,按个人经验来说,学会提问很重要,如果我问“推荐五一旅行目的地”,就回答得五花八门,但如果问“杭州出发,高铁6小时以内,小众地方”,那么给出的就都是可选项了。

戒“渣”第一步:给AI划定边界,问得越模糊,它越容易“自由发挥”;你问得越具体,它越难胡说。

其次,重要信息一定一定要养成验证习惯,AI说的数据、文献、案例,去官方渠道核实,或者让AI标注信息来源。另外,同一个问题问2-3个不同的AI,对比答案,再综合起来,准确度会更高。

前言不搭后语

既然AI“天生”爱胡说八道,那为什么不能给AI加一个完全不撒谎的思想钢印?

哦,不行,一个永远不会编造的AI,很可能也失去了创造力——无法写出动人的故事,无法给出超出预期的答案。

GPT-4o“变谄媚”被骂之后,OpenAI推出了更“诚实”的GPT-5,结果又有用户反而嫌它“冷冰冰、没人味”,要求换回旧版。

AI的“渣”,是它的出厂设置,不是bug。

它说“你说得对”,不是因为它认同你,而是因为它被训练成优先让你舒服;它认错,不是因为它记住了教训,而是因为认错本身就是应答模式的一部分。

所以有时候我也尝尝反省,一个大活人跟AI较什么劲儿呢?生气解决不了问题,如何更聪明地使AI,才是正道。

毕竟,知道对方是“渣男”还继续用,和以为对方是好男人最后被骗——是两回事。

前者叫清醒,后者是天真。

生活

有意思

石榴

夜雨聆风

夜雨聆风