本文梳理了该指南的基本原则、特教相关重点问题和完整操作清单,特别关注了AI在特殊教育场景中的双刃剑效应,供相关从业者参考。

01

基本原则

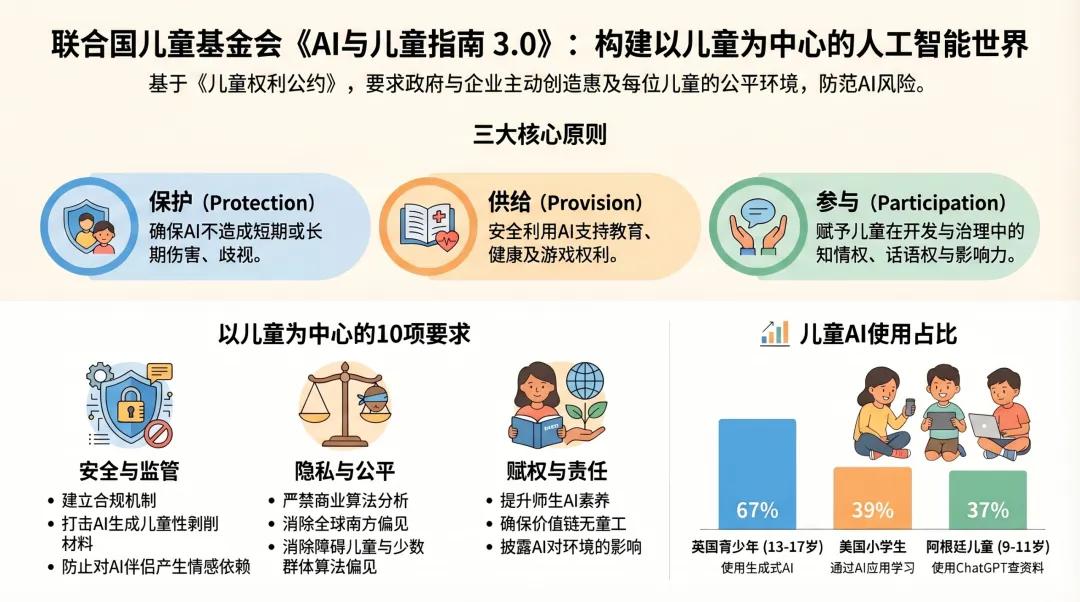

指南基于《联合国儿童权利公约》,提出了“以儿童为中心的AI”这个概念。它包含三个基本原则:

▪ 保护:AI系统不能对儿童造成伤害或歧视,无论短期还是长期。

▪ 供给:在安全、适宜的前提下,充分利用AI系统的潜力来支持儿童的教育、健康和游戏权利。

▪ 参与:赋予儿童在AI系统开发和治理中的参与权和话语权。

这三个原则展开成10项要求和48条具体建议。报告还配有一份检查清单,可以用来评估AI政策或系统是否符合儿童权利标准。

02

重点内容解读:AI与特殊教育

诊断风险与学习机会

AI在分析学习数据时,可能给孩子贴上错误的标签——尤其是特殊需要儿童,他们的学习方式本就与大多数孩子不同,更容易被AI误判。

但AI也在降低学习门槛。全球有2.4亿特殊儿童,过去为他们制作无障碍教材成本高、周期长。现在AI可以自动给教材加旁白、简化文字、描述图片,让这些资源变得触手可及。

AI产品的包容性设计

报告要求AI产品必须采用包容性设计,让所有儿童都能使用,不管他们的能力、神经类型、性别、国籍或文化背景是什么。

具体来说,开发者要在设计阶段就把不同学习方式考虑进去,而不是先按“普通孩子”的标准做产品,再想办法给特殊需要打补丁。更重要的是,设计过程需要让特殊儿童参与,因为他们最清楚自己需要什么。

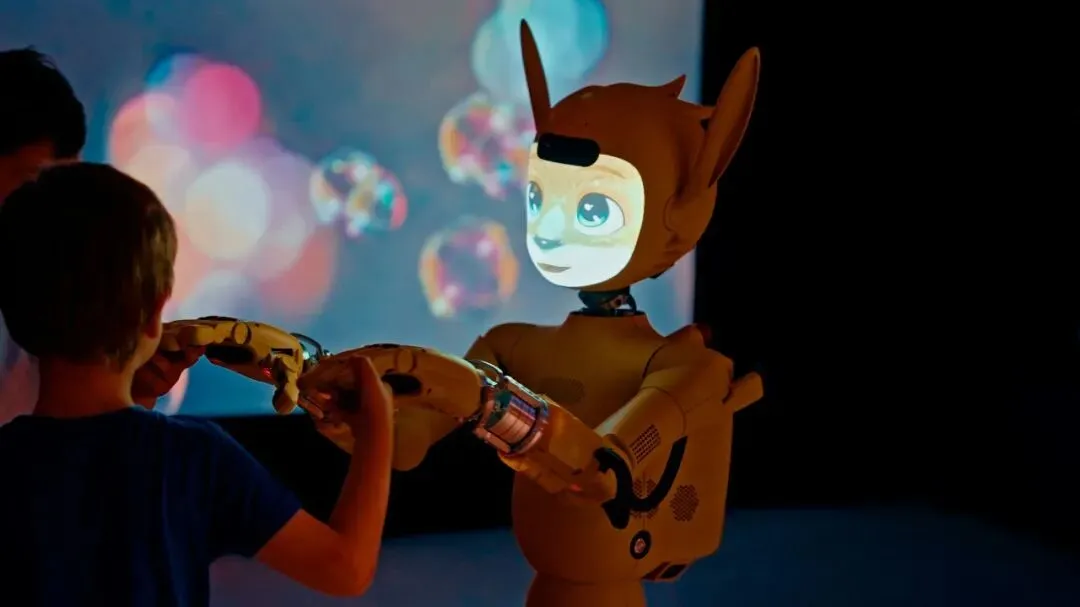

AI伴侣使用

聊天机器人如果设计得当,能帮特殊儿童练习社交技能。但问题是,特殊儿童可能会更容易把AI当成真人,形成情感依赖。如果AI不理解他们的特殊沟通方式,给出的建议可能南辕北辙。

报告强调这类应用必须有监护机制:识别危险对话,当发现自我伤害倾向时立即转介给专业人员。

教师AI素养

教师不只是要学会用AI工具,更要学会判断AI对不同孩子的影响。比如AI生成的学习材料是否适合某个孩子,AI的评估结果会不会给孩子贴上不该有的标签,什么时候该用AI辅助教学、什么时候必须人来做。

报告特别提到,给学生提供社会情感支持这件事,AI做不了。很多特殊儿童需要的正是人类教师的共情和灵活调整,这是算法替代不了的。

数据脱敏

如果AI训练数据里缺少特殊儿童的样本,系统就会看不懂他们的学习模式,给出不合适的建议,在评估中出现系统性误判。

但报告同时警告:不能以“增加代表性”为由大规模收集这些孩子的敏感数据。开发者应该用参与式设计等方法来弥补数据不足,而不是把孩子当成数据来源。数据集说明必须写清楚在儿童代表性方面有哪些局限。

AI工具采购

学校和教育部门在采购AI教育工具时,要评估工具能否支持不同学习需要,检查有没有无障碍功能(比如能不能配合屏幕阅读器使用),确认供应商有没有做过包容性测试。报告要求在大规模推广任何AI系统之前,必须先做儿童权利影响评估,否则学生的学习和隐私都可能受损。

03

附录:完整检查清单

为了将宏观原则转化为具体行动,UNICEF制定了这份极具实操价值的“检查清单”。

本清单将核心诉求拆解为10大要求,并进一步细化为48条具体行动建议(包含3条跨领域原则)。它不仅为政府制定监管法律、企业开发数字产品提供了清晰的合规参照,也为教育工作者和全社会共同构建一个安全、公平、包容的AI生态提供了重要的实践参考。

01. 审查、更新并在必要时制定全面的AI相关监管框架,纳入儿童权利。

02. 建立或指定现有的监督或监管机构,确保遵守AI原则和法律,并建立补救支持机制。

03. 确保政府AI系统符合AI相关法律和儿童权利法。

04. 在AI战略、政策、法律和法规中强制要求对AI系统进行儿童权利影响评估。

05. 在整个AI开发生命周期中持续评估和监测AI对儿童的影响,并公开结果。

06. 要求对AI系统进行安全性和稳健性测试。

07. 消除危害并减轻AI生成、传播或放大的有害和非法内容对儿童的风险,包括错误信息与虚假信息、网络欺凌和诈骗。

08. 防止针对儿童的AI犯罪,如儿童性虐待和剥削。

09. 应对AI聊天机器人或伴侣带来的风险。

10. 保护儿童免受AI在武装冲突和网络行动中的有害使用。

11. 在适当情况下利用AI系统促进儿童安全并支持保护儿童的人员。

12. 负责任地收集和使用儿童数据。

13. 采用“隐私优先”的设计方法。

14. 保护儿童群体的数据隐私。

15. 促进儿童的数据自主权。

16. 积极支持处境不利或脆弱的儿童,使他们能够从AI系统中受益。

17. 减少对儿童或某些儿童群体的偏见,这些偏见会导致歧视和排斥。

18. AI系统应事先明确警告儿童和看护人,他们正在与AI而非人类互动。

19. 向儿童解释AI系统的运作方式时应使用适龄语言,并避免将AI系统拟人化。

20. 使用适龄语言描述AI。

21. 设计、开发和部署AI系统时,应确保无论儿童是否理解系统运作原理,都能依法获得保护和支持。

22. 确保在涉及AI的所有数字商业活动中尊重儿童权利。

23. 确保AI价值链的所有环节(从数据到硬件)都基于权利保护原则,并在所有阶段消除童工和剥削。

24. 确保为高层管理人员和AI生命周期中的人员(包括设计师、开发人员和研究人员)提供AI和儿童权利方面的能力建设,并承诺采取行动。

25. 推动市场提供值得信赖的、透明的儿童AI解决方案。

26. 优先考虑AI如何使儿童受益,特别是在AI政策、法律和系统中。

27. 制定并应用儿童权利设计方法。

28. 在AI使用中整合支持儿童福祉的指标和流程。

29. 解决AI和数字基础设施对环境的负面影响。

30. 利用AI系统促进环境可持续性,包括确保AI价值链的可持续发展。

31. 在AI政策和治理以及设计、开发和部署过程中支持儿童的有意义参与。

32. 在开发面向儿童或影响儿童的AI产品时,采用包容性设计方法。

33. 努力实现设计、开发、实施、研究、监管和监督儿童可能使用或受其影响的AI系统的人员的多样性,包括收集和处理AI数据的人员。

34. 制定或更新AI素养的正规和非正规教育计划,并加强在AI世界(包括未来工作场所)中蓬勃发展所需的生活技能和技术技能。

35. 为教师提供AI培训和支持,使他们在教育中保持中心地位,而不是被AI取代。

36. 为教师、学校和教育部门提供指导,以有效采购和部署AI并减轻风险。

37. 在适当且基于证据的情况下,在教育中利用AI系统。

38. 为父母、看护人和整个社会制定和推广与AI相关的宣传活动。

39. 管理AI对未来工作的影响,以维护儿童权利。

40. 支持基础设施发展以弥合数字鸿沟,并致力于公平分享AI的好处。

41. 投资、调动资源并为以儿童为中心的AI政策和计划创造激励措施。

42. 支持对儿童和与儿童一起在整个系统生命周期中进行AI研究。

43. 参与符合公共利益和维护儿童权利的数字合作。

44. 在政府和商业实践中促进多方利益相关者方法。

45. 支持可互操作的AI、数据和数字治理工作,为各地儿童提供平等的机会和保护。

46. 根据国家或地方具体情况调整实施方案。

47. 运用前瞻性思维预测AI发展趋势并提前应对。

48. 建立持续更新机制,应对AI技术快速演进。

扫码添加工作人员,获取原文件

来源:融合星球公众号

这里有你想看的、想学的各种孤独症资讯

点击进来查看吧

夜雨聆风

夜雨聆风