医疗,自始至终都是一个高风险、高可靠性的行业。

为此,我们分享了期刊Healthcare上题为:Global Regulatory Frameworks for the Use of Artificial Intelligence (AI) in the Healthcare Services Sector的文章。

智药局对这篇文章进行了翻译,并以一种更加通俗易懂的方式呈现,同时更新补充了最新政策,希望为关注AI医疗的研究员、创业者和投资人带来启发。

中国采取的是"两条腿走路"策略:一方面鼓励AI医疗创新,设立多个试点示范区;另一方面加快完善监管体系,为行业发展指明方向。

美国FDA采取了相对灵活的态度,早在2017年就推出了数字健康创新行动计划(Digital Health Innovation Action Plan),为AI医疗产品开辟快速审批通道,但要求企业承诺持续监控产品性能,就像给疾驰的车辆系上安全带。

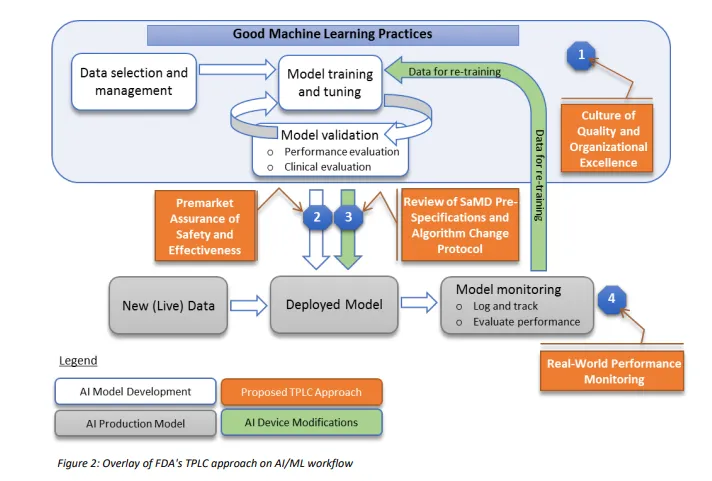

2019年4月,美国食品药品监督管理局(FDA)实施了《针对人工智能/机器学习驱动SaMD修改的拟议监管框架》。

根据该框架,开发者需对其 AI 系统的实际表现负责,并需就性能及输入方面的变化及时向FDA进行通报。该提案还强调指出,如果AI系统的预定用途发生变更,则需重新启动审批流程。

根据这一提议,FDA于2021年发布了《基于 AI/ML 的 SaMD 行动计划》,该文件根据产品全生命周期(TPLC)方法对 AI-MD 进行监管,并更新沿用到最新政策。

其中包括要求进行临床场景压力测试,模拟极端情况(如罕见病影像、设备信号干扰)下的算法鲁棒性、在采集阶段标注数据来源、采集设备型号及参数设置等。

欧盟则更注重风险防控,将医疗AI产品分为不同风险等级。高风险的诊断辅助系统需要经过严格审查,而健康管理类APP则相对宽松,就像为不同车辆设置不同限速。

2021年,欧盟发布了《欧洲医疗器械条例》,其中SaMD的风险分类基于诊断和治疗意图。然而,2021年4月,欧盟提出了《人工智能法案》,该法案为人工智能产品及服务的整个生命周期制定了统一的法律框架。

《人工智能法案》采用基于风险的方法来监管人工智能系统。在医疗领域,高风险的人工智能系统包括那些利用生物识别技术、根据患者病史对其进行分类、以及用于管理公共医疗服务与电子健康记录的软件系统。

根据《人工智能法》对这些高风险人工智能系统提出的主要要求是数据管控和风险管理,这些方面均需由制造商予以应对。

对于低风险和最低风险的人工智能系统(如可能作为医疗服务的一部分与人类进行互动的聊天机器人)而言,必须制定一套自愿遵守的行为准则,以确保服务的安全性和可靠性。

批评者指出,《人工智能法案》缺乏灵活性,因为目前尚无任何余地可将新出现的、来自未预见的领域且具有危险性的人工智能应用纳入“高风险”类别之中。

不难看出,全球 AI 医疗监管已从单点探索走向多元共治,没有绝对统一的标准答案,却有着共同的核心目标:在高风险的医疗领域,为 AI 技术找到最稳妥的落地路径。

推荐阅读

夜雨聆风

夜雨聆风