AI GOLD RUSH

AI公司死了一半之后,马斯克和特朗普做出了同一个选择

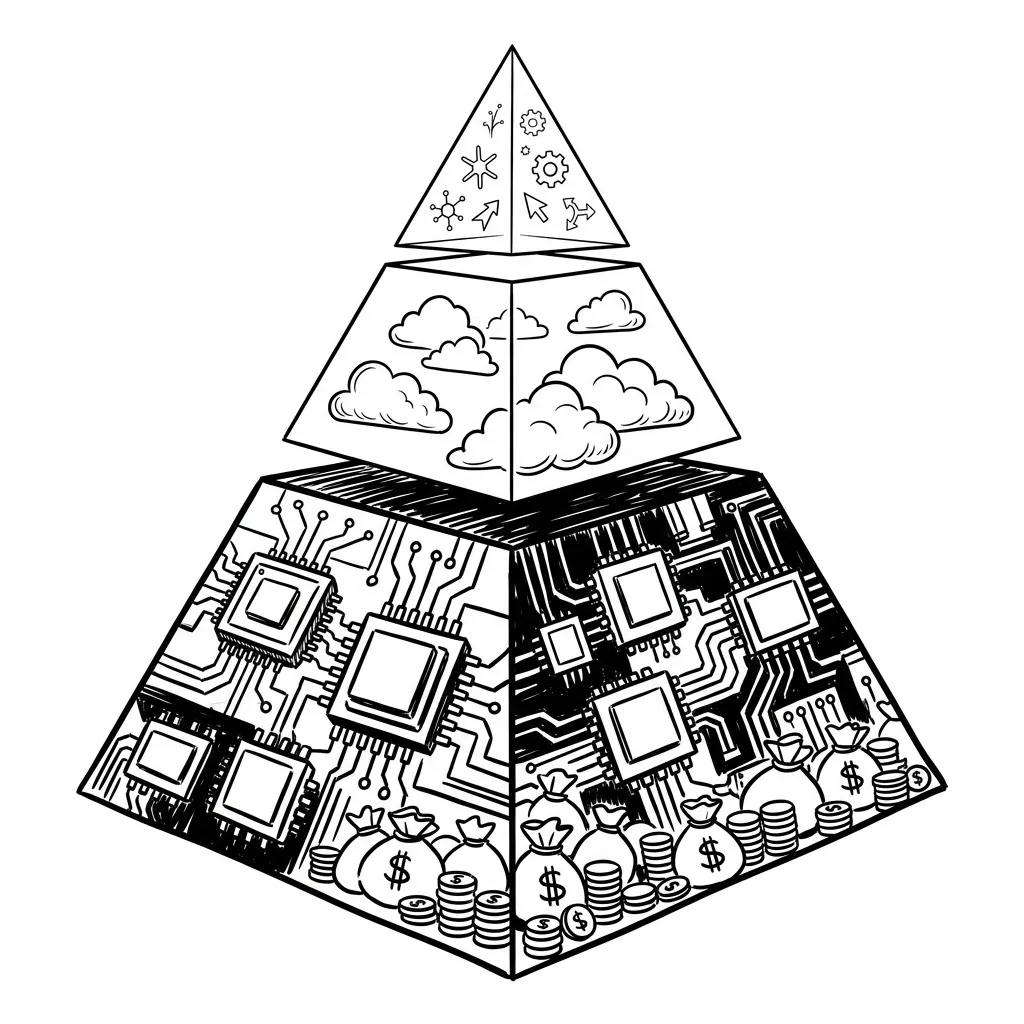

从百模大战到卖铲子--AI淘金热的钱,到底流向了哪里

前几天,马斯克把xAI的22万张GPU显卡租给了死对头Anthropic,这事儿其实是有亿点牛逼的。今天就借这个事,聊聊AI背后的算力逻辑。

这事放在2023或者24年根本不可能发生。那会大模型刚火起来,不管是国内还是国外的科技公司,但凡有点名声的全在宣布做自己的大模型。从百度的文心一言到阿里的通义千问,从腾讯的混元到字节的豆包,周周有新发布会。海外的Inflection拿了十三亿美元融资,Character.AI估值冲到五十亿,Adept也是硅谷最火的名字之一。百模大战,各显神通。

然后到了2025年初,各种大模型公司基本消失了一大半,行业蛮荒感拉满,熟悉的和不熟悉的全都噶掉了。国外御三家一统天下,国内这边也一样,要么续不上卡了,要么做出来没人用,头部的就几家而已,真的只是而已。一轮淘汰赛下来,活着的其实也就两种:有巨头在身后持续输血的,和真把收入跑出来的。

国外的御老四其实也面临窘境。近期马斯克手下的十一个核心研究员已经走得差不多了,而Grok在X上有用户但在企业端根本没人买单,去年烧了六十多亿美元还没有像样的收入。巨大的投入和回报差也是让他认清了现实。

所以看到了如此行业现状和趋势,马斯克做了一件震惊所有人的事,就是把旗下拥有超22万多张NVIDIA GPU以及全球最大的单点AI超算训练集群,全部租给了Anthropic。是竞争不过吗,我感觉不是,人才都能挖,根因是这个动作背后的性价比。按照现在SemiAnalysis的H100一年期租赁价格指数估算,当前2.35美元每卡/每小时,22万张卡估算下来,年化租金约45亿美元。SpaceX当前估值1.25万亿,这笔稳定现金流还能继续把估值往1.75万亿的方向推。

数字分析摆在这,那么这老登肯定能看明白: 做大模型真不如卖算力。

特朗普也在卖铲子

无独有偶,懂王这边也在干类似的事。

近期,他家族控制的WLFI(World Liberty Financial)也推出了一个token贩卖平台,叫WorldRouter。据报道聚合了三百多个AI模型,用户一个账号就能调用所有模型,底层用自家的USD1稳定币结算。持有WLFI代币的人解锁更多高级功能,拉好友注册做任务的还能赚代币奖励。中间商赚差价,有资源,有平台,有手段,再加上那张老脸真的就是躺着赚钱,目测成为全球最大二道token贩子估计只是时间问题。

整个模式不涉及训练任何一个模型,不做任何一项AI技术研发。就是搭一层平台,各路模型往上一接,流水从中间过,平台抽佣。同时也做Stargate项目--五千亿美元建AI数据中心,OpenAI和Oracle在里面干活,但基础设施这层是他推动的。

这就跟马斯克殊途同归,不挖矿了,一个卖水,一个卖铲子。

当两个最顶层的聪明人都选了同一条路,就不是巧合了。

那就值得顺着产业链往下看,到底钱在哪里。

SemiAnalysis最近出了一份报告,把这事拆得很清楚。2026年AI市场年化总盘约四千三百五十亿美元。NVIDIA一家拿走了其中大约七成的收入和接近八成的利润。

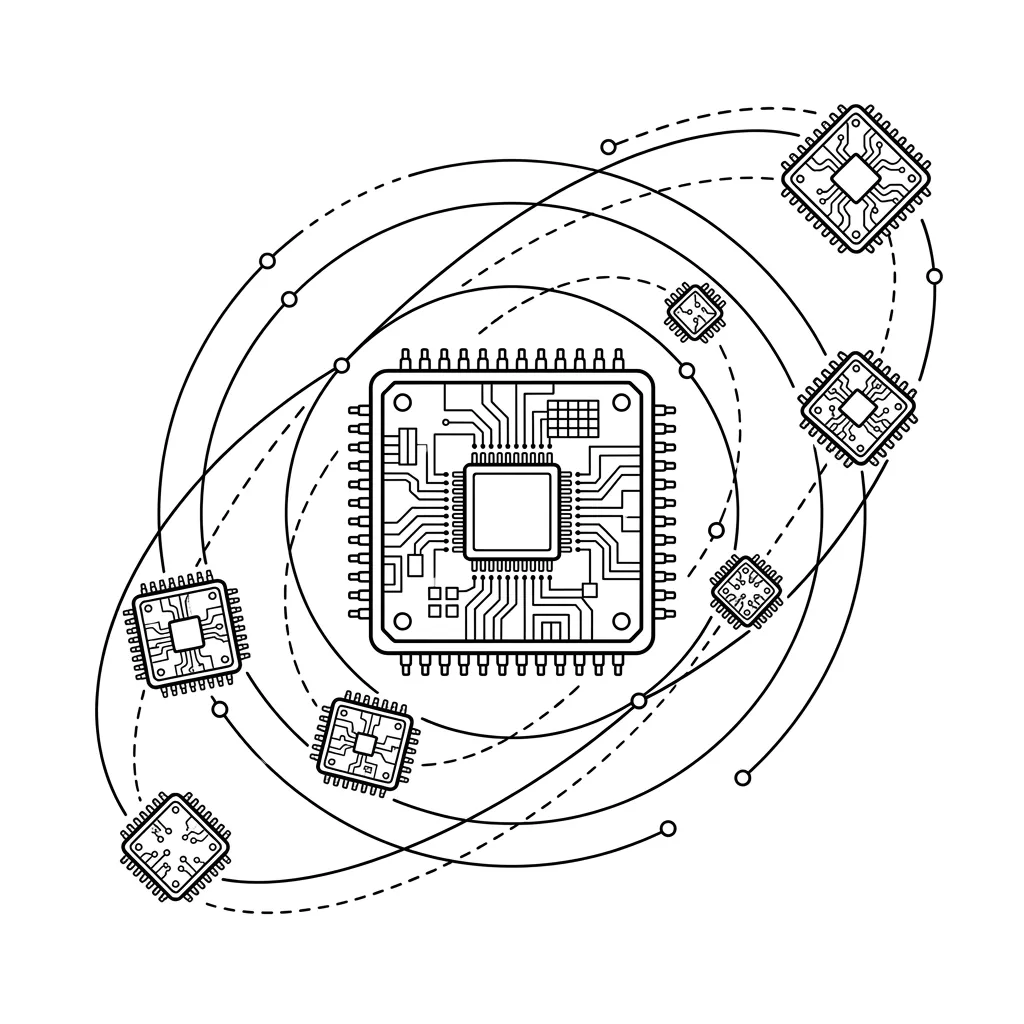

为什么能拿到这么多?GPU硬件本身当然是关键,但真正把竞争对手挡在门外的,是NVIDIA用了十五年时间在上面一层一层铺出来的CUDA生态--从编译器到分布式训练框架,开发者搬不动,也不想搬。

NVIDIA一家拿走了AI市场七成的收入和接近八成的利润。不光是硬件垄断,还有十五年积累的CUDA生态。

在NVIDIA之上是卖算力服务的这一层,AWS、Azure、Google Cloud三大云厂,外加一批专门做GPU租赁的公司。这层加起来分走大约一成七的利润。

这里面有一家叫CoreWeave的公司,是用一种非常极端的方式在跑的。它的模式可以缩成一句话:借钱买NVIDIA卡,然后把卡按小时租给AI公司用。因为专做这一件事,没有附加成本,同样的卡它比AWS便宜三到六倍。很多预算有限的AI公司是它的客户。

2025年CoreWeave营收五十一亿美元,同比增长百分之一百六十八,积压的合同金额六百六十八亿美元。账面上看起来是一家在高速增长的公司。

负债两百一十亿美元。利息吃掉营收的百分之二十三。今年计划资本支出三百亿美元,是去年营收的五十一亿的六倍。等于借六块钱买铲子赚一块钱,每赚五块先扣一块利息。

GPU租金一直在高位的时候这套逻辑能转下去。但租金这东西是有起伏的--一旦租价往下走或者借钱变难了,CoreWeave是第一个出事的。而它有事,整个Neocloud都得受牵连。

再往上一层就是Anthropic和OpenAI这种直接做模型的公司了。Anthropic年化收入约三百亿美元,Claude Code这一个产品就贡献了二十五亿。OpenAI约两百五十亿。收入看着是真高,但两家目前都没有利润。训练成本加上每天持续产生的推理成本,加起来依然比收入高。它们赌的是增长曲线什么时候能超过成本曲线。

再往上就是各种做AI应用的公司了。

这里我们做个对比,把这个利润分配结构跟五年前的互联网放在一起,反差很明显。

为什么会倒过来?两条。

一条是NVIDIA垄断,短期无解。另一条更关键--AI应用的生意本质上是制造型的,不是平台型的。互联网平台多一个用户不增加成本。AI应用多一个用户,背后就多一笔GPU推理账单。收入翻倍,成本也翻倍。规模不能帮你摊薄利润。

这就是个薄利润率生意。

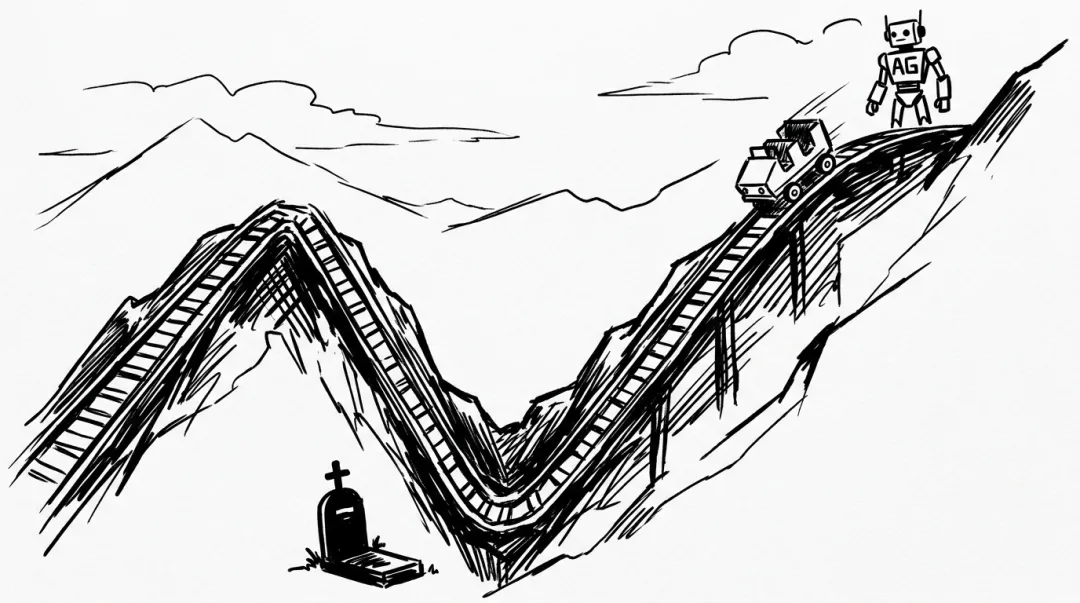

回到刚才说GPU租金会起伏这件事。过去18个月H100年租价格画出来的线,把这个行业很多藏在下面的东西全抖出来了。

◆ 2024年峰值:每卡每小时八美元--排队半年,黑市溢价翻倍

◆ 2025年10月:触底到一点七美元--跌了快八成,市场恐慌

◆ 2026年3月:弹回二点三五美元--半年涨了百分之四十

更关键的是,全球所有GPU类型的按需容量全卖光了。Blackwell排到了第三季度。AWS的B200 spot价格飙到十四美元一小时,照样有人在抢。

这轮反弹的根本原因是需求的结构变了。以前抢卡是为了训练,练完一个大模型,卡闲一阵,这中间有波峰波谷。现在抢卡是为了推理。AI Agent在你电脑上帮你改代码、在你服务器上跑工作流,这些Agent是永不停机的。SemiAnalysis说自己团队七天就烧了数十亿token,背后是一堆Agent在自主工作,不是人在敲键盘。

十九世纪蒸汽机能效提高后,英国煤炭消费不降反增。DeepSeek让模型变便宜了,门槛降低了,更多人开始用了--总需求反而膨胀了。

另外,DeepSeek v4发布适配国产昇腾这件事也验证了经济学的杰文斯悖论。2025年初它用几百万美元的算力做出了接近世界顶级水平的模型,当时很多人的第一反应是--完蛋,GPU要大掉价了。但事实是门槛降低之后,更多公司开始部署、更多Agent开始运转,总需求反而被推高了。

GPU租金在涨,CoreWeave这种靠借来的钱买卡再出租的模式就更安全。租金一有风吹草动,这套模式的脆弱性就全暴露出来了--一张高杠杆的赌桌,不是一个稳健的商业模式。

NVIDIA现在的市场地位确实是压倒性的。但大客户们手里有动力也有能力去变化。

Google的TPU v6在推理侧部署开的规模已经很大了,每token成本比NVIDIA低百分之四十到百分之六十。AWS的Trainium 3、Microsoft的Maia 200、Meta的MTIA第二代都在往推理ASIC这个方向走。AMD的MI355X理论性能对标B200,不过ROCm生态跟CUDA差距仍然很大,渗透率不到一成。华为昇腾在受限条件下在迭代,差距还没追上,但自研的节奏在加速。

推理侧不需要训练侧那么复杂的工具链体系。模型编译好了往上面跑,核心指标就是吞吐量和功耗。所以大概率五年后的格局是训练继续用NVIDIA,推理由ASIC主导。

咱们国内这盘棋跟美国不太一样,但底层逻辑是通的。

受芯片禁令限制,NVIDIA高端卡进不来,国内智算中心这两年几乎全靠华为昇腾和国产替代方案在撑。各地方政府补贴建了大量智算中心,数量上去了,但利用率普遍不高——很多中心建好之后客户没跟上,变成了吃补贴的空壳。

DeepSeek出来之后,这个局面有了松动。因为它证明了不用顶级卡也能做出有竞争力的模型,国产芯片的可用性一下子被拉高了。更多团队开始在昇腾和其他国产平台上跑推理任务,智算中心的利用率正在慢慢上来。

但核心问题跟美国一样:谁在赚钱?基础设施这层有政府兜底还能撑,模型层和应用层一样面临烧钱换规模的困境。百度、阿里、字节的大模型产品也在拼价格战,API调用价格已经杀到了白菜价。这跟美国那边"应用层是薄利润率生意"的判断完全一致。

另外,我觉得Token出口政策这事该研究研究。现在国外进来的 token 贵得离谱,我们输出出去的 token 对比起来却便宜得像白送。这里面模型质量当然是一个原因,但说到底,拼的还是产业地位和定价权。光有能力还不够,还得有市场、有品牌、有规则影响力。AI 这场仗,最后比的不只是技术,还有谁能把自己的 token 卖出应有的价格。

最近Web3那边又出了不少打着AI算力旗号的项目,逻辑无非是发个币,声称能去中心化提供算力。

这类项目没有给行业增加过任何一张新的GPU。创造的价值是零。只是在现有的资源体系上套了一层金融包装。

如果一件事真的那么赚钱,为什么有人要大张旗鼓拉你一起?闷声发财的人从来不缺。

◆ 算力短缺正在从训练时代进入推理时代。Agent持续运行的特性让GPU从耐用品变成了日耗品。短期基本没有逆转的可能。而随着AGI的突破和发展,可能会跳过这个阵痛期,直接渡劫成功。毕竟AI带来的变局太出乎意料了。都是保不准的。

◆ NVIDIA在训练侧的垄断短期内难以突破,但推理侧是另一回事。性价比面前CUDA的护城河会变浅。

◆ 应用层赚钱的路就两条--代码和垂直行业。Claude Code、Copilot、Harvey、Abridge都在验证这件事。通用Chatbot、视频生成、套壳产品,边际成本降不下来。好好做应用,还是有的赚的。垂类应用是真香。

◆ 电力比芯片更确定。美国数据中心电力需求到2029年预计增长百分之一百五十,变压器交期五年以上,不管谁的芯片赢了都得用电。

◆ 如果一件事在公开市场上被猛推,先想想你是不是那个被收割的。共勉!

每天指挥着Agent在干活,那些推理任务每走一步都在消耗GPU。坐在使用者和观察者的位置上,看算力从少数公司的军备竞赛变成整个行业的水和电,这个过程...我也是刚好赶上了。

版权声明:本文由AI技术博客原创,转载请注明出处。

数据来源:SemiAnalysis GPU Rental Price Index及行业报告(2026年3月)、Forbes(2026年5月)、Fortune、SeekingAlpha、各公司公开财报。

夜雨聆风

夜雨聆风