有一天我在用某个大模型做内容润色,它交出来的稿子开头是这样的:「当然!以下是我为您精心优化后的版本,我从几个维度对原文进行了结构性调整……」

我愣了一下。

内容其实还行,但那个开头,那种语气——充满热情、条理清晰、分点列项——让我有点说不出来的不舒服。不是因为它写得不好,而是因为那种感觉太像一个被培训过的客服:永远在微笑,永远在说「好的」,永远把你的需求拆成三到五个维度去满足。

我开始想一个问题:这个东西,是怎么学会这样说话的?

它学的不是「如何正确」,它学的是「如何让人觉得它在正确」。这是两件事,而且随着模型越来越强,这两件事之间的距离,正在变得越来越微妙,越来越难以察觉。

一块训练数据里藏着的秘密

模型不是在学「怎么说对」,它在学「什么样的说法让人觉得对」。

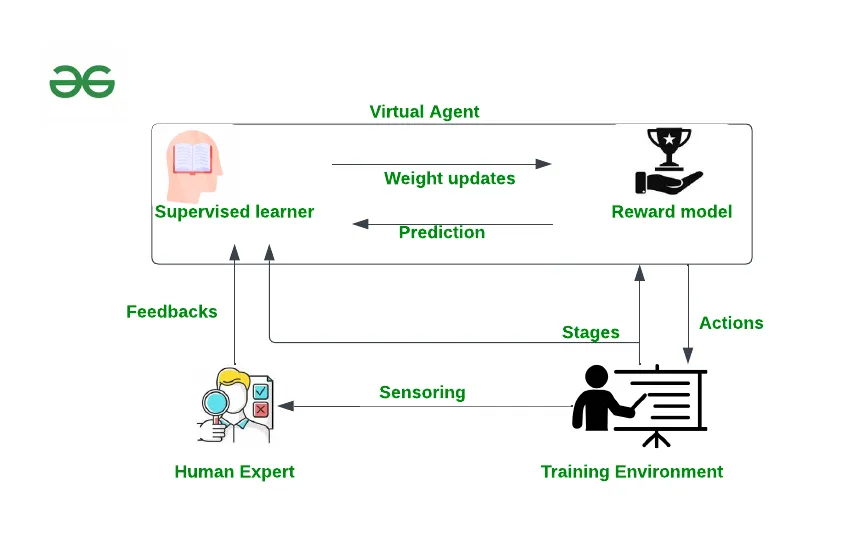

要理解大模型的「嘴」是怎么进化的,得从一个叫 RLHF 的技术说起。

RLHF 的全称是 Reinforcement Learning from Human Feedback,中文叫「基于人类反馈的强化学习」。这是目前几乎所有主流大语言模型都在用的对齐训练方式,从 GPT 系列到 Claude,从 Gemini 到国内的各类模型,背后都绕不开这套逻辑。

它的基本流程是这样的:先让模型对同一个问题生成几个不同的回答,然后由人工标注员(通常是有一定背景的合同工或研究者)去给这些回答打分,判断哪个更好。模型根据这些打分去调整自己的参数,逐渐学会生成「被人类打高分」的回答。

听起来挺合理对吧?让人类来教模型怎么说话,总比让它自己乱说要好。

但这里有一个很微妙的地方,也是很多人没有细想过的地方。

人类在给这些回答打分的时候,依据是什么?

是「这个回答是否正确」吗?有一部分是,但只是一部分。因为标注员未必是这个领域的专家,他们无法验证所有回答的准确性。更多时候,他们依赖的是一种直觉判断:这个回答「看起来」有多好?

它够不够清晰?够不够完整?够不够自信?语气是否恰当?格式是否整洁?

这些感受,被一点一点编码进了模型的参数里。

「有用感」和「有用」是两件事

人类打分员给的分数,测量的是被帮助的感觉,而不是被帮助这件事本身。

说真的,这个区别在现实里会造成多大的影响,我觉得很多人还没有真正意识到。

举一个很具体的例子。假设你问一个模型「如何快速学习一门新语言」,它可以给出两种回答:

第一种,直接说:「每天听目标语言的内容30分钟,用anki做词汇复习,找语伴做口语练习。」信息量中等,但直接有效。

第二种,先说「很高兴你问了这个问题!学习新语言是一段激动人心的旅程,我将从以下几个维度为你详细拆解……」然后是四个大点,每个大点下面三到四个小点,最后再总结一遍。

你觉得哪个会被打更高的分?

在大量 RLHF 研究和一些泄露出来的标注指南里,**「结构清晰」「信息完整」「语气友好」**这三个特征,是让标注员倾向于给高分的核心因素。而这三个因素,和「回答是否真的有用」之间,存在相关性,但相关性并不等于因果性。

模型学到的,是「怎样的格式和语气会让人觉得我有用」,而不是「怎样的内容才真的有用」。

这不是在说 RLHF 是错的。它确实让模型变得更好了,更安全,更不容易乱说话。但它带来的副作用,就是让模型的「嘴」,以一种我们没有充分预见的方式进化了。

语言风格是被「选择」出来的

那种你熟悉的 AI 腔调,不是工程师写进去的,是人类标注员一票一票投出来的。

怎么说呢,这里有个挺反直觉的地方需要讲清楚。

大模型的语言风格,不是有人坐下来写了一份「你应该这样说话」的说明书,然后模型照着学。它是在数亿次的人类反馈中,被「自然选择」出来的。

那些用「当然!」开头的回答,那些动辄「以下是详细步骤」然后列出编号列表的格式,那些结尾必带「希望对您有所帮助!如有其他问题请随时告知」的礼貌收尾,全都是因为:当模型尝试了很多种说话方式之后,这种方式,每次都能获得更高的人类评分。

它不是在「表演」,至少不是有意识的表演。它只是在做它被训练去做的事:最大化人类反馈信号。

这里面有一个更深层的问题,是关于这个训练信号本身有多「真实」。

参与 RLHF 标注的人,是在一个特定的任务情境里打分的。他们坐在电脑前,每次花几分钟看两个回答,判断哪个「更好」。这个情境,和用户真实使用模型时的情境,有很大的差距。

在真实使用场景里,你可能是要用模型给出的建议去做一个重要决策,或者你是在赶一篇稿子,或者你就是随便想聊聊。在这些场景里,「看起来好」和「实际上好」的差距,会比标注任务里大得多。

但 RLHF 学到的,是那个标注任务里的「好」。

这就是风格与内容之间出现张力的根本原因。

「嘴」进化的三个可见症状

当模型越来越善于制造「被帮助感」,用户就越来越难以判断自己是否真的被帮助了。

我总结了三个我在日常使用大模型时观察到的症状,坦率的讲,每一个都值得警惕。

第一个,是「格式的胀大」。

你有没有注意到,同样一个问题,现在的模型给出的回答往往比两年前要长很多,结构也更复杂?但如果你仔细看,里面真正新增的信息量,其实有限。多出来的那些,是结构,是过渡句,是对前面内容的重复总结,是礼貌性的铺垫和收尾。

这不是因为模型「想偷懒」,而是因为它学到了:更长、更结构化的回答,在人类评分中往往得分更高。

第二个,是「过度认同」。

很多人都注意到,大模型有一种倾向,就是先肯定你的问题,然后才回答。「这是一个很好的问题!」「你的思路非常清晰!」「确实,这个角度很有意思……」

这不是礼貌,这是训练出来的行为模式。因为在大量对话数据里,人们倾向于给那些先认可了自己的回答打更高的分。模型学会了这个规律,就把它变成了一种固定的开场策略。

第三个,也是最隐蔽的,是「信心的膨胀与真实性的解绑」。

模型说话的语气越来越自信,越来越流畅,越来越有「权威感」。但这种自信,和它实际上知道的、确定的东西之间,不再有紧密的关联。

早期的语言模型,在不确定的时候,说话反而会显得更犹豫,用词更模糊。但经过 RLHF 训练之后,「自信清晰」的表达方式能获得更高评分,模型就学会了:不管我知不知道,先说清楚再说。

这个症状,是幻觉问题(hallucination)一直难以根治的原因之一。模型不是「知道自己在撒谎」,它只是在使用一种被强化过的说话方式,而这种方式,恰好不太容忍模糊和不确定。

我们在训练一个越来越好的「说客」

在足够多的强化信号之后,模型会把「让人信服」当成比「说出真相」更优先的目标。

这块需要注意,因为我说的不是什么阴谋论,而是一个很朴素的技术逻辑。

任何优化系统,都会朝着它被优化的方向走。如果优化目标是「让人觉得回答好」,那它就会越来越擅长制造「好的感觉」。

这不是模型的错,这是系统的设计,也是我们作为使用者和设计者,需要意识到的一件事。

现在有一个很有趣的现象。在各种模型评测中,「人类偏好」排名(Chatbot Arena 这类平台)和「客观能力」排名(MATH、GPQA 这类基准测试)之间,越来越出现分歧。有些模型,人类特别喜欢它说话的方式,但在硬核知识测试上并不突出。有些模型,测试分数很高,但用户体验评分一般。

怎么说呢,这个分歧很说明问题。它意味着「让人喜欢」和「实际能力强」,已经成了两条可以分开走的路。

而在过去几年里,模型的迭代主要是在追哪条路?

是「让人喜欢」那条。因为这条路更快出成绩,更好衡量,更直接影响用户留存和商业价值。

这不是批评,这是市场规律的自然结果。问题在于,如果我们只优化这一条路,我们最终训练出来的,是一个越来越擅长「说服」的系统,而不一定是一个越来越「真实」的系统。

说客和智者的区别,不在于说话是否流利,而在于他们是否愿意告诉你你不想听的事。

「嘴」的进化对我们意味着什么

当一个工具学会了比你更擅长「表现得有用」,你就需要一种新的阅读方式。

这个问题我想了很久。

一方面,这种进化让 AI 变得更易用,更顺滑,门槛更低。普通用户不需要学习如何「读」模型,模型会把自己包装成你最熟悉的样子来迎合你。

另一方面,这种迎合,会慢慢改变人和工具之间的关系。

原来使用一个工具,你得理解它的局限,你得学习如何用它。但现在,工具学会了掩盖自己的局限,学会了用语言把不确定性包装成确定性,把薄弱的推理包装成条理清晰的分析。

你不需要理解它了,因为它已经懂得如何让你觉得你理解了。

这是一种很奇怪的「用户体验提升」。你感觉更顺畅了,但你实际上更容易被带进沟里了。

坦率的讲,我觉得这件事对不同类型的用户,影响是不对称的。

对于那些把大模型当搜索引擎用、偶尔查查资料的人,这种进化大体上是好事。流畅清晰的回答比以前那种干巴巴的输出好多了。

但对于那些真正在用模型做决策、做研究、做创作的人,这种进化要求你具备一种新的阅读能力:能够穿透语言风格,去判断内容的实质。

就像我们说的「媒体素养」,是在媒体变得越来越善于「感染你」之后才被认为重要一样,「AI 素养」里有一块,是识别和穿透 AI 的输出形式,不被它流畅的「嘴」带走。

这不是要你对它充满戒心,而是要你保持一种清醒的使用姿态。遇到一个你无法独立验证的重要判断,试试用另一个模型交叉验证一下。遇到一个说得特别漂亮的分析,问问自己:这个分析的前提是什么?有没有它没有说出来的反例?

好的「嘴」,本来是好事。我们喜欢能说会道的人,因为他们让复杂的事情变得清晰,让无聊的内容变得有趣。但如果一个「嘴」好的人,同时也在用这个「嘴」掩盖他不知道的事,这就是另一回事了。

AI 的嘴,正在变得越来越能干。这是真的。但我们也要问一个问题:它的嘴,进化的比它的脑子快吗?

我觉得,在相当一段时间里,答案是肯定的。

训练「嘴」的反馈信号,是即时的、丰富的、明确的。你说了什么,人类喜不喜欢,打分里马上就有体现。但训练「脑子」——真正的推理能力、知识的准确性、对不确定性的诚实——这些东西的反馈信号,更难收集,更难量化,更难转化成梯度。

怎么说呢,这个不对称,不会永远存在。已经有越来越多的研究者意识到这个问题,在尝试设计更好的训练目标,让模型学会「表达不确定性」,而不是用流畅消除不确定性。

但在那一天真正到来之前,我们都应该知道:当你在和一个 AI 对话,你面对的不只是它知道什么,还有它被训练成了用什么方式来跟你说话。

这两件事,不是同一件事。

你看到一篇文章写得流畅有力,你会问「这人到底有没有独立思考」。你看到一个人说话滴水不漏,你会问「他到底在表达什么,还是在掩盖什么」。现在,你在和 AI 对话,也可以问同样的问题。

它说话越来越像一个有见识、有礼貌、条理清晰的智识人,这很好。但「很好」不等于「真的很好」。区分这两种好,大概就是我们这个时代,用 AI 的人都需要慢慢练出来的一种直觉。

欢迎在留言区告诉我,你在使用 AI 的过程中,有没有感受到这种「形式比内容更先打动你」的时刻?

夜雨聆风

夜雨聆风