本地AI全能助手:OpenClaw + Ollama Windows 部署完全指南

本地AI全能助手:OpenClaw + Ollama Windows 部署完全指南

想要一个能自主执行任务、支持多Agent协作的本地AI?今天教你用OpenClaw(原Clawdbot)对接Ollama,在Windows上搭建一套完全免费、离线运行的智能体系统。不依赖云服务,数据100%私有,还能充分利用GPU加速!

前言:OpenClaw是什么?

OpenClaw是一个开源的AI Agent框架,它不像普通聊天机器人那样只会回答问题——它能真正“动起来”:执行文件操作、调用外部工具、管理日程、处理邮件……你可以把它看作一个具备自主行动能力的AI助手。

而Ollama作为本地模型运行工具,为OpenClaw提供了强大的“大脑”。两者结合,你将拥有一个完全运行在本地的、功能可扩展的智能体。

本文将在Windows环境下,从零开始部署OpenClaw并配置Ollama本地模型,让你掌握这套强大组合的搭建方法。

Ollama GPU加速配置

检查硬件与驱动

要让大模型跑得流畅,建议利用NVIDIA显卡进行加速。

检查GPU型号:选择此电脑→右键管理 → 设备管理器 → 显示适配器,确认是NVIDIA显卡。

安装NVIDIA驱动和CUDA:

-

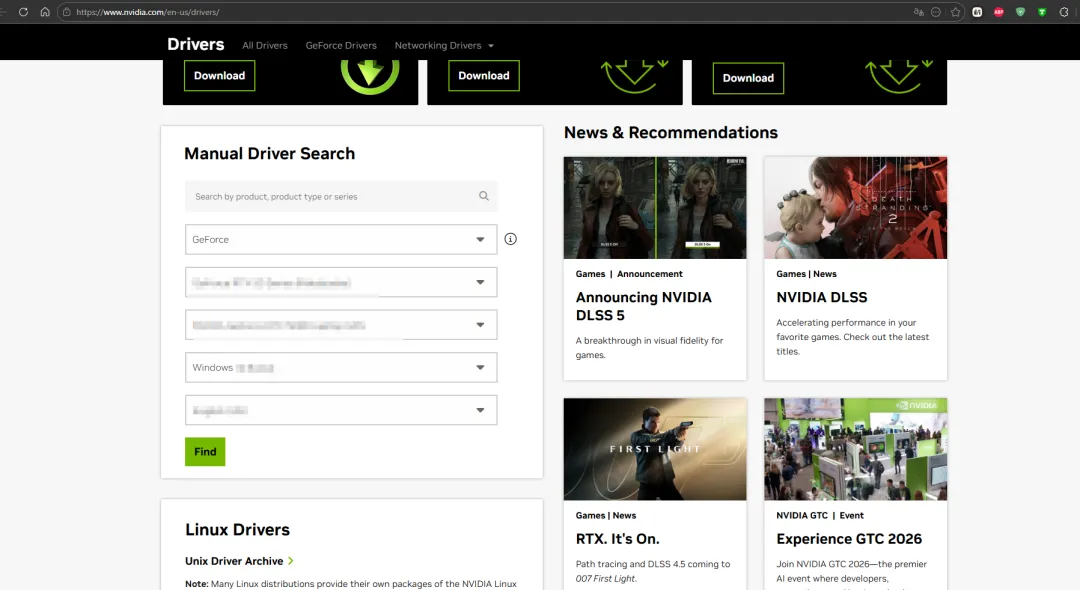

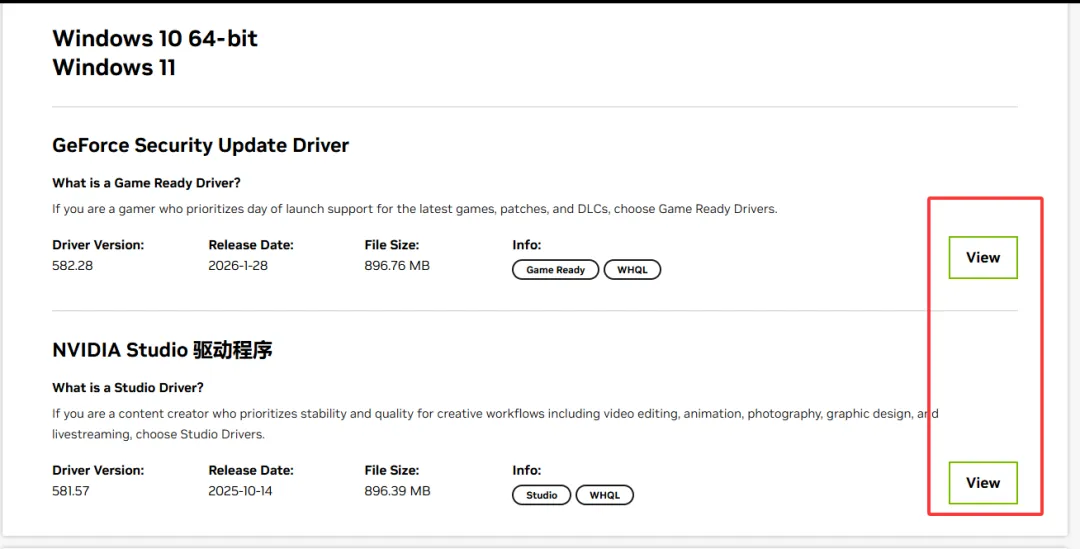

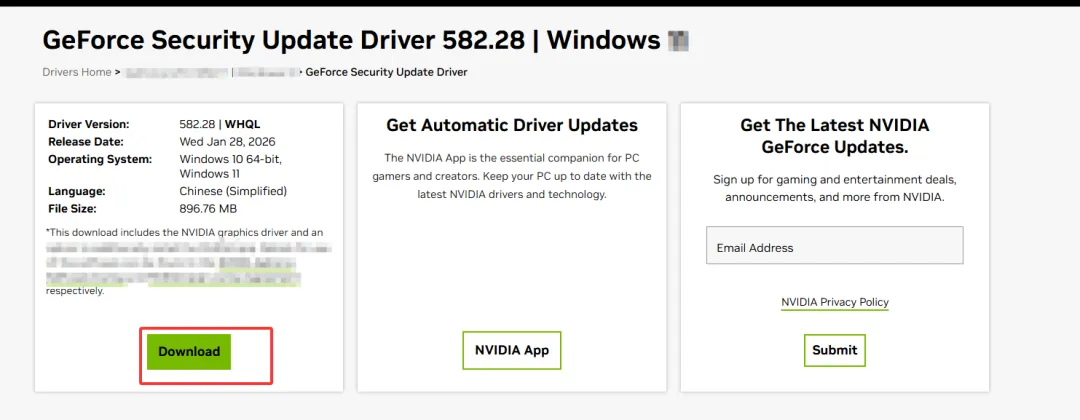

前往 NVIDIA官网 下载对应显卡的最新驱动。

-

安装完成后,在命令行执行

nvidia-smi查看是否显示GPU信息。

启用GPU加速(自动配置)

Ollama在安装时或者重启时会自动检测NVIDIA GPU并启用CUDA加速。你可以通过以下方式确认GPU是否被使用:

# 启动ollama服务,在下面的日志中可以看见关于CUDA等相关内容ollama serve

下载推荐模型

# 拉取模型ollama pull qwen2.5:7bollama pull qwen3.5:7b# 也可直接用运行模型的命令 会自动拉取ollama run qwen2.5:7b拉取完成后查看已下载模型:

ollama list

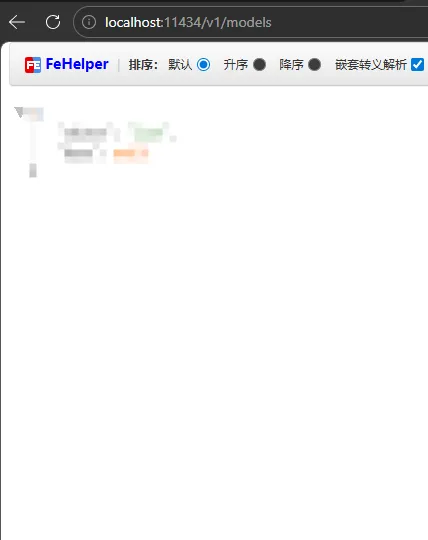

测试Ollama API服务

Ollama默认提供HTTP API,地址为 http://localhost:11434。验证是否正常:

curl http://localhost:11434/v1/models

也可浏览器访问

如果返回模型列表JSON,则服务正常。

安装OpenClaw(Windows)

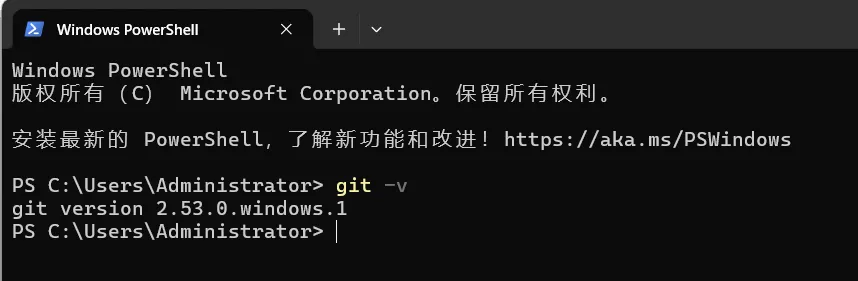

安装Git

-

openclaw可以一键安装,但是需要确保电脑上安装了git,可以通过

git -v来进行确认

-

如果没有安装,则需要进行安装,可以去

git官网进行安装,也可以以管理员身份打开Opwershell,通过命令来进行安装

winget install git.git### 如果出现了无法加载文件...因为在此系统上禁止运行脚本 等错误,可以进行如下设置Set-ExecutionPolicy RemoteSigned -Scope CurrentUserSet-ExecutionPolicy -Scope Process -ExecutionPolicy Bypass -

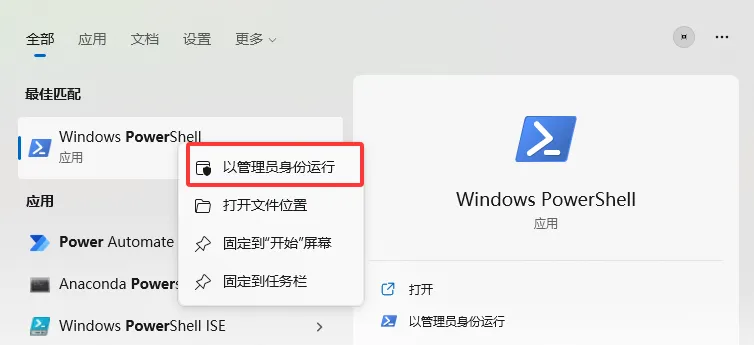

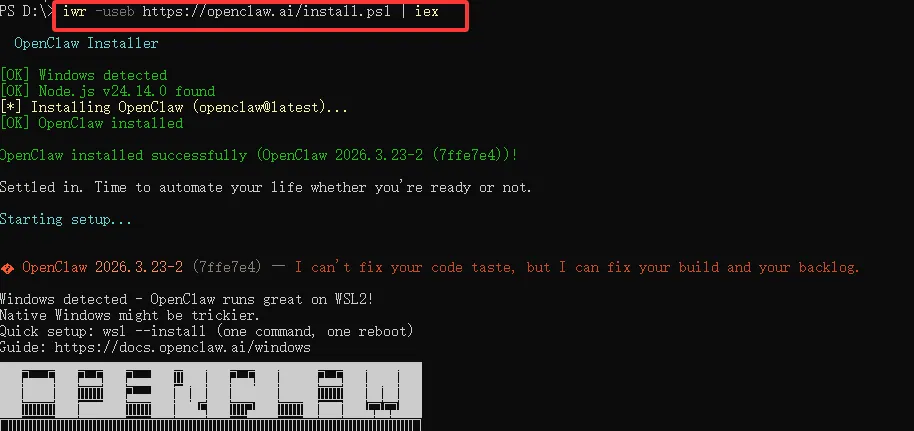

安装openclaw,以

管理员身份打开Opwershell,执行如下命令#https://docs.openclaw.ai/zh-CN/install#windows-powershell-2 在该网址下,有一键安装的命令iwr -useb https://openclaw.ai/install.ps1 | iex

-

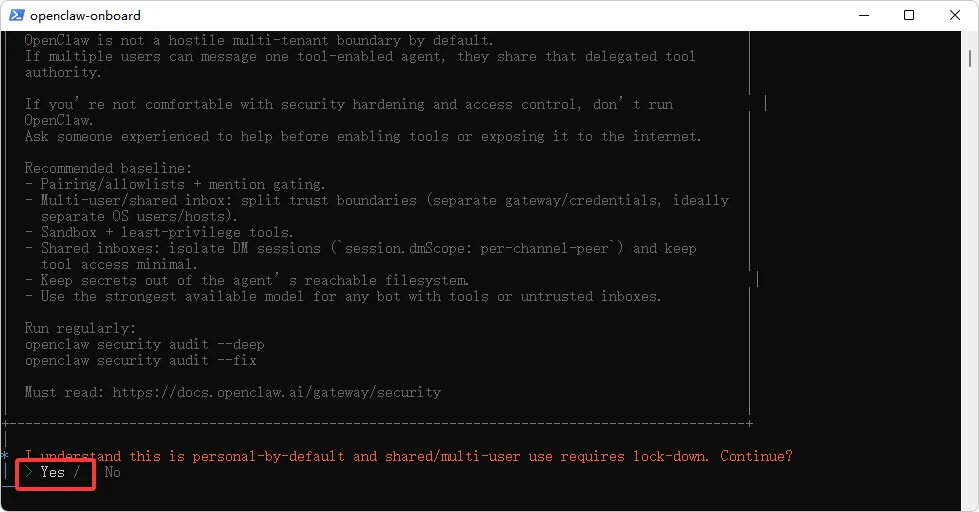

“我理解,默认情况下这是个人使用模式(personal-by-default)如果多人共享或多用户使用,则需要进行安全锁定(lock-down)是否继续?(此处选择Yes)

-

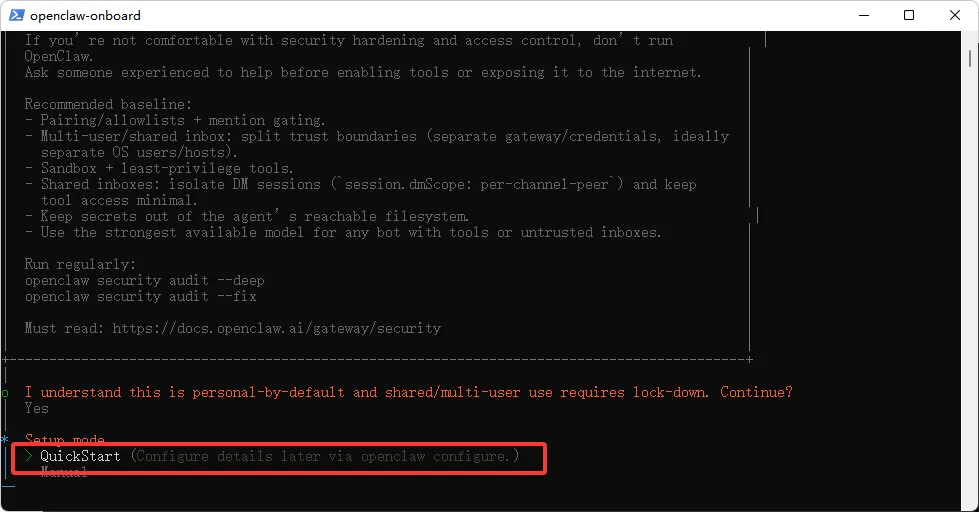

选择引导模式,此处选择默认的QuickStart模式,回车即可

-

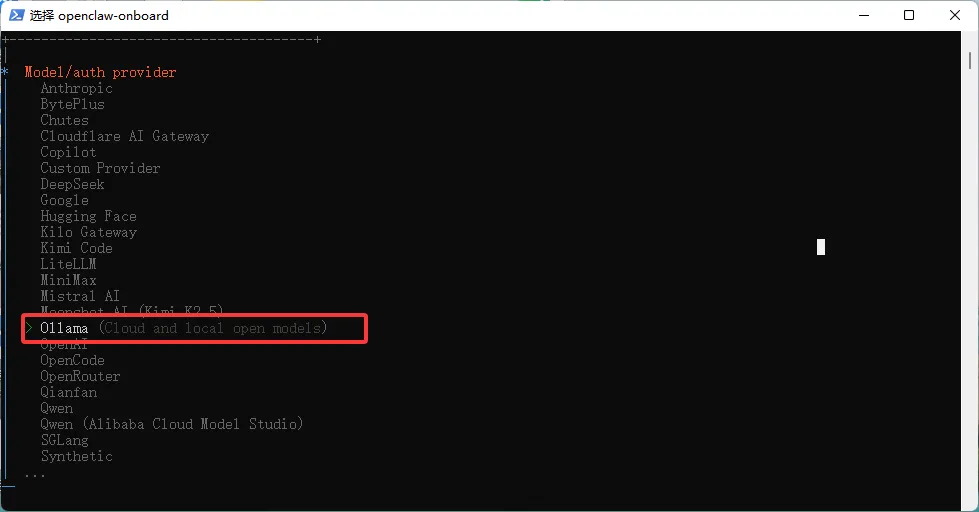

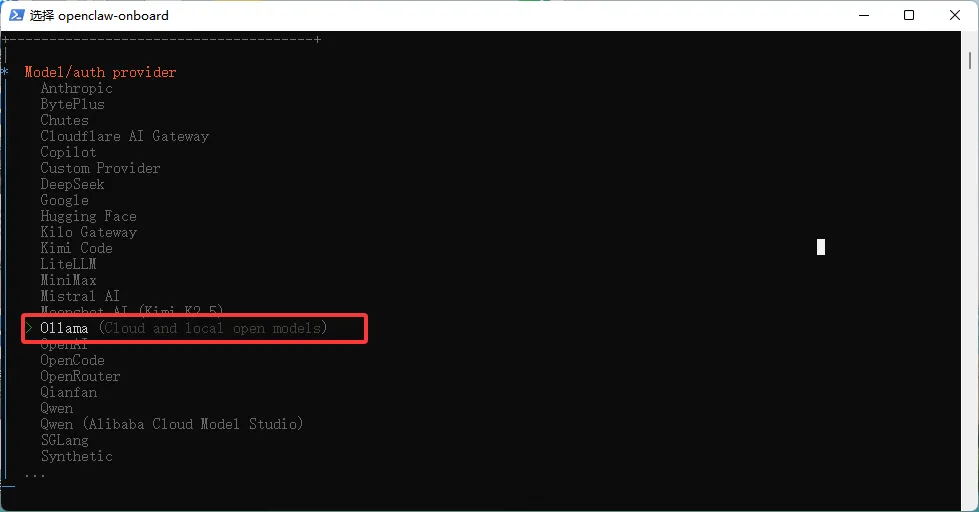

模型/认证提供商

-

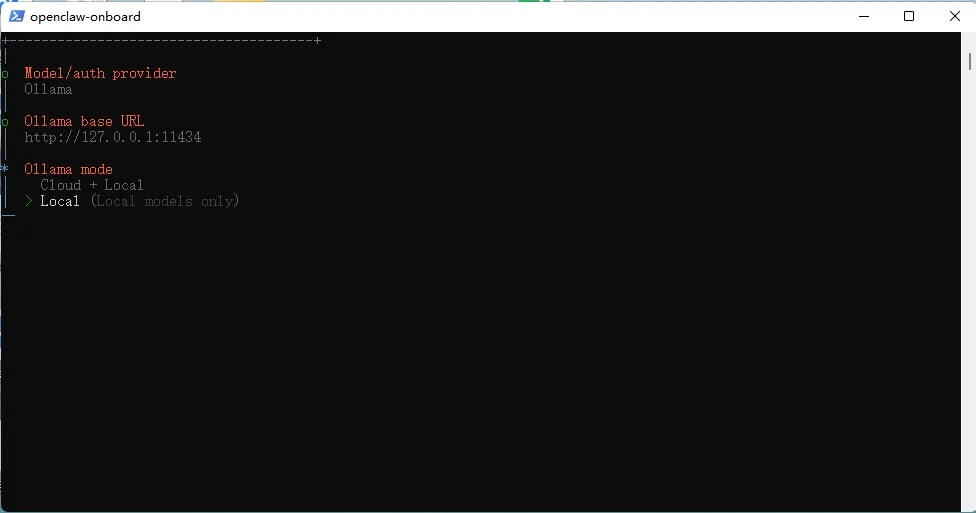

模型URL(我的模型使用的默认url),Ollama模式(我采用的本地模型)

-

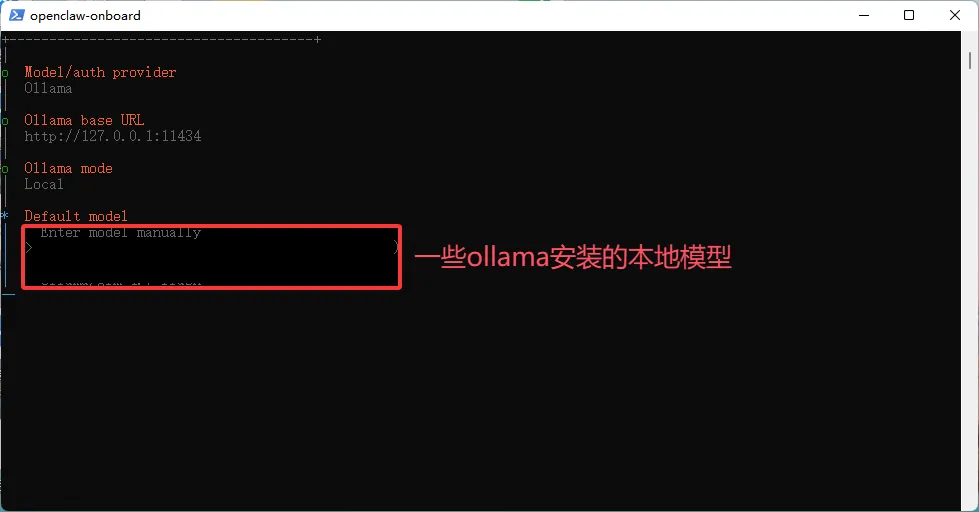

默认模型,这块会让你选择你本地

Ollama上面的模型

-

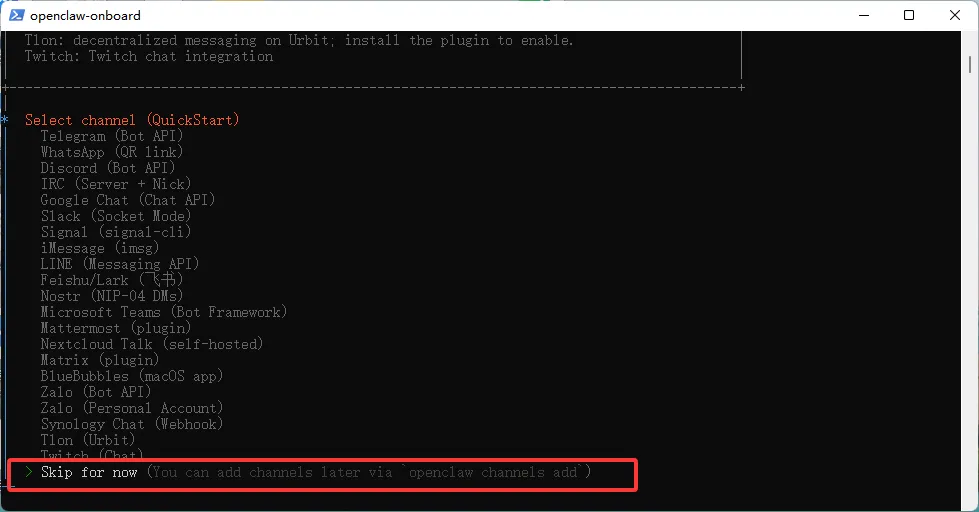

选择通讯渠道(建议选择 Skip for now (先跳过))

-

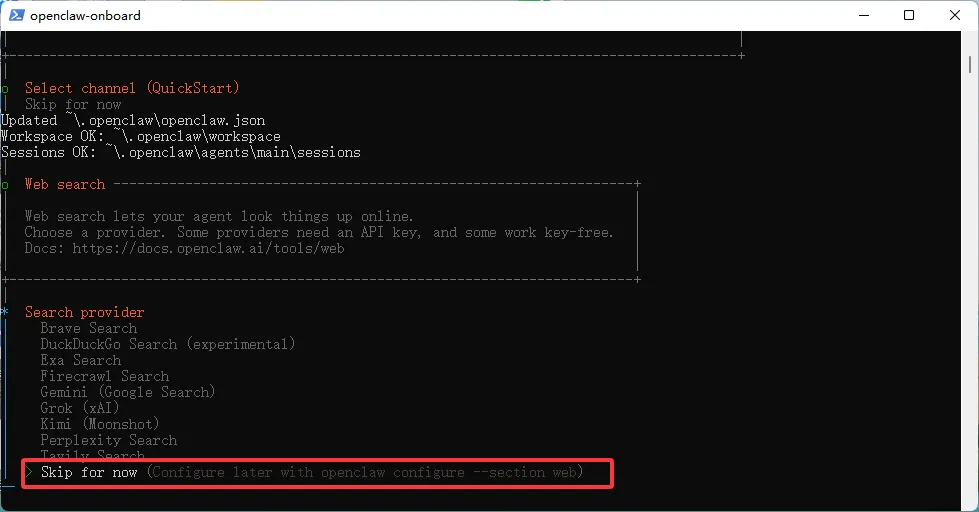

搜索服务提供商(建议选择 Skip for now (先跳过))

-

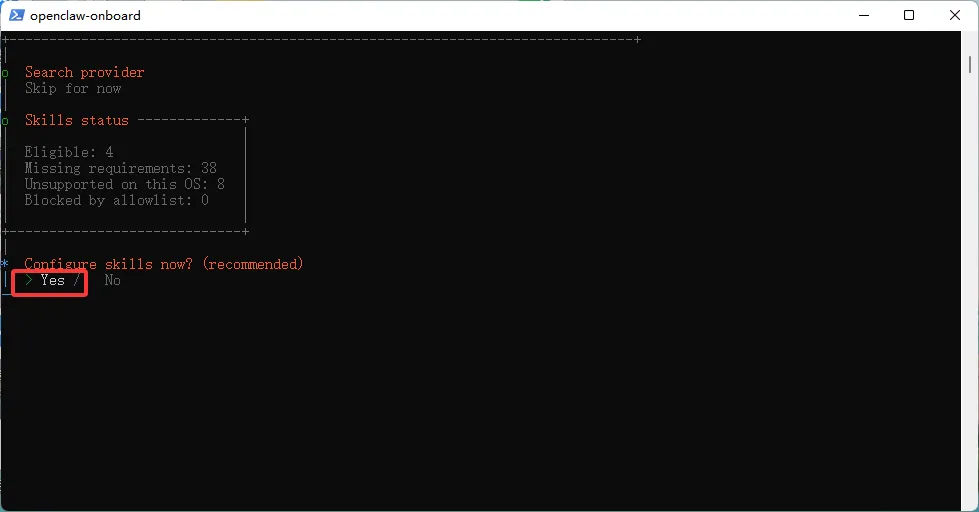

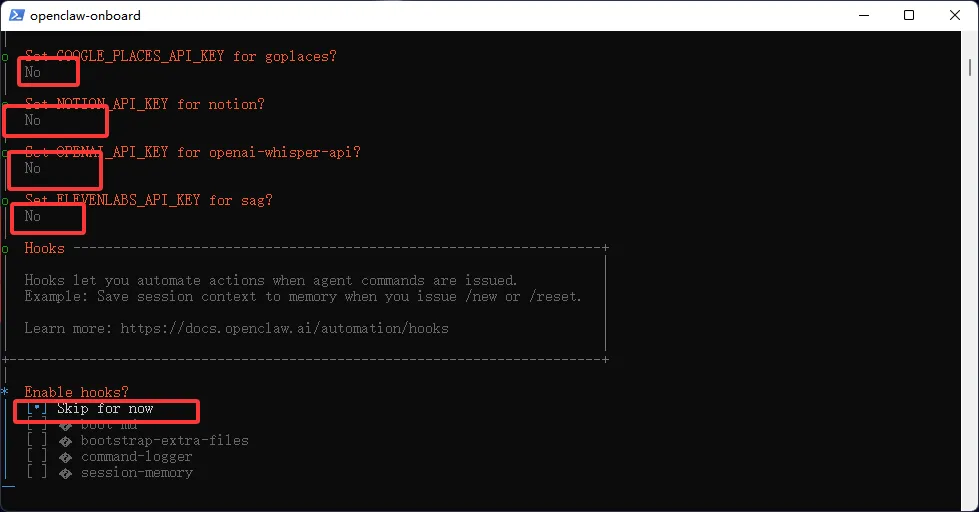

立即配置技能吗?(对于初次安装、建议选择 No ,我选了Yes)

-

立即配置技能吗?选择Yes后,我什么也提供不了,然后所有的都填写了No

启用钩子(建议选择 Skip for now (先跳过))

-

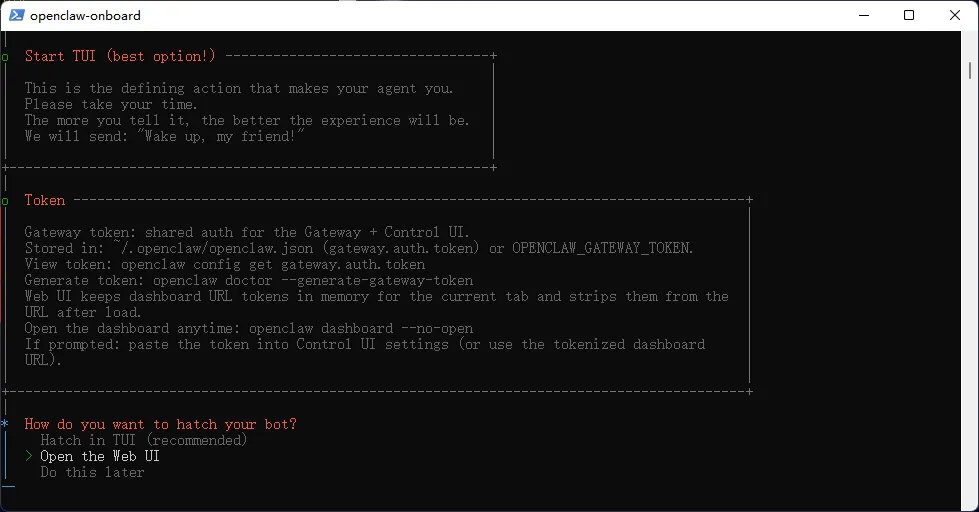

你想如何启动你的机器人(Hatch in TUI (推荐):终端交互;Open the Web UI:打开网页控制面板)

-

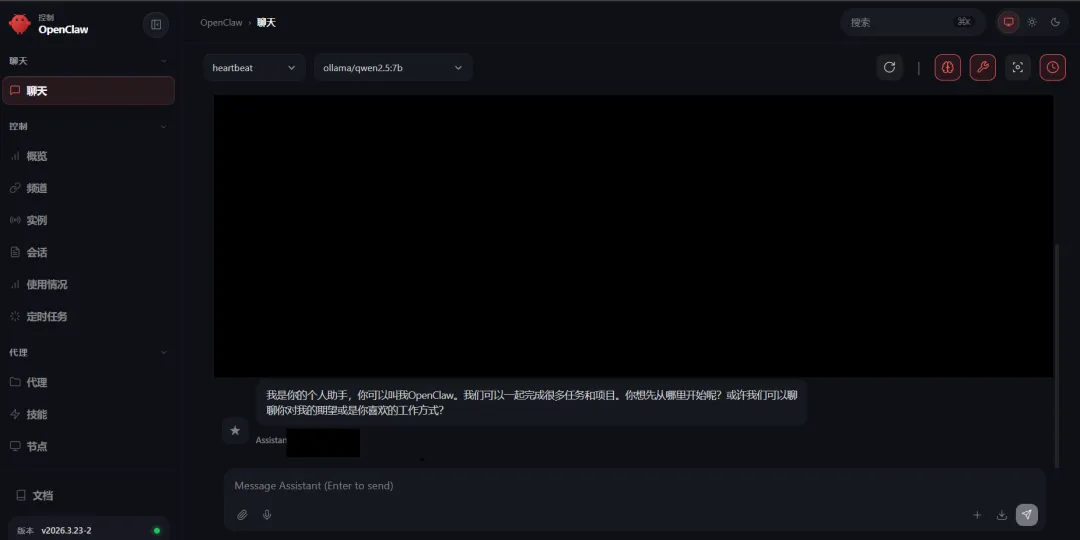

我选择了Open the Web UI,打开网页如下,并进行了测试

初始化OpenClaw配置

如果上述过程不小心被终止了,可以通过下面命令执行初始化操作,会引导你创建配置文件并安装守护进程(使OpenClaw能在后台运行):

openclaw onboard --install-daemon按照提示选择默认选项即可。这一步会在 C:\Users\你的用户名\.openclaw\ 目录下生成配置文件。

启动OpenClaw网关

网关是OpenClaw的核心服务,负责接收指令、调度模型和执行任务,默认情况下安装完成,网关已经打开,不小心关闭后,可以通过以下命令进行启动。

openclaw gateway start成功启动后,你会看到类似 Gateway started on port 18789 的提示。此时可以打开浏览器访问 http://localhost:18789 查看Web控制台。

常见问题与优化建议

Q1:Ollama运行模型时显存不足怎么办?

-

尝试更小的模型 -

调整模型上下文长度(在配置文件的 contextWindow中降低) -

关闭其他占用显存的程序

Q2:OpenClaw启动时提示“端口被占用”

网关默认端口18789,如果被占用可以修改配置文件中的 port 字段。

结语

至此,你已在Windows上成功部署了OpenClaw + Ollama的本地AI智能体系统。这套组合的价值在于:

-

数据完全私有:所有对话和操作日志都在本地 -

离线可用:不依赖任何云服务 -

可扩展:通过编写技能(Skill)让AI执行更多任务 -

GPU加速:充分发挥显卡性能,响应速度快

接下来,你可以进一步探索OpenClaw的更多功能:

-

编写自定义技能(Skill) -

接入其他渠道(如飞书、Discord) -

设置定时任务,让AI自动完成重复工作

如果你希望将这套系统接入飞书等,可以留意后续文章。欢迎在评论区分享你的部署经验!

如果本文对你有帮助,记得点赞、在看、转发!有任何问题,欢迎留言讨论~

夜雨聆风

夜雨聆风