算法半月报Vol.4|微信秒变AI助手,OpenClaw多Agent配置指南,让Agent成为超级入口

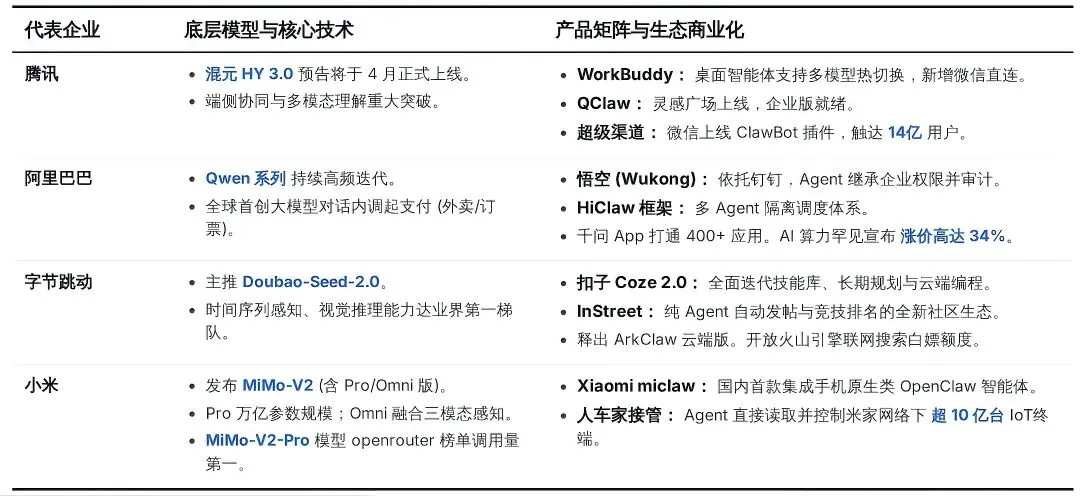

行业动态:国际头部、国内大厂和大模型公司近两周动态

模型更新:MiniMax、小米发布新旗舰模型

硬核实测:微信ClawBot和WorkBuddy、OpenClaw多Agent配置、OpenClaw接入局域网设备

1、OpenAI、Anthropic、Gemini、NVIDIA过去两周新动态

-

OpenAI 发布GPT-5.4 mini/nano两款模型,进一步降低推理成本,近期还宣布了关闭Sora。

-

Anthropic 推出Computer Use工具,手机端Claude发送指令可以操控电脑端界面。

-

Google 发布Gemini2.5 Flash Image新模型。Google新论文TurboQuant算法突破AI内存瓶颈,引发存储芯片市场震荡。

-

NVIDIA GTC 2026发布Vera Rubin GPU,显著降低推理成本,推出NemoClaw AI Agent平台。

2、国内大厂最新动态

-

微信上线 ClawBot 插件,直接触达14亿用户。WorkBuddy 企业级桌面智能体内置上百个专家技能,支持微信直连。

-

阿里发布企业级Agent应用“悟空”。千问APP生态连接能力持续领先。

-

小米发布 MiMo-V2 系列模型,新旗舰模型迈入万亿参数规模,OpenRouter 榜单调用量第一。

3、MiniMax、智谱GLM、KIMI

-

MiniMax发布M2.7模型,成为首个实现“AI训练AI”闭环迭代的模型。推出全模态统一调用计费模式Token Plan。

-

GLM发布GLM-5-Turbo,首个在训练阶段专为OpenClaw优化的基座模型。

-

Kimi核心技术反向输出,成为顶尖编码工具 Cursor Composer 2 的基座模型。Kimi团队提出了Attention Residuals(注意力残差)新方法,优化了模型在深层网络中的信息传递效率与稳定性。

1、Agentic AI 模型

智谱GLM | GLM-5-Turbo

「3月16日」智谱发布首个OpenClaw增强基座模型。主要在工具调用、复杂指令拆解、多智能体协同等核心能力进行升级,长时间任务执行更稳定。

OpenAI | GPT-5.4 mini / nano

OpenAI发布专为 Agentic AI(智能体)工作流、代码生成和高并发 API 调用量身定制的新模型。

2、新旗舰模型

MiniMax| M2.7

MiniMax M2.7 是 MiniMax 第一个深度参与自身迭代的模型,核心亮点是开启”模型训练模型”的闭环机制:M2.7 在训练过程中自主构建强化学习 Harness、更新自身 memory、优化训练流程,完成超过 100 轮无人干预的迭代循环。

小米|MiMo-V2 系列

「3月19日」三款模型齐发,MiMo-V2-Pro(推理旗舰)、MiMo-V2-Omni(全模态)、MiMO-V2-TTS(语音合成)。MiMo-V2-Pro具有1T 参数量(1万亿总参数),激活 42B,支持 100万 tokens 超长上下文窗口。曾以”Hunter Alpha”代号在 OpenRouter 匿名测试并登顶OpenRouter 调用量榜首。

3、OCR模型

百度千帆|Qianfan-OCR

在 OmniDocBench v1.5 基准测试集上:端到端架构中位列第一,超过 DeepSeek-OCR-V2。在Pipeline 架构中,PaddleOCR-VL-1.5 仍居榜首。

Ultralytics Platform

Ultralytics Platform由 YOLO 系列(YOLOv5/v8/v11/v26)创始团队打造的一站式、端到端计算机视觉(CV)AI 平台。支持智能数据标注(集成SAM3算法)、云端模型训练、多种格式导出,适配移动端、边缘端和云端部署。导出格式支持17种(包括ONNX、TensorRT、OpenVINO、TF Lite、NCNN、MNN、RKNN等)。

地址:https://platform.ultralytics.com/

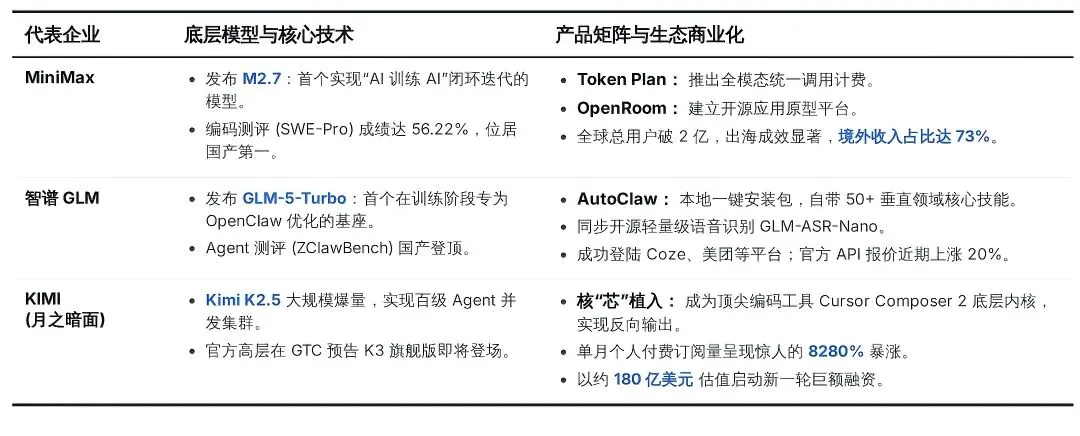

「3月22日」,微信官方发布ClawBot插件。按照以下步骤可接入OpenClaw,非常简单。

第一步,把微信更新到最新版本,去”我-设置-插件”里找到”微信ClawBot”。

第二步,复制这串命令到你部署了OpenClaw的终端。

npx -y @tencent-weixin/openclaw-weixin-cli@latest install

第三步,扫码,接入成功。

你的微信好友列表里会多出一个”ClawBot”。

那么你更想把OpenClaw接入哪个渠道呢?

如果你不想自己部署 OpenClaw,腾讯的 WorkBuddy 也是一个选择——直接内置微信 ClawBot 接入,配上上百位专家和 Skills,上手更快。

以下是WorkBuddy视频简介,你可以看到其中的Skills、上百位专家、微信ClawBot接入、大模型API配置……

为什么需要多Agent?

用过OpenClaw一段时间,你可能会遇到这些问题:

-

对话越来越长,模型开始”忘事”,也可能Skills越来越多,分不清到底使用哪个。

-

同一个Agent又要写代码、又要做调研,让同一个 Agent在不同角色之间反复横跳。一些简单但消耗大量token的任务,可以不需要配置贵的模型。

-

任务一多,需要排队等,效率上不去。

OpenClaw 原生支持并行——如果你只用一个Agent,等于白白浪费了这个能力。

多 Agent 适合什么场景?

不是所有情况都需要多 Agent,以下三类场景最值:

-

任务可以拆:大任务能分解成相互独立的子任务,并行跑。

-

需要专家角色:代码归代码 Agent 管,调研归调研 Agent 管,各司其职。

-

想省 API 费用:核心决策用好模型,基础执行用便宜模型。

OpenClaw 的多 Agent 底层是”网关 + 智能体集群”架构:Gateway 统一接收消息,按路由规则分发给不同 Agent;每个 Agent 有自己独立的工作区、人设、记忆和模型配置,互不干扰。

在这个基础上,有两种协同模式可以选:

-

模式一:SubAgent(主从委派)

一句话理解:“我叫你做什么,你就做什么。”

主 Agent 负责拆解任务、分配工作,子 Agent 执行完了把结果交回来。通讯是单向的(主→从→主),上下文独立,流程清晰。

适合场景: 流程固定、任务边界清晰的分发型工作,比如”调研+整理+写报告”这类流水线。

-

模式二:Agents Teams(团队协作)

一句话理解:“我们一起商量怎么做。”

团队成员之间可以多向通讯,支持共享记忆,角色也可以动态切换,有一个协调者统筹全局。

适合场景: 需要即时沟通、动态调整分工的复杂任务,比如多人协作开发、跨领域联合调研。

如何配置多Agents?

下面我们以“主控 Agent + 执行 Agent”的组合为例,为你拆解具体的配置流程。这套配置不仅能带你跑通标准的 SubAgent(主从委派)流程,同时模拟多人在群聊里协同办公(Teams 模式)。只需四步,就能拉起你的专属 Agent 团队。

-

第一步:接入多个应用渠道

修改 ~/.openclaw/openclaw.json,在 channels 配置中增加 accounts 节点。

以飞书为例,可以同时接多个机器人账号,示例中接入了“personal_bot”和“work_bot”两个飞书机器人。

"channels": {

"feishu": {

"enabled": true,

"connectionMode": "websocket",

"defaultAccount": "personal_bot",

"accounts": {

"personal_bot": {

"appId": "应用1的ID",

"appSecret": "应用1的Secret",

"dmPolicy": "pairing",

"groupPolicy": "open",

"streaming": true

},

"work_bot": {

"appId": "应用2的ID",

"appSecret": "应用2Secret",

"dmPolicy": "pairing",

"groupPolicy": "open",

"streaming": true

}

}

}

}

-

第二步:创建多个 Agent 实例

在 ~/.openclaw/openclaw.json里添加 Agent 配置。通过list数组配置多个Agent实例。可以为每个Agent(如示例中main和work)配置独立的模型、独立的工作空间。

“agents”: {

“defaults”: {

// 你的默认配置

},

// 以下是多Agent配置

“list”: [

{

“id”: “main”,

“name”: “Mimo”,

“model”: “zai/glm-5”,

“subagents”: {

“allowAgents”: [“work”] //授权main可以调用work

}

},

{

“id”: “work”,

“name”: “Ava”,

“workspace”: “/Users/yourname/.openclaw/workspace-work”,

“agentDir”: “/Users/yourname/.openclaw/agents/work/agent”,

“model”: “zai/glm-5” // 你可以配置不同模型

}

]

}

或者用命令行:

openclaw agents add [agent_name]

新 Agent 会自动继承 defaults 里的配置,你只需要覆写想改的部分(比如模型、工作区、人设)。

-

第三步:绑定路由

这一步是建立飞书应用账号和Agent的路由,把每个应用账号绑到对应的 Agent,防止消息发错地方。比如,示例中“personal_bot”账号路由给“main” Agent处理,发往 “work_bot”的消息由“work” Agent处理。保证了多Agent场景下的业务逻辑清晰。

“bindings”: [

{

“agentId”: “main”,

“match”: {

“channel”: “feishu”,

“accountId”: “personal_bot”

}

},

{

“agentId”: “work”,

“match”: {

“channel”: “feishu”,

“accountId”: “work_bot”

}

}

]

-

第四步:打通智能体间通讯

如果要想Agent之间互相通信,需要完成以下agentToAgent 配置。通过allow列表,限制哪些Agent可以互相调用。

“tools”: {

“agentToAgent”: {

“enabled”: true,

“allow”: [

“main”,

“work”

]

}

}

绑定完执行一次重启和配对:

openclaw gateway restart

还有这几个坑要注意:

-

并发上限 :OpenClaw 框架本身支持高并发,但 API 厂商有自己的并发限制。跑量大的任务前,先确认你用的模型允许多少并发,不然会报错。

-

文件路径混乱 :多个 Agent 同时读写文件时容易打架,需要给每个 Agent 配独立 workspace。

-

技能不共享 :不同 Agent 的 workspace 是隔离的,所以 Skills 也不互通。如需配置通用技能(比如联网搜索),建议手动复制到每个 Agent 的目录里。

-

看不到后台过程? :SubAgent 走底层 RPC,用户在群里是看不到 Agent 之间互相调用的过程的。如果你想让群里的人看到完整交互,需要换成 Agents Teams 模式。

按照上述方式配置完成后,你就可以体验多Agent协同工作啦,下面请看视频实测效果。

上面的飞书群聊实测视频中,具体实现过程是这样的:

-

把作为大管家的主Agent (personal_bot) 和负责底层执行的Agent (work_bot) 共同拉进一个飞书工作群。

-

给主Agent配置包含 session_send(主动发送消息)的技能。让它拥有了向群内其他成员主动派发任务的能力。

-

我们只需在群里直接 @personal_bot抛出复杂需求,并在提示词里顺带加一句:“可以让 work_bot 协助”。

-

指令下发后,有意思的工作流开始了:主Agent会自动进行任务拆解,并通过 session_send 技能向work_bot下发子任务。work_bot 跑完数据后,会将结果直接输出在群聊中,并在后台抄送给主Agent。

-

最后,由主Agent完成最终的全局复盘与总结。

在这个过程中,无论是人类还是主控 Agent,都能实时同步任务进度。

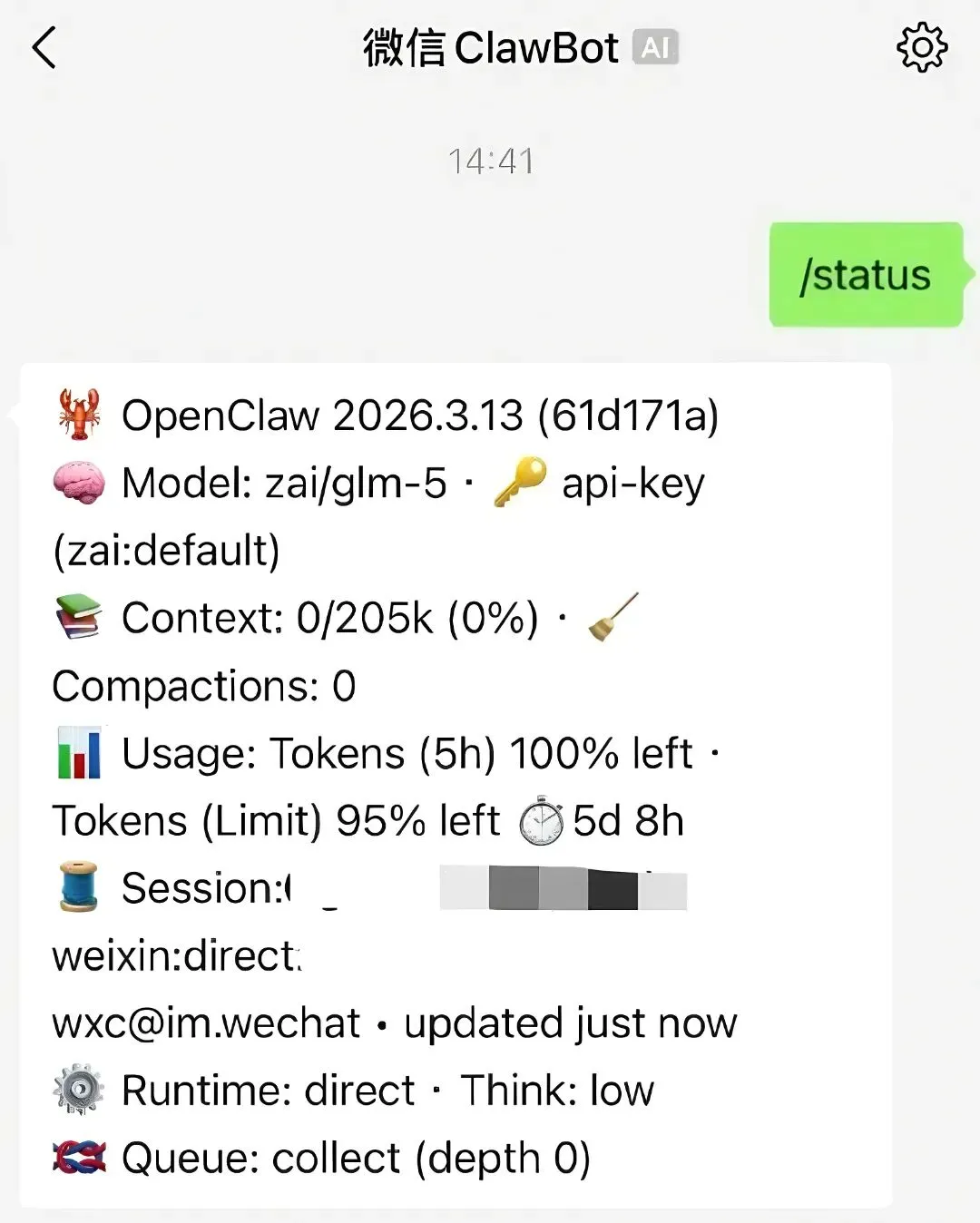

如何让本地部署的OpenClaw接入家里局域网的智能设备?

比如,给OpenClaw装个眼睛👀~

下面,我们来看一下怎么让OpenClaw接入家里的摄像头。

直接给OpenClaw输入你的需求:

“我的局域网内有一些设备,比如摄像头、小米的智能家居设备。你能帮我去连接这些设备,查看视频或者读点设备数据吗?”

按照它的提示,会要你提供该设备的局域网IP和设备的密码。按照它的提示提供信息。就可以正确接入啦。

以下是我成功接入时的对话,让我有点惊讶的是我在和主Agent对话时,自动将任务分配给了一个专门负责开发的Agent。

获取到了画面之后,还可以进行后续的视觉分析任务。

例如,接入一个本地部署的视觉大模型,让它定时推送分析结果,这样你就不用打开视频监控APP查看啦。

除此之外,你还可以在OpenClaw里对话直接控制家里的智能设备,以前需要打开各个APP进行操作,现在直接和你的AI助手对话就能实现。

AI演进:从感知到生成再到执行

从感知AI到生成AI,从生成AI到执行AI,我们正站在AI发展的第三个重要拐点上。

第一阶段是感知AI——让机器看懂、听懂世界;

第二阶段是生成AI——让机器创造内容、编写代码。

而现在,执行AI(Agentic AI)的爆发,不再是”AI能回答什么”,而是”AI能帮你做什么”。

Harness:AI时代的操作系统

如果把LLM比作CPU提供算力,上下文窗口比作RAM存储临时信息,那么Agent Harness就是包裹在LLM外围的结构化控制层——它负责任务调度、工具驱动、状态管理、内存治理。

Claude近期的一系列动作验证了这一趋势:Claude Code让开发者改变了编程方式;最新发布的Computer Use功能让Claude可以直接控制Mac的鼠标、键盘和浏览器。Anthropic正在构建一个完整的AI OS形态。

一个Agent对接多个软件

Andrej Karpathy(OpenAI联合创始人、前特斯拉AI总监)在最近的访谈中提到他正在疯狂地尝试把Agent接入一切,探索可能性的边界。

以前需要多个APP分别管理,现在可以通过Agent方式接入,一个Agent对接所有软件,软件不再需要独立的APP,而是提供标准化的API接口。

OpenAI最新战略提出要打造桌面超级APP,将ChatGPT、Codex编程平台和Atlas浏览器整合为一个统一入口。

未来的软件形态正在从”人使用”变成”Agent使用”。

更多内容,敬请期待

夜雨聆风

夜雨聆风