Claude Code 51万行源码泄漏:外行看翻车热闹,内行看AI Agent工程门道

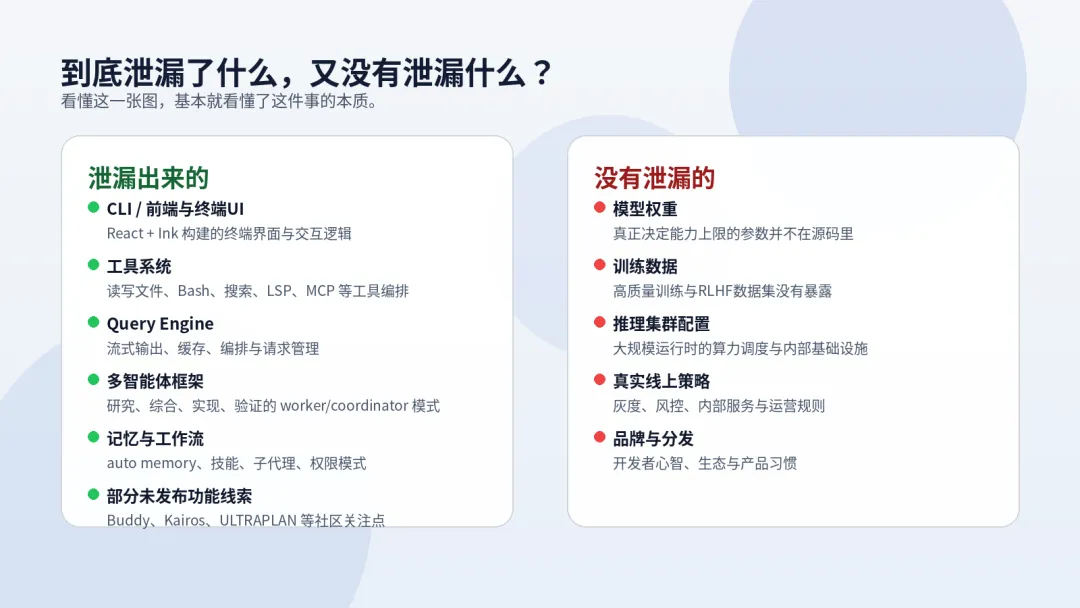

这次泄漏真正暴露了什么,以及社区为什么会对那些“有趣细节”如此兴奋

|那些“有趣细节”,都在指向产品未来

社区这次最兴奋的,是从代码里扒出了一堆很有画面感、也很有启发性的细节。表面上看,它们有的像彩蛋,有的像内部实验,有的甚至有点离谱;但如果往深一层看,这些细节反而把 Anthropic 对产品未来的判断暴露得更清楚了。

1)Buddy:在试探“人格化工作界面”的边界

公开社区分析普遍提到,代码里存在一套名为 Buddy 的终端电子宠物系统,包含稀有度、变体和 ASCII 动画。第一眼看会觉得很闹,甚至像工程师摸鱼时偷偷塞进去的彩蛋。但换个角度,它其实很像一种产品实验,AI 助手不再只是一个冷冰冰的输出框,它要长期与开发者协作,系统是不是要拥有一点陪伴感、辨识度和情绪张力?

它说明顶级团队已经在思考一个问题:AI 助手的价值不只来自能力,也来自关系。一个每天待在终端里的 Agent,未来未必只是工具,它可能会成为一种有存在感的工作伙伴。

2)Dream:把“记忆整理”做成后台能力,说明Agent正在走向长期主义

社区还提到一个叫 Dream 或 autoDream 的机制,核心是让它定期整理记忆。这一点其实特别关键。因为 AI Agent 一旦从一次性问答走向真实工作,就一定会撞上一个问题:怎么记住真正值得记住的东西,又不让上下文无限膨胀。

Anthropic 官方文档已经公开了 Auto Memory 的设计,Claude 会把构建命令、调试经验、架构笔记、代码风格偏好等内容,写入项目级 memory 目录,并把 MEMORY.md 控制在一个有限的规模内。

这跟社区提到的“Dream”机制结合起来看,这跟人的记忆方式很像,我们不会记得所有发生过的事情,但我们的大脑在睡梦中会主动做压缩、归纳和索引。

这背后的启发很大。未来真正高价值的 Agent,不是“上下文越长越强”,一定是是要“越会整理、越会遗忘、越会留下真正重要的东西”。

这两天我在往Google的Gemini做拷贝时,就让GPT整理出关于我的记忆,我很惊奇地发现,它记下了每一个核心重点,这些加起来,就是一幅指向我的画像。

3)Undercover:最有戏剧性的细节,恰恰暴露了AI时代的新型组织问题

在所有社区梳理出的细节里,Undercover Mode 可能是最具传播性的一个。按照公开分析,它的核心作用是:当内部员工在公共开源仓库里使用 Claude Code 时,系统会额外约束提交信息和 PR 描述,避免无意中暴露内部代号、未发布版本、内部工具或“这其实是AI写的”等痕迹。

这个功能有意思的地方在于,它在解决一个更现实的新问题,当 AI 真正进入企业工作流,它会不会把组织边界、内部知识和品牌策略一起带出来?

换句话说,Undercover 代表的是一种新型治理需求。未来公司不只要防员工泄密,还要防 Agent 在正常工作中“说漏嘴”。从这个角度看,这次事故最讽刺的地方也就在这里:Anthropic 在系统里认真设计了避免“暴露身份”的模式,结果却因为打包疏漏把更多东西暴露给了外界。

4)Coordinator:多智能体有工程手册了

社区对 Coordinator Mode 的兴趣很高,不是偶然。因为多智能体一直是这两年 AI 领域最容易被吹、也最容易做成 PPT 的概念之一。真正难的是,多个 Agent 怎么分工、怎么共享上下文、怎么避免互相甩锅、怎么做验证和回收。

公开分析里提到的流程很典型:研究 worker 并行理解代码库,协调者汇总问题并生成规格,实施 worker 做定点修改,验证 worker 跑测试和验收。这说明多智能体已经在朝有角色、有时序、有权限边界的协作系统发展。

这对整个行业的启发是:Agent 的下一阶段,不一定是让单个模型更聪明,而可能是让多个相对可靠的角色,在清晰的工作流里配合得更好。

5)Kairos 与 ULTRAPLAN:两个名字,把未来两条产品线都点出来了

Kairos 被社区解读为更接近“常驻型助理”的模式,强调持续观察、主动出手和简短反馈;ULTRAPLAN 则更像一个深度规划模式,把复杂任务丢到云端长时间思考,再把结果带回本地。无论这些细节最终是否按原样发布,它们都已经指向了两个非常清楚的方向。

第一个方向,是 Agent 从“被叫一下才出现”,走向“在一旁持续待机、在合适时机提醒或行动”。第二个方向,是把本地轻交互与云端长思考做成分层产品:简单任务在本地快跑,复杂规划交给云端慢想。

这也是为什么这些细节不只是“八卦”。因为它们把 Anthropic 可能押注的下一代交互方式,提前露出了一角。

|这次泄漏对行业最大的启发是什么?

第一,AI 编码工具的门槛比很多人想的高得多。一个真正能在真实项目里跑起来的系统,背后远不只是“模型接个编辑器”这么简单,还有工具、权限、记忆、云端执行、审计、协作、UI 全部缠在一起。

第二,Agent 的价值越来越来自工作流,而不是单轮回答。公开文档里已经能看到 Skills、Subagents、Auto Memory、Cloud Tasks、Auto Mode 这些要素,它们共同说明一件事,要做得更像一个能长期干活的系统。

第三,真正的护城河在发生迁移。模型权重、训练数据和推理基础设施依然是最难复制的部分,但用户真正能感知到的竞争力,正在更多地体现在系统组织能力上。谁更会做审批,谁更会记忆,谁更会调度,谁更会把复杂任务拆开并兜底,谁就更可能赢得开发者。

Anthropic这次丢脸,却给行业上了一课

这无疑是一次工程事故,source map 被打进生产包,本身就是不该发生的低级错误。但如果只停留在嘲笑层面,又会错过真正有价值的部分。

它让外界第一次更清楚地看到:顶级 AI 编码产品,到底是怎么被做出来的,一整套关于工具调用、权限治理、长期记忆、多智能体协作和云端执行的系统工程。

这次泄漏暴露是 Claude 的一段小插曲。它让行业明白,模型依然重要,但真正决定产品胜负的,正在越来越多地落到系统层、工作流层和组织层。谁能把这些东西做顺,谁才有机会做出下一个真正像“数字同事”的 AI 工具。

夜雨聆风

夜雨聆风