AI 画图的重点变了:从生成图片,到生成视觉资产

过去两年,AI 画图一直有点拧巴。

它当然能画出漂亮图。电影感、赛博风、产品海报、人物肖像,一眼看上去都挺像那么回事。

但你真想把它放进内容生产流程里,问题马上就来了:中文字容易崩,版面容易乱,同一个主题很难稳定做出一套统一素材。

所以过去很多 AI 生图工具,本质上更像一个“灵感抽卡机”。

它能给你惊喜,但很难稳定交付。

这次 OpenAI 发布 ChatGPT Images 2.0,真正值得关注的地方,不是“图片又变好看了”。

更准确地说,是 AI 画图正在从“生成一张图片”,变成“生成一套视觉资产”。

GPT Image 2.0 真正改变的,不是 AI 更会画图了,而是它开始接近一个能理解内容、组织版面、生成成套视觉资产的设计助理。

省流版

如果只看这一篇的核心判断,可以先记住这几句:

-

AI 画图的重点正在从“画得好看”,变成“能不能进入发布流程”。 -

内容创作者缺的不是一张漂亮图,而是一套能复用的视觉资产。 -

文字、版面、信息图、比例适配、风格一致性,正在变成 AI 图像能力的一部分。 -

设计师不会因为它消失,但只会机械出图的人会更难受。 -

以后真正拉开差距的,不是谁先点出一张图,而是谁先把图接进自己的内容生产系统。

一、以前的问题:好看,但不好用

以前 AI 画图最烦人的地方,是“看起来很强,用起来很虚”。

你让它画一个未来城市,它能画。

你让它画一个人在雨夜街头,它也能画。

但你让它做一张能发出去的中文海报,或者一张能解释概念的信息图,它就容易露馅。

常见问题大概有几类:

-

文字乱码,尤其是中文标题和短句。 -

标题位置奇怪,视觉层级不清楚。 -

图标和箭头乱飞,看着像信息图,但读不出逻辑。 -

单张图还行,一旦要做成一组统一素材,就很难稳定。

这就是 AI 图片过去最大的断点:

它擅长制造视觉效果,但不擅长承载信息。

内容创作者最需要的,恰恰不是纯效果。

是信息被看见。

是观点被记住。

是读者扫一眼图,就知道这段内容在讲什么。

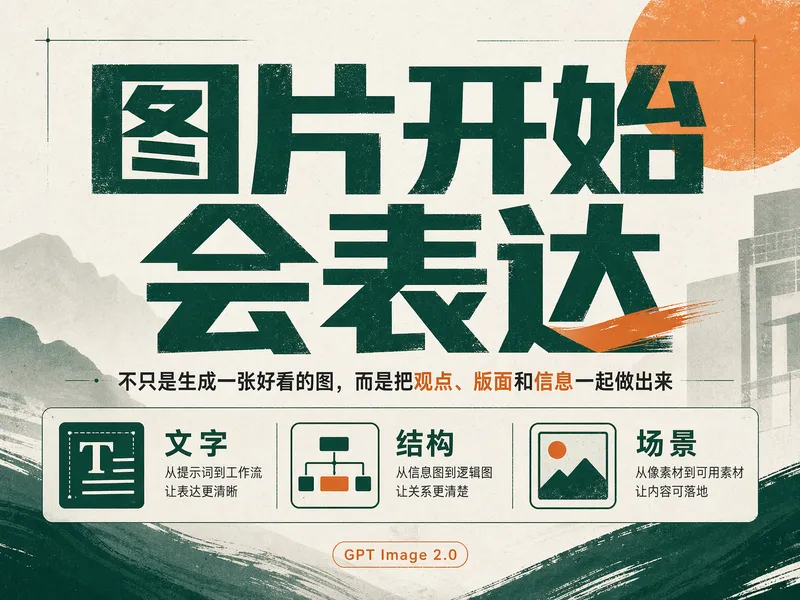

二、真正变强的是:图片开始参与表达

我更愿意把这次更新理解成一个方向变化:

AI 图像模型开始从“图像生成能力”,向“视觉表达能力”靠近。

这也是为什么中文排版很关键。

不是因为中文几个字多难,而是因为文字一旦进入图片,它就不再是装饰。

标题、层级、留白、图标、说明、结论,这些东西加在一起,才叫设计。

如果 AI 能更稳定地处理这些关系,它影响的就不是插画师一个岗位,而是整个内容生产流程。

因为今天大多数创作者缺的不是一张漂亮图,而是一套能直接进入发布流程的图。

比如一篇文章写完,你真正需要的可能是:

-

一张公众号封面。 -

两三张正文解释图。 -

一组小红书轮播卡片。 -

一张信息图。 -

一张适合 X 或朋友圈传播的横版图。

过去这些环节往往是割裂的。

写稿是写稿,配图是配图,修图是修图,排版是排版。

但如果 AI 能理解文章主题,知道这张图要表达什么,知道不同平台需要什么比例,知道文字应该放在哪里,知道哪些信息要突出,事情就变了。

它不再只是画图。

它开始参与表达。

三、真实感不是为了炫技

过去很多 AI 图片有一种很明显的“塑料感”:皮肤太光、光影太干净、背景太完美,乍一看精致,细看就不像真实世界。

现在更有意思的变化,是它开始学会保留一些“不完美”:雨夜的反光、镜头里的颗粒、人物边缘的暗部、墙面上的旧痕迹、海报被环境光影响后的色偏。

这些东西不一定让图片更“干净”,但会让图片更像可以使用的素材。

真实感不是为了炫技。

它的价值在于,让一张图更容易进入真实传播场景。

如果你要写一篇关于 AI 视觉生产的文章,一张雨夜街头看海报墙的图,比一张抽象科技光效图更有说服力。

四、真正值得盯住的是工作流

OpenAI 这次把 ChatGPT Images 2.0 放进 ChatGPT,同时 API 侧也有gpt-image-2这个模型名。

对普通用户来说,它意味着你可以在对话里直接生成和修改图像。

对开发者和工具来说,它意味着图像生成能力可以进入产品流程。

这两件事叠在一起,才是关键。

过去你写内容,可能是这样:

-

先写文章。 -

再想配图。 -

再找工具做图。 -

再手工改比例。 -

再给不同平台重做一版。

现在更理想的流程是:

-

先确定文章判断。 -

再让 AI 根据这个判断生成视觉方向。 -

然后按公众号封面、正文图、小红书卡片、横版传播图分别输出。 -

最后由人来做选择、删减、校对和审美判断。

注意,人的位置并没有消失。

但人的工作重心会变。

以前你可能花很多时间在“做图”本身。

以后你更多是在判断:这张图有没有服务观点?有没有跑题?是不是太像 AI?文字有没有错?这套图能不能形成统一表达?

也就是说,AI 不是把设计这件事消灭了。

它是把低层级的制作成本压下去,然后把人的判断暴露得更明显。

五、设计师不会消失,但边界会被重画

我不太赞成把这次更新简单写成“设计师要完了”。

更准确的说法是:

真正难受的,不是设计师,而是只会机械出图的人。

真正懂内容、懂品牌、懂传播、懂审美判断的人,反而会拿到更强的杠杆。

以前你交付一张图。

以后你可能要交付一套视觉系统。

以前你接一个“帮我做封面”的需求。

以后客户可能会问:能不能顺手把公众号、小红书、视频封面、投放图一起做出来?

这才是变化真正发生的地方。

不是“图片更好看”。

而是“视觉生产的单位变大了”。

-

从单图,变成资产包。 -

从提示词,变成工作流。 -

从灵感抽卡,变成可迭代的内容生产。

六、越强的图,越需要审图流程

当然,它也不能被神化。

图中文字仍然要人工检查。

复杂信息图仍然可能出现逻辑错误。

人物、品牌、事实、数据、版权和使用场景,都需要人来兜底。

尤其是知识类内容,不能因为图看起来高级,就默认它说得对。

AI 图像模型越强,越容易让人降低警惕。

过去一张图如果很假,你会自然怀疑它。

但如果一张图既好看、又有排版、又像信息图,读者反而更容易相信它。

所以接下来内容创作者真正要补的能力,不只是“会不会用 GPT Image 2.0”。

而是能不能建立一套审图流程:

-

文字有没有错? -

信息有没有错? -

图和文章判断是否一致? -

视觉风格是否统一? -

它是不是只是好看,但没有信息增量?

这个流程,会变得越来越重要。

因为 AI 越强,垃圾图也会越像精品图。

最后

GPT Image 2.0 值得写,不是因为 AI 又会画图了。

而是因为 AI 画图的重点变了。

以前我们问的是:它能不能画出一张漂亮图?

现在更应该问的是:它能不能把一个观点,变成一套可发布、可复用、可迭代的视觉资产?

如果答案越来越接近“能”,那受影响的就不只是设计行业。

内容生产、品牌传播、教育课件、产品原型、广告投放,都会被重新组织一遍。

下一阶段的竞争,不是谁能生成一张更炸裂的图。

而是谁能把文字、判断、版面、图片和发布渠道,连成一套稳定的工作流。

以后真正拉开差距的,不是谁先点出一张图,而是谁先把图接进自己的内容生产系统。

这才是 GPT Image 2.0 真正值得盯住的地方。

夜雨聆风

夜雨聆风