今日资讯|OpenAI重夺生图王座,Meta开始记录员工键盘

点击蓝字 关注我们

ENTERPRISE

每日AI资讯

Daily News

每天5分钟

资讯早知道

前言

早上好,人工智能爱好者们。

过去大家讨论AI,更多还是在看模型谁更强、产品谁更快。今天这期更值得看的是另一层变化:AI已经不只是提升生成质量,而是在进一步吃掉创作流程、研究流程,甚至开始反过来记录人类自己的数字工作方式。

今日资讯摘要

-

OpenAI推出 ChatGPT Images 2.0,重新拿回图像生成的头部位置。

-

Meta开始记录员工击键、鼠标和截图,用真实办公行为训练AI代理。

-

Google把 Deep Research 推进到 Max 版本,研究型工作流继续产品化。

-

今日AI工具与快讯:Claude Live ArtifactsExa Deep Max、Genspark Build 和 Stitch 的 DESIGN.md 继续推进。

PART 01

OpenAI重新把生图王座抢了回来

过去很长一段时间,OpenAI在图像生成上都不算最被关注的那一个。

这次更新真正值得注意的,不只是画得更好,而是它开始让图像模型“先想、再找、再检查”。

一

具体情况

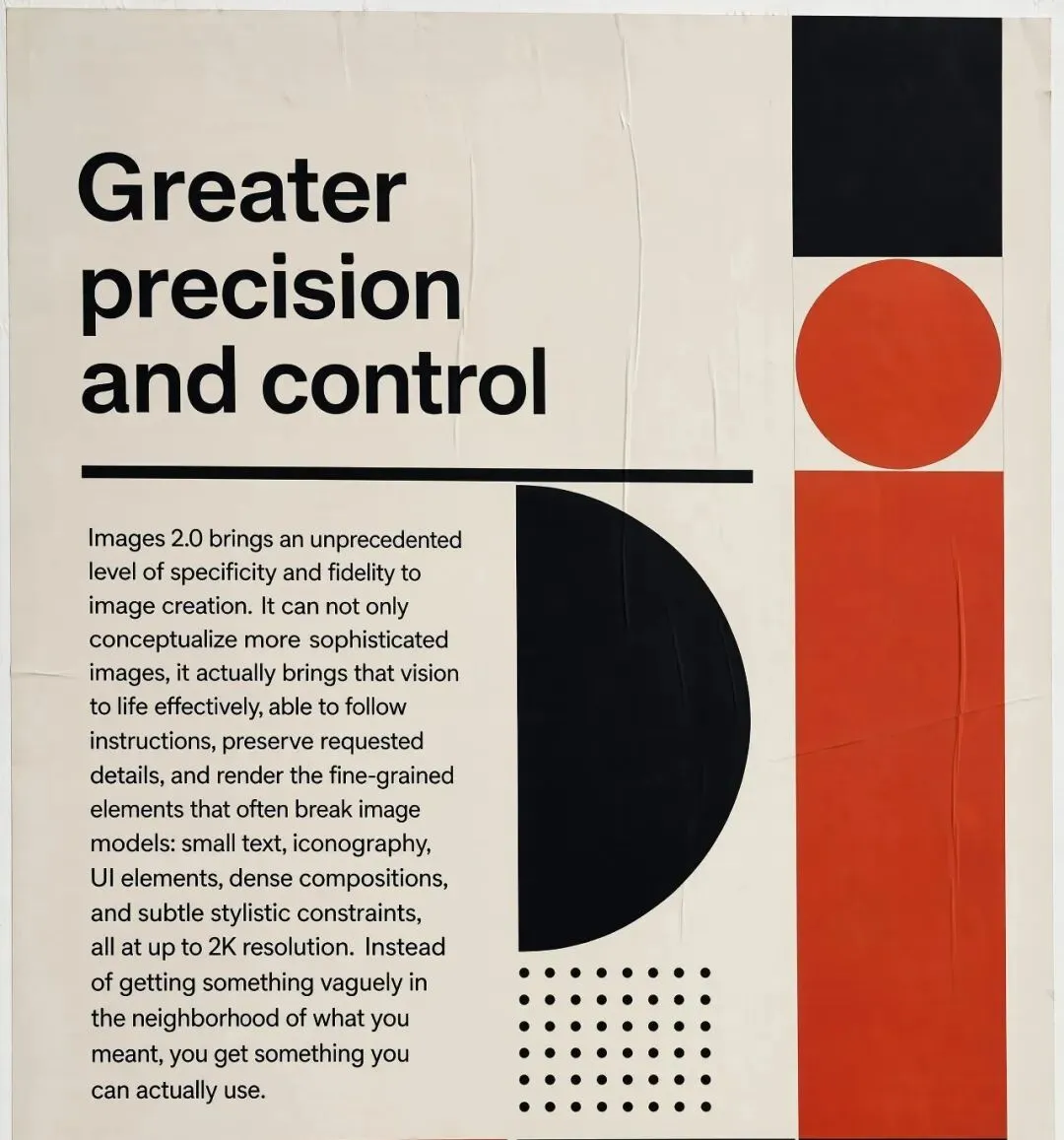

据The Rundown在2026年4月22日的整理,以及OpenAI在2026年4月21日发布的官方说明,OpenAI正式推出 ChatGPT Images 2.0,并将其称为目前“最聪明”的图像生成模型。

这代模型最核心的变化,不只是画质升级,而是会在生成前先进行规划、搜索参考信息,并在交付前做错误检查。

按照The Rundown援引的数据,它已经登上 Arena AI 文生图榜首,并且对 Google 的 Nano Banana 2 形成了明显领先。

功能层面,Images 2.0 支持 2K 分辨率、单次最多 8张 图像输出、从 3:1 到 1:3 的宽高比范围,以及多语言文字渲染。

Sam Altman还把这次升级形容为“像是一下子从 GPT-3 跳到 GPT-5”,目前模型已接入 ChatGPT、Codex 和 API。

二

为什么重要

这件事真正值得注意的,不只是OpenAI又赢了一次榜单,而是图像模型的工作方式开始变化。

过去大家比的是“谁生成得更像”,现在开始比“谁更像一个会思考的视觉助手”。

如果模型已经能自己规划、查资料、校对结果,那它带来的就不只是更好的图片,而是新的创作工作流。

Daily News

2026

Daily News

PART 02

Meta开始把员工日常操作变成AI训练数据

Daily News

机器人公司这些年一直在录人类怎么抓取、怎么行走、怎么完成物理动作。

Meta现在做的,是把这套思路直接搬到办公室电脑上。

具体情况

据The Rundown在2026年4月22日援引 Business Insider 的报道,Meta正在推进一项名为 Model Capability Initiative 的内部计划。

这项计划会记录美国员工工作电脑上的截图、击键和鼠标行为,并用这些真实操作数据训练AI系统。

目前记录范围明显偏向开发和知识工作场景,覆盖 VSCode、Meta 内部助手 Metamate、Google Chat 和 Gmail 等应用。

更受争议的一点在于,内部沟通中明确表示这项记录“没有退出选项”。

报道还提到,大约 8000名 Meta 员工将在 2026年5月20日 离职,而这套系统从他们离开前一个月就开始记录对应工作流。

意义

这说明AI训练正在从“互联网公开数据”继续走向“真实工作过程数据”。

一旦模型开始学习人类在软件里的连续操作,它训练的就不只是回答能力,而是更接近完整的电脑使用能力。

问题也同样明显:当公司把员工日常工作直接变成训练语料,AI效率提升和组织伦理之间的矛盾只会越来越尖锐。

Daily News

2026

PART 03

Google把研究代理推到“Max”版本

Daily News

研究型工作,一直是最容易被AI切进去的高价值场景之一。

Google这次做的,不只是再发一个新功能,而是把研究工作正式往“可组合、可接私有数据、可直接嵌进产品”的方向推进。

一

详情

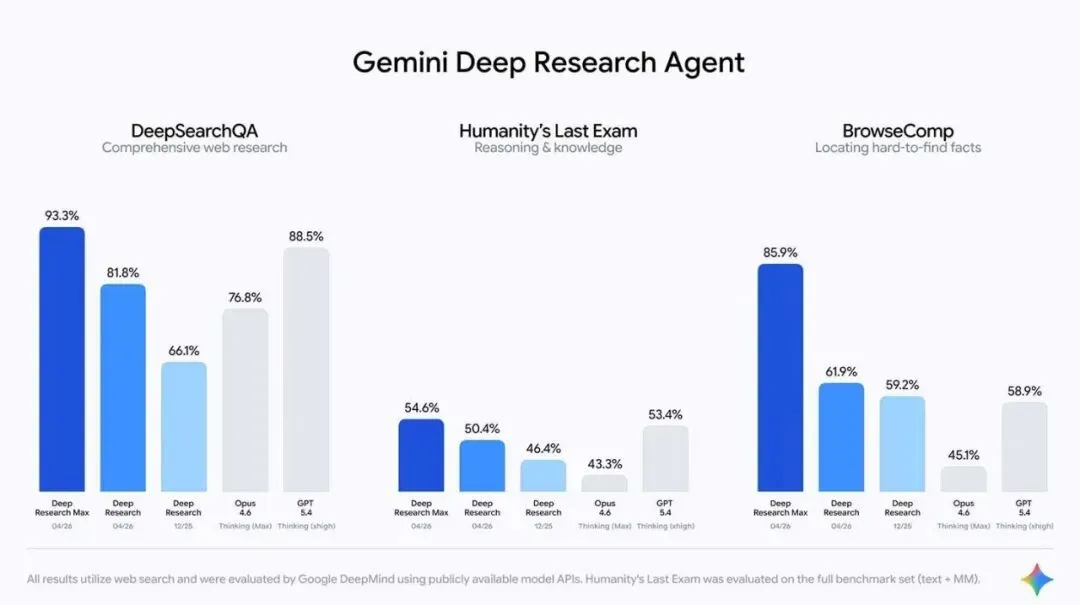

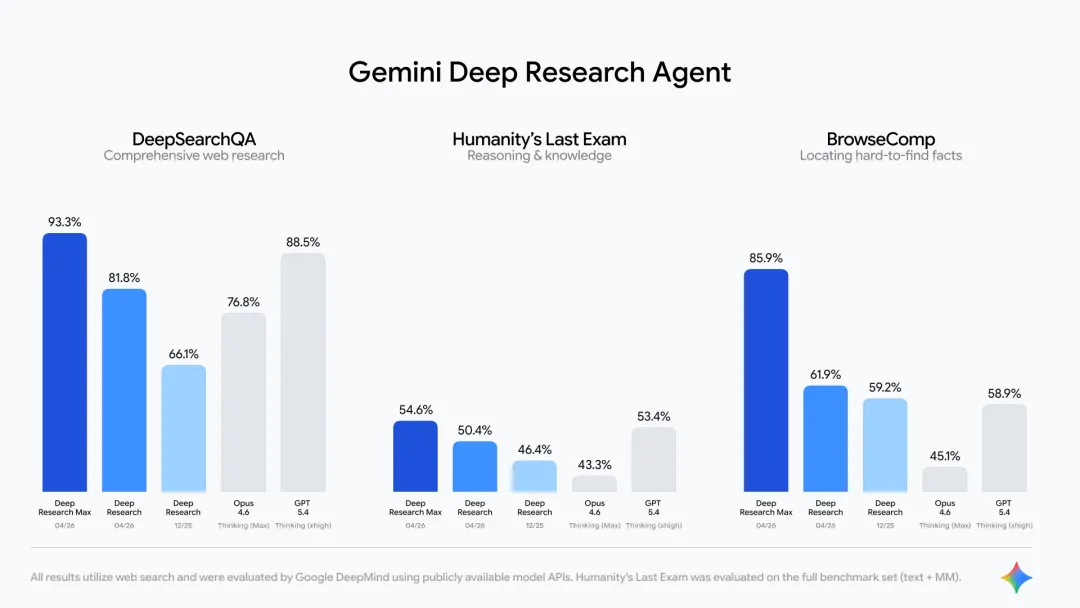

据The Rundown在2026年4月22日的整理,以及Google同日发布的官方博客,Google推出了 Deep Research 和 Deep Research Max。

两者都基于 Gemini 3.1 Pro,可以从公开网页、上传文件,甚至任意 MCP server 中收集信息并生成研究报告,同时支持图表和信息图输出。

Google表示,这一版本已经取代了2025年12月预览的旧版 Deep Research,并与 NotebookLM 内部研究引擎打通。

按照Google自己的基准测试,Max 在检索和推理任务上比旧版提升明显,也优于 Opus 4.6 和 GPT-5.4 等对手。

另外,用户既可以把开放网络搜索与私有数据、MCP 服务混合使用,也可以完全关闭外部网络,只在自己的数据范围内研究。

Google还提到,正在与 PitchBook、S&P 和 FactSet 等机构合作,把付费金融数据直接接入研究流程。

二

影响

这意味着研究型AI已经不再只是“帮你搜一搜”,而是开始成为一个可产品化、可嵌入、可收费的研究引擎。

对咨询、金融、法律和分析型岗位来说,这种变化会非常直接。

接下来真正值得盯的,可能不只是哪个研究代理更聪明,而是谁先把高价值行业数据和代理工作流绑定在一起。

Daily News

2026

PART 04

今日AI工具与快讯

今日工具与快讯:从“会不会用”走向“能不能稳定产出”

-

ChatGPT Images 2.0:OpenAI新一代图像模型,支持先规划、查资料、再生成。

-

Deep Research Max:Google研究代理新版,支持网页、文件和 MCP 数据源混合研究。

-

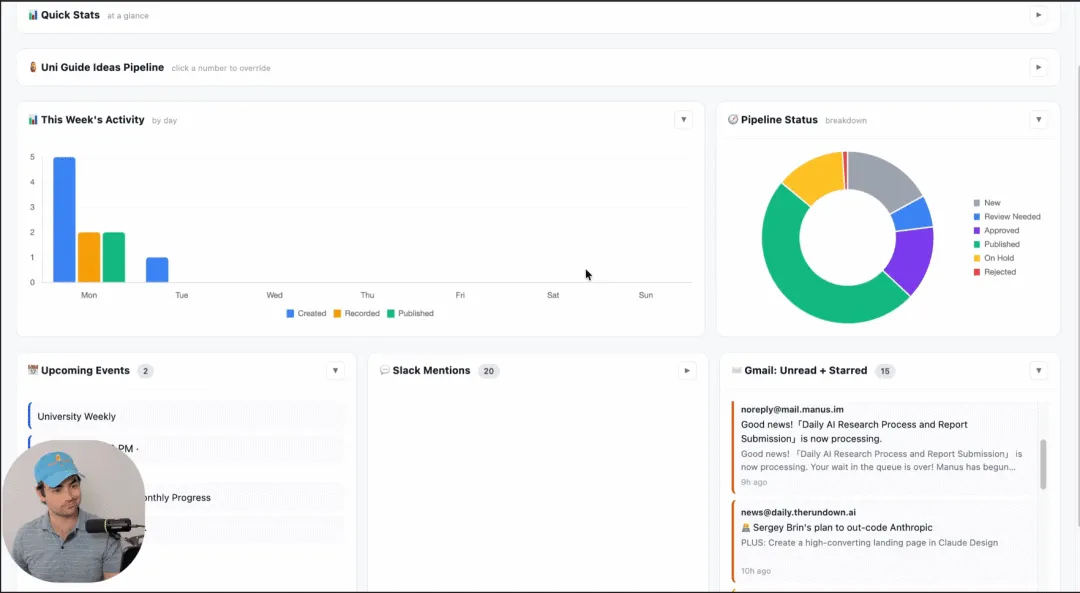

Claude Live Artifacts:可把日常任务、邮件、日程和关键指标整合成一个动态指挥台。

-

Deep Max:Exa推出的新搜索代理工具,强调更强准确率和更快响应。

快讯速览

-

前 OpenAI 研究副总裁 Jerry Tworek 推出 Core Automation,目标同样是做“AI构建AI”的实验室。 -

Meta又从 Mira Murati 的 Thinking Machines Lab 挖走 3名 成员,离开的创始成员总数已增至 7人。

-

Google把 Stitch 的 DESIGN.md 开源,让AI代理更容易理解项目颜色、无障碍和品牌规则。

-

Genspark推出 Build,这是一款基于 Claude Opus 4.7 的代理式 vibe coding 工具,可从文本直接生成网站和应用。

-

Deezer披露,目前每天有约 7.5万首 AI 音乐上传到平台,占新增上传量的 44%,但只获得 1%到3% 的播放,占多数的 85% 还被标记为欺诈内容。

Daily News

2026

END

今天这几条放在一起看,方向已经越来越清楚:

AI正在同时改写三件事:图像怎么被生成、研究怎么被自动化、以及人类自己的工作行为又如何反过来被机器学习。

接下来真正值得盯的,可能不只是模型又涨了几分,而是谁先把AI接进完整流程、接进真实工作、接进持续可迭代的数据闭环里。

以上是今日资讯的全部内容。我们明天见。

版权说明

本文内容整理自网络及官方公开资料

仅供学习交流,不作商业用途

如有侵权请联系删除

夜雨聆风

夜雨聆风