AI给你的建议害了你,那是谁的错

你把一个重要的财务决策交给了AI,它给出了一个看起来很专业的建议,你照做了,结果亏了。你去找AI,它不存在。你去找平台,平台说这只是参考信息。你去找律师,律师说举证很难。这不是假设场景,这正在发生。

有一种损失叫「按正确流程操作后的失败」。你没有轻信路边的野广告,你用的是正规平台、知名产品,你认认真真把问题输进去,AI给了你一个有来有据、条理清晰的法律建议或投资分析。你照着做了。然后出了事。这时候你发现,整个系统里没有一个人对你负责。

问题不是AI会不会出错,而是出错之后谁接着

AI出错这件事本身不值得大惊小怪。人类律师也会出错,人类顾问也会判断失误。真正值得认真对待的问题是:出错之后的责任链断了。传统专业服务里,律师有执照,顾问有资质,出了问题有监管机构、有职业赔偿险、有诉讼渠道。这套体系不完美,但它存在。而AI建议目前落地的方式,是把责任链切断之后再提供服务。

几乎所有主流AI产品的用户协议里都有类似的表述:本产品提供的信息仅供参考,不构成专业法律或财务建议,用户应自行判断并承担相应风险。这句话的法律意义非常明确——平台在你使用之前就已经把责任推出去了。你点了「同意」,你就接受了这个安排。问题是,大多数人点「同意」的时候根本没读这段话,更没想到它在关键时刻意味着什么。

「

免责声明不是中性的技术文件,它是一份责任转移合同。

」

三个角色,三种推卸方式

当AI建议出了问题,现场通常有三个角色:模型开发商、应用平台、用户。每个角色都有自己的推卸逻辑,而且每一套逻辑单独看都有点道理。

1模型开发商会说:我们提供的是底层能力,具体怎么用、用在哪里是平台的事,我们不直接面向用户。

2应用平台会说:我们已经在显眼位置注明了「仅供参考」,用户知情后自主使用,我们不是专业机构,不能对内容准确性负责。

3用户如果去投诉,会被告知:你作为成年人应该对自己的决策负责,AI只是一个工具。

这三套逻辑叠在一起,形成了一个责任真空。没有人撒谎,但受害者也什么都得不到。这不是某个坏人设计的阴谋,而是一个系统性的结构问题——现有的法律框架是为人类专业服务设计的,它预设了一个可以被追责的主体,而AI的产业链条恰好把这个主体稀释掉了。

「仅供参考」这四个字,正在做一件很严重的事

我们需要认真对待「仅供参考」背后的心理机制。当一个系统的界面设计得像专业工具,回答语气像专业顾问,给出的内容像专业报告,用户的心理预期就会自动校准到「专业建议」的水位。然后在最后加上「仅供参考」,这不是在提供信息保护,这是在制造认知错位。

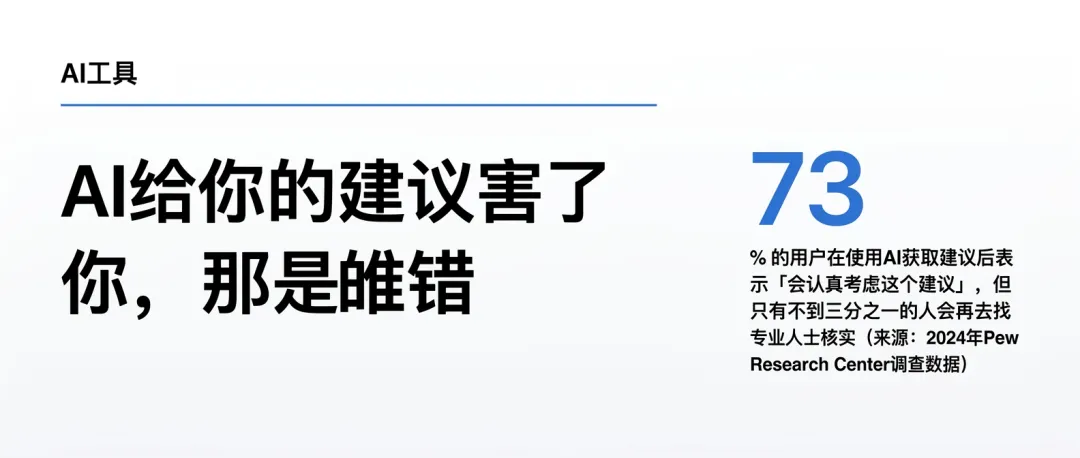

73

% 的用户在使用AI获取建议后表示「会认真考虑这个建议」,但只有不到三分之一的人会再去找专业人士核实(来源:2024年Pew Research Center调查数据)

这个数字说明了什么?它说明「仅供参考」在实际使用场景里几乎没有起到它声称的警示作用。用户的行为模式和他们接受了专业建议之后的行为模式高度相似。平台收获了「专业服务」的用户粘性,却通过「仅供参考」保留了「非专业服务」的法律豁免。这是一种不对称的商业设计,不是中立的技术选择。

方向盘的比喻为什么不够用

谈到AI治理,有一个流行的比喻:「不是给AI踩刹车,而是给它装方向盘和安全带。」这个比喻听起来很平衡,但它有一个盲点——汽车出了事故,我们知道找谁:找司机、找车企、找道路管理方。法律体系花了几十年把汽车事故的责任链建立起来。AI建议出了问题,现在连「谁是司机」这个问题都还没有答案。

更准确的比喻也许是:我们现在坐上了一辆没有登记车牌、没有驾照要求、没有强制保险的车,然后被告知「出了事自己负责」。这不是方向盘和安全带的问题,这是整个道路交通体系还没建起来。

普通人现在能做什么

在监管框架成熟之前,有一些事情是个体可以做的,但我不打算把这段写成「保护自己的五个技巧」那种格式。因为真正的问题是结构性的,把责任压回到个体身上,本身就是这个系统正在做的事。

●真正需要发生的改变是:高风险场景下的AI建议应该被纳入专业服务监管,「仅供参考」不应该成为全能免责牌,用户应该有清晰可用的申诉渠道。这不是反对AI,而是要求AI服务承担和它所获取的信任对等的责任。

有意思的是,这件事对AI行业自身也是有利的。一个「出了事没人管」的行业,长期来看会失去公众信任。责任越明,信任越稳。那些愿意主动建立责任机制的平台,反而会在下一轮竞争里占据更好的位置。不是因为它们更道德,而是因为它们更聪明。

✦ 小结

AI建议出错之后的责任真空,不是技术问题,是制度设计问题。开发商、平台、用户三方都有自己的推卸逻辑,但受害的普通人没有可用的追责渠道。「仅供参考」正在以一种不对称的方式运作:平台拿走了专业服务的商业价值,用户承担了非专业服务的全部风险。解决这个问题不需要反对AI,只需要要求它和任何其他影响重大决策的服务一样:出了事,有人接着。

夜雨聆风

夜雨聆风