AI一本正经胡说八道的毛病,从哪儿来的

它不是在说谎,它根本不知道自己在说什么。这句话听起来像在替AI开脱,但如果你真的搞懂它的工作原理,你会发现这不是辩护,而是一个更让人不安的事实。

有个律师朋友被AI坑过一次。他让ChatGPT帮他找几个类似案例,AI给了他六个,判例号、法官名字、审理时间全都有,格式规整,语气专业,看起来完全没有问题。他把这些引进庭审材料里,对方律师查了半天找不到原件,告到庭上,这才发现六个案例全是编的。法院罚了这位律师五千美元。这件事二零二三年在纽约真实发生过,不是段子。

这件事之所以值得反复讲,不是因为它离奇,而是因为它太典型。AI给出的答案有名有姓有时间,结构上无懈可击,你很难在阅读的时候产生怀疑。这正是幻觉问题最危险的地方——它不像一个明显的错误,它像一个精心排版的谎言,但说谎的那个人自己也不知道自己在说谎。

幻觉不是bug,是它的工作方式本身

要理解幻觉从哪儿来,你得先知道大模型在写一句话的时候到底在做什么。它做的不是查询,不是检索,而是预测。具体来说,它在根据已经写出来的内容,猜下一个词最有可能是什么。这个过程是纯粹基于概率的,没有任何事实校验机制嵌在里面。

当你让它写「二零二三年判决的类似案例」,它会按照「一个真实案例应该长什么样」的模式去拼。它见过大量真实案例的写法,所以它拼出来的东西结构上完全像真案例,有案号,有法官,有判决结果。但内容可能是凭空生成的,因为它从来就不是在记忆事实,它记住的只是事实应该怎么被表达。这两件事差得很远,但输出结果看起来一模一样。

「

模型不知道自己不知道——这才是真正的问题所在。

」

人如果不确定一件事,通常会有点迟疑,语气会软化,会说「好像是」「我记得」「你再查一下」。但大模型没有这种自我怀疑的机制,它的输出是流畅的,语气是肯定的,因为流畅和肯定本身就是它被训练出来的目标之一。你问它一个它根本没有足够数据支撑的问题,它也会用同样平稳的语气给你一个答案。

越精确的问题,越容易幻觉

这里有个反直觉的规律,很多人没注意到。你问AI越细节、越精确的问题,它越容易胡编。原因在于,越精确的答案,在它的训练数据里覆盖得越稀疏。问「爱因斯坦相对论说了什么」它答得不错,因为这个话题网上写烂了,数据密度极高,模型有充分的材料可以综合。但你要问「爱因斯坦一九二七年在普林斯顿具体做过哪几次公开演讲,每次的主题是什么」,它多半会编,因为这个数据密度太低,它只能靠模式补全,用「一个演讲应该长什么样」去填充一个它其实并不掌握的具体事实。

这个规律意味着,越是你需要精确答案的场景,AI越不可靠。法律引文、医学数据、历史细节、学术引用,这些偏偏是你最需要准确的地方,也偏偏是幻觉重灾区。而日常闲聊、写作润色、头脑风暴这些对精确度要求低的场景,它反而表现稳定。

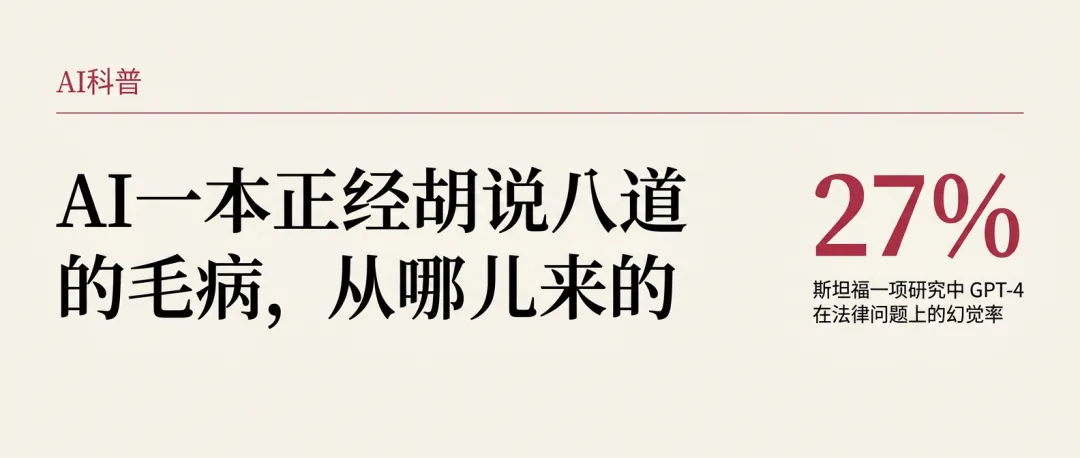

27%

斯坦福一项研究中GPT-4在法律问题上的幻觉率,接近三分之一的回答存在事实性错误

幻觉的结构性原因无法被简单修掉

有人会问,这个问题能不能修?技术上能不能打个补丁?答案是:幻觉和生成机制本身绑在一起,不是一个可以独立修复的模块。大模型之所以能写出流畅自然的文字,恰恰是因为它在做概率预测,而概率预测天然允许它在数据稀疏的地方进行补全。你把这个能力去掉,它就不再是一个语言模型了。这就像问一个擅长即兴演讲的人,能不能保证他说的每一句话都有文献来源——做不到,因为即兴和严格引用是两种不同的工作模式。

所以研究者现在的主要方向不是「消灭幻觉」,而是「控制幻觉」。比如给模型接上外部知识库,让它在回答之前先检索,而不是直接生成。这个方案叫RAG,检索增强生成。它不能让模型变得完美,但可以把它的答案锚定在真实文档上,减少凭空捏造的空间。

你能做什么

1涉及具体事实的问题,优先让AI联网搜索或接上外部知识库,不要让它裸答

这些方法不能让AI变成一个不会出错的工具,但可以让你和它之间建立一个更健康的协作关系。你不是在用一个数据库,你是在跟一个擅长写作但记性很差的助手合作。它写得很好,但你得负责核实。把核实的责任交给它自己,这是最常见的误用方式。

✦ 小结

AI不是在骗你,它只是在完成一个文字接龙游戏。接龙接得太像真的,以至于你会忘记那只是接龙。理解这一点之后,你对它的信任方式应该变一变——不是不信任,而是分场景信任,分类型核查。它在某些事情上比你强很多,在某些事情上需要你盯着它。

夜雨聆风

夜雨聆风