“AI与研究方法变革”系列研讨(一)回顾:AI辅助论文写作与行为边界

4月15日下午,求是书院“AI与研究方法变革”系列研讨活动第一讲在立德楼书院第六空间成功举办。本次活动由求是书院主办,旨在帮助管理学部本科生在人工智能深度融入学术研究的时代背景下,构建系统的学习路径,打造稳定、可持续的学术交流平台。活动面向全体学生开放,以助教团队分享为主体,结合交流与讨论。

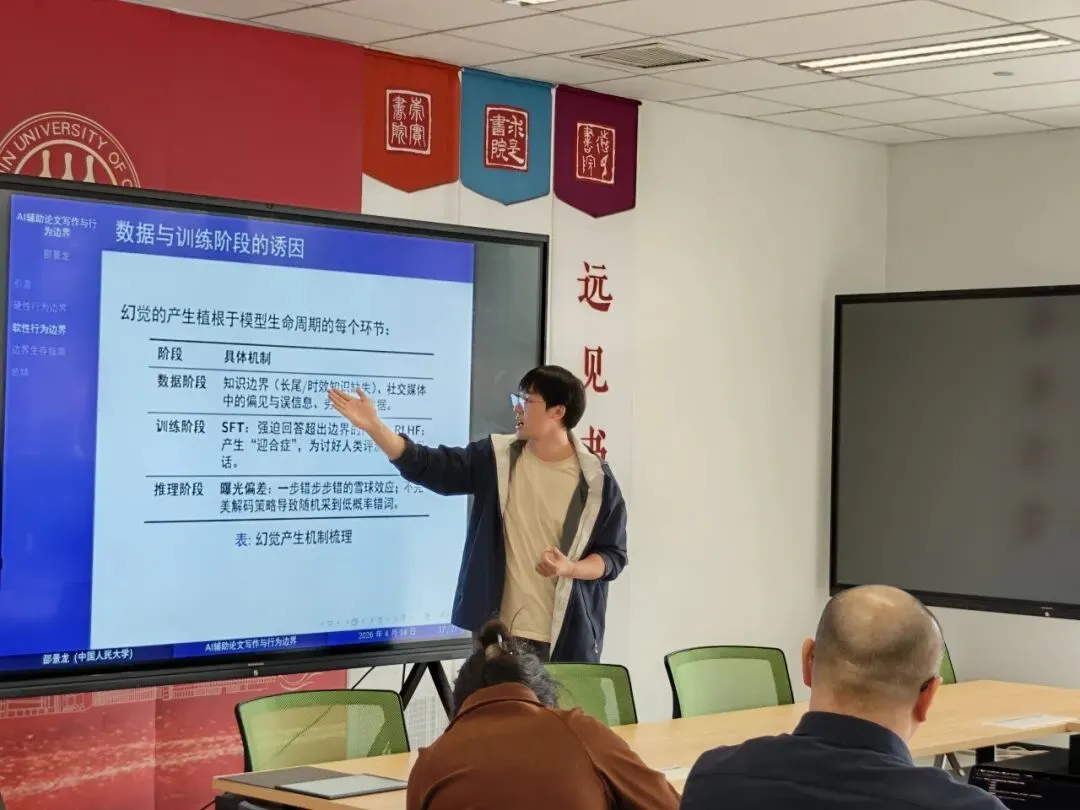

本次讲座特邀统计学院2025级应用统计专业硕士研究生邵景龙作为主讲嘉宾,围绕“AI辅助论文写作与行为边界”这一主题展开分享。讲座吸引了众多对AI辅助学术研究感兴趣的同学参与,现场气氛热烈。

讲座伊始,邵景龙从生成式AI在文本、图像、视频等领域的广泛应用切入,指出利用先进生产力工具辅助学习与研究已是普遍现象。然而,他随即强调,学术论文作为一种具有高度公共性、外部性和可验证性的特殊产品,其规范性、真实性与可追溯性是必须坚守的底线。因此,界定AI辅助写作的合理范畴与行为边界,是每一位科研从业者必须直面的课题。

界定“人机协同”的边界:

工具性使用与替代性依赖

邵景龙首先对AI在论文写作中的合理辅助范畴进行了系统梳理。通过与AI的对话,他引出了“人机协同”的核心观点:AI应定位于支持特定环节的工作,如选题阶段的思路发散、文献的快速梳理、初稿框架的生成以及语言的润色优化等。他通过具体的实操案例,生动展示了如何通过精细化提示词,引导AI高效完成特定检索与初步分析任务,如“请基于2024-2026年学术文献,分析数字化转型对中小企业绩效影响的研究热点与空白”。

与此同时,邵景龙明确AI应用的硬性边界。他结合中国人民大学关于本科毕业论文中使用生成式AI的规范、人民大学学报的投稿要求以及《Nature》期刊的AI政策,指出整篇或核心章节的AI生成、伪造数据与访谈记录、直接采信AI未经验证的结论以及不加查证地使用AI虚构的参考文献等行为,均构成严重的学术不端。他通过分享AI生成错误医学插图致论文撤稿、ICML会议利用隐形水印查出数百名专家使用AI审稿等真实案例,深刻警示了逾越边界可能带来的严重后果。

剖析“幻觉”之源:

理解AI,方能驾驭AI

“为什么AI会犯错?为什么它会给出看似合理但实则错误的答案?”为回答这一核心问题,邵景龙从生成式大模型的底层原理出发,深入浅出地解释了AI产生幻觉的机制。他指出,大模型本质上是基于概率的“自回归语言建模”,通过预测下一个词的最大概率来生成内容,而非进行严谨的逻辑推理。他以“冰淇淋销量增长导致溺水率上升”为例,生动揭示了AI在因果推断上的局限性。

邵景龙进一步提出将AI幻觉细分为事实性幻觉与忠实性幻觉,并从数据训练、监督微调、推理生成等多个环节剖析了幻觉产生的根源。他强调,AI的“过自信”机制、逆向诅咒以及模型本身的数学限制,都可能导致其在特定情境下输出错误或编造的信息,研究者必须对AI的产出保持审慎的批判态度。

走向理性应用:

四大原则与实务探讨

面对AI的潜在风险,邵景龙提出了在使用中规避幻觉、提升效能的四大实操原则:第一,压缩问题空间,通过高度具体化、条件化的提示词限制AI的发挥范围;第二,量化不确定性,要求AI标注推测结论的置信度及其依据;第三,强制结构化,要求AI按指定格式、维度输出内容;第四,进行外部交叉验证,使用多个模型互审或结合专业数据库进行结果比对。

在随后的互动环节,师生们围绕AI工具的选用、如何规避AIGC查重风险、创新点在交互中是否会被泄露等实际问题展开了热烈讨论。

参会的同学分享了使用豆包、Kimi、ChatGPT、Claude、Google AI Studio、AMiner等多种工具的体验与心得。针对同学们普遍关心的边界问题,现场形成了基本共识:在AI时代,研究者的角色正从单纯的内容生产者转变为价值的裁判者、问题的发现者和方向的引导者。只要核心思路源于自身,数据真实可靠,并对AI生成内容完成了严格的查证与转化,AI便可作为提升研究效率的有力工具,关键在于研究者要承担起最终的责任,确保学术产出的原创性、真实性与可靠性。

本次讲座不仅是一场关于AI工具使用的技术分享,更是一次关于学术规范与科研责任的深刻反思。在技术浪潮奔涌向前的时代,既不应盲目排斥先进生产力,也不能在技术的迷宫中迷失学术的本真。本次研讨帮助同学们建立了一种更为清醒的认知:在深刻理解其能力与局限的前提下,理性、规范、负责任地将AI纳入学术生产过程之中。

图片 | 肖世勋

文字/排版 | 陈颖欣

审核 | 胡宏伟 贾志英 刘思佳

夜雨聆风

夜雨聆风