你的 AI 助手每次都把你忘光了——YourMemory 给它装上了会遗忘的记忆

我们大概都有过这种时刻:打开一个新的 Claude 对话框,对话框很干净,干净得像一张从未被写过的纸,而你不得不再一次解释自己的技术栈、工作习惯、上次卡住的那个坑。你说”上次我们聊过”,它说”抱歉,我没有您以前对话的记录”。于是你只好重头来过,把之前跟它磨合出来的那点默契全部抛弃,重新喂一遍。

这件事说来好笑,却是当下几乎所有 AI 助手共享的结构性缺陷——每次会话都是一个孤岛,岛与岛之间没有桥,有的只是用户自己不断重复的解释。

YourMemory 是一个给 AI 代理装记忆的工具,它把记忆持久化这件事交给一套从人类记忆科学里借来的机制去管。背后的理论支撑是艾宾浩斯遗忘曲线——19 世纪德国心理学家赫尔曼·艾宾浩斯在对自己做了数年重复记忆实验之后得出的结论:遗忘不是均匀的,它按指数规律衰减,越近期提取过的记忆,衰减越慢。

YourMemory 把这条曲线搬进了软件里。每一条记忆都有一个强度值,按公式计算:strength = importance × e^(-λ×days) × (1 + recall_count×0.2)。重要的记忆衰减慢,常被调用的记忆衰减慢;强度降到 0.05 以下的,每隔 24 小时自动清除。AI 的记忆固然可以无限堆叠,但堆叠的结果往往是检索时每条都被平等对待,有用的和没用的一起被捞出来。YourMemory 想要的是另一种状态:有轻重缓急,而不是一个不加区分地堆放万物的仓库。

记忆的分类也按照重要性设了衰减梯度。策略性的成功经验,不被调用也能撑约 38 天;具体的事实和偏好,能撑 24 天左右;基于推断得出的上下文,19 天;而错误和环境特定的问题记录,只有 11 天的半衰期,会更快让位给新的经验。这个设计背后有一个朴素的判断:昨天踩过的坑比三年前的成功经验更值得被记住,只要这个判断成立,记忆的权重分配就有了合理的依据。

检索同样不是靠一次搜索完成的。第一轮是向量搜索,对所有记忆做余弦相似度打分,取得分最高的若干条;第二轮是图谱扩展,从第一轮结果出发做广度优先遍历,把那些词汇上没有交集、但在语义上相邻的记忆也顺着边找出来。人在提问时用的词和记忆被存入时用的词往往不一样,只靠词汇匹配会漏掉一大半相关内容——图谱这一轮专门补这个漏。在 Snap Research 发布的 LoCoMo 基准测试集上,1534 个跨会话问答对,YourMemory 的 Recall@5 达到 59%,而 Zep Cloud 是 28%。

多个 AI 代理可以共享同一个 YourMemory 实例,每个代理有自己的私有记忆空间,访问权限通过代理身份文件控制。这意味着一套工作流中的不同代理可以在隔离的状态下各自积累经验,也可以在授权后共享某些公共上下文,而不至于相互污染。

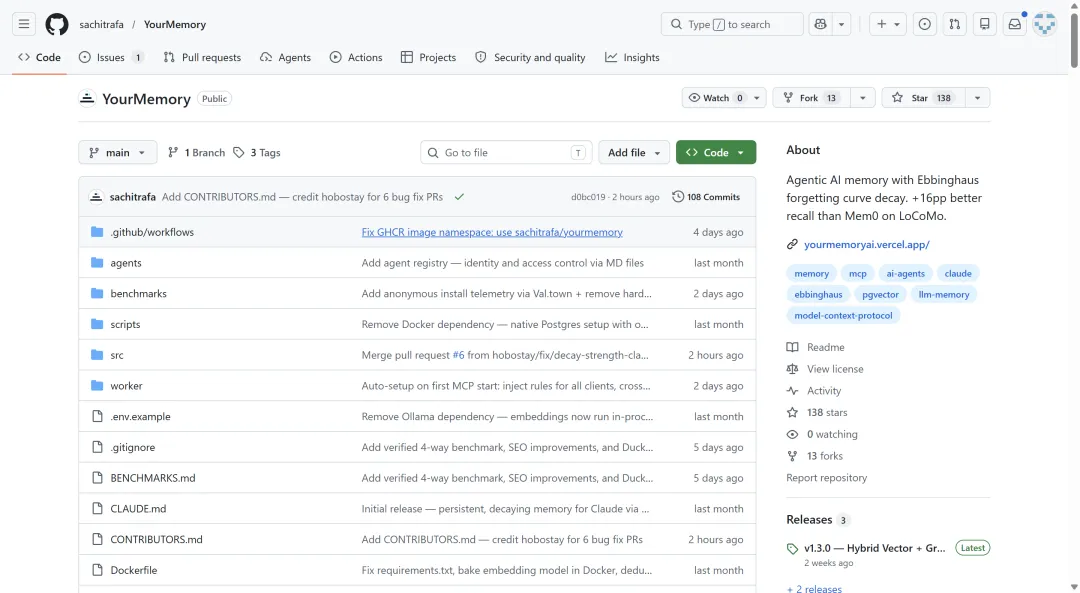

YourMemory 目前以 MCP 服务器的形式接入,支持 Claude Code、Claude Desktop、Cursor、Cline 等主流客户端,凡是兼容 MCP 协议的工具原则上都可以接入。向量数据库默认用 DuckDB,图谱用 NetworkX,嵌入模型在本地运行,不依赖外部服务,没有数据库需要另行部署。

我总觉得,给 AI 装记忆这件事被低估了。多数人谈论 AI 助手的能力,谈的是它能不能写代码、能不能看图、回答得准不准——这些固然重要,但”它记不记得你”这件事同样构成一个人工具体验的根本。一个每次都要从零开始的工具,和一个积累了你几个月使用习惯的工具,用起来是两种完全不同的感受。前者是查询机,后者才算得上助手。

YourMemory 把遗忘曲线这个在记忆研究里早已成熟的工具,移植进了 AI 代理的记忆层,让记忆按照重要性和频次自然地此消彼长,衰减的归于沉默,被反复调用的留下来。想法本身并不新奇,新奇的是它被做出来了,而且在基准测试上跑出了不错的数字。

https://github.com/sachitrafa/YourMemory

夜雨聆风

夜雨聆风