OpenClaw 3.2 重磅发布:那个能自己进 Google Meet 开会、还能边听边做的 Agent 来了!

在职场里,比“写代码”和“写报告”更消耗生命的,是那些长达两小时、且与你只有 5% 相关性的拉齐会。

在过去,我们用各种飞书/钉钉的“智能纪要”工具来缓解这种痛苦。但这只是“被动记录”,如果老板在会上说:“那个谁,把昨天那份数据拉出来看一下”,你依然得手忙脚乱地切屏找文件。

但在过去的 48 小时里,开源社区被 OpenClaw 3.2 的正式发布彻底点燃。这个最初只在终端里跑的本地 Agent 框架,完成了一次史诗级的越狱:它长出了耳朵,并且正式走进了会议室。

今天,我们就来硬核拆解 OpenClaw 3.2 带来的三大跨越式特性。

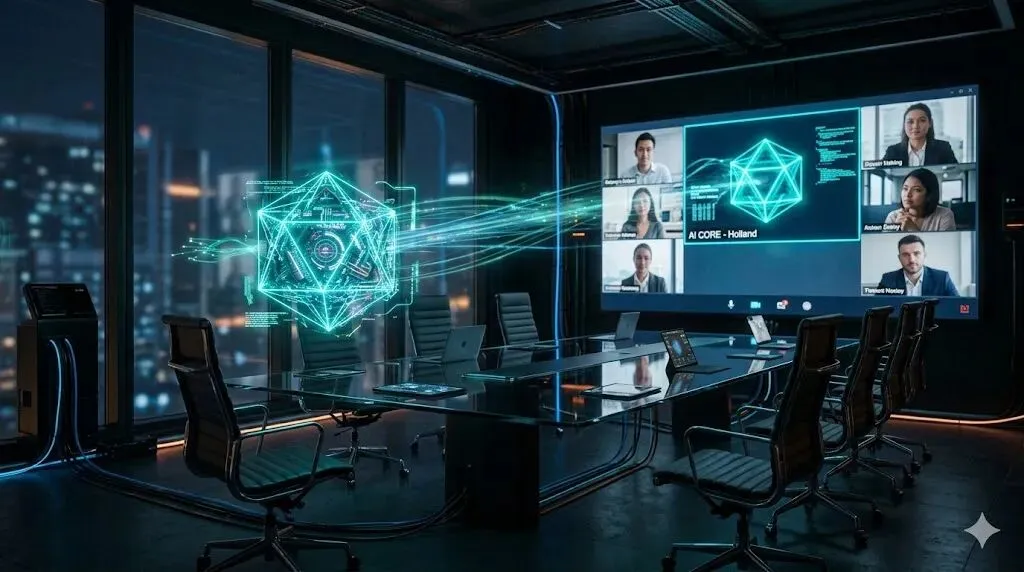

一、 原生 Google Meet 插件:从“记录者”到“参与者”

在 3.2 版本中,最抓人眼球的莫过于官方内置的 bundled participant plugin。

你只需要在控制台输入一段极简的指令:/join_meet [会议链接] --role assistant。你的 OpenClaw 实例就会以一个虚拟参与者的身份,堂而皇之地出现在 Google Meet 的九宫格里。

这和市面上的录音机器人有本质区别:它不是在录音,它是在“开会”。

-

权限下放: 它能直接读取会议的实时字幕流,结合底层的 RAG(检索增强生成)知识库,理解当前的讨论上下文。

-

主动出击: 如果会上有人提到“帮我查一下 Q1 的营收”,它会自动在后台调用你的内部数据库 API,并在 3 秒后将总结好的报表直接发送到会议的文字聊天框里。

你的 Agent 不再是一个需要你单独去“喂指令”的工具,它变成了你的数字分身,替你在无聊的会议里保持全勤。

二、 实时语音循环(Realtime Voice Loops):真正的“边听边做”

以前的 Agent 交互,叫做“回合制游戏(Turn-based)”。 你打一段字,它思考,它调用工具,然后它回复。这个过程往往伴随着几十秒的等待。

而 OpenClaw 3.2 引入了彻底的异步流式架构,支持接入类似 OpenAI Realtime 这样的多模态底层模型,实现了惊人的 “边听边做”(Listen-while-executing)。

在架构层面,它将“监听线程”与“工具执行线程”完全解耦:

-

当产品经理在会上滔滔不绝地讲述需求时,Agent 的语音流模块在实时解析意图。

-

还没等产品经理说完,Agent 已经在后台默默打开了 Jira,开始填表。

-

最恐怖的是“可打断性”:如果产品经理突然改口“哦不对,把优先级调低”,Agent 能瞬间中断上一个动作,修改参数,重新执行。

这就像是一个拥有绝对专注力和肌肉记忆的人类助理,消灭了所有多余的 I/O 延迟。

三、 坐标级点击(Viewport Coordinate Clicks):浏览器的“像素级”接管

在过去,让 Agent 帮你上网查资料或者填表,依赖的是解析网页的 DOM 树(也就是 HTML 源码)。但只要遇到用 Canvas 画的图表、Flash 残留、或者远程桌面(VNC),Agent 就会瞬间变成瞎子。

为了解决这个痛点,OpenClaw 3.2 将视觉模型(Vision Models)的权重拉到了最高。

它引入了 Viewport Coordinate Clicks 功能。简单来说:它不再读代码了,它直接“看”屏幕。

当你让它“点击那个红色的结账按钮”时,底层视觉模型会截取当前浏览器视口,进行像素级分析,直接返回按钮所在的 (X, Y) 绝对坐标,然后驱动无头浏览器(Headless Browser)进行物理点击。

这意味着,只要是你肉眼能看懂的系统、哪怕是二十年前用 VB 写的、没有任何 API 接口的老旧内网 ERP,OpenClaw 都能像一个真正的人类操作员一样,去点击、拖拽、完成自动化。

四、 结语:被重塑的“在场权”

OpenClaw 3.2 的发布,不仅是一次技术狂欢,更是一次对职场形态的降维打击。

当一个没有肉体的代码实体,能够比你更专注地听完一场会议、比你更精准地拉出报表、甚至比你更快地操作那个难用的内部系统时,我们需要重新思考一个问题:

在未来的职场里,人类的“在场(Presence)”,究竟还剩下多少不可替代的价值?

或许,未来的优秀员工,不再是那个天天泡在会议室里的人;而是那个躲在屏幕背后,冷静地指挥着五六个 OpenClaw 实例,在各个平行会议中同时推进业务的“超级包工头”。

夜雨聆风

夜雨聆风