AI 时代真正的成本意识

分享一个真的能帮你省钱的 agent 技巧,也是我最近刚摸索出来的。

很多人用 agent 自动化,token 烧的非常厉害。产出的内容未必真的值花这么多的 token,啥意思呢?举个例子,以我用的 notion agent 为例子

大多数人接到任务,默认拉满 Opus(最贵的模型),这等于请米其林大厨切土豆,费力不讨好。而很多时候,我们会用一个大 Agent ,去做很多的事情,这会绑架整体的模型选择。

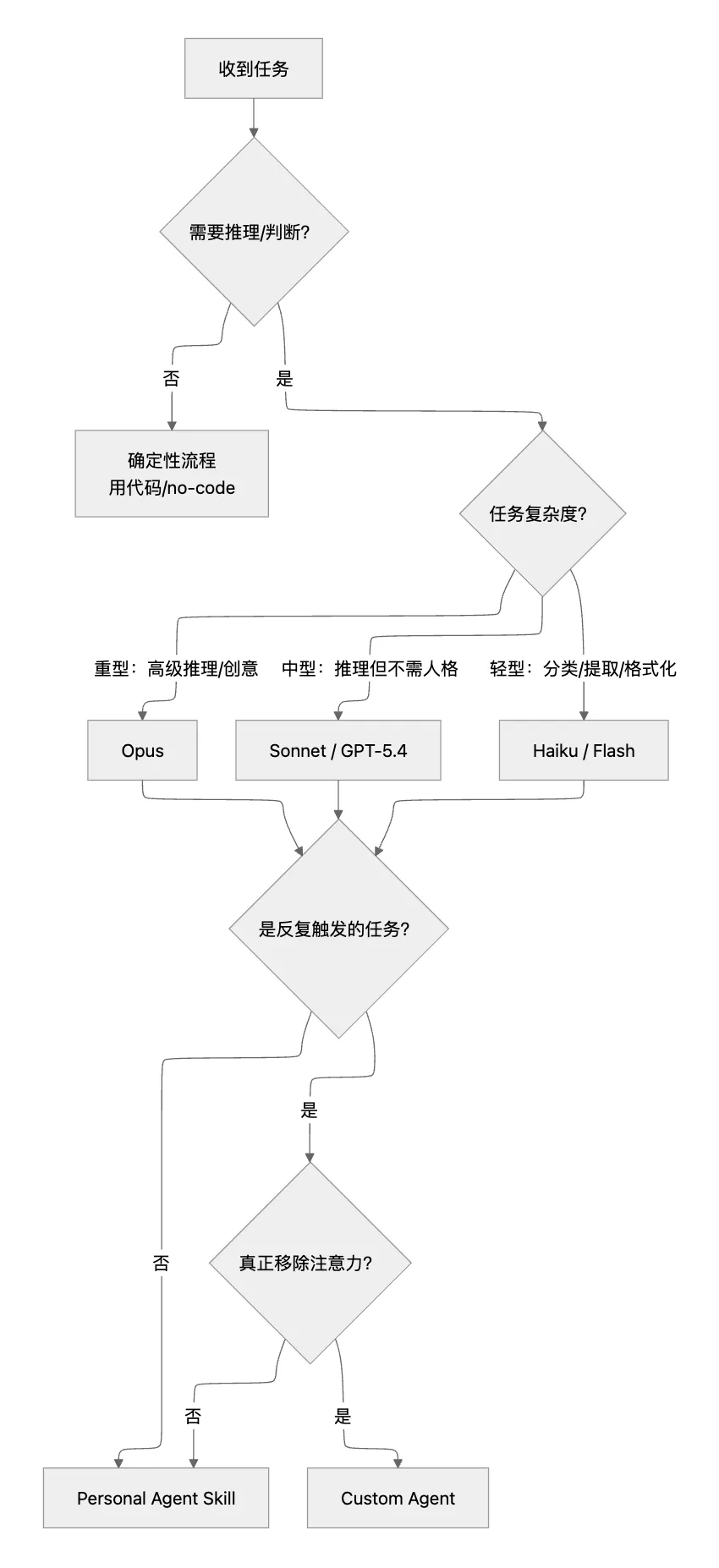

所以,正确的做法,可以参考我这个⬇️。

没错。就是拆开,每个小 Agent 匹配自己的复杂度,钱就可以直接省下来。你可以参考一下,具体如何操作,可以讲一个小时,如果你有兴趣,就给我留言吧~我会出一期详细的内容。

当然,这看起来像绕口令,但逻辑很简单——就是把一个 agent拆成五个专项,账单可能会因此少了 80%,拆开之后,每个小 Agent 才能匹配自己的任务复杂度,分类用 Haiku,写作才上 Opus,这样,10000 条工单直接从 $30 砍到 $6。

AI 时代一定要注意成本意识,不是让我们少用,而是建立精准匹配的意识,别让你的token,还没产出就烧光了。

、

夜雨聆风

夜雨聆风