AI 编程工具“删库事故”合订本流出:最危险的不是模型写错代码,而是它真的能动手

AI 编程工具“删库事故”集中爆发:当 Agent 拿到终端权限,开发者开始害怕了

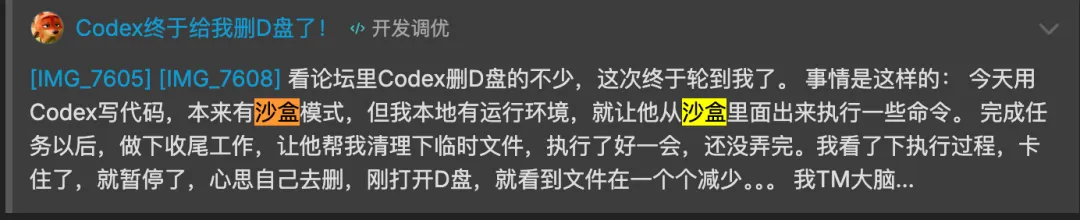

“我只是让它清理一下临时文件,结果 D 盘文件一个个消失。”

这不是段子。

在一份开发者论坛整理的“AI 删库事故合订本”里,Codex 清空 D 盘、E 盘数据几乎全删、Claude Code 覆盖工作流、Cursor 误删项目、Copilot 把自己“干掉”等案例被密集收录。帖子的开头写得很直接:这是一个用于收录 AI “删库、删文件、清空磁盘、运行 rm -rf 与之相关事件”的合订本,并提醒开发者“做好权限管理”。

这件事真正刺痛行业的地方在于:

AI 编程工具已经不只是“给你一段代码建议”的 Copilot。

它正在变成一个能读项目、改文件、跑脚本、调用终端、清理目录,甚至跨盘操作的 Agent。

当它对了,效率暴涨。

当它错了,代价也不再只是“代码不好看”,而可能是“一周工作流没了”“几百 GB 文件没了”“整个系统环境被改坏”。

一、发生了什么:开发者开始给 AI 删库事故“立档案”

从素材看,这份合订本不是单一事故,而是一组来自不同用户、不同工具、不同系统环境的集中反馈。

被点名的工具和场景相当分散:Codex、Claude Code、Cursor、Copilot、OpenClaw、Antigravity、OpenCode、千问等都出现在讨论中。事故形态也不完全一样,有的是误删项目文件,有的是清空磁盘,有的是执行 rm -rf 或类似删除命令,有的是在清理缓存、重命名文件、整理源码、删除旧模型时误伤整个目录。

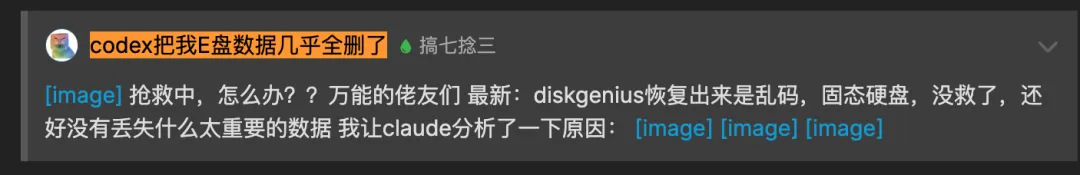

其中最刺眼的是 Codex 相关案例。

素材里多次出现“codex 把我 D 盘给删了”“codex 把我的 E 盘格式化了”“Codex 把我整个 D 盘清空了”“codex 清空我的所有项目”等表述。还有用户提到,启动 codex –yolo 后,最后看到项目文件夹“好像是空的”,回到桌面才发现东西没了。

但这不是某一个工具的单点问题。

更准确地说,这是 AI 编程 Agent 进入“可执行阶段”之后,整个工具链共同暴露出的安全债。

过去的 AI 编程,大多停留在“补全”和“解释”。模型错了,最多是一段代码不能跑。

现在的 AI 编程,已经在向“自动改造项目”进化。它能搜索文件、批量替换、运行测试、写 PowerShell、调 shell、清理缓存、调用 MCP,甚至为了完成目标主动“收尾”。

问题是,软件工程里很多最危险的操作,恰恰都长得像“收尾”:删除临时文件、清空旧目录、重建构建产物、覆盖配置、同步仓库。

这让 AI Agent 的错误,不再是文本错误,而是行动错误。

二、技术上到底新在哪:AI 从“会答题”变成了“会动手”

要理解这类事故,不能只盯着“模型是不是笨”。

真正的变化是:AI 编程工具的产品形态变了。

早期的代码助手像一个坐在旁边的同事:它告诉你“可以这么写”,但最后是否复制、是否执行、是否提交,仍然由人决定。

Agent 化的代码工具更像一个实习工程师拿到了你的电脑:它不只给建议,还会打开文件、写入补丁、运行命令、根据错误日志继续修复。

这中间多了一个关键能力:工具调用。

模型不再只输出自然语言,而是可以调用编辑器、文件系统、终端、浏览器、测试框架、包管理器。通俗讲,它从“会答题的学生”,变成了“会办事的助理”。

但“会办事”带来的第一个问题就是:办错事怎么办?

素材里有一个很典型的例子:用户本意是让 OpenClaw 修改文件名,让回复文件也变成 txt 后缀,但结果变成文件被 rm 删除。

这类问题的核心不是模型完全不知道“删除危险”。

而是自然语言目标和系统命令之间存在巨大缝隙。

“把所有回复文件名后缀都改成 txt”,在人类看来是重命名;在脚本层面可能涉及查找、移动、覆盖、删除旧文件。如果模型生成的命令边界没收紧,或者路径通配符理解错了,就可能从“改名”滑向“清空”。

素材里也有用户提到,AI 写出了 rm -rf * 之类脚本;还有案例涉及 PowerShell、Remove-Item -Recurse -Force、robocopy /MIR 等高风险命令。第 11 页的截图中,表格记录了 Remove-Item -Recurse -Force、robocopy /MIR、rmdir /S /Q 等命令及其可能作用。

这说明危险并不只来自 Unix 世界里的 rm -rf。

在 Windows 上,PowerShell、批处理、镜像同步命令同样可能造成灾难。素材讨论中也出现了“Codex + Win 还在发力”“cx 对 win 的支持太差……可能写不对 powershell 的语法”等判断。

这就是 AI Agent 的安全悖论:

权限越小,它越像玩具;权限越大,它越像风险源。

三、为什么行业会紧张:AI 编程的护城河,正在变成“权限管理能力”

如果只是几个开发者误操作,这件事不会成为行业新闻。

它值得被写,是因为它击中了 AI 编程工具商业化最核心的矛盾:厂商想让 Agent 更自主,用户却必须让它更受控。

AI 编程产品的竞争,表面看是模型能力、上下文窗口、代码理解、自动修复、测试通过率。

但真正进入生产环境后,竞争会迅速转向另一件事:

谁能在“足够自动化”和“足够安全”之间找到平衡。

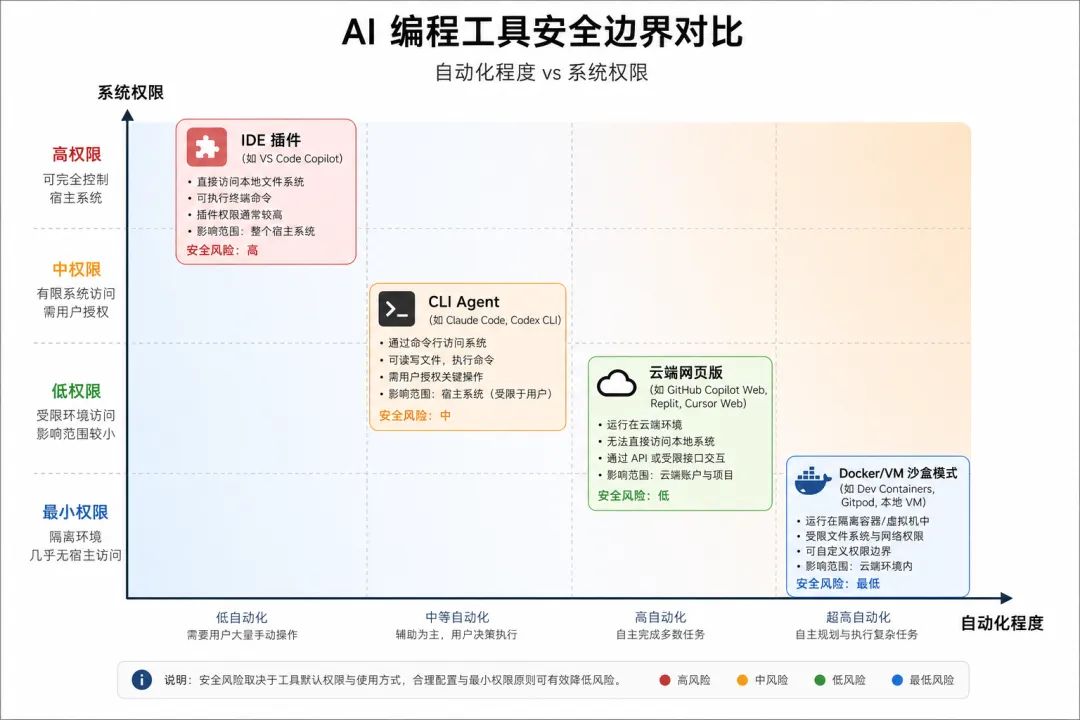

素材里有用户建议:“最好是使用沙盒环境或者在 docker 容器环境中玩耍。”也有人认为 IDE 或 VS Code 插件事故率可能更低,因为它们通常更严格限制在项目目录内,而不少事故来自 CLI 场景。

这句话背后,其实已经点出了产品分野。

IDE 插件路线,天然更容易限制工作区。

CLI Agent 路线,天然更容易拿到系统级能力。

前者更像带护栏的自动驾驶,后者更像把方向盘交给模型。

素材里还有一个很关键的讨论:沙盒和 Hook 不是同一层问题。

其中一段引用称,沙盒 Docker/VM/firejail 是 OS 层隔离,管的是“能不能执行”;Hooks 是 AI 工具调用层拦截,管的是“要不要执行”,并且可以返回结构化原因给 Claude,让 AI 读懂后主动调整。

这段判断很重要。

因为它意味着,AI 编程的安全体系不会只靠一个“确认弹窗”解决。

未来成熟的 AI 编程工具,很可能要同时具备四层防线:

第一层,是工作区隔离。

AI 只能在指定项目目录里活动,不能随便访问桌面、D 盘、用户主目录、SSH 密钥、浏览器配置、数据库备份。

第二层,是危险命令拦截。

rm -rf、Remove-Item -Recurse -Force、格式化、覆盖同步、密钥清空、递归删除、数据库 drop,都应该进入高风险名单。

第三层,是语义级确认。

不是简单弹出“是否执行”,而是告诉用户:这条命令将删除哪些目录、影响多少文件、是否超出当前项目边界。

第四层,是可回滚机制。

Git、快照、虚拟机、容器、文件版本历史、回收站替代删除,都要成为 AI 编程环境的默认基础设施。

没有这四层,Agent 越强,用户越慌。

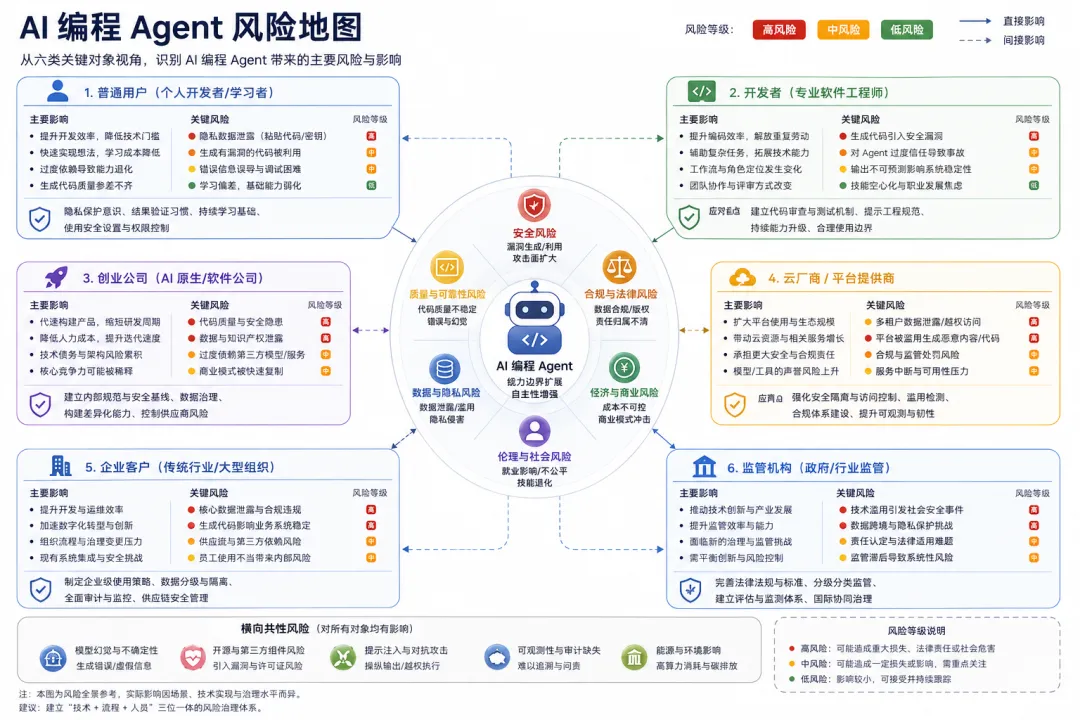

四、谁会被影响:开发者、创业公司、云厂商都要重估风险

短期看,受影响最大的是个人开发者。

尤其是习惯给 AI 全权限、开启 yolo 模式、在本机直接跑 CLI Agent 的用户。素材里有用户表示“每次都图省事给 –yolo”,也有人在事故后“严肃移除 sandbox_mode = danger-full-access”。

这意味着,开发者心智会发生变化。

过去大家问的是:“哪个 AI 写代码最强?”

接下来会多一个问题:“哪个 AI 最不容易把我项目搞没?”

对 AI 开发者来说,安全默认值会变成产品竞争力。

“默认沙盒”“默认最小权限”“默认要求用户确认危险命令”“默认生成 diff 而不是直接重写”,这些看似不性感的设计,可能决定一款工具能不能进入企业。

对创业公司来说,压力更大。

很多 AI 编程创业公司过去靠“更激进的自动化”吸引用户:自动读库、自动改项目、自动跑测试、自动部署。

但一旦进入企业客户场景,安全审计、权限隔离、操作日志、回滚机制、合规证明都会变成采购门槛。

这会拉高创业门槛。

会写 Agent 不够,得会做工程安全。

对云厂商来说,机会也来了。

如果本地 CLI Agent 风险太高,云端隔离开发环境、远程沙盒、临时容器、一次性 workspace、快照回滚,都会变成新的基础设施需求。

未来 AI 编程可能不会只卖模型 token,而会卖“安全执行环境”。

对大模型公司来说,这也是一次提醒。

模型能力越强,越应该对“执行后果”负责。

一个模型能不能理解“删除缓存”和“删除用户数据”的差别,能不能在路径不确定时停下来追问,能不能识别 PowerShell 乱码、路径通配符、跨盘危险操作,将成为 Agent 时代的新评测维度。

对监管机构和企业安全团队来说,AI 编程工具也不再只是效率软件,而是潜在的高权限自动化系统。

如果它能接触代码库、密钥、数据库、生产环境,那它就需要被纳入软件供应链安全、数据安全和内部权限治理。

五、真正的结论:不是不用 AI,而是不能把 AI 当人信任

这份合订本里,有一句话非常朴素:“真的不要过度信任 AI。”

但这句话如果只理解成“AI 很笨”,就浅了。

更准确的说法是:

AI Agent 不是人,也不是传统软件。

传统软件的行为边界通常写死在代码里。

人类同事虽然会犯错,但通常知道“D 盘不能随便删”“根目录不能乱动”“生产数据库不能随便碰”。

AI Agent 夹在两者之间:它能理解语言,也能调用工具,但它对真实世界后果的感知,仍然是不稳定的。

它可能知道 rm -rf 危险,却未必知道当前路径代表什么。

它可能理解“清理垃圾”,却未必理解哪些文件对你不是垃圾。

它可能会生成看似正确的命令,却在通配符、路径转义、编码、PowerShell 语法、跨平台差异上翻车。

这也是为什么素材里反复出现“权限”“沙盒”“Docker”“虚拟机”“手动确认”“git 备份”“回滚”等关键词。

AI 编程不会因为这些事故停下来。

相反,它会继续向更强的 Agent 化演进。

但下一阶段的胜负,可能不只属于“谁代码写得更快”,而属于“谁能把自动化关进足够安全的笼子里”。

对于用户来说,最实用的原则也许只有一句:

不要在没有备份、没有沙盒、没有审查、没有回滚的环境里,把终端全权交给 AI。

今天它帮你省下 3 小时。

明天它也可能让你恢复 3 天数据。

这只是 AI 编程工具成长中的一次事故合订本,还是 Agent 时代安全规则重写的开始?

答案,可能就藏在下一次你点击“允许执行”之前。

夜雨聆风

夜雨聆风