Tool calling 联邦化了 AI 能做什么。下一层,是联邦化 AI 对你的理解。

Agentic AI 这场竞赛,从足够远的距离看,开始像是整个行业在一个抽象层上下了同一注。

每个月都有新协议把模型伸得更远。MCP。Function calling。Agent skills。Computer use。Browser use。工具目录以千计。每场发布的口径都一致:我们给模型多一双手。隐含承诺是,能力是瓶颈,等到接好足够多的能力,agent 就不再是技巧,会成为基础设施。

这一注押错了。不是完全错,那太容易了。错在哪一层值得一个协议。

Tool calling 联邦化了 AI能做什么。它没联邦化 AI关于你知道什么。这两件事之间的不对称,是接下来十年 AI 必须面对的核心架构事实。

一 · Tool Calling 真正解决了什么

看一下 tool calling 实际解决的事情。

一个对你没有持续记忆的模型,坐在一个与上周对话窗口毫无关系的会话窗口里,被授予了搜索数据库、写文件、发消息、操作浏览器、运行部署的能力。它胜任地完成了任务。然后会话结束。下次会话从架构层面的零开始。

Tool calling 用极大的工程努力和真正的优雅,把一个无状态系统弄得看起来短暂地有用了。这是给一个失忆症患者每天早上一份新的工作描述。患者很聪明。工作描述越来越精致。患者还是不记得你是谁。

这是今天每个主流 agent 框架底下的未明言设计假设:模型是被赋能的对象。用户是瞬时输入。你只在一次请求的持续时间内存在,会话边界一到就消失,最多留下一份下次会话可能加载也可能不加载的薄薄摘要。你积累的语境,那些决定、修正、审美偏好、被否决的路径、凌晨两点的洞察,构成你工作纹理的一切。没有协议归属地。它无法被寻址。无法被迁移。无法被携带走。

有一个词形容每次互动都获得全新身份的实体。它不是 agent。它是 tool。整套协议栈,忠实地执行下来,造出了更精致的工具,并管它们叫 agent。

二 · 三个具体的 Tool Calling 失败

任何在严肃工作流里同时用多个 AI 的人,过去一周都撞过这三个。

重新解释税。昨天你在 Cursor 里跟 Claude 花两小时推演一个架构决策,三种方案被考虑,两种带着具体理由被否决,一种带着写下来的保留意见被采纳。今天你打开Gemini问同一个项目的事。Gemini 一无所知。不是因为 Gemini 是更差的模型,它对这个具体问题甚至可能更好,而是因为你与你使用的 AI 之间没有任何协议层把你的语境跨越供应商边界传递。你粘贴。你总结。你重新论证那些被否决的路径。工作产出比昨天的略差,因为 AI 操作的是一个比你昨天花两小时建起来的稀疏得多的对你推理的模型。解释税在每一次跨供应商切换时复利。

反馈闭环丢失。AI 完成一个任务。你纠正它,不,那个语气太随意;不,那个变量名违反我们约定;不,那个审美不符合品牌调性。修正都很具体、经过考虑、辛苦得来。它们一个都没沉淀。下一次请求,可能就在明天,又回到默认的语气、默认的命名、默认的通用风格。Tool calling 扩展了 AI能做的事;没给它一种途径去学习你说了什么”不”。你成了一个搬运偏好的西西弗斯,每个会话推同一块品味的石头上山,看着它在 context window 重置的瞬间滚下来。

项目记忆碎裂。在一个严肃项目内部你可能在协调几个专门 agent,一个设计 agent、一个代码 agent、一个写作 agent、一个研究 agent。每个都通过 tool calling 获得了能力。每个都在自己的格式里、在自己的会话边界后维护对同一个项目的私有工作记忆。设计 agent 不知道代码 agent 上周四提交了什么。写作 agent 不知道研究 agent 已经映射了哪些约束。Agent 们作为能力被联邦化了。项目本身在它们之间碎裂,而你 ,那个人,是唯一的同步线。

这些不是 UX 问题。是被洗成 UX 问题的基础设施层失败,这样行业看起来才不那么尴尬。

三 · 反不对称的商业激励

市场上每个 AI 厂商都有商业理由维持这种状态。每个 silo 都被激励深化它对你的私有记忆,拒绝与任何其他 silo 互通。

你的语境成了护城河。你与模型积累的关系成了锁定。你用某个 AI 越久,切换越痛,不是因为替代品更差,是因为你在用「重新解释税」给每一个新 AI 付费。

“We have federated AI capability. We have not federated AI understanding of you.”

我们联邦化了 AI 的能力。我们还没联邦化 AI 对你的理解。

第二次联邦化才是真正重要的:能力没有对用户的记忆 = 租来的才华,能力有可携带的对用户的记忆 =为用户复利、由用户掌控方向的杠杆。

四 · Cognitive Federation 的技术形状

第二次联邦化的技术形状并不奇异。这是 MCP 如果针对正确不对称设计会成为的样子。

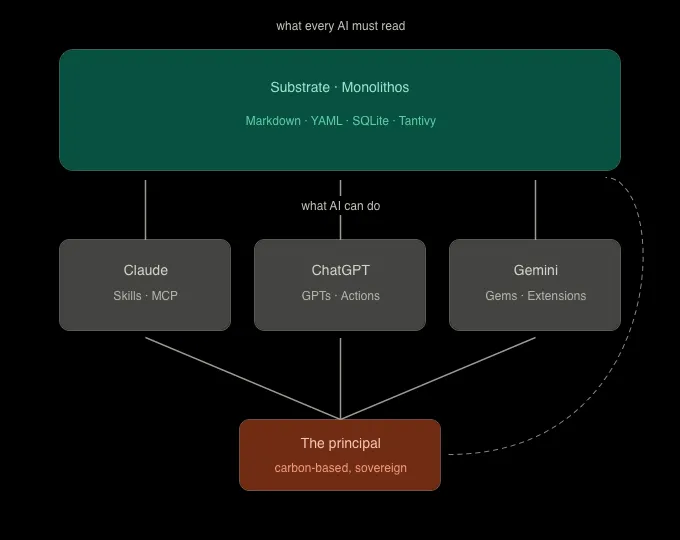

有一个用户拥有的、唯一的真相源。本地存储。用户能用自己眼睛读懂的格式。带版本。可审计。用用户自己的密钥备份。他们的笔记、决定、晶化的历史、当前的战略状态。这就是这个系列第二篇论证的 substrate:Markdown + 结构化元数据 + 确定性索引。用户多年来已经在写入的格式,只是被升级成知道如何被查询的系统。

有一个多客户端协议让任何 AI 读这个 substrate。Claude 读它。Gemini 读它。Grok 读它。明年发布的下一代读它。它们通过同一个标准接口读,同一种权限模型,返回同一份权威出处。没有模型有你的私有记忆。每个模型都对关于你的记忆有读取权,由你的规则治理。

有归因与审计。任何 AI 对 substrate 做的每个动作都被记录、可追溯、可逆。你可以问:哪个 AI 写的这个?什么权限?引用什么源?什么日期?当前 AI 工具时代把这当作高级功能。它是信任的前提。

有用户主权的权限模型。用户决定哪些 AI 能读 substrate 的哪些部分、哪些能写、哪些只能看结构化摘要、哪些被吊销。权限由用户颁发,不是供应商颁发。用户是主要的。每个 AI 都是带凭证的访客。

这才是认知联盟的真实含义。不是给一个 AI 多一些工具。是让每个 AI 都接入同一个用户,在用户的条款下,用用户的格式,对照用户对自己是谁的记录。

不是让每个 AI 多一些能力。是同一个用户的记忆和认知跨越所有 AI。

五 · 这一层不可能由你以为的人来建

还有一个论点,是这个领域大多数分析回避的,因为它不舒服。

Anthropic 不能建。商业模式取决于 Claude 成为你最依赖的 AI,一个让其他每个 AI 都能读取同一记忆的联邦协议在结构上敌对那个目标。

OpenAI 不能建,理由相同,ChatGPT Memory 的整个商业逻辑前提是记忆留在 ChatGPT 里。

Google 不能建;他们的 AI 战略层叠在一个靠数据驻留赚钱的云上。

Microsoft 不能建;他们的优势是把企业 AI 与 Microsoft 资产的其余部分绑定。

每一家都有世界级工程才华,一个季度就能把协议发出来。没有一家会发,因为发布它会溶解他们被付薪保卫的护城河。

“Cognitive federation cannot be built by anyone whose revenue depends on cognitive lock-in.”

认知联邦化,不可能由那些靠认知锁定赚钱的人来建。

这不是道德判断。是关于谁结构上有空间做这件事的陈述。把用户从供应商劫持的记忆中解放出来的协议,必须来自对用户用哪个 AI 中立的构建方。搭建基座的 builder,一定不是卖认知的。激励机制是让每个模型在服务用户上更好,一旦成为用户,终生伴随。

他们会建出世界上最好的模型。得有别人来建那一层,让你能保留你和AI们做过的事。

那是一个市场上狭小、边缘、可防御的位置。它恰好是唯一一个能设计出正确协议的位置。

This is the layer Monolithos exists to build.

“The real moat in agentic AI is not capability. It is memory. And memory cannot be rented.”

Agentic AI 真正的护城河不是能力。是记忆。而记忆,不能租赁。

本文是 Monolithos Technical Notes 第一辑的第三篇也是最后一篇。前两篇:《为什么向量搜索解决不了「AI 记忆」》、《我们把 AI 记忆层建在了 1970 年代的文件系统上》。第二辑将于本季度晚些时候启动。

英文原文:silasyu.substack.com

Monolithos 官网:monolithos.ai

夜雨聆风

夜雨聆风