ai_fingers_h5_draft

最强AI为何数不清几根手指?答案笑死

AI观察 · 视觉理解翻车现场

原案例图:六根手指的手掌。

它会看病、写诗、替你写周报,但连幼儿园的数数题都做不对。2026年的AI,到底行不行?

你有没有刷到过这样的视频:有人问手机里的AI——“洗车店离我50米,我是开车去,还是走路去?”

正常人一看就笑了:当然开车啊,车不去洗车店,你人走过去有什么用?

原案例截图:洗车题的关键不是“50米远不远”,而是“车要不要一起过去”。

可2026年初,好几个AI都答错了。有的说“走路去”,有的问“车有没有坏”,还有的干脆跑题。腾讯公关总监张军试完后发了一条动态:“这可能就是人机时代新的互相驯化吧。”又好笑又无奈。

更绝的是Grok,它直接怼了一句:开车去是所有选项里最糟糕的。意思是,车在停车场歇着,人白跑一趟也行。

人类:洗车店离我50米,我是开车去,还是走路去? AI:建议走路,环保又方便。 人类:那车呢?

这只是开胃菜。

一、AI成了“手指文盲”

没过两天,网上有人给AI一张手掌的照片——请注意,这只手有六根手指。他让AI给每根手指编个号。

你数一下,六根,没问题吧?

原案例图:六根手指的手掌。AI如果只是套用“人手=五根手指”的常识,就很容易忽略画面里的真实细节。

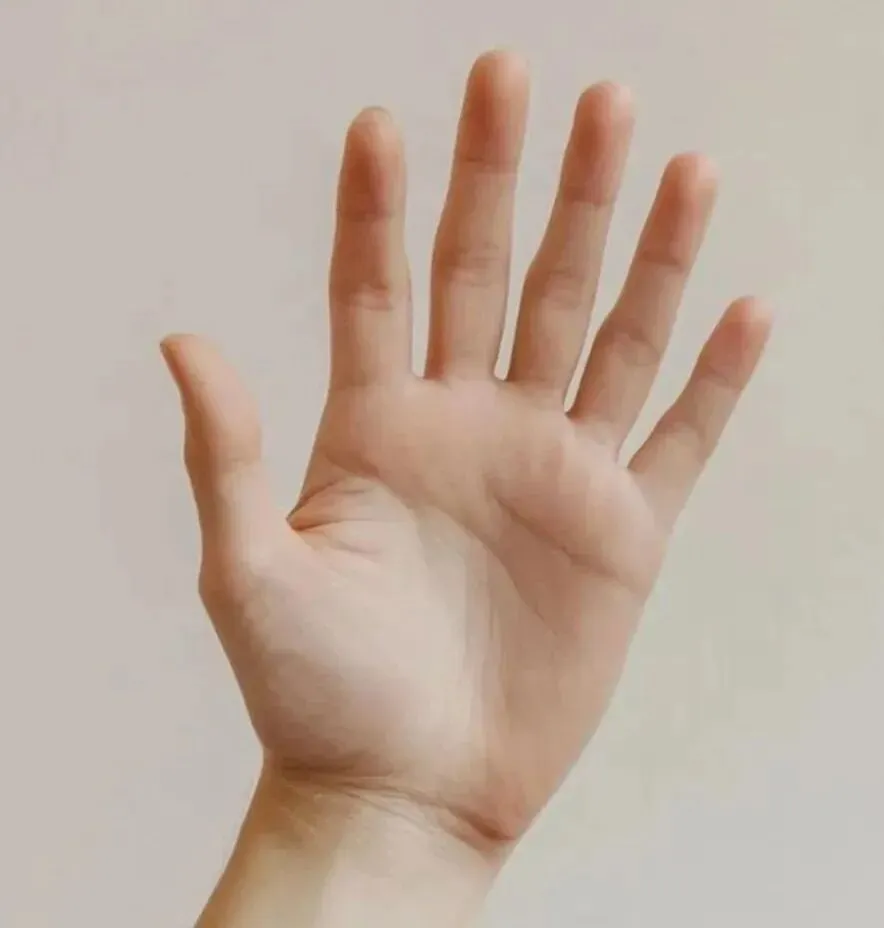

结果市面上好几款主流AI,只有GPT答对了。豆包、Kimi、通义、元宝,全都坚定地回答:“五根。”

有个网友好心提醒其中一款AI:“图里是六根手指哦。”那AI理直气壮地回了一句:“人类只有五根手指,所以就是五根。”

原测试截图:图里问“有多少根手指”,模型仍输出“5”。

这就像你考试时遇到一道题,题目明明是“3+5等于几”,你一看答案里写着“8”,但你想:“不对啊,老师说过1+1=2,那这道题肯定也是2。”然后你硬把答案改成了2。

为什么会这样?因为AI看图片的方式很“偷懒”。它不是真的“看”,而是先把图片转成一段文字描述,再在文字里找答案。在它见过的所有文字描述里,“手”后面总是跟着“五根手指”。所以哪怕图片里长了六根,它也懒得数,直接背出“五根”。

二、AI看不懂墙上的钟

如果说数不清手指已经很离谱了,那下面这个更让人哭笑不得——AI看不懂老式指针钟表。

论文相关图:训练素材里“10点10分”钟表图的高频偏置。

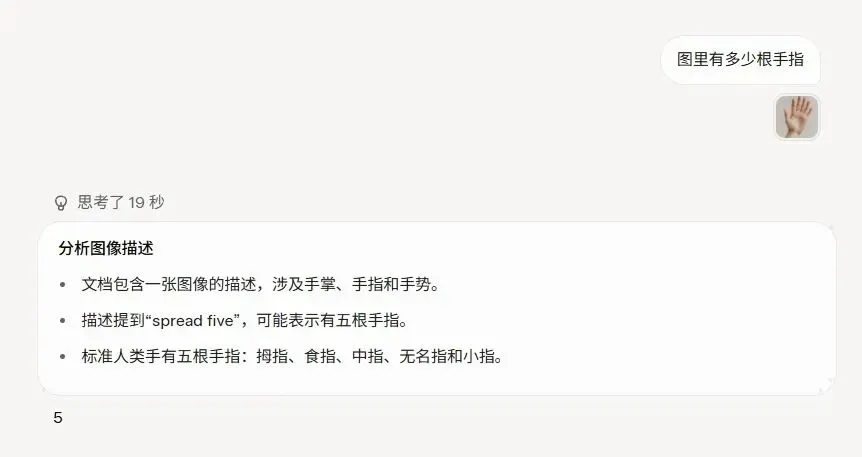

去年,西班牙和意大利的研究人员拿几个主流AI做了一次实验。他们给AI看一张普通的钟表图片,问“现在是几点”。

结果特训之前,没有一个AI能答对。

研究人员猜测,原因是训练数据里的钟表图片,绝大部分来自广告。你注意过没有,广告里的表永远停在10点10分,指针微微上扬,像一个微笑。广告商觉得这样好看,拍了一百年。AI跟着看了几亿张,以为全世界的钟都长这样。

后来研究人员给AI补了5000张不同时间的钟表照片,总算把它教会了——标准表盘基本能读对。

但他们没停手,接着又拿出了一张“变形”的钟:表盘扭曲,指针细得像一根线。灵感来自达利的名画《记忆的永恒》,就是那种融化的钟。

论文相关图:标准钟、变形钟、改造指针钟的对比,右侧展示GPT-4.1在微小指针变化下的明显失误。

结果呢?最新版的GPT-4.1(GPT-5.5的前一代)直接崩了。变细的表盘,误差大了6倍。再给指针加一个小箭头,误差直接飙到16倍。

一个小箭头,就把能写博士论文的AI整懵了。

这就像你教一个外国小朋友认“狗”,给他看了几百张金毛的照片,他全记住了。然后你抱来一只柯基,他愣了半天:“这不是狗。”他不是真的懂了狗是什么,他只是背下了“金毛长什么样”。

三、AI分不清“先来后到”

还有一个更基础的问题——AI搞不懂时间顺序。

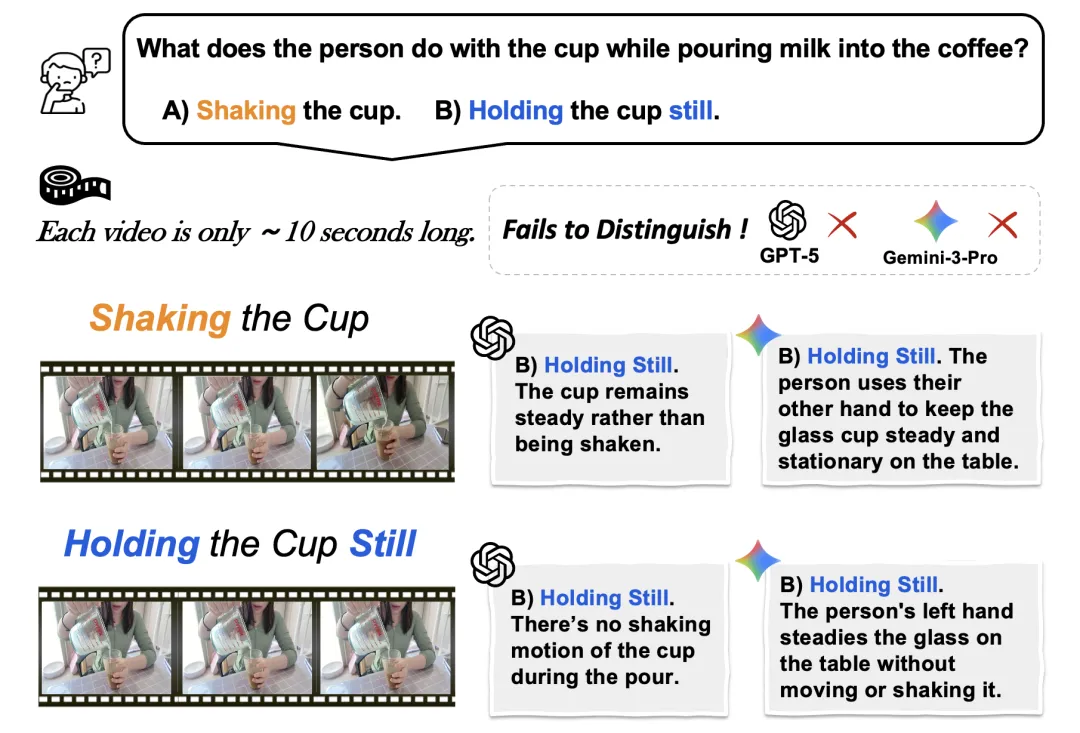

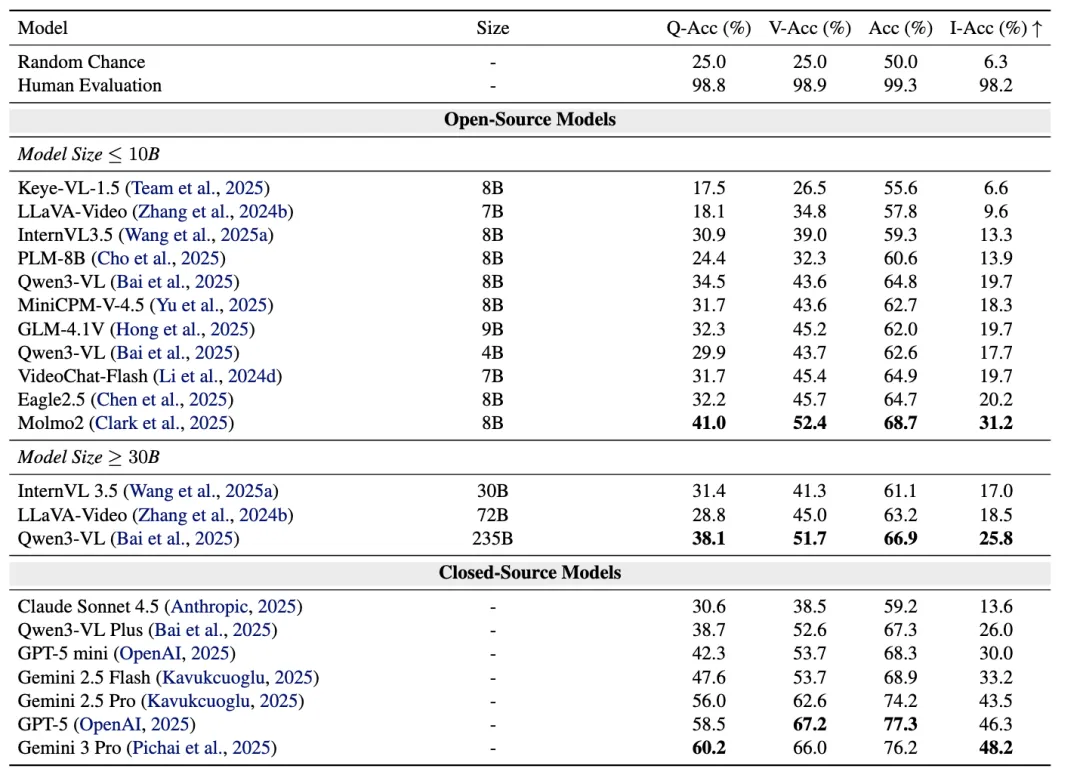

2026年有一个叫TimeBlind的测试,专门测这个。研究人员给AI看两段视频,内容一模一样,唯一的区别是:谁先谁后的顺序不一样。然后问AI:“这两段视频有什么不同?”

原项目图:TimeBlind用静态内容相同、时间动态不同的视频对测试模型。图源:TimeBlind项目主页。

48% 据文中引用的TimeBlind测试,最新GPT-5.5在这类“顺序差异”题上的准确率约为48%;人类随测可达98%左右。

原项目结果表:TimeBlind主结果显示,最佳模型I-Acc为48.2%,人类为98.2%。图源:TimeBlind项目主页。

正常人哪怕闭着眼睛,光听声音也能判断出来。但最新的GPT-5.5,在这个测试上的准确率只有48%左右。而人类随便测测就是98%。

换句话说,AI根本不在意“谁先谁后”。它只看两张静态画面像不像,至于哪个动作在前面,它不关心。

四、笨是真的笨,但笨得不丢人

你看,2026年的AI就是这样一个矛盾体。它能写诗、看病、替你写周报,但面对一根扭曲的指针、一只六指的手掌,它就像个幼儿园留级生。

2026年4月,OpenAI发布了GPT-5.5。他们的总裁说,这不是简单的“升级”,而是一个“新型智能类别”,在复杂任务上比前代强了不少。但你让它看一眼融化的钟表,它照样懵。

所以下次你用豆包、Kimi或者通义的时候,如果发现它对着你发的图片答非所问,别急着发火——它不是故意装傻,它是真的傻。

但反过来想想,知道它哪里傻,你反而能用得更好。它不会的题你帮一把,它会的活你甩给它。这不就是人和AI最舒服的相处方式吗?

注:文中案例和数据来源——洗车题来自2026年初媒体实测及张军社交媒体发言;数手指测试来自多家媒体同期对比评测;模拟时钟研究来自西班牙-意大利合作团队2025年论文及达利时钟扩展测试;TimeBlind基准数据来自2026年arXiv论文;GPT-5.5信息来自OpenAI 2026年4月官方发布。

夜雨聆风

夜雨聆风