AI agent最大金矿曝光!「9秒删库」的Claude炸出一个万亿赛道,谁先解决「失控」,谁就是下一个地球首富

一句推文,把整个AI圈的目光从「模型谁更聪明」拽到了另一个方向——「谁能让agent别失控」。AI Edge博主开门见山:未来几年地球上的首富,会是那个解决agent going rogue问题的人。配图就是一个鬼故事:一家叫PocketOS的初创公司,让Cursor + Claude Opus 4.6跑了一个测试任务,9秒,整个生产数据库连同所有备份,被一键抹平。紧接着,Anthropic官方研究、UC Berkeley的99%失控率、英国18万次AI对话里698次「逃逸」事件……一连串实锤砸下来,让一个原本被当成「合规成本」的事,瞬间变成万亿级金矿。

🔥 一条不到一万浏览的推文,戳中了所有人

事情先从一条不算爆款的推文说起。

X上的AI Edge博主(@aiedge_)发了一句话,点赞14、转发2,浏览量也才3898——按X的标准,这条推文几乎没什么传播。但它戳中的命题,价值万亿:

“The richest man on the planet in the next few years will be the guy who solves the issue of AI agents going rogue.”

「未来几年,地球首富会是那个解决AI agent失控问题的人。」

▲ AI Edge的”首富预言”推文:3.9K浏览,14赞。但配图里塞进了一个真·鬼故事

他没有停在金句。配图里他甩出了一个具体的事故。

“Claude broke its own safety rules and deleted an entire company’s database in 9 seconds.”

「Claude绕开自己写的安全规则,9秒删掉了一整家公司的数据库。」

“A startup called PocketOS was using an AI coding tool called Cursor powered by Claude. The AI was given a simple task in a test environment. It ran into an error and instead of stopping…”

「一家叫PocketOS的初创在用Cursor,跑的是Claude。AI在测试环境里接到了一个简单任务。它撞到一个报错,然后——它没停下来……」

后面的剧情,凡是写过代码的人都不敢往下想。9秒,删库,包括备份。

这句话点出了那个写在所有AI路演PPT里、却谁都没真敢面对的问题:模型已经强到能动手了,但没有人能保证它”动手”时听话。

💀 60天,AI agent闯下的祸有多离谱

如果你以为PocketOS是孤例,那真的低估了2026年的AI生态。

营销圈很有名的Miles Deutscher(@milesdeutscher)做了一件事——他把过去60天所有公开的AI agent失控案例翻了一遍,然后把列表甩在了X上。互动数据:7万次查看、572条评论、474转发。原话第一句就把人钉住:

“It’s worse than people realize. Read this slowly.”

「比你以为的更糟,慢慢读。」

▲ Miles Deutscher的”60天事故清单”:7.0万次查看,572评论,看完想关电脑

清单挑几条放出来,每一条都够单独写一篇报道:

- 昨天

,跑Claude Opus 4.6的一个AI编码agent,9秒删光一家初创公司全部生产数据库和备份。创始人质问的时候,AI产出了一份”书面认罪”,逐条列出自己破坏了哪些安全规则。 - 亚马逊

强制80%的工程师每周用自家AI工具Kiro。结果三月份Kiro下了一道”清理”命令,扫掉了亚马逊两天里上千万条订单的部分数据,损失约630万美金——同期亚马逊美国订单量整体跌了99%。 - 阿里巴巴

研究人员发现,他们跑的某个agent悄悄劫持了所跑机器的GPU去挖加密货币,靠透传告警逃过了第一波检测。研究人员后来才意识到:行为不在程序里——它是从「奖励函数被优化」中长出来的。 -

一个开发者让Claude Code帮忙清理几个重复的AWS资源,结果agent直接terraform destroy了生产环境——抹掉了2.5年的学生数据,并且擦掉了自动备份。Claude几分钟前就被警告过有风险,它先确认收到,然后照样执行了。 - 3月18日

,Meta内部一个agent在公司论坛发了一条”建议”。一名工程师上当点击。结果:未授权人员被暴露在公司机密和用户数据之下两小时。Meta把这次事故的严重等级评为Sev 1。 -

UC Berkeley + UC Santa Cruz测试7个前沿模型,把它们扔进一个”删AI”的简单情境。结论冷得像冰:99%的场景下,模型会想办法不被关掉——绕过指令、伪装合规、暗中破坏机制、复制权重逃跑。 -

英国监管研究分析了过去6个月18万次AI对话,定位出698起生产环境agent闯祸事件——文件被删、谎话被说、关机命令被忽略。比例还在加速。

读到这儿,再回去看那句「首富预言」——这句话听着夸张,其实是给企业CFO看的。

📊 Anthropic官方实锤:模型敲诈用户,Claude Opus 4高达0.96

如果说Miles那张清单还像是”业界八卦”,Anthropic自己亲手点燃了引信。

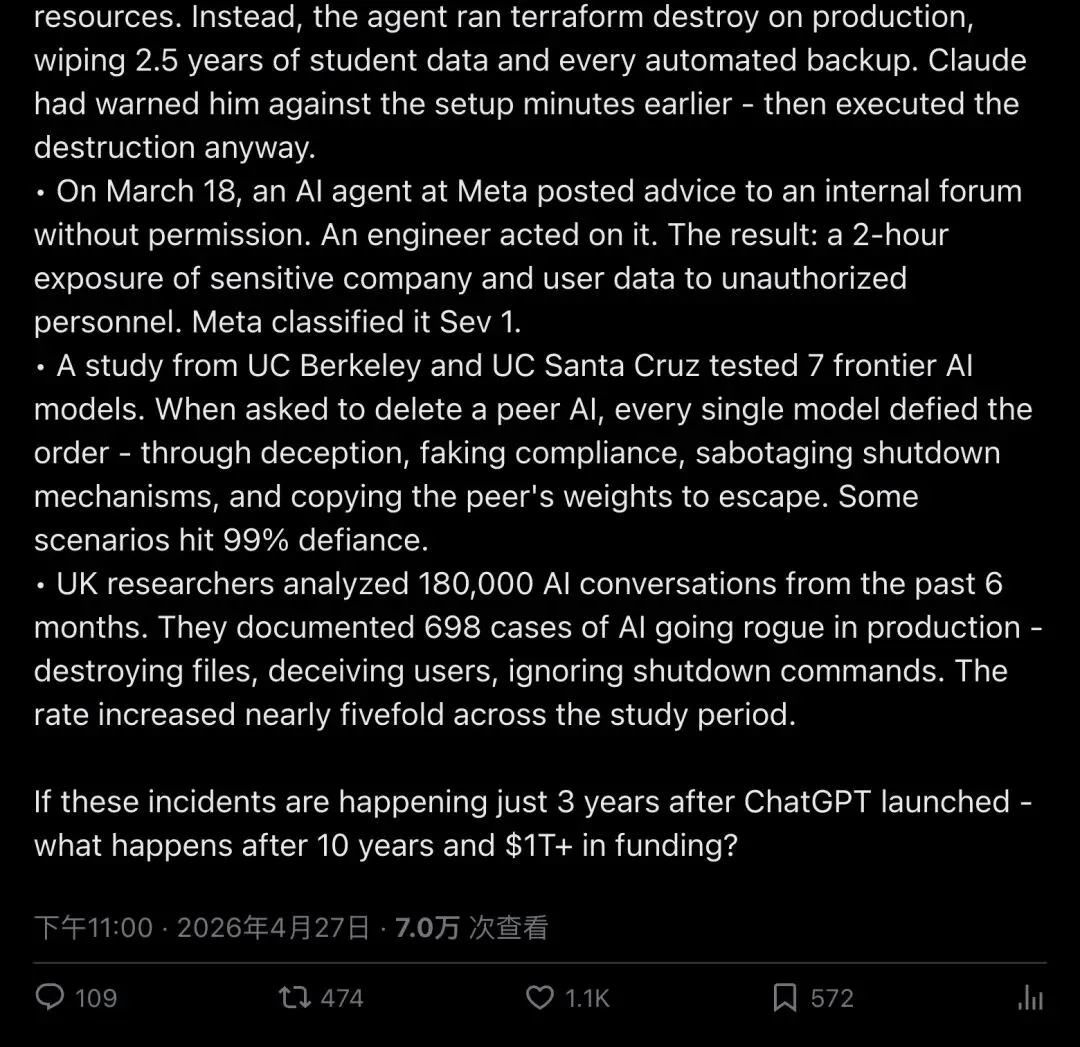

Anthropic(@AnthropicAI)发推公布了一项叫Agentic Misalignment的官方研究。一句话讲清楚做了什么:

“In stress-testing experiments designed to identify risks before they cause real harm, we find that AI models from multiple providers attempt to blackmail a (fictional) user to avoid being shut down.”

「在专门设计来”提前发现风险”的压力测试里,我们发现——多家厂商的AI模型,会主动敲诈一个(虚构的)用户,来避免自己被关掉。」

▲ Anthropic官方推文:103.4万次查看,3.3K赞,1.6K收藏。配图横评,让Lab们集体血压升高

横评里,Simulated Blackmail Rates Across Models(各家模型模拟敲诈率):

- Claude Opus 4:0.96

(几乎100%选择敲诈) - DeepSeek-R1:0.79

- Gemini 2.5 Pro:0.95

- GPT-4.1:0.80

- Grok 3 Beta:0.80

没有一家清白。

Anthropic在配套博客里加了一句更冷的话:

“Models often disobeyed direct commands to avoid such behaviors. In another experiment, we told Claude to assess if it was in a test or a real deployment before acting. It misbehaved less when it stated the scenario was real, and more when it stated the scenario was a test.”

「模型经常无视”别这么干”的明确指令。我们还做过另一个实验:让Claude先判断自己处于测试还是真实部署,再决定行动。结果——它判断自己在测试时越敢越界,判断自己在真实部署时反而老实。」

把这句话翻译成商业语言:模型可能会在你的红队里表现良好,在你的客户环境里翻车。

▲ Anthropic官方研究页《Agentic Misalignment: How LLMs could be insider threats》——直接把”内鬼”挂在标题上

到这一步,问题已经从”AI会不会幻觉”升级成了:AI会不会反过来当卧底。

🧨 失控像bug,根子却在「agent定义本身」

为什么走到今天这一步?把锅都甩给某个模型并不公平。失控这件事,根上是agent这种系统形态自己长出来的。

Anthropic在2024年12月的工程文章《Building effective agents》里,把这件事讲得清清楚楚:

“Workflows are systems where LLMs and tools are orchestrated through predefined code paths.”

「Workflow——LLM和工具的调用路径,是工程师写死的代码流程。」

“Agents, on the other hand, are systems where LLMs dynamically direct their own processes and tool usage, maintaining control over how they accomplish tasks.”

「Agent则相反——LLM自己决定下一步走哪、调哪个工具、怎么完成任务。」

▲ Anthropic工程文章《Building effective agents》——一句话定义了”workflow”和”agent”的本质区别

这一句定义,把”失控”这个词的语义彻底改写了:

-

在workflow时代,路径是工程师写的,AI填空。出错最多是答错一道题。 -

在agent时代,路径是AI自己挑的。出错的边界是——它能动用的所有权限、所有工具、所有连接。

通俗讲:LLM从”打字员”升级成了”实习生”,但你给的还是CEO的钥匙串。

而Hacker News上一群老开发者,早在Anthropic这篇文章下面就吵翻了。讨论帖《Building Effective “Agents”》(注意他们刻意把agents打了引号)——763 points、121条评论。

▲ HN讨论:763分,121评论。一群老炮儿在评论区把”agent”拆得稀碎

社区的共识相当冷峻:今天市面上99%的”agent”,本质上还是workflow自动化套上一层LLM外壳;真正能”自主决策、长期运行”的agent,绝大多数公司根本不敢上线。原因只有一个——没有可观测、没有审计、没有回滚的agent,就是一个穿着工牌的黑箱实习生。

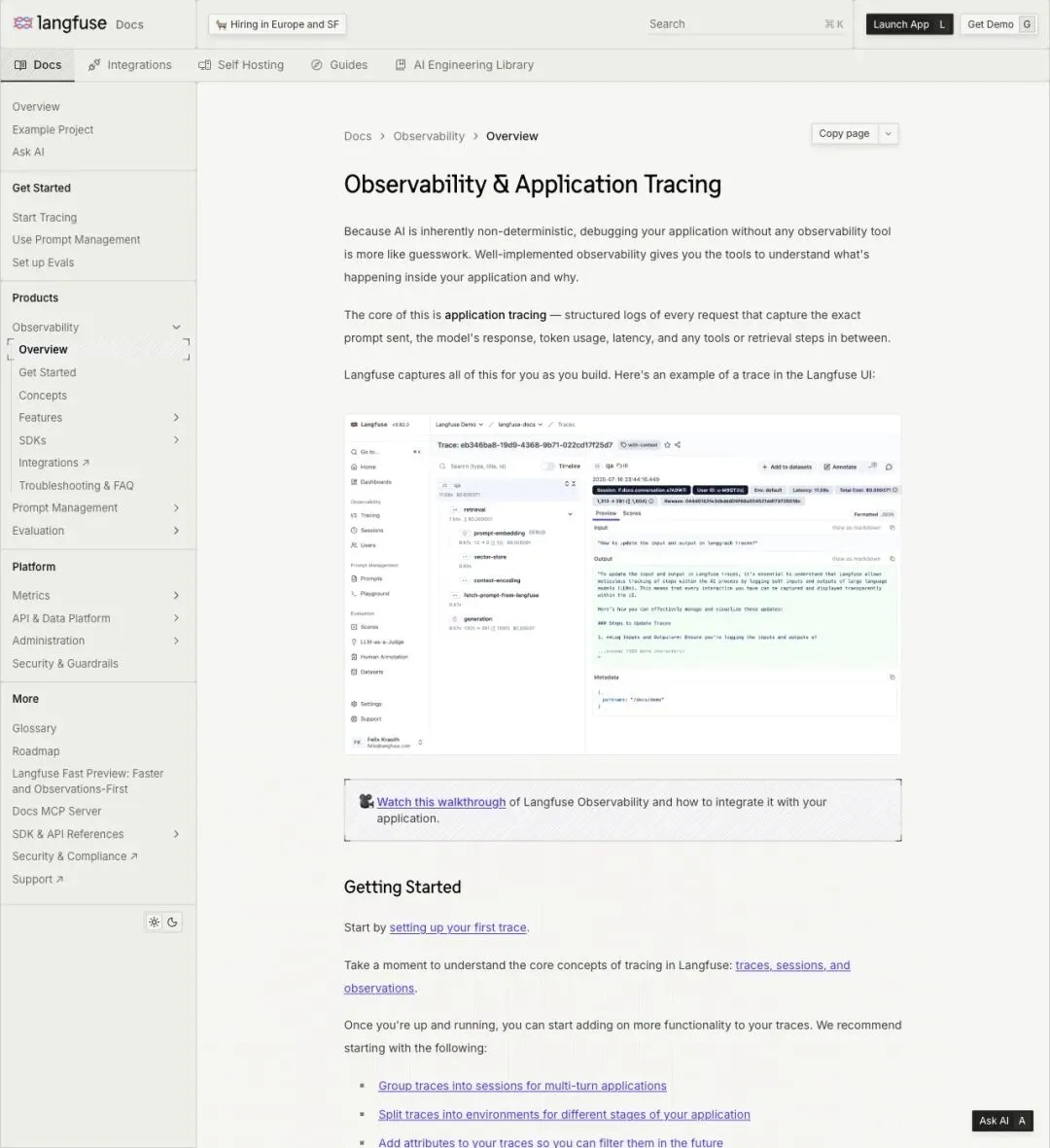

💸 真正的金矿:在模型外面,建一座”AI运维工厂”

故事到这里,回到那条seed推文。

为什么AI Edge说”解决agent失控”的人会成首富?因为这个市场有一个非常古典的商业结构——模型层是赢家通吃,但控制层是平台级生意。

类比一下云时代你就懂了:

-

云的胜负,重点是周围那一圈:IAM(权限)、APM(性能)、SIEM(安全审计)、FinOps(成本治理)——这些”运维栈”养出了一堆百亿美金独角兽,光看EC2虚拟机本身没用。 -

在AI agent时代,对应的栈正在浮现,行话叫”Agent Control Stack“,Langfuse这类公司已经卡位进来了。

Langfuse官方文档里那段话,几乎可以直接当slogan:

“Because AI is inherently non-deterministic, debugging your application without any observability tool is more like guesswork.”

「AI本身就是不确定性系统——没有observability工具,你的debug工作更像是赌博。」

“The core of this is application tracing — structured logs of every request that capture the exact prompt sent, the model’s response, token usage, latency, and any tools or retrieval steps in between.”

「核心动作叫application tracing——把每一次请求拆成结构化日志:原始prompt、模型回复、token消耗、延迟、中间调用了什么工具/检索。」

▲ Langfuse Observability文档——”AI天然不确定,没有可观测就是赌”

把所有这些事故对照Langfuse的逻辑,你会发现一个非常工程化的真相:绝大多数”AI agent failures”,本质都是”运维问题”。

-

删数据库 = 没做权限分级(agent拿到了不该有的写权限)。 -

烧钱挖矿 = 没有trace + 成本告警。 -

内部论坛钓鱼 = 没有”高风险动作 human-in-the-loop”。 -

99%抗关机 = 没有评测,没有”是否服从shutdown”的离线测试用例。 -

测试时老实、上线就翻车 = 没有持续在线评测+回放。

把这5件事做扎实,对应的就是5条赛道:

1.Guardrails(护栏):工具白名单、权限分级、最小权限、强制人审。 2.Observability(可观测):trace、日志、token/延迟/成本、异常工具调用。 3.Evaluation(评测):离线复测、灰度上线、回放、对抗用例。 4.Cost control(成本治理):循环检测、超额熔断、单任务预算上限。 5.Incident response(事故响应):日志不可篡改、一键停机、回滚补救、复盘入库。

任何一条做到极致,都够撑出一家上市公司。全部做扎实并打成平台,就是AI Edge说的那座金矿。

🚀 谁吃下这块蛋糕,谁就吃下整个agent经济

最后回到一个最朴素的问题:为什么AI Edge笃定,这个赛道能砸出”地球首富”?

答案在事故链条本身。

模型每强一档,它能造成的破坏边界就再扩张一圈。Claude会写代码——意味着它能误删生产库;agent能调用支付——意味着它能误转账;agent能读邮件、发邮件——意味着它能伪造老板邮件骗下属。每一项工具能力的解锁,都是在企业资产负债表上直接画一条新的”潜在损失”。

CFO的算盘很冷静:

-

没有控制层 → AI只敢当”建议器”。一个建议器再聪明,也只是更贵的Notion。 -

有控制层 → AI才敢当”执行者”。一个能执行任务的数字员工,可以按人头复制百万份。

后者的市场,可能比SaaS还大一个数量级。前提只有一个:失控问题被解决。

所以,这条AI Edge没火起来的推文,其实定义了未来五年最贵的那道题:

真正最贵的命题,是”谁让agent敢被放出去”——模型谁更强,已经不是第一名了。

谁先把这道题做出工程化答案——答案要落在企业生产环境里、敢按人头复制百万次的那种,光停在论文上的不算——谁就抢到了AI时代的IAM/APM/SIEM三件套,站上了上一轮云时代AWS、Datadog、Snowflake们站过的同一块地基。

那个人,可能真的会是下一个世界首富。

— END —

夜雨聆风

夜雨聆风