用OpenClaw龙虾助手的时候,你是不是也觉得token消耗如流水?

我第一次用的时候就是这样。聊着聊着,token没了。

后来我才发现,不是龙虾费钱。是我用法有问题。

这篇文章,分享8个我省token的技巧。

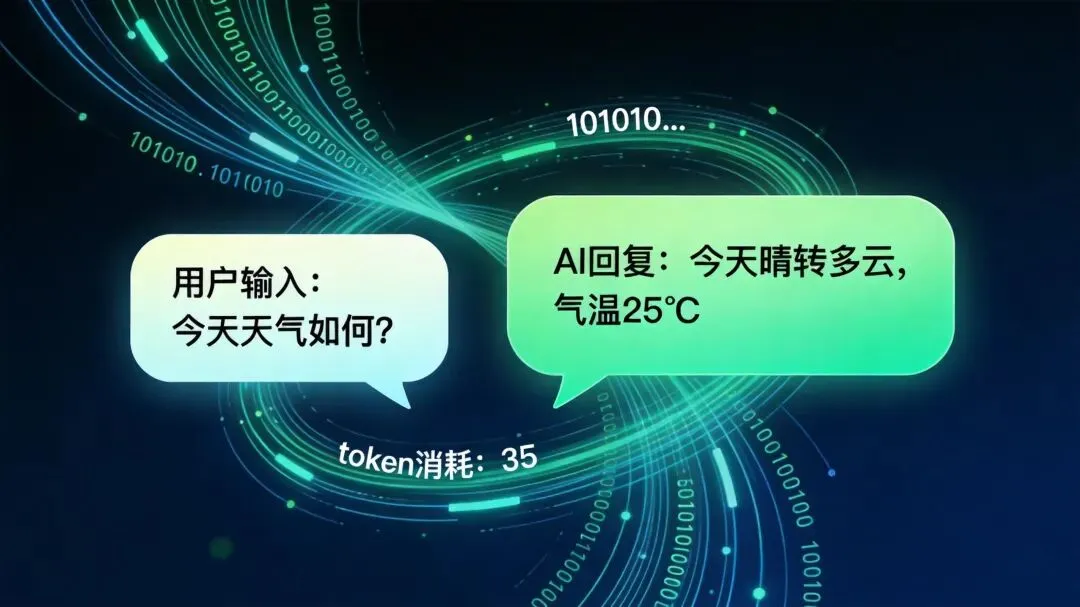

为什么聊得越久越费钱?

先搞清楚原理,才能对症下药。

每次对话,AI都会把「系统提示 + 历史消息 + 工具输出」全部打包发过去。聊得越久,这个包就越大。钱自然花得越多。

这就像去餐厅点菜,每道菜都要端上桌。聊得越久,桌上的菜越多。最后结账,你付的是整桌菜的钱——不是最后一道菜的钱。

所以,省钱的核心就两个字:控制。

控制你每次对话"端上桌"的内容量。

下面8招,就是帮你控制这个量的。

第一招:先看病再开药

在和龙虾的对话里,直接输入:

/status你会看到类似这样的信息:「Context: 50k/200k(25%)」

这个数字表示当前上下文占用比例。25%,意味着你已经用掉了四分之一的上下文容量。

这是诊断的第一步。

一般来说,超过50%,建议做优化处理。

我的习惯是:聊天前先看一眼,心里有数。就像开车看油表,快没油了就加油,别等到抛锚——那时候就晚了。

第二招:一键压缩瘦身

龙虾的对话压缩有两种模式:保守和激进。

保守模式(默认):你得手动输入 /compact,龙虾才会把历史对话压缩成一段摘要,替换掉原始记录。

适合需要精确控制的人。

激进模式:如果你经常长对话、怕忘记手动压缩,可以跟龙虾说:

改成aggressive模式龙虾会主动压缩长对话,不用你操心。

我个人的习惯是用保守模式。因为有时候我需要回看历史对话的细节,压缩之后就找不到了。但如果你只是用龙虾做日常任务,激进模式更省心。

第三招:任务结束开新篇

这个最简单。输入:

/new彻底清空历史,从零开始。

什么时候用?

• 话题切换的时候 • 任务完成的时候 • 感觉对话开始变慢的时候

这样做有两个好处:省token,避免历史信息造成上下文污染。

第二点很重要。你之前聊过的内容,可能会影响龙虾现在的判断。开新对话,让它重新思考,往往更精准。

就像跟同事开会。上午聊A项目,下午聊B项目,最好是开两个会,而不是一个会开一天——那样谁都会累。

第四招:按需切换模型

输入:

/model就可以切换当前对话模型,或者查看已接入的模型。

为什么要切模型?因为不同模型的价格差很多。

日常闲聊、简单任务,用性价比高的模型就够了。复杂项目、深度分析,再用贵的强力模型。用完立刻切回去。

这就像开车。市区代步用小排量,跑高速才用大排量。不是所有场景都需要法拉利——开法拉利去菜市场买菜,多少有点浪费。

如果你想让某个模型在所有对话持久生效,可以跟龙虾说:

把xx模型设置为默认模型然后让它自动重启网关即可。

第五招:按需切思考模式

这个很多人不知道。

大模型的思考模式会消耗大量token,响应也更慢。简单任务完全没必要开,直接回答更快更省。

关闭思考:

/think off打开思考:

/think on你还可以根据任务难度切换思考级别:

• /think low- 轻度思考,性价比高• /think medium- 中度思考,平衡速度和深度• /think high- 深度思考,慢但最透彻

我一般这样用:

• 问简单问题: /think off• 写代码、做分析: /think medium• 复杂架构设计: /think high

就像开车换挡。上坡用低速挡,平路用高速挡。省油又高效。

第六招:用PinchTab替代浏览器控制

这个是省token的大杀器。

龙虾有内置的浏览器控制功能,但它用的是截图方式——每操作一次网页,就要把整个页面截图发给AI分析。一张截图动辄几千token,用几次浏览器,token就没了。

PinchTab 是一个替代方案。它用「accessibility tree」解析网页,而不是截图。

什么意思?

简单说,就是把网页内容转成文字描述,而不是图片。同样的页面,截图要3000 token,PinchTab只要800 token左右。省5倍以上。

如果你的任务涉及大量网页操作,这一招能帮你省下一大笔。

安装方法:

npm install -g pinchtab然后在龙虾里配置使用PinchTab作为浏览器工具即可。

第七招:直接执行Bash命令

有些操作不需要AI「思考」,直接执行就行。

在命令前加 !,龙虾会直接执行Bash命令,不走AI推理流程。

比如:

!ls -la!npm install!git status这样做的好处是:这些命令本身不消耗token(或者消耗极少)。

适合哪些场景?

• 查看文件内容 • 执行已知的固定命令 • 跑脚本

就像你让助理去买咖啡。不用说一堆话解释怎么买,直接说「去买杯美式」就行。

第八招:让龙虾自己解决

如果你觉得前面的招数太多,记不住?

没关系。

直接跟龙虾说:

帮我优化token消耗看看它会给你哪些解决方案。

让AI帮你省钱省时间,也是AI的本职工作嘛。

最后说两句

这8招,核心就一句话:别让对话越积越长。

定期检查上下文(/status),该压缩就压缩(/compact),该清空就清空(/new),该切换就切换(/model、/think),该用工具就用工具(PinchTab、!前缀)。

养成习惯,你的token账单会好看很多。

我有个朋友说,一边看龙虾干活,一边看token消耗下降,感觉很爽。

嗯。我也这么觉得。

推荐阅读

加我微信进openclaw交流群(备注:龙虾)

夜雨聆风

夜雨聆风