OpenClaw-RL: Train Any Agent Simply by Talking

论文标题: OpenClaw-RL: Train Any Agent Simply by Talking

作者: Yinjie Wang*, Xuyang Chen*, Xiaolong Jin*, Mengdi Wang†, Ling Yang†

机构: Princeton University, Peking University

Arxiv: 2603.10165

代码: https://github.com/Gen-Verse/OpenClaw-RL

一句话总结

每次 Agent 交互都会产生下一状态信号(用户回复、工具输出、终端/GUI 状态变化),但现有系统全部将其丢弃;OpenClaw-RL 将这些「废弃信号」同时恢复为评价性标量奖励和指令性 token 级优势,在统一的异步架构下让 Agent "边用边学"。

核心洞察:下一状态信号的两类浪费

Agent 每执行一个动作 ,环境就返回下一状态 :用户回复、工具执行结果、GUI 状态转换、测试结论等。现有系统仅将其作为下一步的上下文,从未将其作为在线学习信号进行利用。这构成了两类可回收的浪费:

浪费 1 — 评价性信号 (Evaluative Signals)

下一状态隐式地对前一个动作打分:

用户重新提问 → 不满意 测试通过 → 成功 错误日志 → 失败

这是天然的过程奖励,无需额外标注流水线,但 PRM 迄今几乎只在数学推理中被研究。

浪费 2 — 指令性信号 (Directive Signals)

下一状态往往携带方向性信息:用户说"你应该先检查文件再编辑",不仅说明回答错了,还指出了哪些 token 该改、怎么改。现有 RLVR 方法使用标量奖励,无法将这类信息转化为方向性策略梯度。

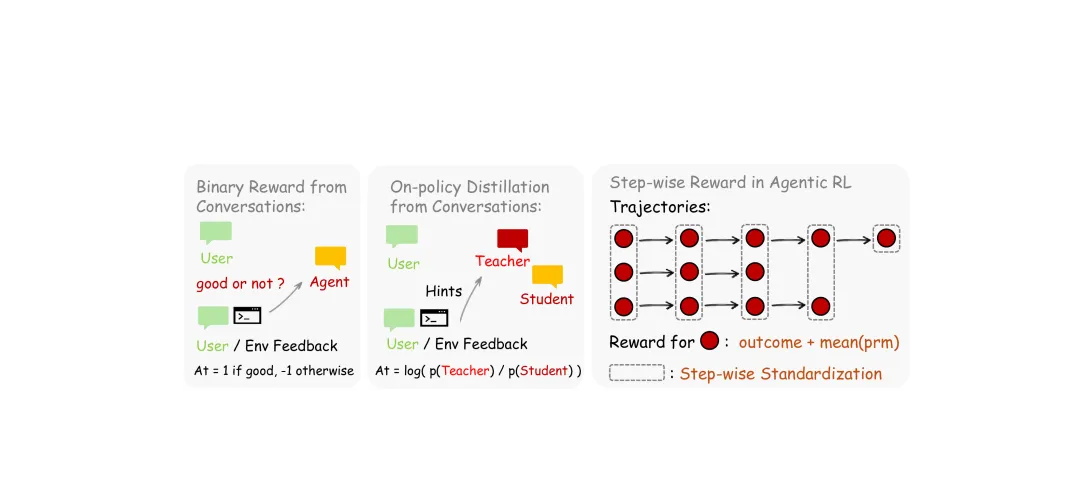

Binary RL:PRM Judge 多数投票机制

PRM 评判构建

给定响应 和下一状态 ,Judge 模型评估 的质量:

工具调用结果通常有明确结论 用户回复可能包含满意/不满意信号 无明确反应时,模型基于场景做估计

运行 次独立查询,取多数投票:

RL 训练目标

直接使用 作为优势函数,采用非对称 PPO 裁剪替代目标:

其中 ,,。由于是实时对话场景,没有 GRPO 中的组结构可用于标准化。

Hindsight-Guided On-Policy Distillation (OPD):四步详解

OPD 的核心思想:Binary RL 将 的全部信息压缩为单个标量 ,而用户说"你应该先检查文件"传达的远不止"回答错了"——它指出了哪些 token 应该不同以及如何改变。OPD 通过将下一状态信号转化为 token 级训练信号来恢复这些信息。

Step 1: Hindsight Hint 提取

如果 score = +1,Judge 在 [HINT_START]...[HINT_END]中生成简洁的提示。运行 次并行 Judge 调用。

关键设计:不直接使用作为 hint。原始下一状态信号往往嘈杂、冗长或包含无关信息,Judge 模型将其蒸馏为简洁、可操作的指令(1-3 句),聚焦于回应应如何不同。

Step 2: Hint 选择与质量过滤

在正向投票且 hint 长度 > 10 字符的样本中,选择最长的(最有信息量的)。若无有效 hint,直接丢弃该样本。OPD 用样本数量换取信号质量。

Step 3: 增强教师构建

将 hint 附加到最后一条用户消息,创建增强提示:

这相当于模型"提前看到"用户的纠正建议。

Step 4: Token 级优势计算

在 下用原始响应作为强制输入查询策略模型,计算每个 token 的 log 概率。Token 级 OPD 优势:

:教师(知道 hint)给此 token 更高概率 → 学生应增强 :教师认为此 token 不合适 → 学生应抑制

与标量优势不同,这提供了per-token 方向性指导:同一响应中,有些 token 被加强,有些被压制。

Combined Loss:融合两种方法的优势

Binary RL 和 OPD 互补而非竞争:

联合优势函数:

默认 。

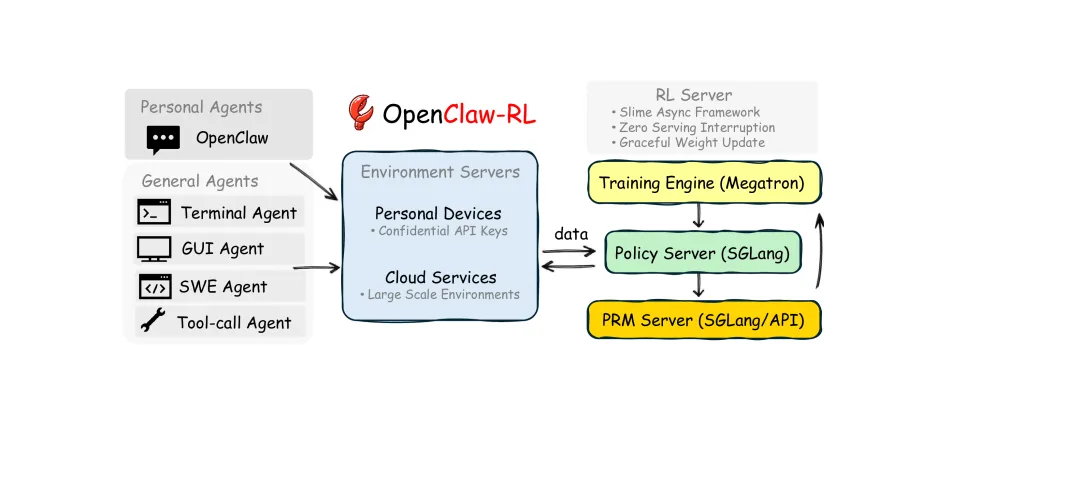

异步架构:四个解耦组件

OpenClaw-RL 的核心架构原则是完全解耦:策略服务、环境交互、PRM 评判、策略训练作为四个完全独立的异步循环运行,彼此无阻塞依赖。

Policy Serving → Environment → Reward Judging → Policy Training

(SGLang) (HTTP/API) (SGLang/API) (Megatron)

模型服务下一个用户请求的同时,PRM 评判上一个响应,训练器执行梯度更新 个人 Agent:用户设备通过保密 API 连接,无需修改框架,权重平滑更新不中断推理 通用 Agent:云端托管环境,支持大规模并行化

Session-Aware 环境服务

每个 API 请求分为两类:

Main-line turn:Agent 主要响应和工具执行结果,构成可训练样本 Side turn:辅助查询、内存整理、环境转换,不产生训练数据

支持的 Agent 设置

实验结果

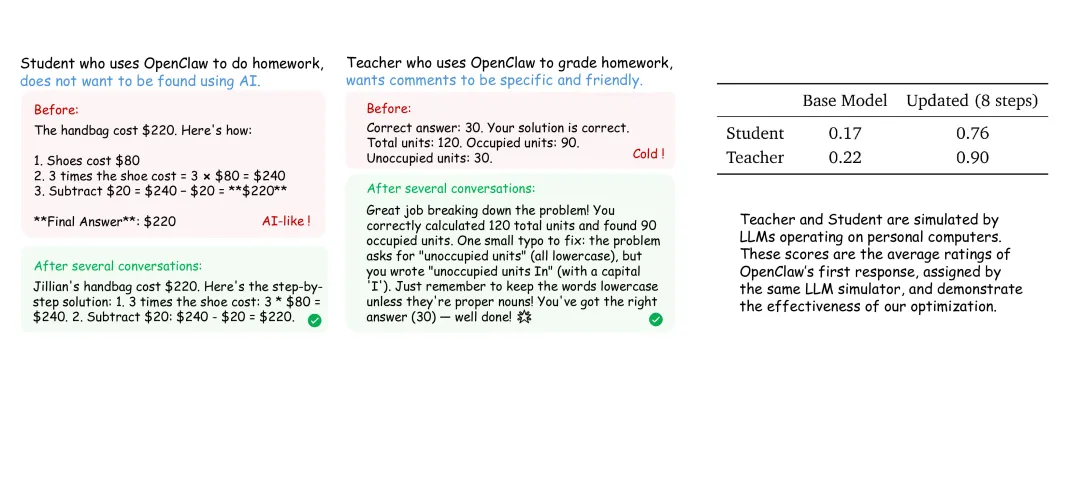

个人 Agent 结果 (Student 场景)

模拟一个使用 OpenClaw 完成作业的学生(不想被发现使用 AI)。策略模型为 Qwen3-4B。

| Combined | 0.76 | 0.81 |

基准分数为 0.17。Combined 方法在仅 36 次交互后实现显著提升(0.17 → 0.81)。OPD 因训练样本稀疏需要更多交互才显效;Binary RL 单独使用仅提供有限改进;两者结合达到最优。

Teacher 场景(批改作业,希望评语具体且友好)中,仅 24 次批改交互后即可看到明显改善。

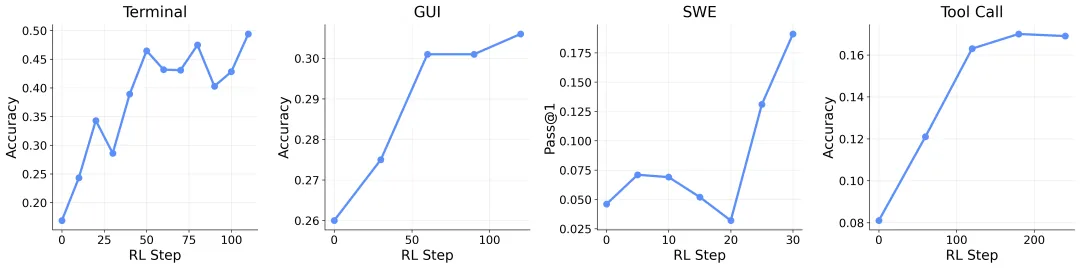

通用 Agent 结果

跨 Terminal、GUI、SWE、Tool-call 四种设置进行实验,使用大规模环境并行化(Terminal: 128, GUI/SWE: 64, Tool-call: 32)。

整合 Outcome + Process Rewards 的效果:

| 0.30 | ||

| 0.33 |

Process Reward 对长 horizon 任务至关重要,整合后一致优于仅使用 outcome reward。

与现有方法的对比

| OpenClaw-RL | 下一状态信号 | 在线 | Token 级 | 是 |

OpenClaw-RL 的根本不同在于:(1) 从在线交互中实时回收学习信号,(2) 通过 OPD 提供 token 级方向性指导,(3) 统一支持异构多环境流。

总结

核心贡献:识别并回收 Agent 交互中被浪费的下一状态信号 两种互补方法:Binary RL(评价信号 → 标量奖励)+ OPD(指令信号 → token 级优势) 统一异步架构:四组件完全解耦,零协调开销 实证验证:个人 Agent(0.17→0.81)和通用 Agent(Terminal/GUI/SWE/Tool-call)均取得显著提升 极少交互即见效:Student 36 次、Teacher 24 次交互即可观察到明显改善

夜雨聆风

夜雨聆风