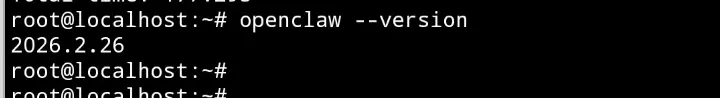

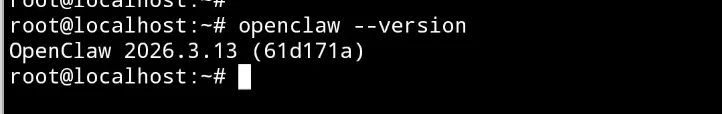

#查看当前版本openclaw --version

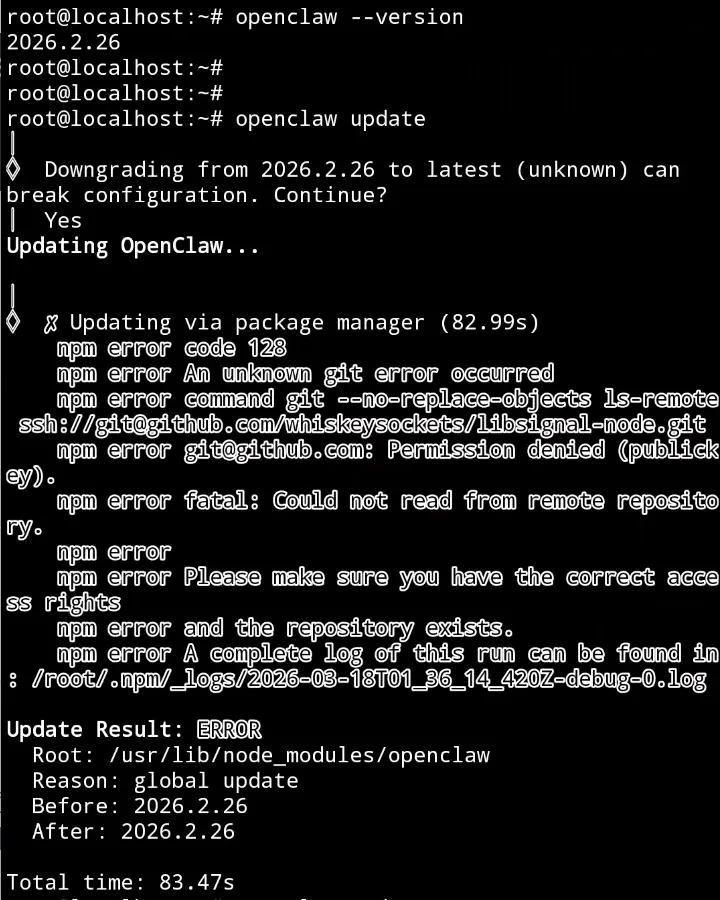

# 升级到最新版本openclaw update

这个错误表明 OpenClaw 在通过 npm 更新时,尝试从 GitHub 通过 SSH 协议拉取依赖(libsignal-node),但遇到了权限问题。

问题原因

npm 尝试使用 SSH 方式 (git@github.com) 访问 GitHub 仓库,但你的环境没有配置 SSH 密钥,或者密钥未被 GitHub 接受,导致权限被拒绝。

解决方案

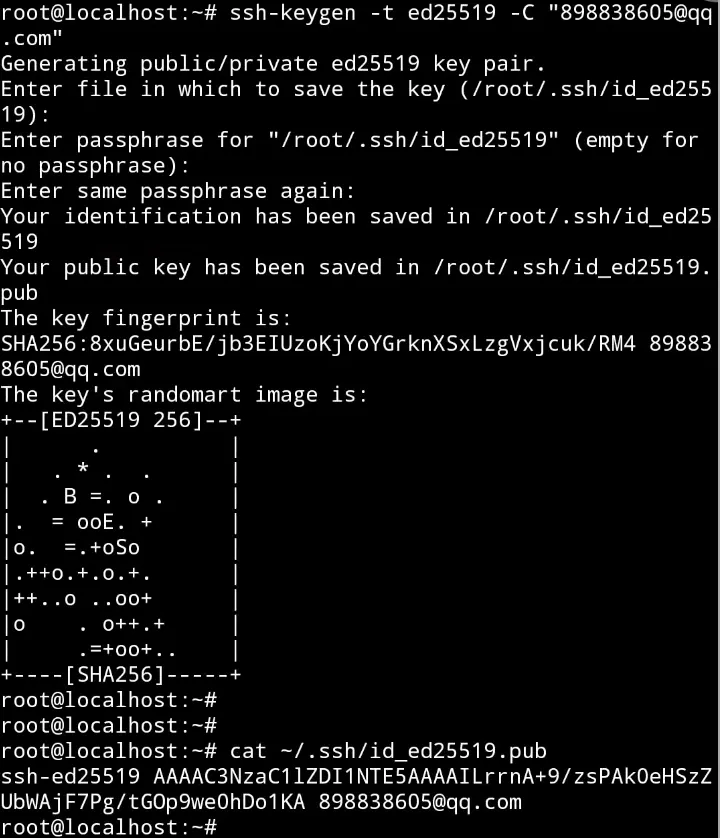

方法 1:配置 GitHub SSH 密钥(推荐)

生成 SSH 密钥并添加到 GitHub:

# 1. 生成 SSH 密钥ssh-keygen -t ed25519 -C "填你自己的注册github的邮箱"# 2. 查看并复制公钥cat ~/.ssh/id_ed25519.pub# 3. 将公钥添加到 GitHub: https://github.com/settings/keys

github打开慢的或者打不开的,可以在这里下载GitHub加速器 https://steampp.net/

# 升级到最新版本openclaw update

#查看升级后的版本openclaw --version

启动openclaw查看功能是否完整

# 先停止再启动以防原来的还在运行openclaw gateway stopopenclaw gateway --port 18789 --verbose

方法 2:强制使用 HTTPS 替代 SSH(快速解决)

# 全局配置 Git 使用 HTTPS 而非 SSHgit config --global url."https://github.com/".insteadOf "ssh://git@github.com"# 或者仅针对本次 npm 安装npm install openclaw --global --prefer-offline=false

方法 3:卸载OpenClaw重新安装(之前的配置都没了)

# 停止 OpenClaw 网关(如果正在运行)openclaw gateway stop# 全局卸载npm uninstall -g openclaw# 验证是否卸载成功(应该提示 command not found)openclaw --version

# 删除全局配置目录rm -rf /root/.openclaw# 删除 npm 缓存中的 openclaw 相关npm cache clean --force# 删除全局 node_modules 中的残留(如有)rm -rf /usr/lib/node_modules/openclawrm -rf /usr/local/lib/node_modules/openclaw

# 删除日志rm -rf /root/.npm/_logs/*openclaw*rm -rf /root/.openclaw_logs # 如果有# 删除可能存在的锁文件rm -f /tmp/openclaw*.lock

# 检查是否还有 openclaw 命令which openclaw # 应该无输出openclaw --version # 应该提示 command not found# 检查目录是否删除干净ls -la /root/.openclaw # 应该提示 No such file or directory

# 使用 npm 重新全局安装npm install -g openclaw --prefer-offline=false# 验证安装openclaw --version# 启动配置向导(会重新创建 ~/.openclaw 目录)openclaw onboard

# 再启动网关openclaw gateway --port 18789 --verbose

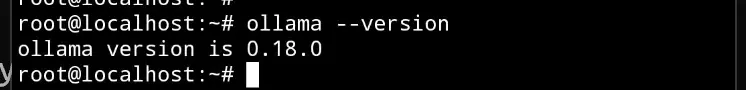

# 官方一键安装命令(更新升级ollama版本也可以用此命令)curl -fsSL https://ollama.com/install.sh | sh

# 查看是否安装成功ollama --version

ollama serve | ollama serve | |

ollama run [模型] | ollama run llama3.2 | |

ollama pull [模型] | ollama pull deepseek-r1 | |

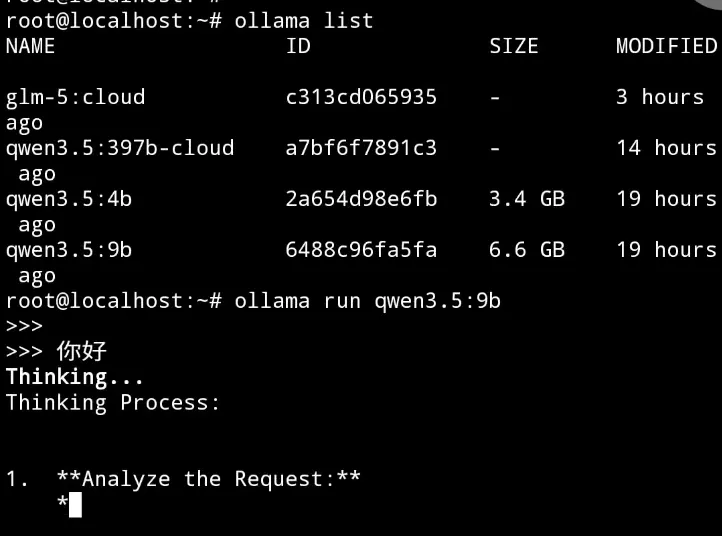

ollama list | ollama list | |

ollama ps | ollama ps | |

ollama rm [模型] | ollama rm llama3.2 | |

ollama create [名称] | ollama create my-model -f ./Modelfile | |

ollama show [模型] | ollama show llama3.2 | |

ollama cp [原模型] [新模型] | ollama cp llama3.2 my-llama | |

ollama push [模型] | ollama push user/model |

--verbose-v | ollama run llama3.2 --verbose | |

--format json | ollama run llama3.2 --format json |

/bye | |

/set parameter [参数] [值] | |

/show info | |

/clear |

OLLAMA_HOST | OLLAMA_HOST=0.0.0.0:11434 ollama serve | |

OLLAMA_MODELS | OLLAMA_MODELS=/data/ollama-models | |

OLLAMA_CONTEXT_LENGTH | OLLAMA_CONTEXT_LENGTH=8192 | |

OLLAMA_DEBUG | OLLAMA_DEBUG=1 ollama serve |

# 启动 Ollama 服务(API 服务器),此终端不要关闭ollama serve

# 前面启动了Ollama 服务(API 服务器)就不需要再启动了,此终端不要关闭ollama serve

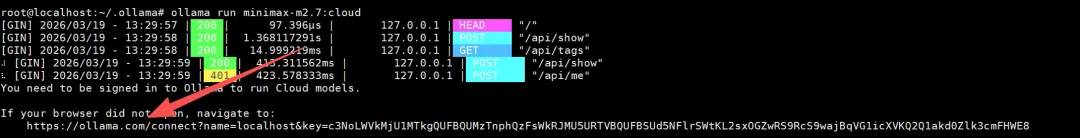

https://ollama.com/connect?name=localhost&key=c3NoLWVkMjU1MTkgQUFBQUMzTnphQzFsWkRJMU5URTVBQUFBSUlhUk1XdlVoNVYzN1p2aFVCY09EUGsyZ0lrSEdIbGg0T1lMN2FMa3J3Vk4

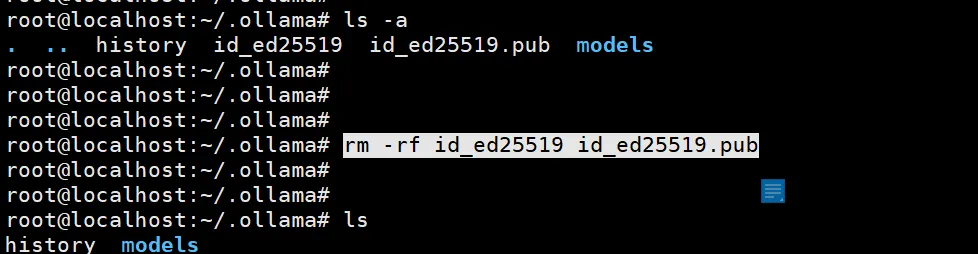

#进入ollama目录cd ~/.ollama/# 查看当前目录文件ls# 删除id_ed25519 id_ed25519.pub,这是两个授权文件rm -rf id_ed25519 id_ed25519.pub#重新启动ollamaollama serve &

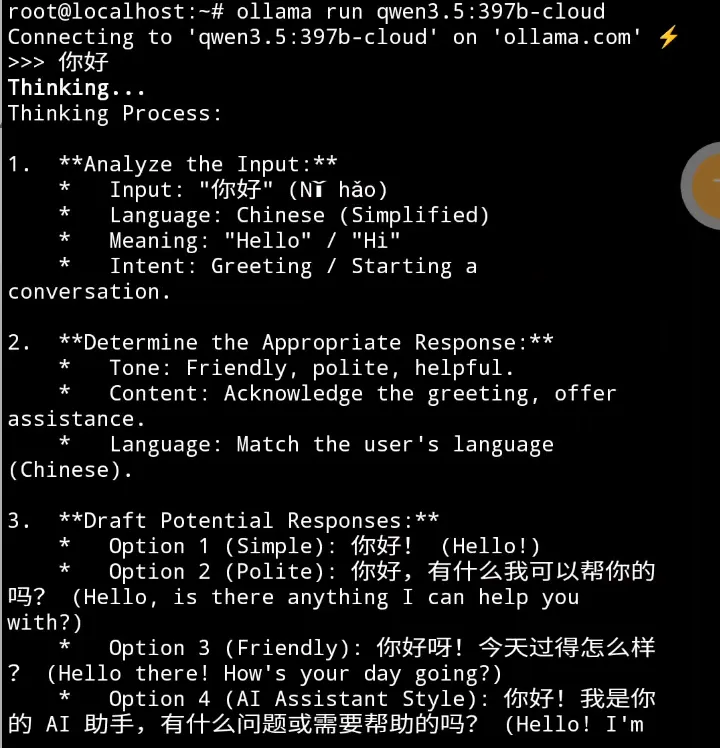

# 再随便启动一个云端模型ollama run minimax-m2.7:cloud

#启动了Ollama 服务ollama serve# 新打开一个终端执行以下命令#openclaw第一次启动用openclaw onboard 命令openclaw onboard#已经运行过的openclaw用openclaw configure 命令openclaw configure# 配置完成后启动网关服务openclaw gateway --port 18789 --verbose# :后面的自行换

第3个命令不会的看旧手机别扔!5 分钟变身 AI 服务器,手机部署 Open Claw AI 全教程

第4个命令如下选择配置ollama本地或云端模型

1、Where will the Gateway run?

● Local (this machine)

2、Select sections to configure

● Model

3、Model/auth provider

●Ollama

4、Ollama base URL

● http://127.0.0.1:11434

5、Ollama mode

● Cloud + Local

6、Models in /model picker (multi-select)

● 选择你的本地模型或者你的云端模型

7、Select sections to configure

● Continue

可以查看openclaw有哪些模型可用

# 查看可用模型openclaw models list#查看当前模型openclaw config get agents.defaults.model.primary#永久切换模型openclaw config set agents.defaults.model.primary <目标模型ID>

| Free(免费版) | ||

| Pro 版 | ||

| Max 版 |

关键计费细节

- 无 Token 计费

:Ollama 云端不按输入 / 输出 Token 收费,仅限制请求次数和并发数,成本可预测; - Premium 请求

:调用大参数云端模型(如 glm-5:cloud、qwen3.5:397b-cloud)会消耗 Premium 请求次数,普通模型不消耗; - 超额处理

:免费版 / Pro/Max 版超出额度后,会被限流或提示升级套餐,不会产生额外账单; - 私有模型

:Pro/Max 版可上传私有模型到云端,按模型数量计费(Pro 限 3 个,Max 限 5 个)。

夜雨聆风

夜雨聆风