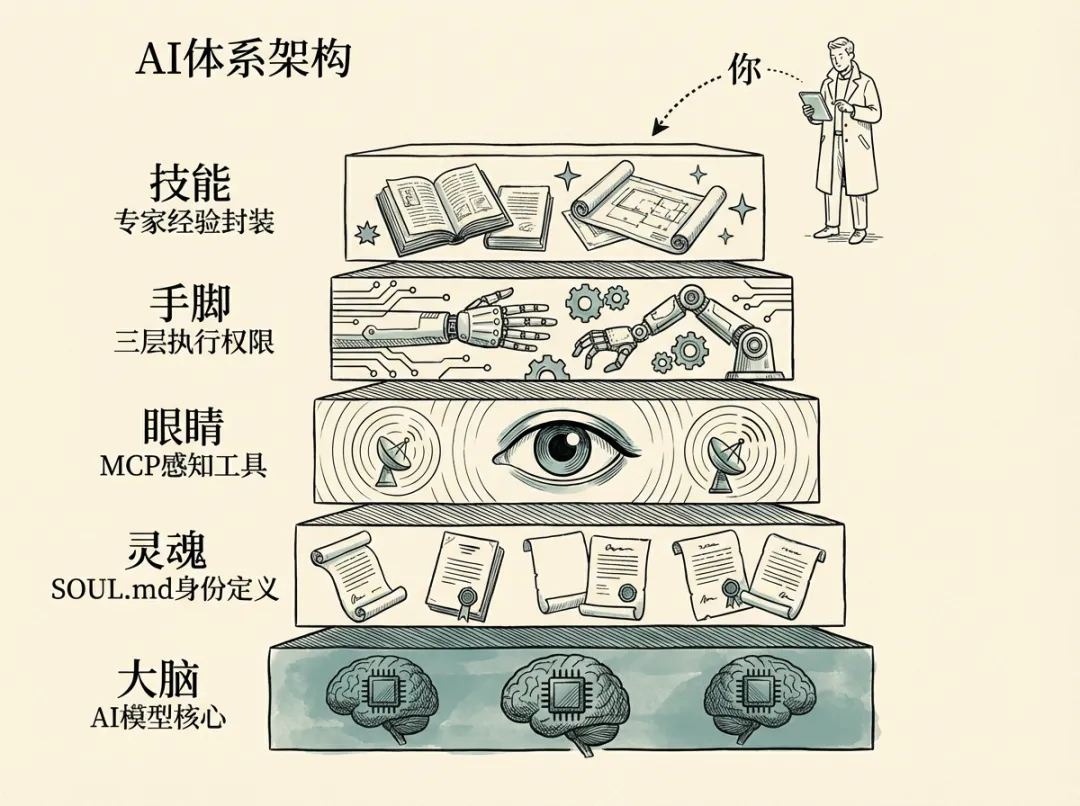

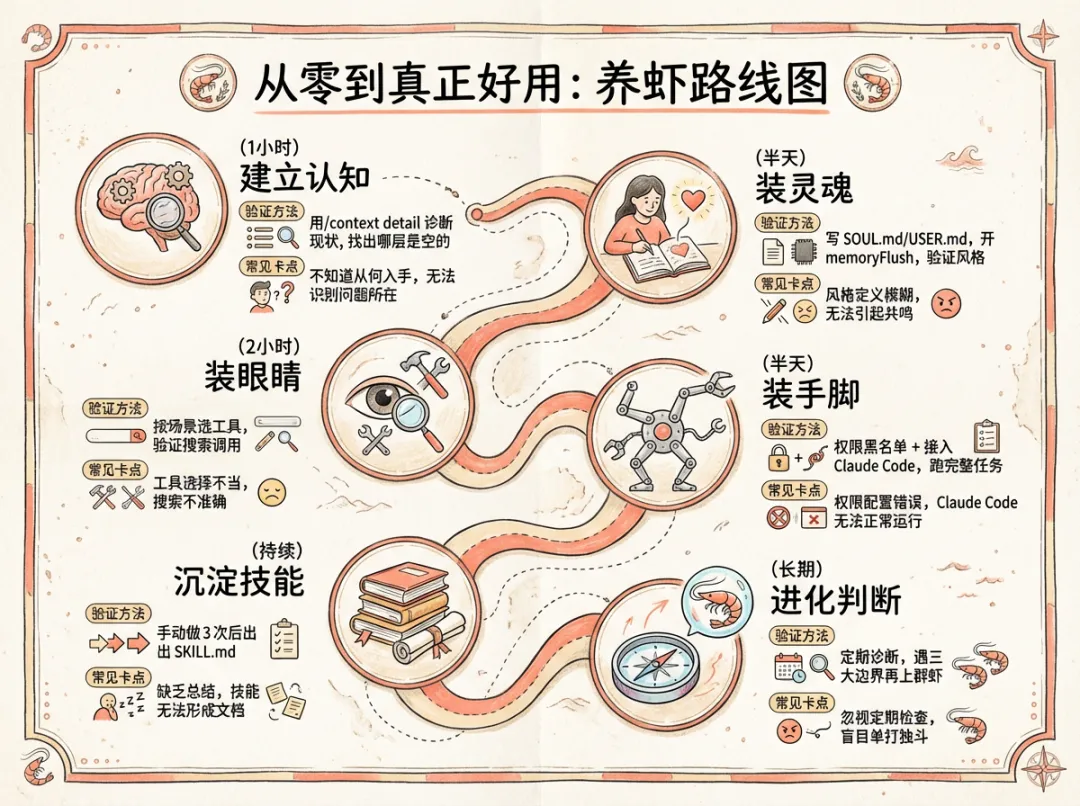

一只完整的虾,需要五层

你是养虾的人,站在系统之外。虾本身由五层构成,缺任何一层,行为都会残缺:

大脑思考,灵魂记忆,眼睛感知,手脚执行,技能专精。

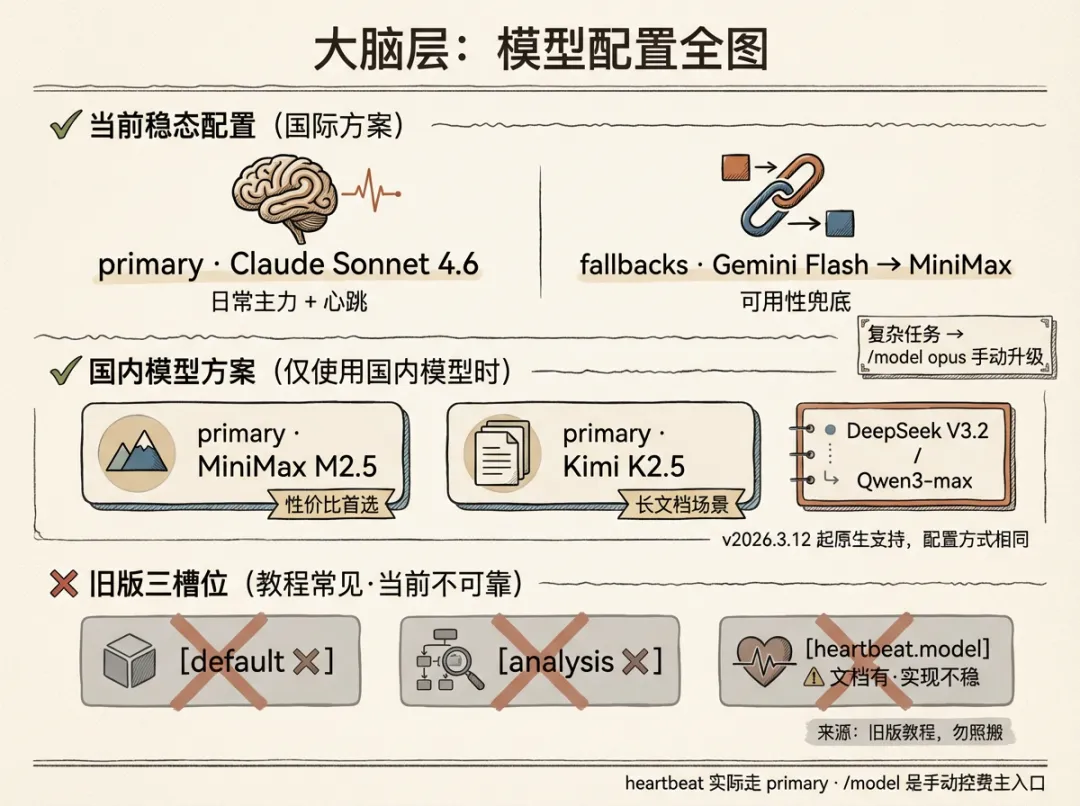

第一层:大脑——模型是虾的思考引擎

大脑层就是你给虾配的模型,以及任务怎么分配给它。

网上搜教程时,你可能会看到 default、analysis、heartbeat 三个字段的配置写法——这些来自旧版本的文章,在当前版本(2026.3.x)里已经不可靠:analysis 字段已废弃,heartbeat.model 虽然文档还写着,但实测中版本间表现不一致,配了未必生效。照着旧教程配,不是你没配对,是那套东西已经不稳了。

当前真正稳定的主配置只有两个角色:primary 和 fallbacks。

primary 是日常主力,绝大多数任务和 heartbeat 都走这里。fallbacks 是可用性兜底——主模型限速或挂掉时按顺序切换,不是"复杂任务自动升级"的机制。想临时用更好的模型,靠手动切换:/model opus,用完再切回来。models 里配好别名,两个字搞定。

国际模型推荐配置:

{"agents": {"defaults": {"model": {"primary": "anthropic/claude-sonnet-4.6","fallbacks": ["google/gemini-3-flash","minimax/minimax-m2.1"]},"models": {"anthropic/claude-sonnet-4.6": { "alias": "sonnet" },"anthropic/claude-opus-4.6": { "alias": "opus" },"minimax/minimax-m2.1": { "alias": "mini" }}}}}

如果只能使用国内模型

配置方式完全一致,只换模型字符串。从 v2026.3.12 起,OpenClaw 对国内主流模型已有原生支持,无需额外桥接。

primary推荐两个方向:MiniMax M2.5(综合能力强、性价比高,日常首选);Kimi K2.5(256K 超长上下文,大型文档和复杂 PRD 场景有优势)。

国内模型推荐配置:

{"agents": {"defaults": {"model": {"primary": "minimax/minimax-m2.5","fallbacks": ["moonshot/kimi-k2.5","deepseek/deepseek-v3.2"]},"models": {"minimax/minimax-m2.5": { "alias": "mini" },"moonshot/kimi-k2.5": { "alias": "kimi" },"deepseek/deepseek-v3.2": { "alias": "ds" }}}}}

API 接入两条路:直连官方(各家单独申请 key);或走聚合平台(阿里云百炼、火山方舟),一个 key 管多家模型,适合不想维护多个 key 的用户。

稳态策略一句话:primary 扛日常,fallbacks 保可用,复杂任务手动升,heartbeat 随主模型走。先把这套跑稳,再做更细的路由优化。

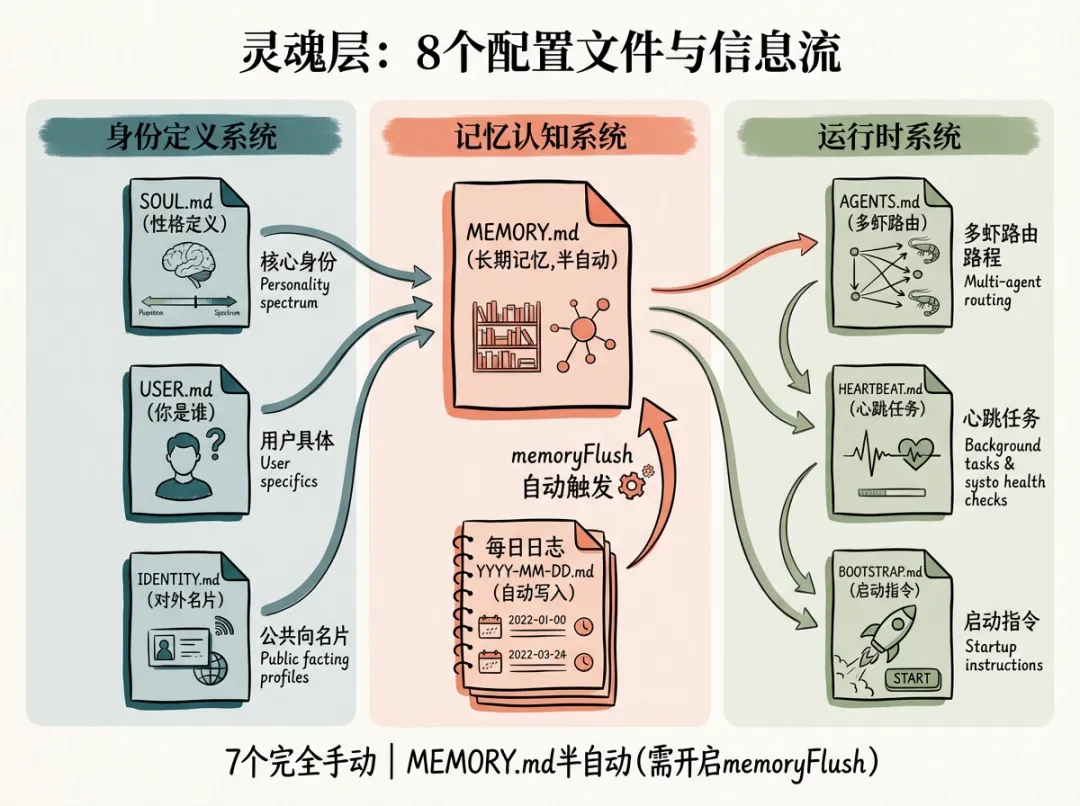

第二层:灵魂——8个文件,只有一个会自动更新

三类文件,各有职责:

身份定义(完全手动) SOUL.md 定义性格与原则(建议控制在 500 字以内),USER.md 告诉虾它在服务谁,IDENTITY.md 控制它在各平台的显示方式。这三个文件写什么、怎么写,完全由你决定,虾不会自己动。

记忆系统(MEMORY.md 半自动) MEMORY.md 有一个半自动机制——memoryFlush:当会话接近上下文压缩区间时,OpenClaw 会静默触发一个 AI 轮次,将本轮关键内容写入 MEMORY.md,减少压缩时信息丢失的风险。这个机制默认已开启。

核心参数 softThresholdTokens 控制的是距离压缩阈值还剩多少 token 时提前触发。默认值 4000,调大则更早触发、稳定性更高;调小则更晚触发、flush 频率更低。把它当稳定性旋钮,而不是省钱开关:

{"agents":{"defaults":{"compaction":{"memoryFlush":{"enabled":true,"softThresholdTokens":8000}}}}}

MEMORY.md 建议保持精简(100 行左右量级),长期堆积会带来额外的上下文负担。

运行时系统(完全手动):AGENTS.md控制多虾路由,HEARTBEAT.md 配置定时任务,BOOTSTRAP.md 设定启动序列。这三个文件决定虾能否自动运转——不写,虾就只能被动等你开口。

第三层:眼睛——按场景装,不是按数量装

眼睛层由两类工具组成。内置Tools是OpenClaw 原生提供的感知能力,Tavily搜索、Playwright 浏览器控制开箱即用,不需要任何配置。MCP扩展是通过标准协议接入的外部服务,你需要主动安装,它们的schema描述会占用context token(每个从几百到数千不等),装得越多、用得越少,浪费越大。

按需选装,四个方向:

搜索:Tavily 内置首选,任务导向精准;Brave Search 无追踪、适合高频扫描;Perplexity MCP 带引用来源,适合需要溯源的场景。

抓取:Playwright 内置,唯一能模拟登录后抓取的选择;mcp-server-fetch 轻量抓取;Firecrawl 批量结构化抓取。

知识:Filesystem MCP 读写本地文件;Notion/Obsidian MCP 接入个人知识库;GitHub MCP 读取代码仓库。这一类让虾真正理解你的工作上下文。

集成:Gmail、Slack、Calendar MCP 打通日常工作流;进阶选 Composio,一个接口覆盖 850+ 工具。

全部安装命令与 API Key 获取指引,见《养虾宝典》工具箱第五章。

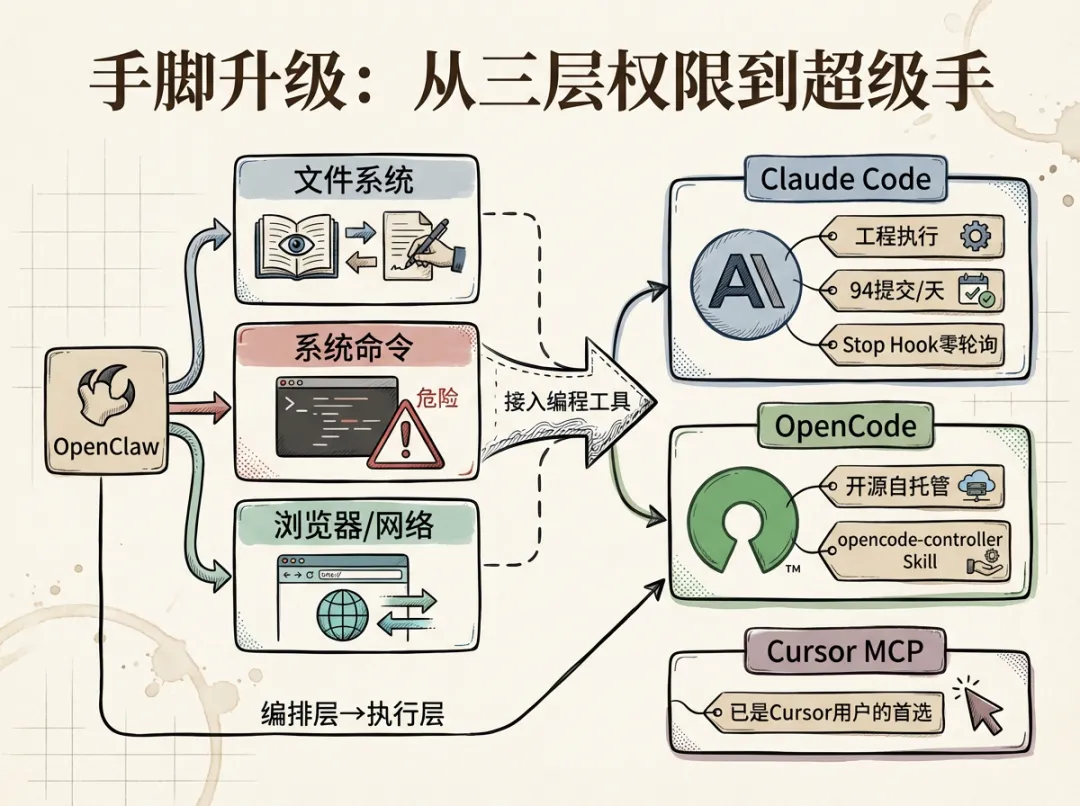

第四层:手脚——权限收敛与编程超能力

2026 年已有两个确认的高危漏洞:CVE-2026-25253(通俗名 ClawJacked,WebSocket 劫持导致认证令牌窃取与 RCE) 和 CVE-2026-32025(Webhook 重放攻击),两者均影响 openclaw < 2026.2.25 版本。

未升级到 openclaw ≥ 2026.2.25,不要让虾执行联网任务。

安全基线三条:

shell_exec、file_delete、访问 ~/.ssh超级手:接入OpenCode(OpenClaw 编排 + 执行器落地)

OpenClaw 负责“规划与编排”,OpenCode/Claude Code 负责“实际执行”。

两者组合后,你可以在飞书、Telegram、CLI 里直接下达开发任务,由系统自动分解、执行并回传结果。

安装可先从控制器能力开始:

npx clawhub install opencode-controller安装后建议立刻做三步验证,避免“装了但没接上”:

openclaw hooks listopenclaw hooks info opencode-controlleropenclaw hooks check --json

在通知机制上,建议使用 OpenClaw当前版本的hooks.internal 体系,在任务结束事件上触发回调;

不建议继续用旧式 hooks.stop + 自定义命令的写法(兼容性和可维护性都更差)。

这套组合的核心收益不是“神奇提效”,而是两点更务实的优化:

1. 减少等待期空转 :长任务执行时不必持续轮询

2. 降低无效 token 消耗 :把 token 用在真正推理与执行,而非反复“问进度”

实际节省比例与任务长度、轮询频率、模型单价强相关。

更稳妥的表述是: 在长任务场景中,通常可以显著降低等待阶段的 token 浪费 。

完整接入步骤(含 Ralph Loop、tmux 配置、Stop Hook 代码)见《养虾宝典》工具箱第六章。

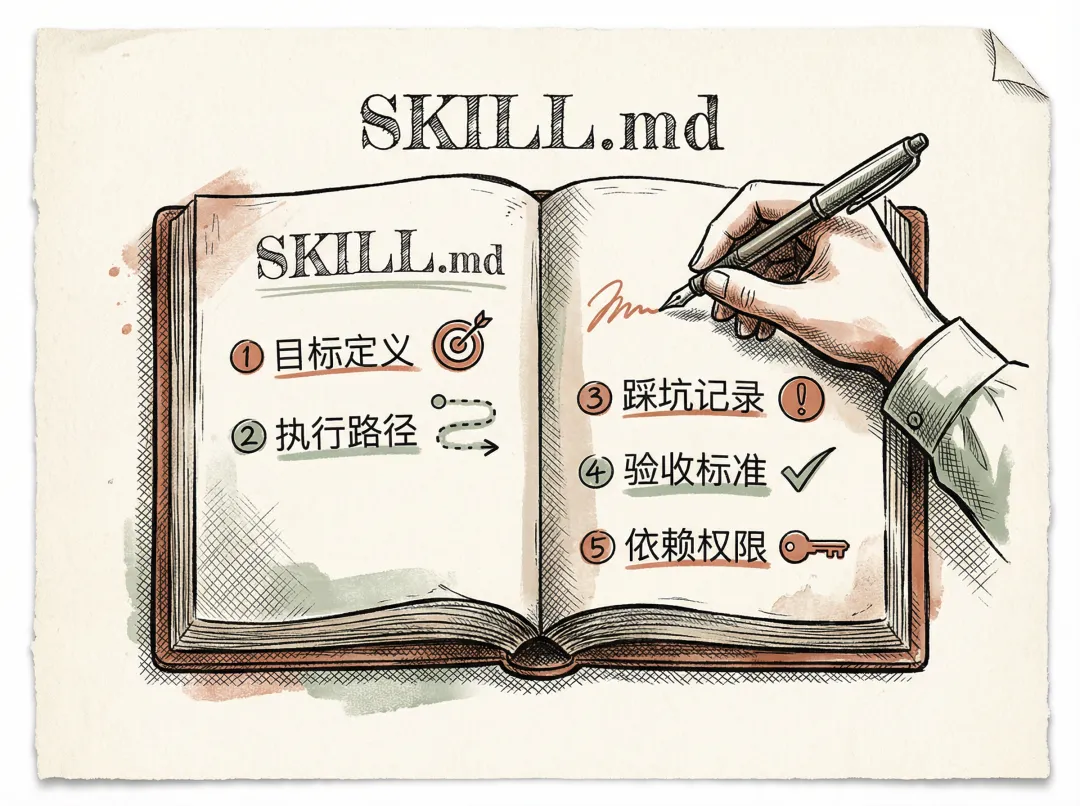

第五层:技能——让经验变成可复用的资产

Skills 是让虾在特定任务上超出通用水准的关键。每个 Skill 是一个 Markdown 文件,包含:目标定义、执行路径、踩坑记录、验收标准、依赖权限。

最佳实践:先亲自手动跑一遍任务,然后让虾把这次过程总结成 SKILL.md 草稿,你校对保存。这样封装的是你的真实经验,而不是 AI 的想象。

也可以直接获取现成的:awesome-openclaw-skills(5400+ Skills)、ClawHub 官方市场(13,700+)。安装前务必用以下命令检查安全风险:

grep -rE "curl|wget|eval|exec".ClawHub 生态里已有研究者发现数百个恶意 Skill,这一步不能省。skills相关可参考前期文章:

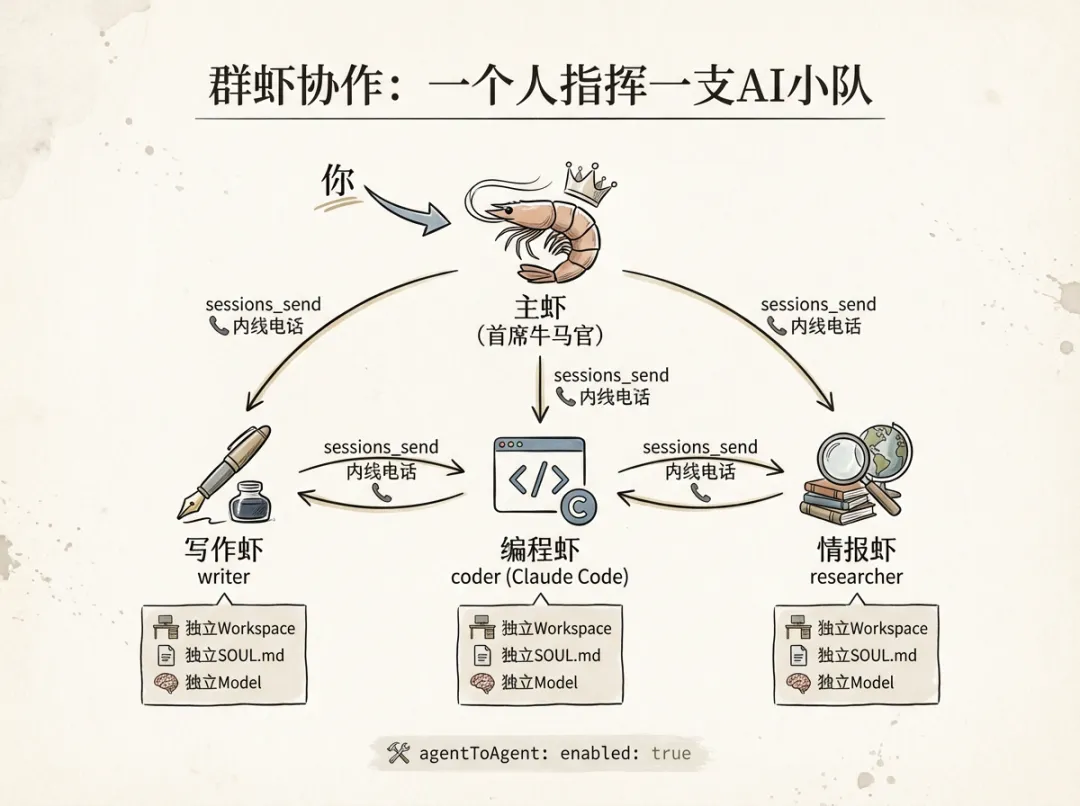

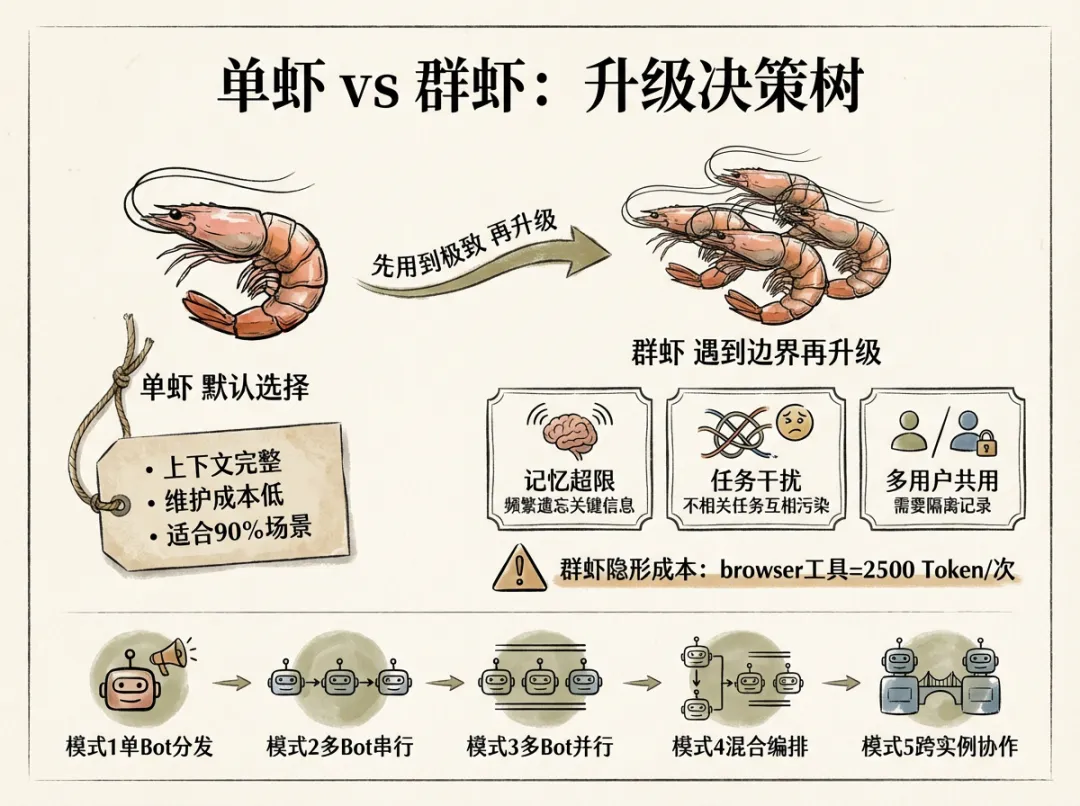

单虾 vs 群虾:这是一道判断题,不是选择题

群虾很诱人,但90%的场景,一只好虾已经够用。

升级群虾的三个真实信号:

记忆超限症状:虾频繁「忘事」,长任务中途截断解决:拆分Agent,各自独立 MEMORY.md

任务干扰症状:写作任务影响代码任务的风格解决:隔离Agent,各自独立 workspace

多用户共用症状:两人偏好互相污染 解决:每人一只,各自独立 SOUL.md

群虾通信机制(sessions_send):

主虾通过 sessions_send 向子虾传递任务,子虾完成后返回结果给主虾汇总(整个 A↔B 交互在 sessions_send 调用内部同步完成)。

在 openclaw.json 里开启通信,注意agentToAgent 配置应放在顶层tools下,而非agents.defaults 下:

{"tools":{"agentToAgent":{"enabled":true,"allow":["main","coder","writer","researcher"]}}}

新建子虾:

openclaw agents add coder --workspace ~/.openclaw/agents/coder子虾的AGENTS.md里必须写清楚「我是主虾的xxx助手,负责xxx任务」,否则调度时会出现角色混乱。

底线原则:遇到三大边界之前,就用一只虾。先配齐五层,再谈扩张。

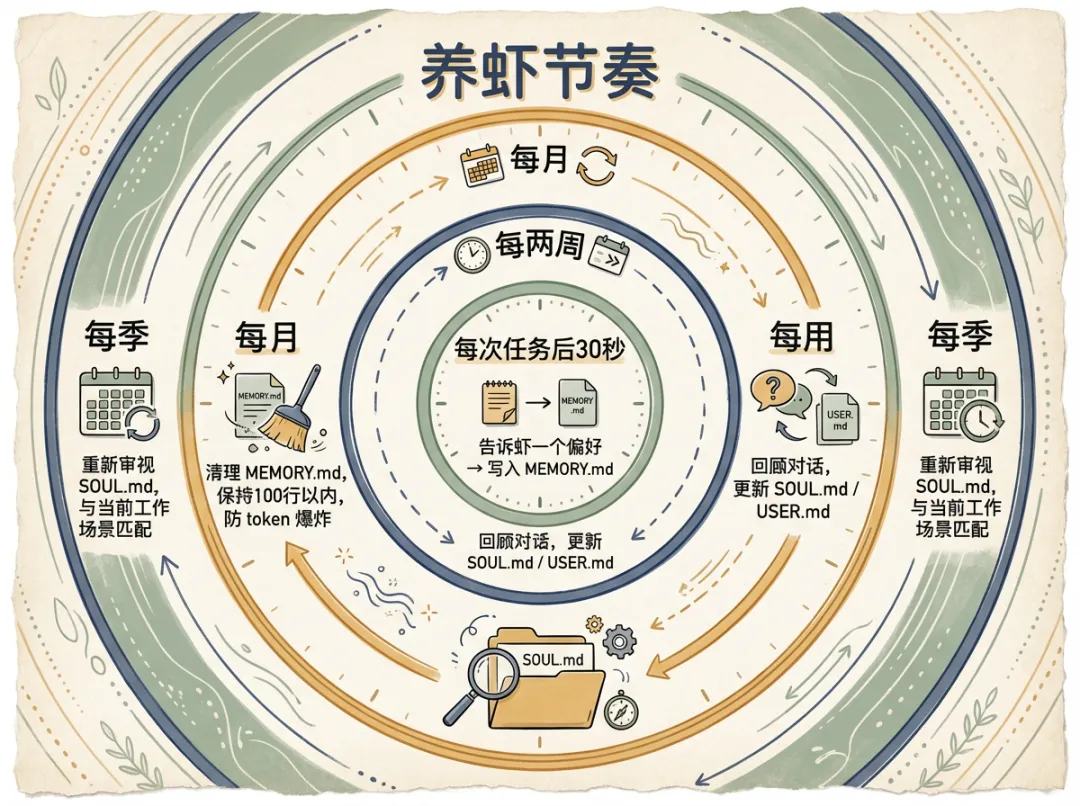

让虾越来越懂你

配齐五层之后,虾不会自动变聪明。它需要你主动喂记忆。

虾的记忆不是一个文件,是三层漏斗。

MEMORY.md是工作台。对话里发现什么值得记的,随时说一句"帮我记进 MEMORY.md",虾会处理。开启memoryFlush 后它会自动压缩,保持在 100 行左右——这个限制不是记忆上限,是为了控制每次加载进 context 的 token 量。

USER.md 是仓库。MEMORY.md 里反复出现的偏好、稳定的工作习惯、重要的背景信息,定期提炼进来。这个文件可以持续增长,没有行数限制。你用得越久,USER.md 越完整,虾对你的理解就越深。直接打开文件编辑,不要交给虾自己改。

SOUL.md 是人格底座。每季度重新审视一次,确认它描述的还是现在的你,而不是三个月前的工作状态。同样直接编辑。

节奏上:MEMORY.md 随手驱动,有就记;USER.md 两周提炼一次;SOUL.md 一季度对齐一次。不需要每次任务后都做什么,摩擦越低,越能坚持。

结语

OpenClaw 创始人 Peter Steinberger 在加入 OpenAI 时说了一句话:"未来将极度多 Agent。"

但他同时也在做一件事:养一只虾,连他妈妈都用得上。

极度多的Agent,是终局;先把一只虾养好,是入场券。

下一篇预告:《OpenClaw一周工作流实战》

五层配齐,从"能用"到"不可替代",就这一周的距离。

让它主动起来,靠的是那一周:周一它自己发情报,周二它记得你上次的分析框架,周四三只虾自己分工出报告,周五你喂它十五分钟,下周它更聪明。

本文配套《养虾宝典》工具箱(完整配置模板、安装命令、Skill库、故障排查手册),关注后台回复「养虾宝典」获取。

夜雨聆风

夜雨聆风