技术层级 | 核心技术名称 | 核心定位 | 核心作用 |

|---|---|---|---|

基础层(大模型根基) | LLM(大语言模型) | 核心引擎 | 提供基础语言能力,理解和生成人类语言,支撑后续所有技术 |

Aligning(对齐) | 安全底线 | 通过RLHF和规则约束,让AI输出贴合人类价值观和伦理规范 | |

KV-cache(键值缓存) | 效率优化 | 缓存上下文语义信息,大幅提升AI响应速度,避免卡顿 | |

对抗训练 | 安全防御 | 通过对抗样本训练,增强模型对恶意输入的鲁棒性,防止被操纵 | |

分布式训练 | 大规模训练 | 拆分训练任务到多设备并行执行,解决显存不足、速度慢问题 | |

调优层(让大模型更听话) | Prompt Engineering(提示词工程) | 零成本调优 | 优化指令设计,不改变模型参数,让AI精准响应需求 |

Fine-tuning(微调) | 场景适配 | 用特定场景数据集训练,优化模型参数,定制专属技能 | |

MoE(混合专家模型) | 高效扩容 | 拆分模型为领域专家模块,提升效率、扩容能力,降低成本 | |

PD分离(预训练与部署分离) | 落地优化 | 拆分训练与部署环节,兼顾模型能力与运行效率,解决部署难题 | |

模型蒸馏 | 轻量化适配 | 将大模型知识迁移到小模型,压缩体积,适配轻量化场景 | |

工具层(让大模型会动手) | RAG(检索增强生成) | 知识更新 | 外接知识库,检索最新信息,解决LLM知识滞后问题 |

Function Calling(工具调用) | 任务执行 | 让AI调用外部工具,从语言生成者转变为任务执行者 | |

MCP(模型上下文协议) | 工具复用 | 制定统一对接标准,打破工具壁垒,实现跨应用工具复用 | |

多模态融合 | 跨模态交互 | 让AI同时处理文本、图像等多类信息,实现跨模态生成与交互 | |

高阶层(让大模型能思考) | 思维链(CoT) | 推理提升 | 让AI分步呈现思考过程,提升复杂问题推理能力,支撑Agent自主思考 |

Agent(智能体) | 自主执行 | 基于目标自主思考、拆解任务、调用工具,全程无需人工干预 | |

Multi-Agent(多智能体) | 协同协作 | 多个Agent分工协作,解决单Agent无法处理的复杂任务 | |

Context Engineering(上下文工程) | 思路优化 | 筛选整理上下文信息,让Agent决策更精准、不跑偏 | |

Agent Skill(智能体技能) | 能力复用 | 封装可复用技能模块,快速提升Agent能力,沉淀SOP流程 | |

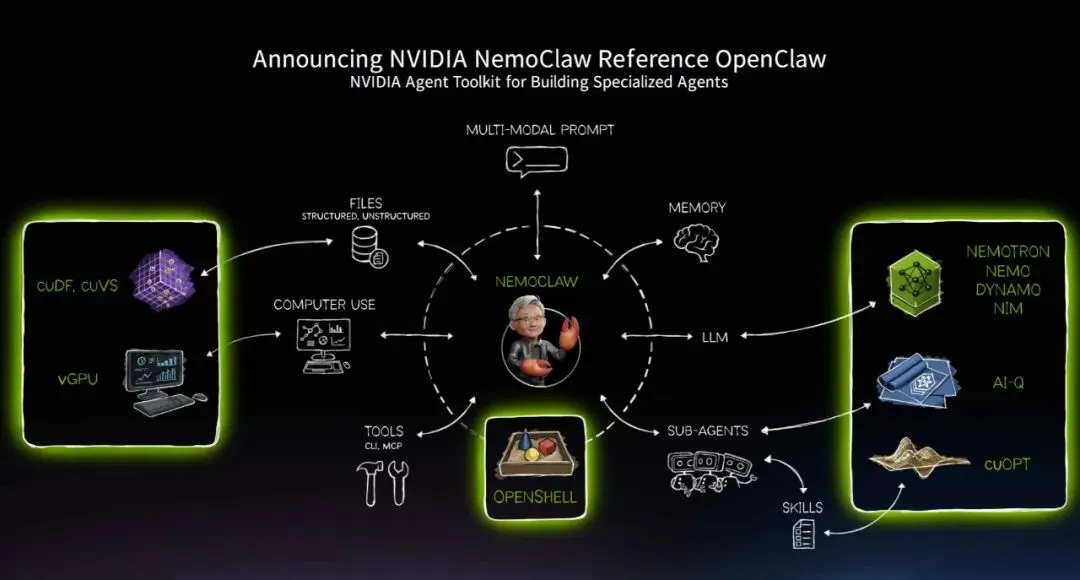

落地层(让Agent稳落地) | OpenClaw | 开源框架 | 帮助快速构建自定义AI助手,支持多入口交互和本地部署 |

Harness Engineering(工程实践) | 稳定保障 | 构建受控环境,让Agent安全、高效、可靠地执行长周期任务 |

往

期

精

选

“十五五”期间中国集成电路产业如何实现全球前三、自给率80%、7nm国产化等远大目标?

CPU vs GPU vs TPU vs NPU vs LPU,AI算力五巨头到底谁才是王者?

电力、存储、光通信、芯片算力/算法协同实现AI未来十年1000倍能效提升

夜雨聆风

夜雨聆风