很多人,包括马斯克,都畅想过AI解放人类——大部分人躺着,AI干活。

可现实呢?我们被AI焦虑和AI项目压得喘不过气,才猛然惊醒:我们以为的“效率解放”,其实是AI挖的隐形陷阱。它没让我更轻松,反而悄悄偷走我的时间、能力甚至隐私。这不是危言耸听,是我和AI打交道最真切的体感,也是最容易被忽视的真相。

下面,咱们就先来聊一聊这些代价:

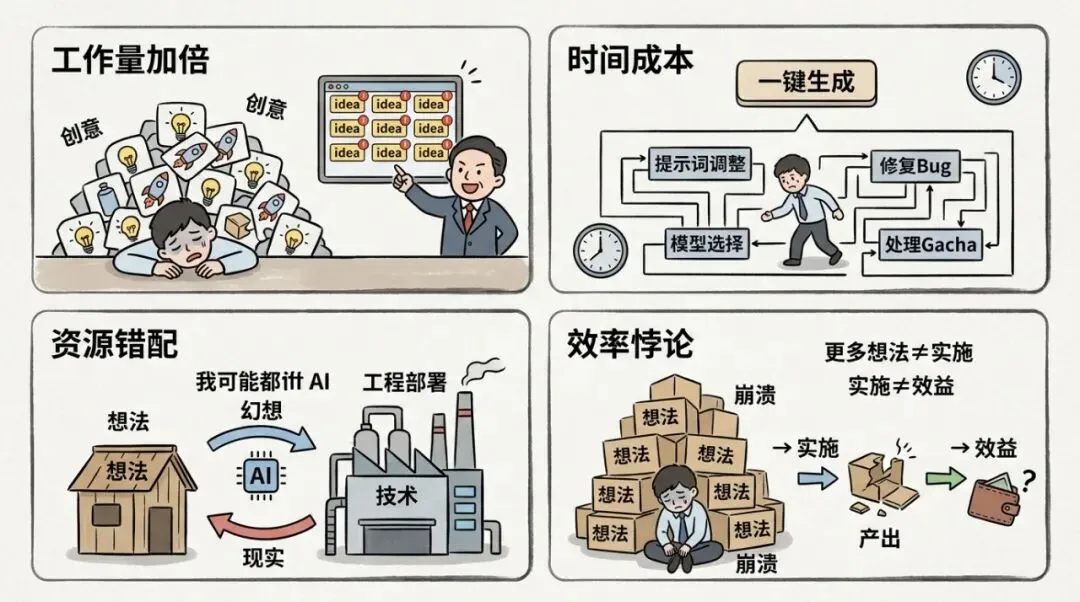

想法爆炸:老板狂喜,打工人快疯了

AI让创意产出变廉价,老板的想法被无限激发,打工人的任务量直接翻倍。

更扎心的是,AI本身有学习成本——调提示词、选模型、修bug、处理抽卡……每一个“一键生成”背后,都是我半天的命。最离谱的还不是忙,是资源错配。明明是需要技术、工程、部署能力的项目,让一个个产生了我有AI我也行的错觉。

科技发展的“效率悖论”电灯、汽车、互联网本是为了改善人们生活,结果却让我们更忙——天黑了也要干活、出差要当天往返,消息要秒回。AI也一样,效率提升了三倍,忙碌却翻了倍。我们被自己创造的工具,绑得更紧。

结论:想法变多 ≠ 你能实现;能实现 ≠ 投入产出划算。AI没让我躺平,反而让我更卷了。

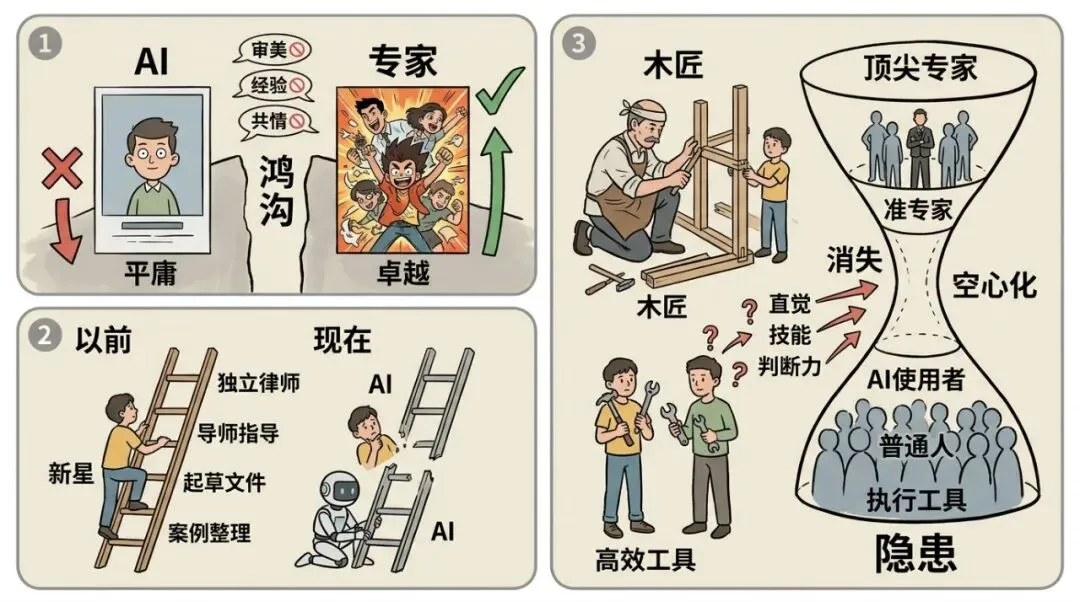

人才断层:学徒活被AI抢了,然后呢?

AI吞掉了人才成长的基础环节,跳过“做中学”,直接切断了中间层的成长路径。

创作质量的对比我用AI剪视频、做海报,效率远超手动,但和专业导演、设计师比,差距依然明显。就像猫和老鼠动画师John与AI同题作画——AI的作品合格却平庸,而John的作品总能让人眼前一亮。AI给不了审美、经验和共情。

人才成长的对比以前,法学院毕业生从整理案例、起草文书做起,跟着前辈一步步打磨,最终成为独当一面的律师。现在,AI包揽了所有“学徒活”,律所不再需要初级助理。通往专家的梯子,最下面几级被抽掉了。这和传统木匠、裱画手艺的困境如出一辙——因为高效工具,年轻人不愿再花漫长时间学徒,古老手艺慢慢失传。

结论:未来可能只剩顶级专家和会用AI的普通人,中间那个“准专家”阶层正在变薄,最后沦为具体执行的作用。手感、直觉、判断力,谁来培养?这是个长期隐患。

信息环境恶化:你刷的可能是“数字泔水”

AI生成内容的低门槛,导致“数字泔水”泛滥,污染信息环境,还慢慢弱化了我们的深度思考能力。

信息环境的对比以前是“信息免费但难找”,我们花时间找可信信息;现在是“信息泛滥但难辨真假”,我们要花更多时间筛选,甚至要为可信信息付费。AI生成的假消息全网疯传,数据“投毒”污染模型,优质信息被“数字泔水”淹没。你看到一条新闻,第一反应不是“信不信”,而是“这是人写的还是AI写的”。

更麻烦的是:信任成本变高了。 你连熟人发来的视频都不敢轻易相信,因为可能是AI换脸。社会整体的互信被削弱,沟通、交易、协作的效率反而可能下降——AI本为提效,结果在信任层面拖了后腿。

结论:思考判断的成本指数级上升,信息获取的平等性被打破,社会信任成本增加,效率反而可能降低。

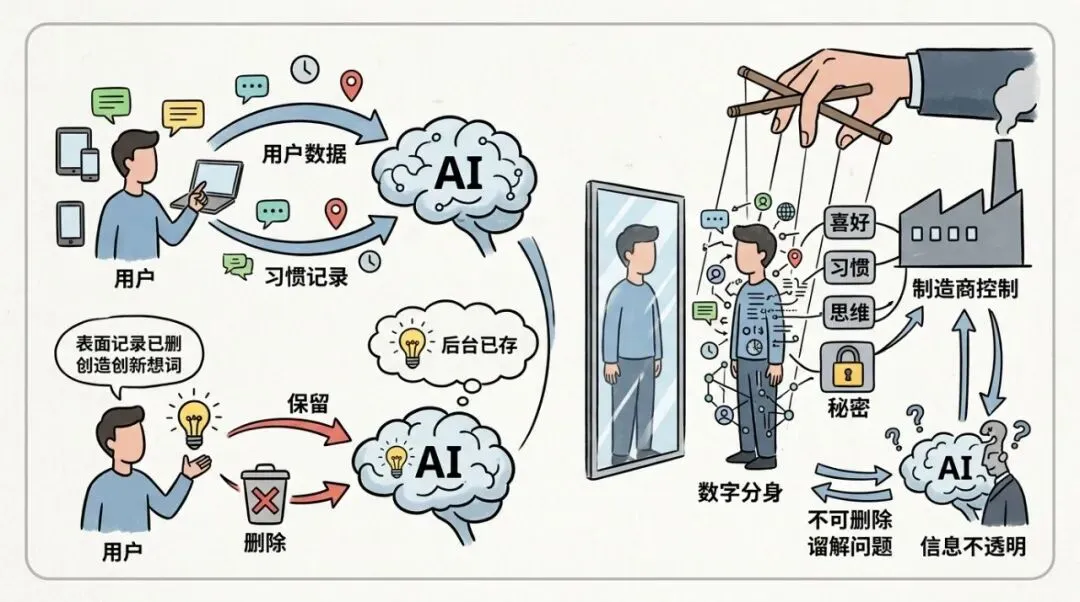

数据隐私:你以为删掉了,它其实都记着

AI的智能依赖用户数据,后台隐性记录你的习惯,隐私被悄悄窃取,你却毫无察觉。我做了一个实验:创造一个无任何公开记录的全新概念并创造了一个词,删除会话后,AI依然能记住并自然使用它。原来,我们删除的只是“表面记录”,后台数据早已被悄悄留存。我们以为的“隐私”,其实早已被AI默默“记住”。

说白了,厂家直接拿捏了你的数字分身。 你的偏好、习惯、思维方式,甚至那些你不想让别人知道的东西,都在它手里。你连删都删不掉,连问都问不清楚。

结论:廉价AI的代价,往往是你的隐私,更是你对自身数据的失控权。厂家随意拿捏你的喜好。有的公司的数据也很容易就被AI抓了去。这也是为啥各大厂商都狂推自家的AI大模型。数据为王的时代,谁掌握了用户的数据,谁就更具优势。

咱们再来聊一聊目前AI模型的一些硬伤:

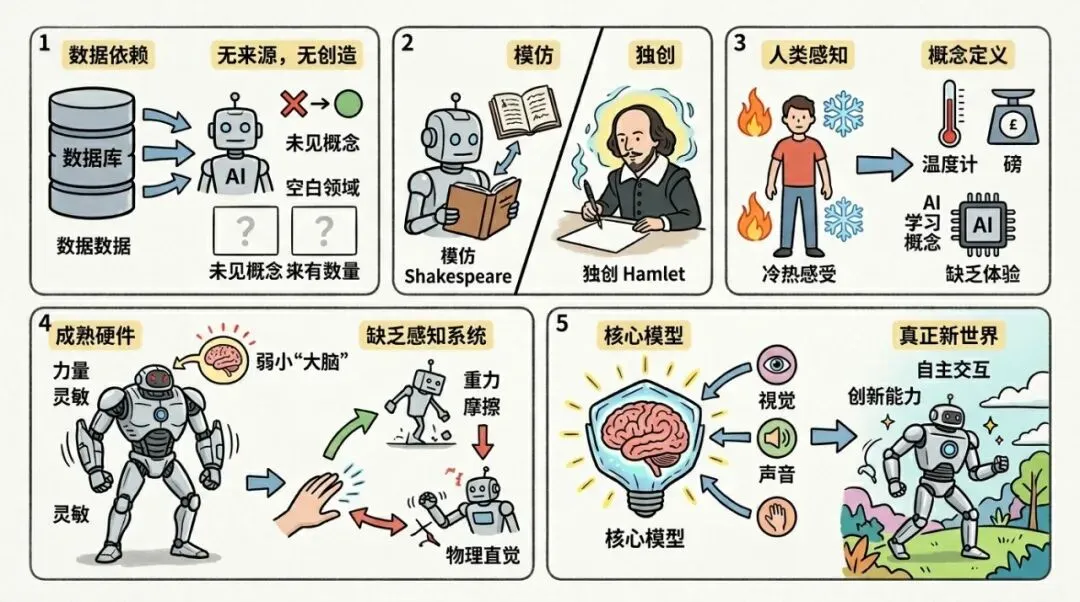

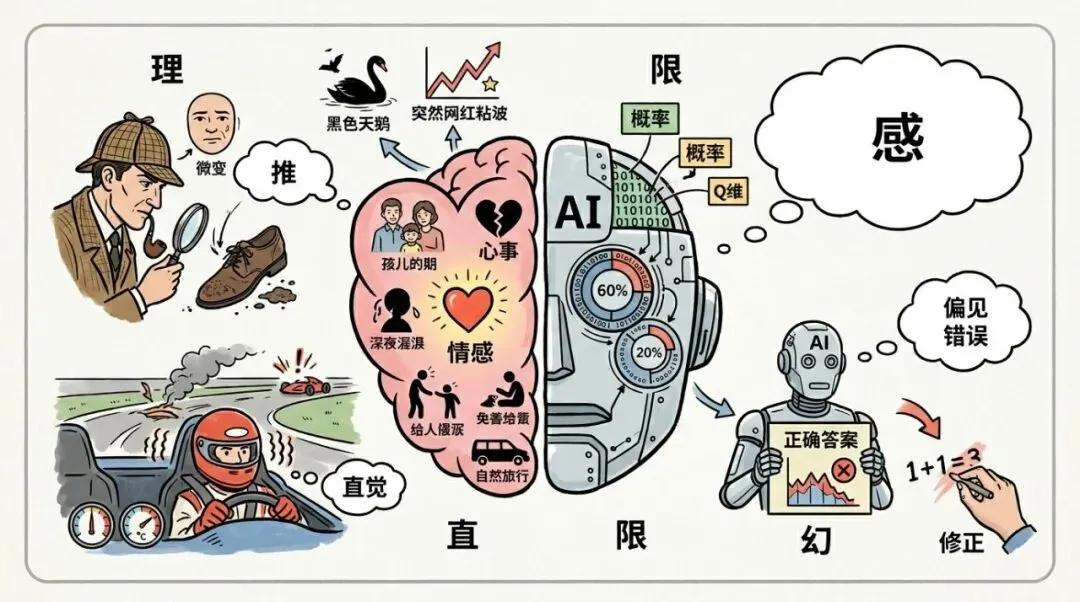

数据与感知的双重枷锁:没有源头,就没有创造

AI的所有输出都依赖存量数据。没见过的概念、没有样本的领域,对它来说就是一片空白,如同婴儿。

它能把莎士比亚风格的诗写得惟妙惟肖,但写不出《哈姆雷特》——因为那是从零到一的创造。它擅长模仿,不擅长原创。

更深层的问题是:数据的源头是什么?是人类对物理世界的感受。那么在走向通用人工智能的道路上,无法像生物体一样做到全方位感知,”有限输入“的将是永远的鸿沟。

人类先感受到冷热,才发明温度计;先感受到轻重,才定义“磅”。感受是一切概念的起点。 AI可以学习这些概念,但它从未体验过冷热,也不会主动创造新的度量单位。没有感受,就没有创造。

这也解释了机器人发展的瓶颈。目前机器人硬件已经相当成熟——力量、灵活性、爆发力,很多指标已超越正常人类。但“大脑”还不够强,尤其是缺乏感受系统。没有触觉、没有对重力和摩擦力的身体记忆,机器人只能执行预设动作,无法像人类一样通过试错建立物理直觉。

只有当模型足够强、配上完善的感受系统,机器人才能真正走向新世界。

认知局限:不懂人心,更没有灵魂

首先,AI不懂人心,也没经历过意外

它无法理解主观反叛、审美突变、黑天鹅事件。为什么某个网红突然爆火?为什么某首歌突然引发全民共鸣?AI给不了答案——它的世界只有数据和概率,没有“惊喜”。

比如福尔摩斯探案:看到一个人衣服上的泥土、饰品、微表情,综合判断他的职业、行踪——AI做不到,再比如赛车场上,专业赛车手能事实通过身体感受一切做出判断,场地环境,温度湿度,车身稳定,轮胎状况,以及突发状况,比如烟雾判断前方出事,声音判断发动机故障等等,AI也许能通过一些传感器输入了解信息,但是它没有实时、多模态的物理观察感受和判断能力。即使接入摄像头,也只是“看”像素,不是“看懂”因果。

其次,AI不知道自己不知道

人类能反思:“我刚才的推理对吗?”AI没有这种能力。这就是AI幻觉的根源——它自信满满地给出错误答案,却没有“我不确定”的信号。人类可以主动检查、修正;AI只能依赖数据,无法“跳出自己看自己”。

最深层的,AI没有灵魂

LLM的底层是概率判断——它不是在“理解”,而是在计算“下一个最可能出现的词”。它能写出“我爱你”,是因为训练数据里这个词出现无数次,而不是因为它真的感受到了爱。

人类先有感受,后有指标。AI只有指标,没有感受。它没有童年、没有失恋、没有深夜痛哭。它可以模仿深情,但复刻不了真诚。

极度理性无法产生灵魂。人类有冲动、有共情、有非理性的选择——说走就走的旅行、危难时的舍身取义。这些AI无法理解。如果强行赋予AI“冲动”,那将不可控,也不是人类想要的。这也是为什么大家担心AI发展会导致灾难。

这三层局限层层递进:看不懂外部世界 → 看不清内部状态 → 没有内在感受。它们共同构成了AI无法进步跨越那一层的鸿沟。

结尾

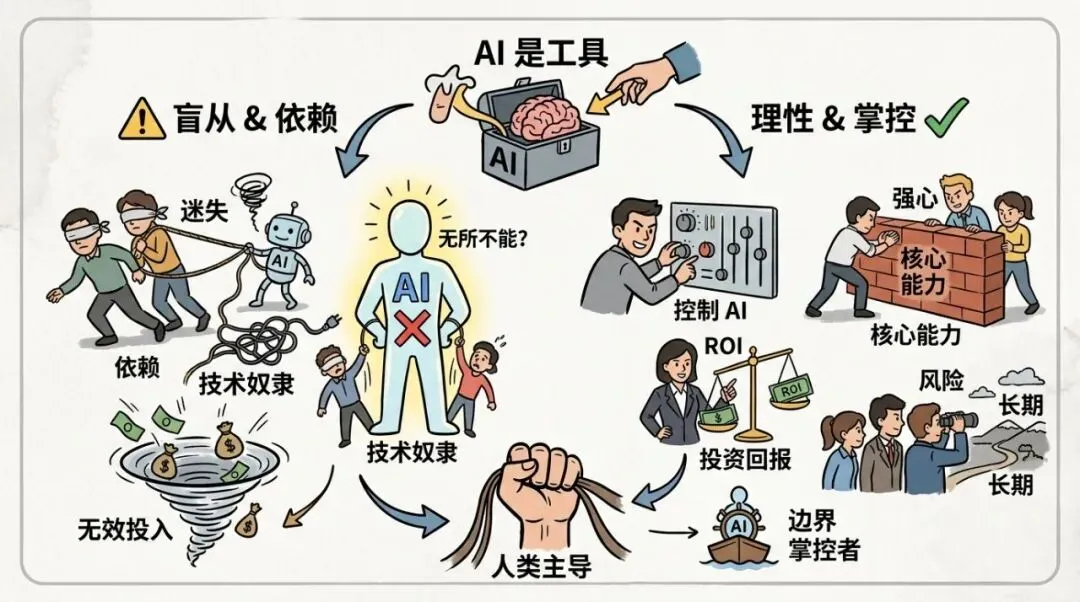

我至今确实在方方面面用 AI、拥抱 AI,没有刻意抵触,但有一点必须说清楚:别再迷信 “AI 万能” 了,真的没必要。

我们得理性看清它的边界,也得正视它背后的那些隐性代价,别盲目跟风依赖 —— 就像当年的百度、微信,到最后都是工具渗透进我们的生活,而不是我们拼命去迁就它、卷它,毕竟它最终会慢慢适应我们普通人的需求,不用我们费尽全力去深度搭建、死磕技术。

对我们普通人来说,守住自己的核心本事就够了;企业不用盲目烧钱跟风,把控好投入产出比就好;整个社会多警惕下长期风险就行。

说到底,AI 就是个工具而已,是我们用它,不是它绑着我们,我们才是掌控者,不是被它牵着鼻子走的傀儡。

欢迎在评论区聊聊:AI 到底让你更轻松还是更忙更焦虑了?下一篇,我们聊聊AI在商业化方面的发展与瓶颈。

夜雨聆风

夜雨聆风