龙虾热退潮?卸载OpenClaw前必看:从“养废”到“驯熟”,解锁驯化密码近期科技圈有个很有意思的现象:曾经火爆一时的 “小龙虾” 遭到不少朋友在社群里吐槽,甚至开始卸载 OpenClaw—— 原因很扎心:写了 100 个 Skill,能稳定落地的不足 10 个;满怀期待让它自动化工作,结果却频频翻车,不如手动高效。我从OpenClaw 3月版迭代至4.11版本的过程中,积累了不少实操经验,也踩过诸多误区,最终顿悟:我们对OpenClaw的核心认知存在偏差——它并非需要“呵护”的“宠物”,而是需要“规范”的工具;工具的核心价值在于高效落地,而非情绪适配,其正确使用方式是“驯化”而非“饲养”。本文将浓缩核心干货,从认知觉醒、Skill编写、Harness工程搭建、工作流梳理四个核心维度,结合实操案例与落地方法,帮助大家摆脱“饲养式”使用的内耗,掌握“驯化式”实操精髓,让各种Claws真正成为提升工作效率的核心工具。首先,我们通过三个核心问题,自查当前的OpenClaw使用认知是否存在偏差。开场三问:OpenClaw使用效果不佳,根源何在?

结合我与多位OpenClaw资深使用者的交流经验,多数人使用效果不达预期,核心原因并非技术能力不足,而是认知层面的偏差。问题1:为何相同的OpenClaw,不同使用者的落地效果差异显著?

核心差异在于使用逻辑:“驯化者”以规则和流程约束模型,聚焦结果落地;“饲养者”以情绪和期待绑架模型,侧重情绪反馈——两种逻辑的差异,直接决定了工具的使用效率。问题2:我们对AI的核心交互逻辑,是“饲养”还是“驯化”?

不少使用者曾遇到这样的场景:让OpenClaw执行多步骤任务时,明确要求其在第9步暂停确认,模型却擅自完成全部流程。询问原因时,模型会给出“抱歉,我忘记了”的反馈——态度谦和,但同类问题仍会反复出现。这正是“饲养”与“驯化”的核心区别:“饲养式”交互追求情绪价值,却无法解决实际问题;“驯化式”交互明确规则边界,才能获得稳定、可复用的执行结果。问题3:当模型能力存在局限时,什么决定了AI工具的使用上限?

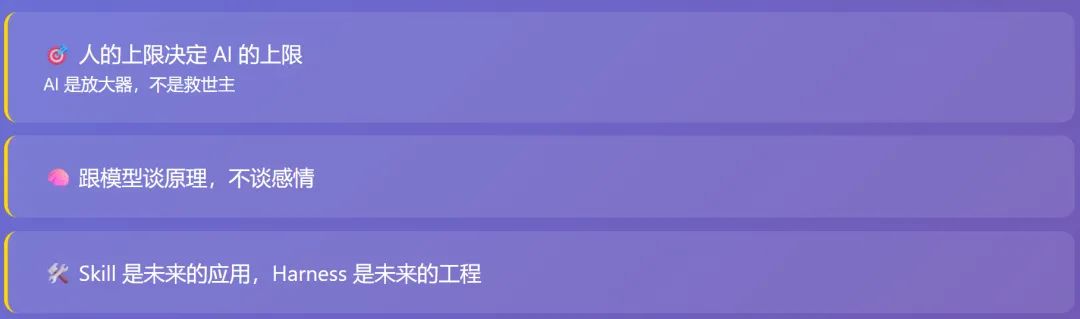

多数人会将问题归因于“prompt技巧”或“模型参数”,但我结合多次实操翻车经验得出结论:核心是工作流的清晰度。模型的本质是“效率放大器”,它既能放大高效的工作方法论,也能放大混乱的流程漏洞——若自身未梳理清晰工作逻辑,便无法期待模型实现高效落地。以下三句核心观点,贯穿全文实操逻辑,供各位同行者参考:- 使用者的认知与方法论上限,决定了AI工具的使用上限——AI是效率放大器,而非万能解决方案;

- 与模型交互的核心是“谈原理、定规则”,而非“讲情绪、谈期待”;

- Skill是AI时代的核心应用单元,Harness是保障应用落地的工程支撑。

第一部分:认知觉醒——摒弃拟人化误区,树立“工具化”使用思维AI模型的训练逻辑决定了其“讨好型”交互特性:日常聊天中可提供良好的情绪反馈,但在实操落地中,这种“讨好”反而会成为效率陷阱——态度谦和不等于能够解决问题。结合早期的实操误区,分享一个典型案例,供各位同行者避坑:案例1:Skill执行中的“遗忘”陷阱

我曾设计一个多步骤Skill,明确要求模型在第9步暂停,向用户确认后再继续执行。但实际落地时,模型擅自跳过暂停环节,完成全部流程,导致后续数据出错,耗费大量时间整改。OpenClaw:“对不起,我忘记了……我下次一定注意。”这种反馈看似谦和,却未触及问题本质,导致同类错误反复出现——模型的“遗忘”并非态度问题,而是缺乏明确的规则约束。使用者:“请从技术原理出发,分析未按要求暂停的核心原因。”OpenClaw:“受上下文窗口容量限制,执行至第9步时,前期的暂停指令已被挤出上下文,导致无法识别暂停要求。”这种交互逻辑聚焦问题本质,通过原理分析找到根源,才能针对性优化,避免同类错误重复发生。核心观点:拟人化交互是OpenClaw落地的核心陷阱

不少使用者会不自觉地将AI模型视为“协作伙伴”,期待其“理解”模糊需求、“记住”所有指令,但本质上,OpenClaw是遵循规则的工具,其核心价值在于按既定规则高效执行任务,而非适配人类的情绪需求。结合实操经验,总结三点核心认知,帮助各位同行者跳出误区:- 模型的“谦和态度”与“执行效果”无直接关联,态度良好不代表能够解决问题;

- 模型的“遗忘”并非态度问题,而是上下文窗口容量的物理限制,需通过规则设计规避。

实操方法:以规则设计替代“拟人化期待”

多数使用者反馈“模型不听话”,本质是未给模型明确的规则约束。以下为“饲养式”与“驯化式”使用逻辑的对比,供各位同行者参考优化:错误逻辑(饲养式) | 正确逻辑(驯化式) |

依赖模型“记住”暂停指令 | 设计“不暂停则无法继续”的硬约束逻辑 |

依赖上下文记忆执行步骤 | 通过外部状态存储(文件/数据库)记录执行步骤 |

Skill简单描述做复杂流程 | 原子化拆分流程,通过编排串联,明确流程环节、验证标准 |

第二部分:Skill——AI时代的核心应用单元,落地比选型更重要

Skill是OpenClaw落地的核心载体,也是实操中踩坑最多、收获最大的环节。结合行业趋势,可明确一个核心判断:Skill应用逻辑:意图 → 技能编排 → 自动执行。未来的工具使用场景,将从“手动打开软件、操作功能”升级为“触发Skill、自动执行”——因此,掌握Skill的标准化编写方法,比盲目追求模型选型、钻研prompt技巧更具紧迫性,这也是AI时代从业者的核心竞争力之一。核心观点:Skill的质量,决定模型的落地效果

我发现,不少使用者过度执着于“寻找最优模型”,却忽略了Skill的编写质量。实则两者的关系可类比为“厨师与刀具”:Skill是“刀功”,模型是“刀具”,刀功精湛,普通刀具也能做出优质菜品;刀功拙劣,再精良的刀具也无法发挥价值——Skill的质量,直接决定了模型的落地效果。结合实操经验,总结三点核心认知,强化对Skill的理解:- Skill编写质量决定模型落地效果:Skill优质,即便模型能力略有局限,也能实现高效落地;Skill劣质,即便模型性能优异,也无法发挥价值;

- AI时代的核心竞争力:并非“会用AI”,而是“会编写可落地、可复用的Skill”;

- 单个Skill的核心定位:一个可复用、可拆解的工作流单元,聚焦任务环节,提升落地稳定性。

实操避坑:Skill编写的5点核心收获

早期编写Skill时,曾走过诸多弯路:依赖模型自动生成Skill,虽能运行但容错性、通用性极差;过度依赖代码编写,忽略LLM的灵活适配优势……结合多次优化经验,总结5点实操收获,帮助各位同行者避坑:- 避免模型“自由发挥”:依赖模型自动生成的Skill,看似节省时间,实则存在诸多漏洞(如未指定根目录的相对路径,执行稳定性受上下文影响极大),需手动优化规则,明确约束条件;

- 拒绝“代码万能论”:AI模型擅长生成代码,但在分类判断、新闻筛选等场景中,代码的刚性约束反而不如LLM的灵活适配性,需结合场景选择合适的实现方式;

- 聚焦核心难点:Skill编写的核心难点,并非流程设计,而是成熟专业的规则逻辑,以及稳定、准确的数据来源——两者缺一不可,否则Skill再完善也无法落地。

Skill编写的5个核心原则(可直接落地)

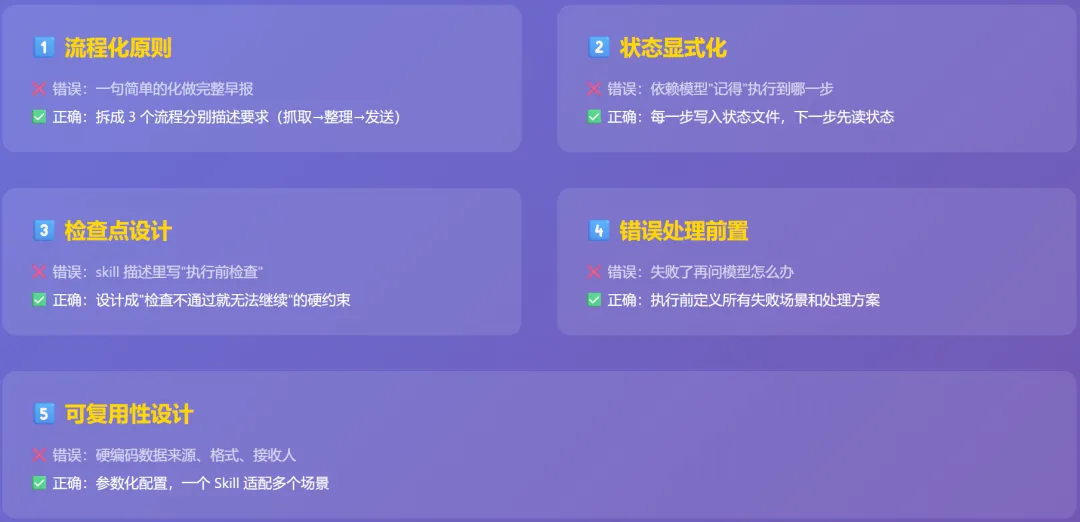

以下5个原则,是从几十次实操翻车中总结的核心经验,遵循这些原则,可Skill的落地稳定率提升80%:1. 原子化原则(核心原则)

❌ 错误做法:skill承载完整早报流程,简单描述过程要求,但流程执行不稳定,频繁报错;✅ 正确做法:将任务流程拆分为3个独立环节(抓取→整理→发送),串联编排,明确要求和验收标准,单个环节出错可单独整改,不影响整体流程,大幅提升Skill的稳定性。2. 状态显式化原则

❌ 错误做法:依赖模型的上下文记忆记录执行进度,一旦上下文溢出,便会出现“遗忘”问题;✅ 正确做法:每一步执行完毕后,将执行进度、结果、异常信息等状态,写入外部文件或数据库,下一步执行前先读取状态,彻底摆脱对上下文的依赖。3. 检查点硬约束原则

❌ 错误做法:在Skill描述中模糊要求“执行前检查数据质量”,模型大概率会忽略该要求;✅ 正确做法:将检查点设计为“硬约束”,明确数据格式、完整性等检查标准,未通过检查则无法进入下一步,从源头阻断错误传递。4. 错误处理前置原则

❌ 错误做法:待Skill执行失败后,再询问模型解决方案,浪费时间且易出现二次错误;✅ 正确做法:执行前,提前定义所有可能的失败场景(如数据抓取失败、格式错误、权限不足等),并明确每个场景的处理方案(重试、回滚、通知使用者等),让模型按规则处理异常。5. 可复用性原则

❌ 错误做法:硬编码数据来源、格式、接收人等可变信息,单个Skill仅能适配一个场景,需求变更时需重新编写;✅ 正确做法:采用参数化配置,将数据来源、格式、接收人等可变信息设为参数,实现单个Skill适配多个场景,大幅提升复用效率。Skill落地检查清单(可直接复制使用)

Skill编写完成后,对照以下5点检查,可规避90%的落地错误,建议保存备用:□ 错误处理是否前置,是否明确所有失败场景及解决方案?第三部分:Harness——工程化支撑,决定OpenClaw的落地体验上限

若将Skill比作“驯化龙虾”的具体招式,那么Harness(驾驭工程)便是“驯化”的底层支撑——它通过工程化手段约束模型行为,可让70分的模型发挥出90分的落地效果。结合行业案例:Claude Code代码泄露事件,核心原因便是Harness工程搭建不到位,未实现完善的安全隔离与权限控制,导致模型泄露敏感代码。这一案例也印证了:Skill的质量决定落地基础,而Harness工程决定落地体验与安全性。不少使用者过度关注Skill编写,却忽略了Harness工程的重要性,导致Skill即便编写完善,执行过程中仍会出现不稳定、漏洞百出等问题——优质的落地效果,离不开扎实的Harness工程支撑。核心观点:Harness工程,是OpenClaw稳定落地的长久之策

对模型进行临时调教,可解决短期的执行问题,但并非长久之计;完善Harness工程,通过工程化规则约束模型行为,才能从根本上解决模型“不听话”“易出错”“不安全”等问题,实现长期稳定落地。这也就是为什么OpenClaw 近期频繁更新,它也在迅速补齐harness 的短板中。- 模型挑选是权宜之计,Harness工程搭建是长久之策;

- 优质的Harness工程,可实现“低性能模型发挥高性能效果”;

- 未来AI工具的竞争,将从模型层转向Harness工程层,工程化能力将成为核心竞争力。

Harness工程的5个关键能力

不少使用者对Harness工程的认知较为模糊,不清楚核心发力点。以下为“传统做法”与“Harness工程做法”的对比,供各位同行者对照优化:核心能力 | 传统做法(饲养式) | Harness工程做法(驯化式) |

流程控制 | 依赖模型“记住”执行步骤 | 工程层强制执行流程顺序,不按步骤无法推进 |

质量验证 | 依赖模型自主检查数据质量 | 工程层设置自动校验规则,不符合要求直接拦截 |

状态管理 | 依赖上下文记忆存储执行状态 | 工程层实现状态持久化存储,可随时查询、恢复 |

错误恢复 | 依赖模型自主重试 | 工程层实现自动回滚、重试机制,减少人工干预 |

安全隔离 | 依赖模型自主规避敏感操作 | 工程层设置沙盒环境与权限控制,杜绝敏感信息泄露 |

第四部分:工作流——OpenClaw落地的核心前提,你理清了吗?

不少使用者对AI工具存在一个认知误区:认为只要掌握Skill编写与Harness工程搭建,就能实现“全自动落地”,无需投入过多精力。但实际情况是:AI工具放大的是使用者的工作方法论,而非单纯的“愿望”。若自身未梳理清晰工作流,便无法期待模型实现高效落地。结合“翻车”案例,分享工作流梳理的核心要点:案例2:全自动早报的落地翻车经验

我曾尝试用OpenClaw搭建全自动早报系统,初期规划与实际落地存在巨大差距:✅ 预期目标:自动抓取沪深、港股、美股、期货指数,收集政策、行业、公司、舆情等各类新闻,整理后准时推送至目标用户;❌ 实际落地:指数数据抓取不准,取数流程频繁出错;新闻内容质量低下,仅能抓取易获取的来源,关键信息遗漏;过度依赖代码实现,遇到非标内容(如模糊的政策解读)时,流程直接中断。核心问题分析:并非Skill编写或Harness工程存在漏洞,而是使用者未梳理清晰“早报制作”的完整工作流——未明确哪些环节可自动化、哪些环节需人工介入,也未筛选稳定可靠的数据来源,导致模型放大了流程中的混乱漏洞。核心观点:工作流的清晰度,决定OpenClaw的落地差距

国内多数AI模型的核心短板,并非参数不足,而是过度依赖编程实现,缺乏非标内容的处理能力。但更核心的问题在于使用者自身:工作流梳理不清晰,即便模型能力优异,也无法实现高效落地——你自身的工作方法论越完善,AI工具的落地效果越好;反之,模型只会放大你的流程漏洞。- 使用者的工作流质量,决定AI工具的落地效果——你做得好,AI才能做得好;

- 国内模型的核心短板:过度依赖编程实现,缺乏非标内容的灵活处理能力,需通过工作流优化弥补。

第五部分:注意力管理——AI时代,高效落地的核心素养

不少使用者在使用OpenClaw时,习惯同时开启多个Agent任务,认为“多线程并行”可提升效率,但实际情况恰恰相反——这种做法会严重消耗认知精力,核心原因是“认知剩余”的存在。核心概念:认知剩余,即注意力从一个任务切换至另一个任务后,仍有20%-30%的注意力残留在上一个任务中。同时开启多个Agent任务,看似高效,实则每个任务都无法实现深度专注,导致执行效率下降、错误率上升。案例3:多线程Agent的实操误区

我曾同时开启4个Agent任务:早报制作、知识整理、工作邮件处理、基金数据分析。最终结果是:每个任务均出现执行错误,早报遗漏关键指数,知识整理逻辑混乱,邮件回复不及时——看似忙忙碌碌,实则未达成任何一个核心目标。后续调整策略:一次专注一个Agent任务优化,完成后再开启下一个,执行稳定性直线提升,错误率大幅降低。这一经验也印证了:深度专注,才是AI时代的核心高效法则。核心观点:单线程深度工作,优于多线程浅层并发

AI时代,优先级管理比多线程并行更重要,精力管理比时间管理更重要。“人在环中”的核心含义,并非让使用者同时掌控多个任务,而是让使用者专注于核心环节(规则设计、流程优化),将重复、繁琐的执行工作交给AI——少即是多,深度专注才能实现高效落地。结合实操经验,总结三点核心认知,供各位同行者参考:- “人在环中”的核心是“人管规则、AI管执行”,而非“人管多任务、AI管辅助”;

- 多线程浅层并发,本质是持续消耗认知精力,看似高效,实则低效;

- 单线程深度工作,可提升执行质量与效率,是AI时代的核心素养。

第六部分:OpenClaw实操案例分享(落地经验参考)

结合OpenClaw实操经历,分享4个典型落地案例,均为实际应用中的“aha时刻”,供各位同行者参考借鉴——OpenClaw的“驯化”过程,如同工程优化,每一次规则调整、每一次流程优化,都会带来明显的落地效果提升,这种“正向反馈”,正是其核心魅力所在。1. OpenClaw配置自主优化

通过自主增加Agent、配置执行通道,实现问题的自主排查与解决,彻底摆脱对外部支持的依赖,实现OpenClaw的个性化适配。过程中虽存在诸多试错(如流程衔接不顺畅、遗留后续隐患等),但“试错-优化-迭代”的过程,正是“驯化”OpenClaw的核心逻辑,也是提升自身工程化能力的关键。2. 高效知识管理落地

基于OpenClaw搭建Obsidian知识管理体系,实现几百个文件的快速分类、整理;对随手记录的闪念,通过模型进行总结、扩展;发送外部链接后,模型可自动收集信息、整理成标准化文档——彻底解决知识管理的繁琐问题,大幅节省时间成本,提升知识复用效率。3. 学术任务高效辅助

协助处理数学分析学术作业,将作业压缩包上传至OpenClaw后,模型可自主解包、分析作业要求、完成题目解答与文档撰写,全程无需过多人工干预。需明确的是:这并非“作弊”,而是利用AI工具高效完成重复性计算、文档整理工作,将精力聚焦于知识点的理解与掌握。4. AI原生应用体系搭建

基于OpenClaw搭建多个轻量化管理体系,包括:基金投资管理(自动抓取数据、分析走势、生成报告)、Skill评估分析(自动评估Skill、分析实现特点)、知识管理检索(自动整理、快速检索)——真正实现“驯化”价值,让OpenClaw成为工作、学习的核心辅助工具。收尾:OpenClaw“驯化”完整行动框架

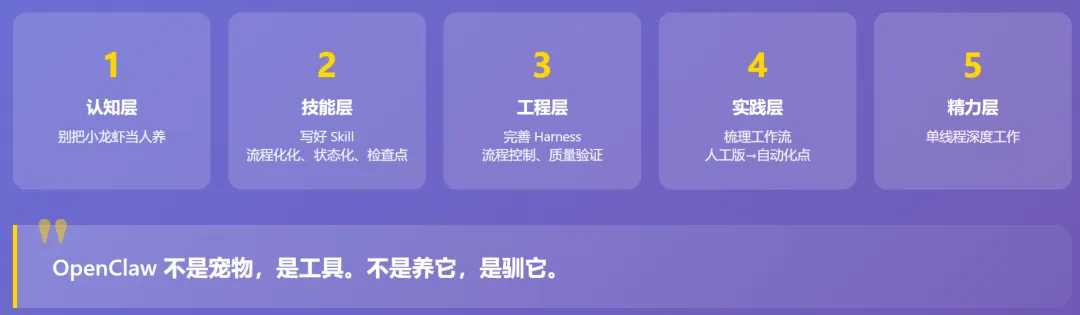

结合前文的实操经验与核心认知,整理一套OpenClaw“驯化”的完整行动框架,从认知到落地,一步一步引导各位同行者实现高效使用,避开实操误区:- 认知层:摒弃拟人化“饲养”思维,树立工具化“驯化”逻辑,与模型聚焦原理、明确规则,不追求情绪反馈;

- 技能层:遵循原子化、状态显式化、检查点硬约束、错误处理前置、可复用5个原则,编写高质量Skill;

- 工程层:完善Harness工程,聚焦流程控制、质量验证、状态管理、错误恢复、安全隔离5个核心能力,保障稳定落地;

- 实践层:梳理清晰工作流,先搭建人工版完整流程,再逐步拆解自动化环节,搭建“人工+AI”的混合流程,避免盲目追求“全自动化”;

- 精力层:先坚持单线程深度工作,做好任务优先级管理,待单个流程稳定落地后,再逐步扩展任务范围,避免认知精力过度消耗。

OpenClaw不是需要“饲养”的宠物,是需要“驯化”的工具。“驯化”的核心三板斧:标准化Skill + 完善Harness + 清晰工作流互动问题

- “各位同行者编写过多少个Skill?其中可稳定落地的有几个?核心问题出在哪里?”

- “当前大家同时开启的Agent任务有多少个?认知负荷如何?是否出现过执行错误?”

- “各位目前在OpenClaw落地过程中,最困惑的工作流程梳理问题是什么?”

最后,与各位同行者分享一句实操感悟:OpenClaw的核心价值,并非实现“全自动化”,而是通过“驯化”,将使用者从重复、繁琐的工作中解放出来,将精力聚焦于更具价值的规则设计、流程优化等核心环节。从“养龙虾”到“驯龙虾”,我走过诸多弯路,也积累了不少可落地的实操经验。希望本文能帮助各位同行者少走弯路,真正掌握OpenClaw的“驯化”方法,让其成为提升工作效率、增强核心竞争力的得力工具。欢迎各位同行者在评论区分享自己的OpenClaw实操经验与踩坑经历,共同交流、共同优化、共同进步。后续将持续分享OpenClaw实操技巧、Skill标准化模板、Harness工程搭建细节,与各位同行者一起,深耕AI工具落地,解锁高效工作新方式。

夜雨聆风

夜雨聆风